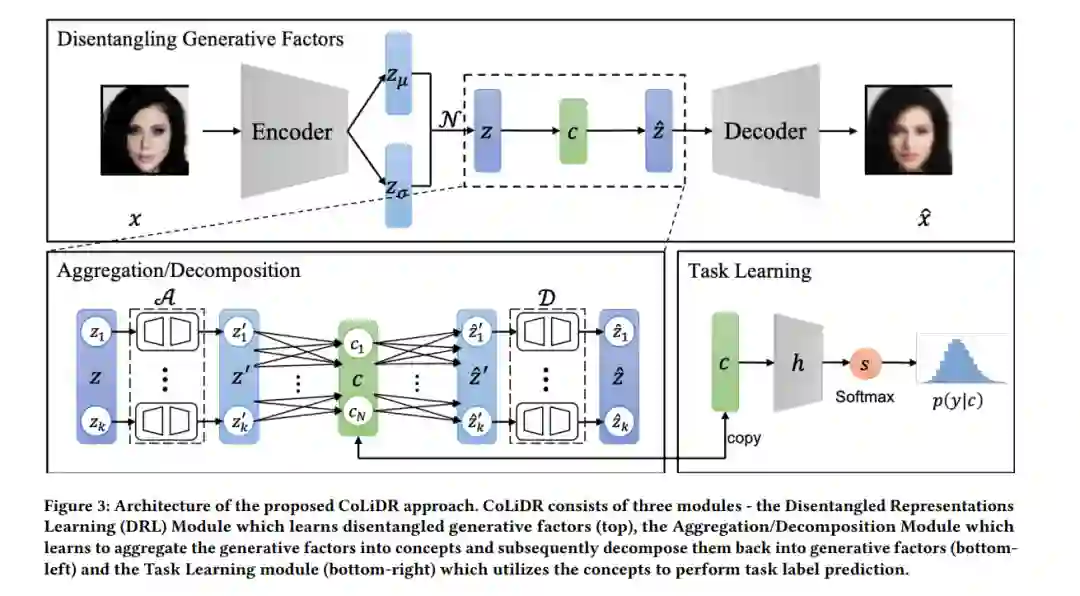

深度神经网络的可解释性研究通过基于概念的模型提供了一种有前景的方法,以人类可理解的概念来解释模型行为。另一条平行的研究路径则侧重于将数据分布解缠为其底层生成因子,从而解释数据生成过程。虽然这两种方向都得到了广泛关注,但很少有工作致力于将生成因子解释为概念,从而将数学上解缠的表示与人类可理解的概念统一起来,以用于下游任务的解释。在本文中,我们提出了一种新方法CoLiDR,该方法利用解缠表示学习框架来学习相互独立的生成因子,并随后通过一个新颖的聚合/分解模块将这些表示聚合为人类可理解的概念。我们在具有已知和未知潜在生成因子的数据集上进行了实验。实验结果表明,我们的方法能够成功地将解缠的生成因子聚合为概念,同时与最先进的基于概念的方法保持一致。对学习到的聚合过程的定量和可视化分析显示了我们的方法相较于常用的基于概念的模型在四个具有挑战性的数据集上的优势。最后,我们的方法可以推广到任意数量的概念和生成因子,使其足够灵活,适用于各种类型的数据。

成为VIP会员查看完整内容

相关内容

Arxiv

225+阅读 · 2023年4月7日