人工智能(AI)有可能在社会、经济和政策的各个方面带来变革,包括国防和安全。英国希望成为在民用和商业应用领域推广人工智能以及负责任地发展国防人工智能的领头羊。这就要求对与人工智能军事应用相关的新出现的风险和机遇,以及英国如何与其他国家开展最佳合作以减轻或利用这些风险和机遇,有一个清晰而细致的认识。

2024 年 3 月,英国国防部(MOD)国防人工智能与自主单元(DAU)和外交、联邦与发展办公室(FCDO)联合委托兰德欧洲公司(RAND Europe)开展一项简短的范围界定研究。该研究的目的是初步探讨人工智能在军事上的应用可能在战略层面产生风险和机遇的方式,因为迄今为止的大部分研究都集中在战术层面或非军事主题(如人工智能安全)上。后续工作将更详细地探讨这些问题,为英国在这些问题上的国际参与战略提供信息。

本技术报告旨在为理解人工智能军事应用所带来的战略风险和机遇设定一个基线。一份独立的总结报告则侧重于为决策者提供高层次的研究结果。

人工智能的出现正在给竞争和冲突带来深刻变化

人工智能最好被理解为一套双重用途的通用技术,以硬件为基础,但以软件为核心。与传统军事技术不同的是,它们高度民主化,扩散速度极快。创新是由商业用途的私营部门驱动的,而不是由政府或国防部门驱动的。对军事应用和影响的集体认识正在提高,但起点较低。辩论往往优先考虑某些引人注目的问题,如致命自主武器系统(LAWS)或人工智能(AGI),而忽略了其他议题。它只关注战术,而忽视战略;只关注风险,而忽视机遇;或只关注军事人工智能的直接后果,而忽视从长远来看可能影响最大的二阶和三阶效应。

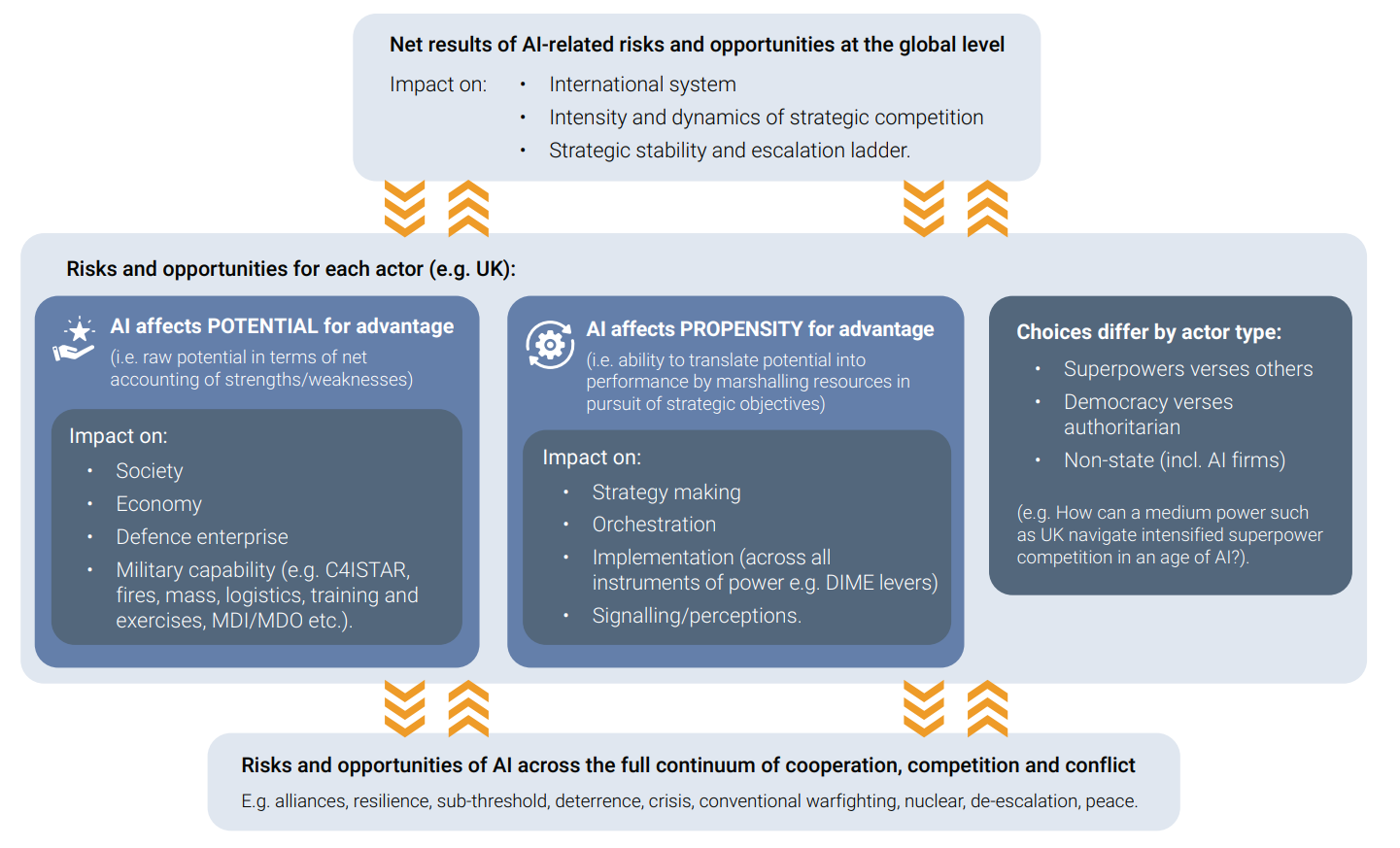

为了解决这个问题,国防部和国防和外交、联邦与发展办公室(FCDO)委托进行这项研究,以制定一个概念框架,规划军事人工智能带来的战略风险和机遇。

图 0.1 框架:人工智能军事应用的战略风险与机遇

人工智能对国防和安全构成复杂、重大且未被充分认识的风险

本报告详细探讨了许多风险和机遇,其中最紧迫的包括

-

信息操纵,如人工智能深度伪造,这不仅会引发政治、经济和社会问题,还会在危机时刻影响军事决策。

-

赋予非国家行为者挑战国家军队主导地位的不对称能力,或者在最坏的情况下,赋予他们新的大规模毁灭性工具(如生物武器)。

-

人工智能对对手之间攻防平衡、战争升级动态以及核威慑稳定性的相互影响。这些问题在超级大国竞争加剧的情况下,在世界已经在应对其他不安全因素(如乌克兰、以色列-伊朗\移民、气候变化等)的情况下,尤其令人担忧。

-

与未来出现的任何人工智能相关的潜在灾难性安全和安保风险。

在英国国内,还需要应对对国内政治和经济产生破坏性影响的重大问题。这些问题决定了国防的目的和手段。在国外,人工智能同样会对以规则为基础的国际秩序的健康产生深远影响,这取决于各国、工业界和民间社会是否以及如何有效地共同管理其影响。人工智能专家非常担心,人工智能会在多大程度上使世界许多地方的平衡倾向于压制性和独裁的治理模式,同时有可能颠覆民主政治、污染信息环境和破坏社会的战斗意志。

同样,在军事人工智能方面的领导力也可能带来巨大的利益。

其中许多潜在风险也可能成为战略优势的机遇。人工智能的利弊平衡取决于各国如何快速有效地调整武装部队等机构,以利用人工智能的优势。同样,这也取决于各国政府如何在国际上施加影响,使全球军事人工智能行为朝着符合本国利益和价值观的方向发展。这就意味着各国政府要愿意进行重大投资、组织改革和文化变革,以改变国防部门对新技术的态度。

需要采取紧急行动,降低新出现的风险,利用各种机遇

为了应对这些挑战,各国必须紧急制定一项全面的行动计划,考虑到人工智能技术进步、围绕人工智能或通过人工智能进行的地缘政治竞争以及国际体系中围绕人工智能不断演变的规范之间复杂的相互作用。这应利用一套影响不同受众的机制工具包,运用外交、信息、军事和经济(DIME)杠杆,汇集一套积极主动的行动方案:

- 努力促进负责任地采用人工智能,最大限度地发挥其对国防的益处。

- 努力限制非国家行为者、恐怖主义行为者或敌对/无赖国家采用军事人工智能,同时也要让他们付出代价,以影响他们的行动。

- 努力为军事人工智能制定全球、小型和双边治理安排。

这也应借鉴其他领域的经验教训--如本报告所述--以及最近关于人工智能的高级别倡议的势头。突出的例子包括布莱切利峰会、军事领域负责任的人工智能(REAIM)峰会和《军事人工智能政治宣言》。

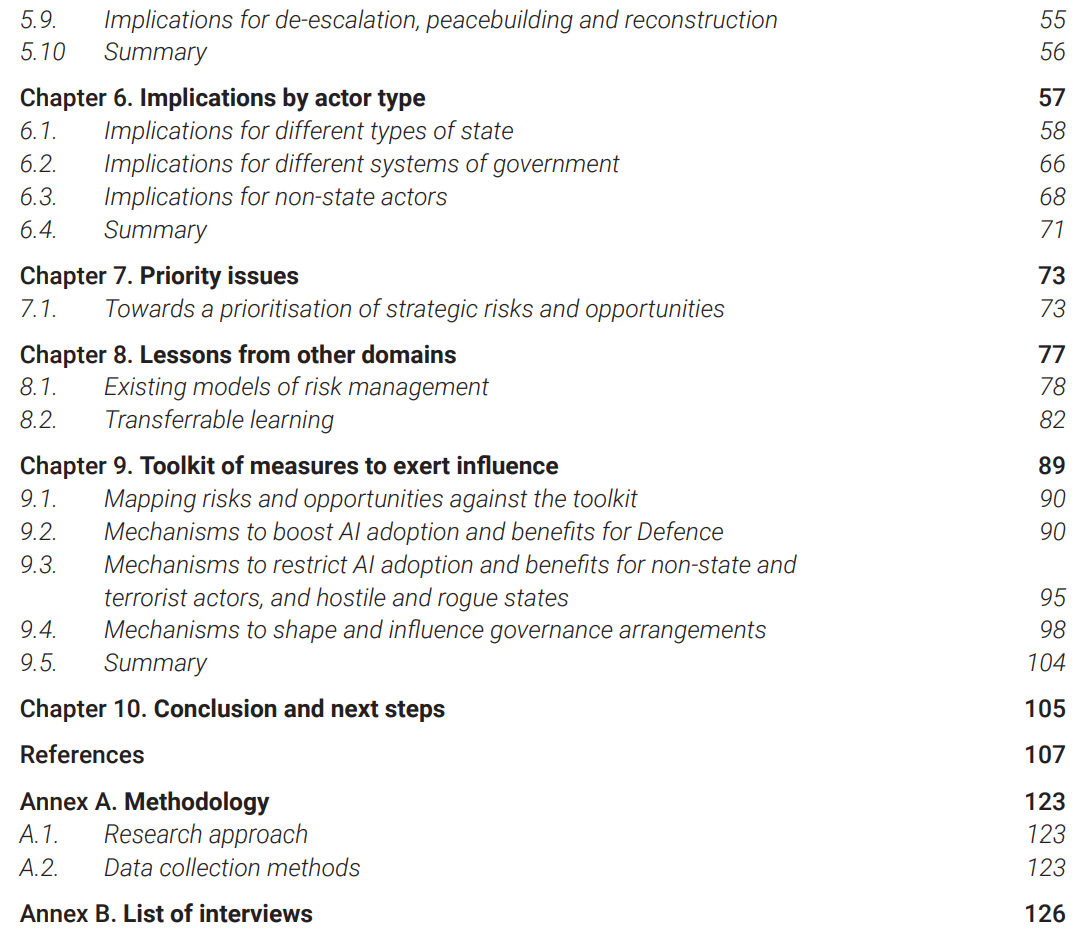

表0.2塑造全球国防人工智能发展的机制工具包

| 工具包类别 | 优先行动手册 |

|---|---|

| 促进英国国防采用人工智能并从中获益的机制 | 加快整个国防领域对人工智能的投资和采用,同时提高抵御恶意或意外滥用人工智能的能力 |

| 限制采用人工智能的机制和对手的利益 | 采取竞选方式,限制、减缓或增加对手(国家或非国家)部署军事人工智能的成本 |

| 形成新的军事人工智能管理安排的机制 | 在提高对军事人工智能风险的认识、发现问题和分享学习成果方面发挥领导作用;与主要盟国(如美国)和竞争对手制定透明度和建立信任措施,以降低升级风险;促进采用包容性和参与性方法,就人工智能军事领域负责任的行为规范达成新的全球共识,为今后达成更强有力的具有约束力的协议做好准备;促进减少核和生物相关的人工智能紧急风险的小型多边机制的平行发展;研究如何将人工智能纳入核查和合规机制,反之亦然;随着时间的推移,将当前零散的人工智能治理倡议整合为一个更加具体的架构 |