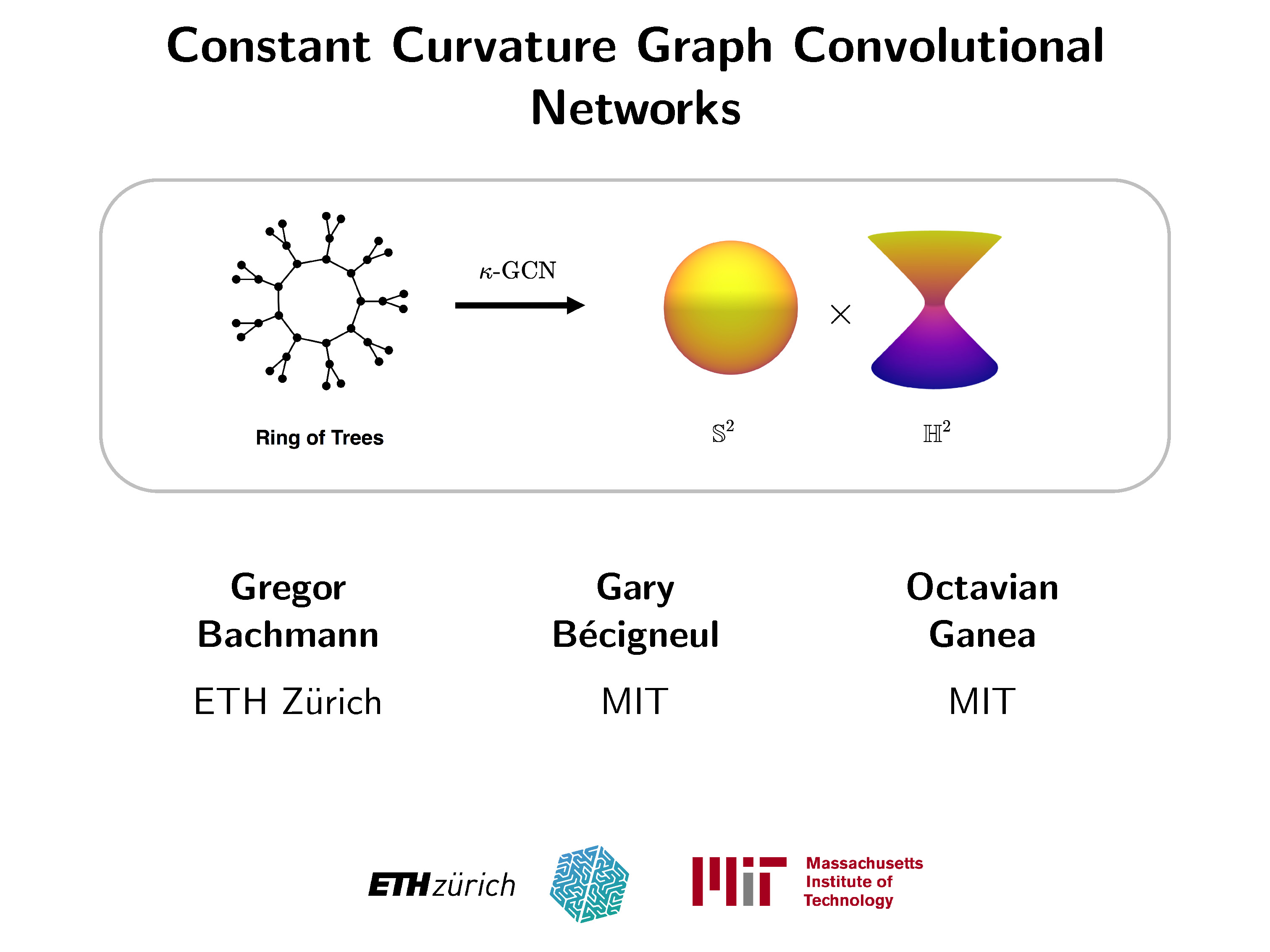

最近,人们对在非欧几里得空间中表示数据的方法(例如双曲或球面)越来越感兴趣,这些方法提供了对某些真实世界数据属性(例如无尺度、分层或循环)有用的特定归纳偏差。然而,流行的图神经网络目前仅限于通过欧几里得几何和相关的向量空间操作来建模数据。在这里,我们通过提出将图卷积网络(GCN)在数学基础上推广为常曲率空间的(乘积)来弥补这一差距。我们通过i)引入一种统一的形式,可以在所有常曲率几何之间平滑地插入,ii)利用陀螺质心坐标,推广了经典的欧几里德质心概念。当曲率从任何一边变为零时,我们这类模型平滑地恢复它们的欧几里得对应模型。根据其离散曲率,我们在非欧几里得行为的符号数据上的节点分类和失真最小化的任务表现优于欧几里得GCNs。

https://arxiv.org/abs/1911.05076

概述

图卷积网络 针对图像数据的卷积网络和深度学习的成功启发了对于共享参数与图形几何形状一致的图推广。Bruna等人(2014);Henaff等人(2015)是利用图上的局部谱滤波器在图傅里叶空间中开发频谱图卷积神经网络的先驱。然而,为了减少对拉普拉斯特征模式的图依赖,Defferrard等人(2016)利用Hammond等人(2011)的结果使用Chebyshev多项式近似卷积滤波器。所得到的方法(在附录A中讨论)在计算效率和精度和复杂性方面是优越的。此外,Kipf和Welling(2017)通过考虑一阶近似来简化这种方法,从而获得高可伸缩性。提出的图卷积网络(GCN)是通过对称归一化邻接矩阵来插值节点嵌入,而这种权值共享可以理解为一种有效的扩散式正则化器。最近的工作扩展了GCNs,实现了链接预测(Zhang & Chen, 2018)、图分类(Hamilton等,2017;和节点分类(Klicpera et al., 2019;Velickoviˇc et al .´, 2018)。

ML中的欧几里得几何。在机器学习(ML)中,由于各种原因,数据通常在欧几里得空间中表示。首先,有些数据本质上是欧几里得的,比如经典力学中三维空间中的位置。其次,直觉在这样的空间中更容易,因为它们拥有一个吸引人的矢量结构,允许基本的算术和丰富的线性代数理论。最后,许多感兴趣的量,如距离和内积在封闭公式中是已知的,可以在现有的硬件上非常有效地计算。这些操作是当今大多数流行的机器学习模型的基本构建模块。因此,欧几里得几何强大的简单性和效率已经导致许多方法实现了最先进的任务,如机器翻译(Bahdanau等,2015;wani et al., 2017),语音识别(Graves et al., 2013),图像分类(He et al., 2016)或推荐系统(He et al., 2017)。

黎曼ML 尽管取得了成功,但某些类型的数据(例如分层数据、无标度数据或球形数据)被证明可以更好地用非欧几里德几何表示(Defferrard et al., 2019;Bronstein等,2017;Nickel & Kiela, 2017;Gu et al., 2019),尤其带来了丰富的流形学习理论(Roweis & Saul, 2000;和信息几何(Amari & Nagaoka, 2007)。在活力操纵非欧几里得几何的数学框架被称为黎曼几何(Spivak, 1979)。虽然它的理论导致了许多强而优雅的结果,但它的一些基本量,如距离函数d(·,·),通常不能以封闭的形式提供,这对许多计算方法都是禁止的。

常曲率几何的代表性优势。在一般黎曼流形和欧几里得空间之间的一个有趣的权衡是由常截面曲率流形给出的。他们一起定义了所谓的双曲(负曲率),椭圆(正曲率)和欧几里得(零曲率)几何。正如下面和附录B中所讨论的,欧几里得空间在嵌入某些类型的数据(如树)时具有局限性,并且会产生很大的失真。在这些情况下,双曲空间和球面空间具有代表性的优势,为各自的数据提供了更好的归纳偏差。

双曲空间可以直观地理解为一棵连续树:球的体积随半径呈指数增长,类似于二叉树的节点数随深度呈指数增长(图1)。它的树状性质已经被数学研究了很长时间(Gromov, 1987;哈曼,2017;与欧几里得几何结构相比,它被证明能够更好地嵌入复杂网络(Krioukov et al., 2010)、无标度图和分层数据(Cho et al., 2019; Sala et al., 2018; Ganea et al., 2018b; Gu et al., 2019; Nickel & Kiela, 2018; 2017; Tifrea et al., 2019)。一些重要的工具或方法找到了它们的双曲线对应物,例如变分自编码器(Mathieu et al., 2019;、注意力机制(Gulcehre等,2018)、矩阵乘法、递归单位和多项logistic回归(Ganea等,2018)。

常曲率空间中的GCNs。在这项工作中,我们引入了一个扩展的图形卷积网络,它允许学习存在于具有任何曲率符号的常曲率空间(乘积)中的表示。我们通过将导出的统一陀螺框架与GCNs的有效性相结合来实现这一点(Kipf & Welling, 2017)。与我们的工作同时,Chami等人(2019年);Liu等人(2019)考虑了通过切线空间聚合在双曲空间中学习嵌入的图神经网络。他们的方法将在第3.4节中作更详细的分析。我们的模型更一般化,因为它在一个包含双曲空间的严格超集中产生表示。