神经网络模型是机器学习中的热点研究方向之一,其模型包括网络架构和 神经元模型两部分。在过去半个多世纪的研究中,出现了各种基于不同网络架 构的学习模型与方法,但对基本的神经元模型研究相对较少。人工神经元模型 的建模通常参考生物神经细胞,当前最流行的模型仍是 1943 年提出的 MP 模 型[145] (第一代神经元模型)。七八十年来,学界对非 MP 的新型神经元模型仅有 一些探索,比如 60 年代提出的脉冲神经元模型 (第二代神经元模型)。脉冲神经 元模型在微观尺度上建模了生物神经系统的短程突触可塑性 (short-term synaptic plasticity),具有良好的神经学性质,但尚未在现实应用中展现出计算优势。 本文首先对第二代脉冲神经元模型进行研究,指出该模型的重大缺陷—— 分岔 (bifurcation) 问题。这可能是制约脉冲神经元模型发展的关键因素之一,对 该问题进行修正将显著提升脉冲神经元的计算潜力。然后,本文对第三代神经元 模型进行探索,通过建模生物神经系统中的长程突触可塑性 (long-term synaptic plasticity),首次实现了中观尺度 (mesoscopic scale) 的神经元建模。该探索将极 大地完善现有神经元模型体系。本文对第二代和第三代人工神经元模型展开了 系统研究,主要取得了如下五方面的创新结果:

- 脉冲神经元模型分岔问题的发现。通过对一大类脉冲神经元模型的数理性质 进行研究,从理论上揭示了脉冲神经元建模中的 ‘‘分岔” 问题,即脉冲神经 元内的超参数发生小的改变时,模型的功能拓扑会发生急剧变化,从而导致 解空间发生坍缩。分岔问题在脉冲神经元模型中普遍存在,会对脉冲神经元 的数理功能产生严重制约,这可能是脉冲神经网络在现实应用中难以达到优 秀性能的关键阻碍之一。实验验证了上述理论发现。

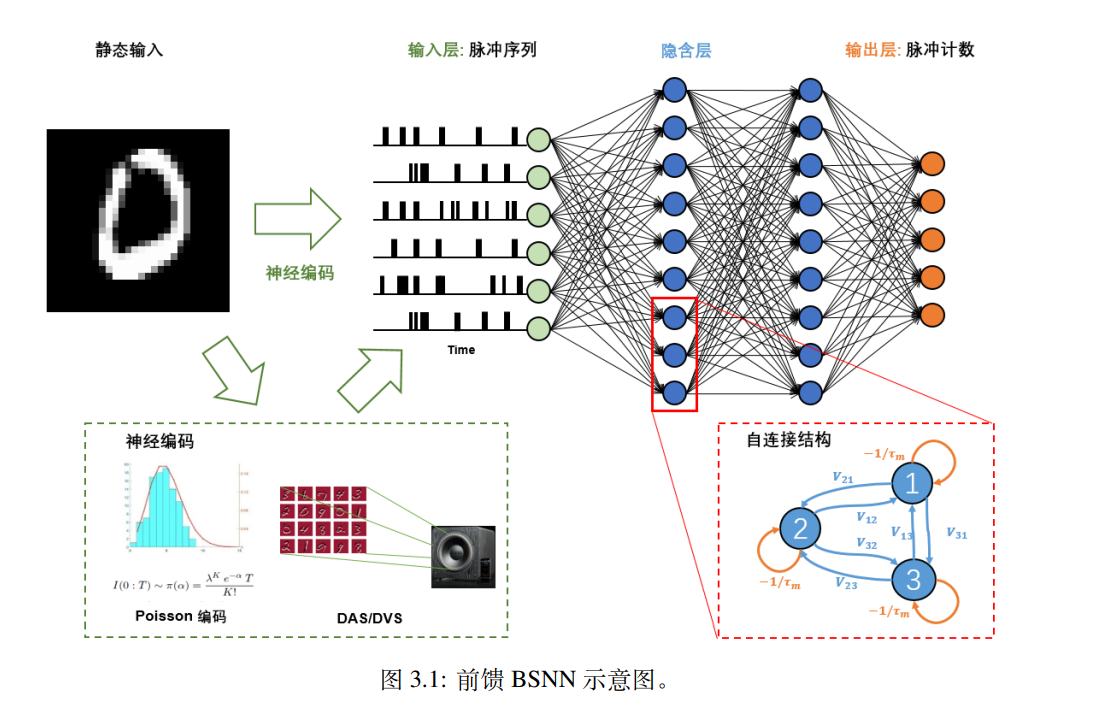

- 脉冲神经元模型分岔问题的修正。对分岔问题进行修正,提出了 BS (Bifurcation Spiking) 神经元模型。该模型通过一组学习参数解耦分岔超参数与系统 特征值之间的关系,以降低超参数值变化对神经元功能拓扑的影响,从而修 正了脉冲神经元模型中的分岔问题。理论表明 BS 神经元模型能够近似连续 时间动力系统,具有强大的表示能力和学习能力。实验验证了 BS 神经元模 型在一些监督学习任务上具有优越的表现。

- FT 神经元模型的初始设计实现。对第三代神经元模型的设计和实现进行探 索,提出了 FT (Flexible Transmitter) 新型神经元模型。不同于宏观建模的第 一代 MP 神经元模型和在微观尺度上建模短程突触可塑性的第二代脉冲神经 元模型,FT 模型在中观尺度上建模了受神经递质调节的长程突触可塑性,第 一代 MP 神经元模型可看作 FT 模型的特例。FT 神经元可在复数域内通过新 的反向传播实现计算,兼容于任何网络构架。本文采用最简单的前馈架构实 现了 FT 神经网络模型,并通过实验验证了其有效性。

- FT 神经元模型的数理性质研究。数理性质的研究主要关心神经元模型数学 表达式的函数功能,以及实现算法的性能等问题。本文工作从近似理论和优 化理论两方面分析 FT 神经元模型的数理性质,理论展示了 FT 模型相较于 第一代 MP 神经元模型的优势: (1) 逼近径向函数时,FT 神经元模型所需要 的参数数量更少,比 MP 神经元模型少一个量级; (2) 由 FT 神经元搭建的网 络模型更容易收敛到最优解。上述结论不仅从理论上保障了 FT 神经元模型 的合理性,而且展示了开发具有复数运算的神经网络模块的可行性。

- FT 神经元模型的计算性质研究。计算性质的研究主要关心神经元模型的可 计算性、可学习性以及时间建模能力等问题。本文工作从预测可学习性理论 和记忆性理论两方面分析 FT 模型的计算性质,理论展示了 FT 模型在时空 数据上的泛化能力和记忆能力: (1) 提出了关于神经网络模型的预测可学习性 理论,并给出了数据依赖情形下的泛化误差界; (2) 提出了基于分数阶估计的 长记忆性判别准则,以评估 FT 神经元模型处理非平稳和变周期时序数据的 能力。上述结果从理论上验证了 FT 神经元模型在时空建模方面的能力。

关键词:机器学习;神经网络;突触可塑性;MP 神经元模型;脉冲神经元模型; FT 神经元模型;机器学习理论;时间序列分析

成为VIP会员查看完整内容