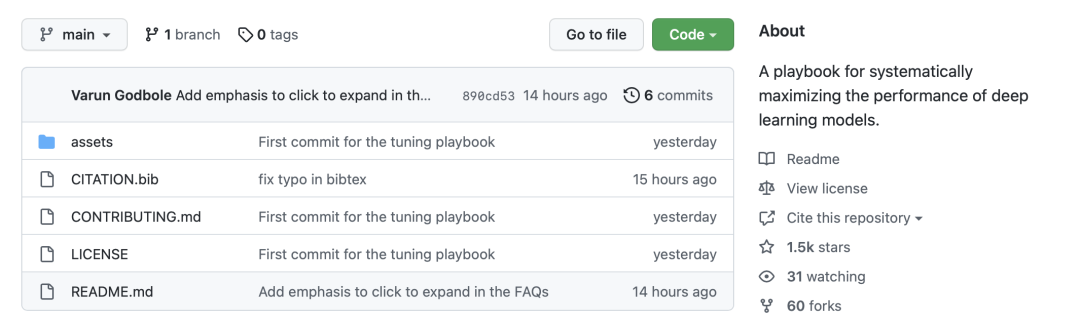

由五名研究人员和工程师组成的团队发布了《Deep Learning Tuning Playbook》,来自他们自己训练神经网络的实验结果以及工程师的一些实践建议,目前在Github上已有1.5k星。

手册地址:https://github.com/google-research/tuning_playbook 作者: Varun Godbole,George E.Dahl,Justin Gilmer,Christopher J.Shallue,Zachary Nado 该项目也得到了图灵奖获得者,谷歌 AI 科学家 Geoffrey Hinton 等人的推荐,Geoffrey Hinton 表示「大量的实践经验已被提炼成这份强大的深度学习模型调参指南。」

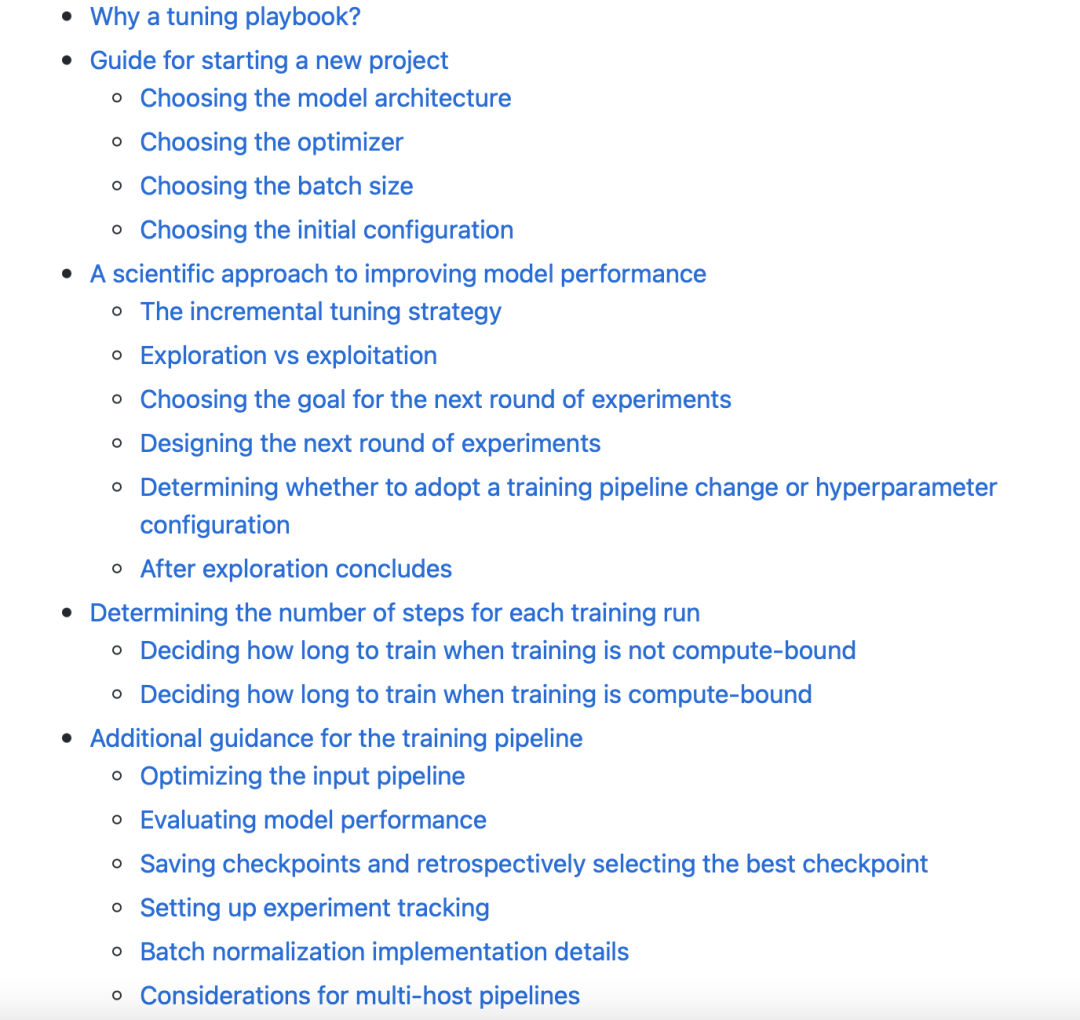

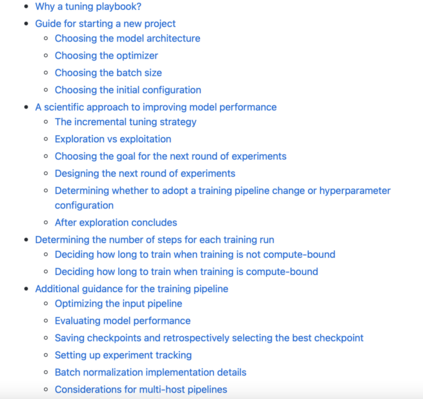

本手册适用范围为:对系统地最大化深度学习模型性能感兴趣的工程师和研究人员,包括个人和团队(需要掌握机器学习基本知识和深度学习概念),其中内容主要聚焦超参数调整,因为这是作者们在工作中耗时最多、收获也最多的环节。 内容可以分为四大部分: * 指导开始新项目 * 改善模型性能的科学方法 * 如何决定每次训练运行步数 * 训练过程中的其他经验

作者之一、谷歌大脑团队的研究科学家George E.Dahl 表示:现在要想让深度神经网络在实践中运行良好,需要付出惊人的努力和猜测,但人们用来获得深度学习良好结果的实际配方很少被记录下来。论文虽然呈现了一个完美的结果,但是掩盖了原来的过程,而从事商业问题的机器学习工程师很少有时间退一步,去回溯原来的过程。 教科书优先考虑基本原理,比较少的针对于实践指导,但我们却有大量问题是在应用中需要被解决的。虽然我们在社交媒体或者文章中发现一些「技巧」但是新手从业者和专家级别在获得结果的过程中,仍在存在较大的差距,这是做Deep Learning Tuning Playbook的初衷。

目前记录深度学习过程的内容非常有限,我们希望通过发布这个手册来改变这一现状。我们会尽量说明详细的工作流程,并不断的迭代更新。 作者:

Varun Godbole,目前是谷歌AI的一名软件工程师,主要经验集中在建模和构建处理大型数据集的基础设施方面。 George E. Dahl,是谷歌大脑团队的研究科学家,他的研究集中在高度灵活的模型上,并且他还对语言、感知数据以及化学、生物和医学数据的应用感兴趣。 Justin Gilmer,谷歌大脑的研究科学家,他在Google Scholar上引用已经破万,主要研究方向为深度学习、组合型、随机图论。 Christopher Shallue,目前正在攻读哈佛大学的天体物理学博士学位,在此之前,他曾在谷歌工作了5年10个月。 Zachary Nado,谷歌大脑的研究工程师,本科就读期间,曾先后在谷歌和SpaceX实习,研究领域包括数据挖掘与建模、机器智能、NLP等。