摘要

知识图谱代表了关于人、地方和事物的数百万事实和可靠信息。这些知识图谱已经证明了它们的可靠性,并被用于提供更好的搜索结果;回答有关实体的模糊问题;以及训练语义分析器以增强语义网的语义关系。然而,虽然互联网上存在大量与粮食、能源和水(FEW)相关的数据集,但缺乏能够使用这些资源的可靠方法和工具。这阻碍了利用知识图谱的新型决策应用的发展。在这篇论文中,我们介绍了一个新的工具,叫做FoodKG,它利用先进的机器学习技术丰富了FEW知识图谱。我们的首要目标是改善决策、知识发现,并为FEW领域的数据科学家提供更好的搜索结果。给定一个输入的知识图谱(在原始FEW数据集上构建),FoodKG根据原始数据集的术语和类别,用语义相关的三元组、关系和图像来丰富它。FoodKG采用了一种现有的图嵌入技术,该技术是在联合国粮食及农业组织发布的受控词汇AGROVOC上训练出来的。AGROVOC包括农业和食品领域的术语和类别。因此,FoodKG可以用语义相似度分数和不同类别之间的关系来增强知识图谱,对现有实体进行分类,并允许FEW专家和研究人员使用科学术语来描述FEW概念。在AGROVOC上训练后得到的模型与在同一数据集上训练的最先进的词嵌入和知识图谱嵌入模型进行了评估。我们观察到,根据Spearman Correlation Coefficient得分,该模型的表现优于其竞争对手。

我们引入了联邦学习(FL)技术来进一步扩展我们的工作,通过在每个数据集网站上训练较小版本的模型而不访问数据,然后在服务器端汇总所有的模型,将私有数据集包括在内。我们提出了一种我们称之为RefinedFed的算法,通过在聚合阶段之前过滤每个数据集站点的模型来进一步扩展当前的FL工作。我们的算法将目前在MNIST日期集上的FL模型准确率从84%提高到91%。

第1章 介绍

在本章中,我们简要介绍了研究领域、我们在该领域解决的研究问题、工作目标、工具、已经使用的网络服务以及我的工作贡献。

1.1 概述

20年前,任何人都很难相信他们会拥有一部手机,更不用说一台笔记本电脑了,现在大多数汽车的计算微处理器比用来作为交通工具送人登月的太空车的微处理器还要强大[9]。技术的巨大飞跃革新了新的生活方式和我们在许多不同方面的沟通方式。它甚至改变了我们思维方式的优先次序,将农业革命转变为工业革命,并导致了巨大的信息革命。如今,任何事情都可以通过技术完成,包括在线会议、在线学位、在线工作、社会沟通等等。此外,娱乐和与朋友和家人的沟通也可以通过社交网站在网上完成。这场重大的信息革命每天都会产生大量的数据,称为大数据(BD)[13]。大数据的概念是指结构化和非结构化数据的复杂和大量,传统的数据处理应用软件不足以处理每天产生的大量数据[57]。

大数据科学(BDS)是研究管理、存储、分析和检索海量数据的科学。BDS面临的挑战之一是,互联网上的数据并不遵循特定的格式。不同的社交媒体网站使用不同的方式来存储和处理在线数据[43]。例如,YouTube网站表示,每分钟有价值400小时的视频被上传,10亿小时是YouTube上每天被观看的内容[91]。YouTube以结构化格式存储这些小时的视频,而拥有比中国人口更多用户的Facebook则以图表形式存储数据[15]。这些不同的格式给想要分析和处理这些数据的用户带来了新的挑战。BDS的重要部分是使用户能够分析和处理不同格式的大数据。结构化数据,也被称为关系型数据库(RDB),包括表格、电子表格和使用结构化查询语言(SQL)进行处理的数据库。虽然SQL是一种常见的、强大的语言,但对于连接结构化和非结构化的数据,如文本、视频、图像、电子邮件和音频文件,仍然存在许多挑战。

幸运的是,有一种通用的数据模型,被认为是解决上述所有挑战的方法。资源描述框架(RDF)是一个万维网联盟(W3C)的数据模型。RDF将数据分为三部分:主语、谓语和宾语,它们被称为RDF三要素,<主语><谓语>"宾语",图1。可以添加一个新的值来描述三联体的上下文,这被称为

图1:RDF模型

RDF三元组代表了人类和计算机的实体和概念之间的语义信息和事实[90]。RDF数据模型中的主体提供了一个通用资源标识符(URI)来呈现独特的信息和事实。这使得人类和计算机可以追溯一个词的起源、相关术语以及在什么情况下被提及[71]。清单1说明了参与URI后的四维模型。

清单1:RDF四元组例子

此外,RDF模型的一个最重要的用途是连接和合并不同格式的数据。如果不使用RDF模型,合并两个不同的数据库会很复杂。复杂程度随着数据库数量的增加而增加。当使用RDF模型时,这个过程首先是将表转换为RDF模型,然后连接这些三要素。连接RDF数据模型的好处是可以用于不同格式的不同数量的数据。将数据库转换为RDF模型是许多用户面临的挑战之一,因为没有特定的工具可以在没有人的帮助下自动使用。将数据库转换为RDF模型需要一个特殊的结构,将数据库中的数据映射为RDF模型。不同的数据库需要不同的结构;这些结构被称为本体。对于每个数据库,用户都需要提供一个本体。

互联网上存在少数本体,但它们并没有涵盖不同用户的目的。因此,我们在DBpedia本体的基础上开发了一个新的本体,可以用来为使用FEW知识库的用户服务,这个本体叫做FEW本体。FEW本体包含数十种关系,在转换为RDF模型时,可以用来指定两个实体之间的关系。例如,表1包含书籍的标题、作者、出版商等。

表1:图书数据库的例子

| 书名 | 标题 | 作者 | 出版标识 | 页数 |

|---|---|---|---|---|

| 0596002637 | 部分RDF | Shelley Powers | 7642 | 350 |

| 0596000480 | 脚本 | 大卫-弗拉纳根 | 3556 | 936 |

将第二本书与 "JavaScript "联系起来的关系是 "标题"。很少有本体定义这样简单的关系,但是对于另一列来说,关系可能是 "页数"。在这种情况下,用户必须搜索定义 "页数 "关系的本体或创建自己的本体。在将前面的表格转换为RDF模型后,数据将如图2所示呈现。

图2:第二本书的RDF模型[8]

RDF数据模型的另一个优点是,用户可以简单地理解使用这些RDF三元组呈现的所有信息。用户可以添加额外的信息,如作者个人网站的链接,他有多少个孩子,以及他还写过哪些书。

我们工作的第二部分是通过添加基于给定数据集中实体之间语义相似性的额外信息来增强映射的RDF数据集。我们的程序开始时,一次对两个实体进行语义上的比较。基于这些实体之间的关系,额外的三元组将被添加到数据集中,其中包含被比较的实体的语义相似度分数和它们之间的关系。在一个数据集中,多个实体可能具有除现有实体以外的关系[109]。例如,一个数据集可能包含诸如 "David Flanagan "和 "Java in a Nutshell "这样的名称,这会让用户感到困惑。在这种情况下,根据第一个和第二个名字之间的语义相似性添加额外的信息,如 "作者 "或 "拥有者",将丰富数据集,为用户了解名字和实体之间的确切关系提供宝贵的信息。此外,用额外的信息来充实数据集将最大限度地减少搜索时间。例如,在 "David Flanagan "和 "Java in a Nutshell "之间添加 "作者 "关系,将为想要搜索这些名字之间关系的用户节省时间和精力。为此,我们利用ConceptNet网络服务为我们提供了一个给定词的所有语义相关的概念,以便用它们来进行计算。在开始解释我们的工作之前,我们想提一下选择FEW领域的几个原因。

-

现在的技术大多与计算机相关的项目有关,如社交媒体、银行、广告、教育等。食品、水和能源系统并不像其他专业那样拥有相同的技术兴趣。因此,我们的项目旨在建立一个系统来改进粮食、水和能源的知识图谱,以增强这些系统的功能,使用户能够以更好的方式分析数据库和图谱[83]。

-

在将数据库转换为RDF模型时,由于缺乏现有的本体,我们不得不在DBpedia本体的基础上创建一个新的本体,以便与FEW系统一起使用。

-

分析数据并不是一个新的概念,但是通过添加与现有数据相关的额外的RDF四元组来丰富数据集,基于这些四元组之间的语义相似性是一个真正的挑战,这将丰富一个数据集,为用户提供更多关于该特定数据集中存在的概念的有用信息和事实。

食物、能源和水是维持地球上人类生活的关键资源。目前,互联网上有大量与食物和能源资源相关的数据集。但是,仍然缺乏能够消费这些资源并提供决策能力的可靠工具[82]。此外,互联网上的水电数据以不同的格式存在,文件扩展名为CSV、XML和JSON,这使得用户在加入、查询和执行其他任务方面面临挑战[51]。一般来说,这样的数据类型在关联开放数据(LOD)的世界中是不可消费的,也不准备被不同的深度学习网络处理[64]。最近,在2018年9月,谷歌宣布了其 "谷歌数据集搜索",这是一个包括图形和关联数据的搜索引擎。谷歌数据集搜索是语义网领域的一次巨大飞跃,但挑战在于缺乏已发布的知识图谱,尤其是在FEW系统领域[35]。

包括Freebase[18]、DBpedia、[14]和YAGO[98]在内的知识图谱由于其语义属性而被普遍用于语义网技术、关联开放数据和云计算[29]。近年来,许多免费的和商业的知识图谱都是从维基百科这样的半结构化资源库中构建的,或者是从网络上收获的。在这两种情况下,其结果都是大型的全局知识图,在完整性和正确性之间有一个权衡[42]。最近,人们提出了不同的细化方法,以利用这些图中的知识,通过增加缺失的知识、识别错误部分和提取对用户有用的信息,使它们在特定领域更有用[74]。此外,大多数知识图谱中使用的知识提取方法是基于二元事实的[31]。这些二元事实代表了两个实体之间的关系,当有多个实体时,特别是在像FEW这样的特定领域,这限制了它们的深度推理能力[102]。

缺乏可靠的知识图谱服务于FEW资源,这在很大程度上促使我们建立了我们的工具--FoodKG,它使用特定领域的图嵌入来帮助决策,改善知识发现,简化访问,并提供更好的搜索结果[36]。FoodKG通过添加额外的知识和图像来丰富FEW数据集,这些知识和图像是基于同一背景下实体之间的语义相似性[101]。为了实现这些任务,FoodKG采用了最近的基于自聚类的图嵌入技术,称为GEMSEC[84],该技术在AGROVOC[21]数据集上重新训练。AGROVOC是一个词汇集合,涵盖了联合国粮食和农业组织关注的所有领域,包括粮食、营养、农业、渔业、林业和环境。重新训练的模型AGROVEC是一个特定领域的图嵌入模型,使FoodKG能够用不同术语和概念之间的语义相似度分数来增强知识图。此外,FoodKG还允许用户通过一个友好的用户界面使用SPARQL查询知识图。

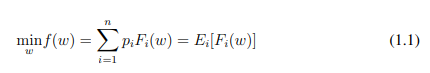

目前现有的知识图谱和数据大多是私有的。因此,我们通过添加联邦学习(FL)技术来扩展我们的工作,以便能够从私有和安全的数据中获益。联邦学习是由McMahan[61]提出的一种分布式机器学习方法,其目标是使用大量的分布式数据集来训练一个集中的/全球的模型,而不访问数据并保持数据的本地化。这个想法是在每个数据集所在地训练一个较小版本的模型,然后在服务器上聚集所有的模型,目标是最小化目标函数,如下图所示:

其中n是客户的数量,

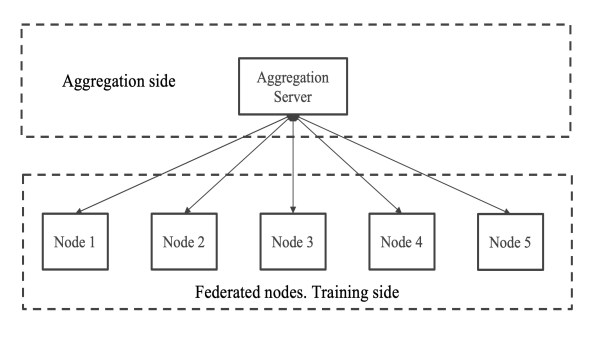

联邦学习(FL)是在保护隐私的机器背景下广泛采用的技术之一,目的是在无法访问的数据上训练模型,如医院的病人记录。特别是,FL技术不是将数据上传到一个集中的服务器上进行模型训练,而是将模型发送给数据持有者,作为回报,数据持有者将训练一个模型,而不需要分享数据或允许访问数据。此外,FL经常被用来训练来自边缘和可穿戴设备的模型,这些设备不断收集用户的数据,如电话和医疗设备。例如,FL最有名的用途之一是在智能手机的键盘领域。谷歌在Gboard移动键盘[40, 46, 80, 106](简化的FL架构见图3)、安卓信息[24]中广泛使用FL,而苹果在iOS 13[99]中使用跨设备FL。预测智能手机键盘中下一个单词的模型是用FL技术训练的。与其将用户的所有私人文本上传到一个集中的服务器并训练一个模型,不如在用户手机上训练一个简单的模型,产生一个准确率不高的模型。然而,当收集数以千计的用户模型并在服务器上平均其权重时,将产生一个更好和更普遍的模型。然后,产生的模型将在下一轮中被发送给所有的用户。在FL的一个回合中,服务器将全球模型发送给所有的客户,每个客户将在自己的私人数据上进一步训练这个模型,然后将更新的数据再次发送给服务器进行汇总。这个过程将继续重复,更多的通用模型将被产生。

图3:FL的简化结构,服务器最初向客户发送一个全局模型。客户端进行本地训练并与服务器共享更新的权重。服务器汇总这些权重并更新全局模型,然后再继续执行这些步骤。

对所有客户模型进行平均化是目前用于生成具有更好准确性的全局通用模型的标准方法。这种技术类似于随机森林,其想法是对所有过度拟合的树状模型进行平均,以产生一个更好的整体模型。然而,当参与实体(即参与训练小模型的场所的数据持有者)不持有 "好的 "数据或他们的数据可能包括很多噪音时,这种方法面临着真正的挑战。例如,在使用FL来改善智能手机的下一个单词预测的情况下,许多人使用英语来输入其他语言的单词(例如,我可能用英语输入 "salam",而它是阿拉伯语的问候语)。更不用说那些语法错误和捷径了,比如输入 "u "而不是 "you"。不同的口音和不同的俚语也可能降低模型的准确性,如输入 "goin "而不是 "going "等。从这些用户那里收集到的模型将对一般模型有害。

另一方面,我们有在图像上训练的计算机视觉模型。然而,有些客户可能有大量高分辨率的图像。其他客户可能只有少量的图像、损坏的图像、低分辨率的图像、黑白图像和有大量噪音的图像,这些都会对整个模型产生不良影响。此外,从更大的人群中收集模型需要更多的计算能力、带宽和引入的延迟。因此,我们提出的算法将在每一轮之后对每个客户的模型进行简单的准确性测试,并根据输出结果将模型纳入服务器的进一步操作或不纳入。

在这篇论文中,我们提出了一个名为FoodKG的工具,它完善和丰富了FEW资源,以利用FEW图中的知识,从而使其对研究人员、专家和领域用户更加有用。我们工作的主要贡献如下:

-

FoodKG是一个新颖的软件工具,旨在使用多种功能来丰富和增强FEW图。为所提供的三元组添加上下文是首批功能之一,可以更容易地查询图,为深度学习模型提供更好的输入。

-

FoodKG提供了不同的自然语言处理(NLP)技术,如POS标签、chunking和Stanford Parser,用于提取有意义的主题,统一重复的概念,并将相关实体连接在一起[22, 50, 59]。

-

FoodKG采用了专业化张量模型(STM)[37]来预测图中新增加的关系。

-

我们采用WordNet[67]来返回所提供主题的所有偏移量,以解析ImageNet[85]中的相关图像。这些图像将以通用资源定位器(URL)的形式被添加到图中,作为相关的和纯粹的图像。

-

FoodKG利用GEMSEC[84]模型,该模型在AGROVOC上经过转移学习和微调后产生AGROVEC,以提供相似和链接概念之间的语义相似度分数。AGROVEC与在同一数据集上训练的词嵌入和知识图谱嵌入模型进行了比较。由于在特定领域的图数据上进行了训练,AGROVEC在Spearman Correlation Coefficient得分方面取得了优于其竞争对手的表现。

-

我们引入了联邦学习(FL)技术来进一步扩展我们的工作,通过在每个数据集站点训练较小版本的模型而不访问数据,然后在服务器端汇总所有的模型,将私人数据集纳入其中。我们提出了一种我们称之为RefinedFed的算法,通过在聚合阶段之前对每个数据集站点的模型进行过滤来进一步扩展当前的FL工作。我们的算法在MNIST日期集上将目前的FL模型准确性从84%提高到91%。

我们的结果表明,AGROVEC在不同的场景下提供了比其他嵌入更准确和可靠的结果:类别分类、语义相似性和科学概念。

我们的目标是使FoodKG成为FEW领域的数据科学家和研究人员利用知识图谱的概念和机器学习技术开发下一代应用的最佳工具之一。本论文的其余部分组织如下。第2节讨论了最近的相关工作;第3节介绍了FoodKG的设计细节;第4节讨论了FoodKG的实现和性能评估;最后,我们在第5节得出结论。