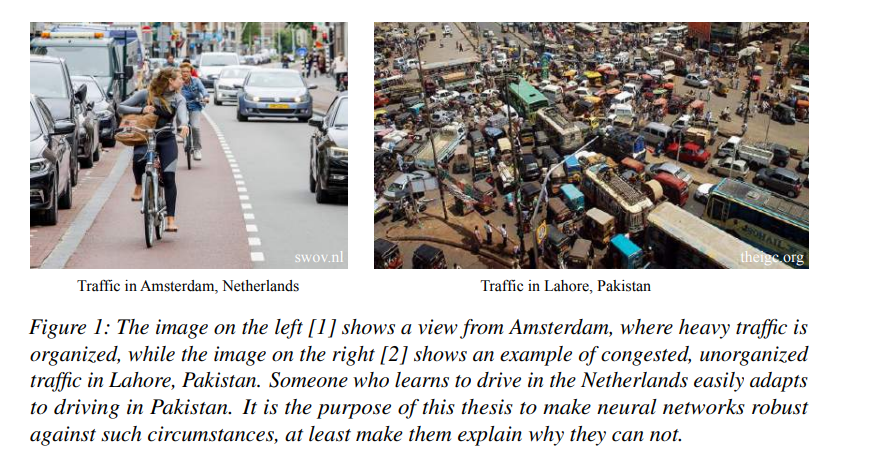

**本文探索了用于视觉分类的神经网络的可解释的鲁棒性。本文研究了使神经网络可在现实世界应用中部署的一个基本问题:“如何使神经网络具有可解释的鲁棒性?”我们首先让神经网络变得可解释。**它从使黑盒神经网络通过利用属性(即物体的视觉区分属性)和扰动来证明其推理,以提供反事实解释开始。接下来的两章侧重于增强神经网络对自然和对抗性扰动的鲁棒性。通过在网络架构中整合扰动来做到这一点,并为修改网络提供了背后的理论依据,通过用类似变换的图像训练标准网络来增强其鲁棒性。最后一章利用属性来提高对扰动的鲁棒性,并作为副产品提供解释。在巴基斯坦,这是右手驾驶,而在荷兰,这是左手驾驶。更重要的是,交通状况和天气状况有很大的不同。在巴基斯坦,司机遇到拥挤的交通,包括行人、汽车、公共汽车、摩托车、人力车、马车和卡车。另一方面,尽管司机必须小心自行车和汽车在同一条路上行驶,但荷兰的交通是有组织的,规则是严格遵守的,如图1所示。此外,巴基斯坦中部是中等到温暖的天气,而在荷兰,人们需要在冬天的雨、风和雪中开车。尽管这些视觉环境不同,在荷兰学习驾驶的人可以很快适应在巴基斯坦驾驶。当涉及到对未见过的视觉环境的泛化能力时,人类具有非凡的能力。他们很容易将他们从以前的经验中学到的东西应用到新的情况中。尽管神经网络在理想情况下显示出人类水平的感知能力[3,14,35,81,89,140],但在它们在学习阶段没有遇到的情况下,它们没有显示出这种能力。目前,它们需要大量的数据来学习所有这些不同的场景,否则就会失败。在2018年的一个这样的例子中,一辆自动驾驶汽车在训练网络时将人误认为物体[10],从而导致了事故,而从未考虑过横穿马路。因此,在将神经网络部署到实际应用中之前,增强其鲁棒性是很重要的。

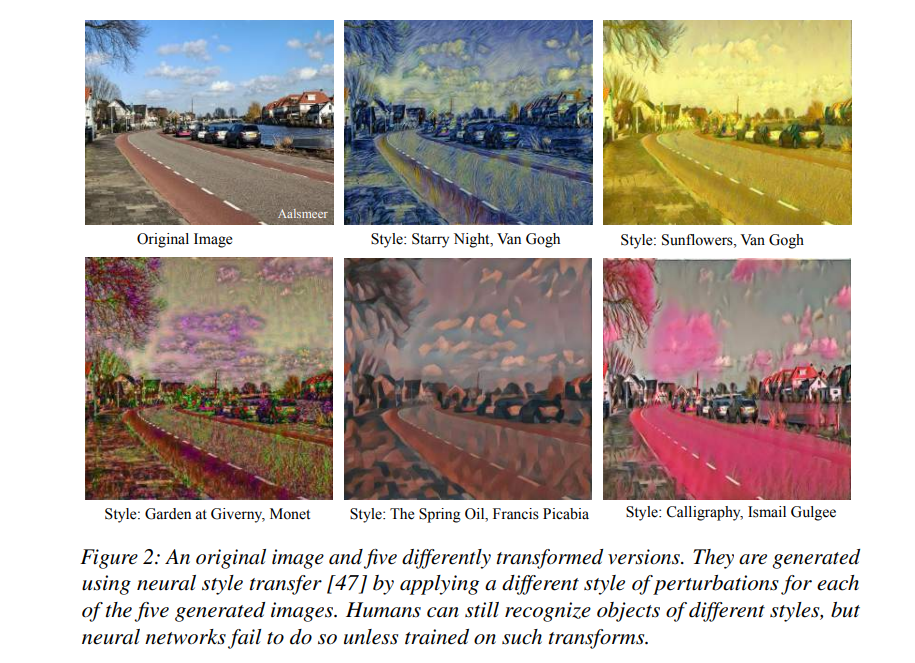

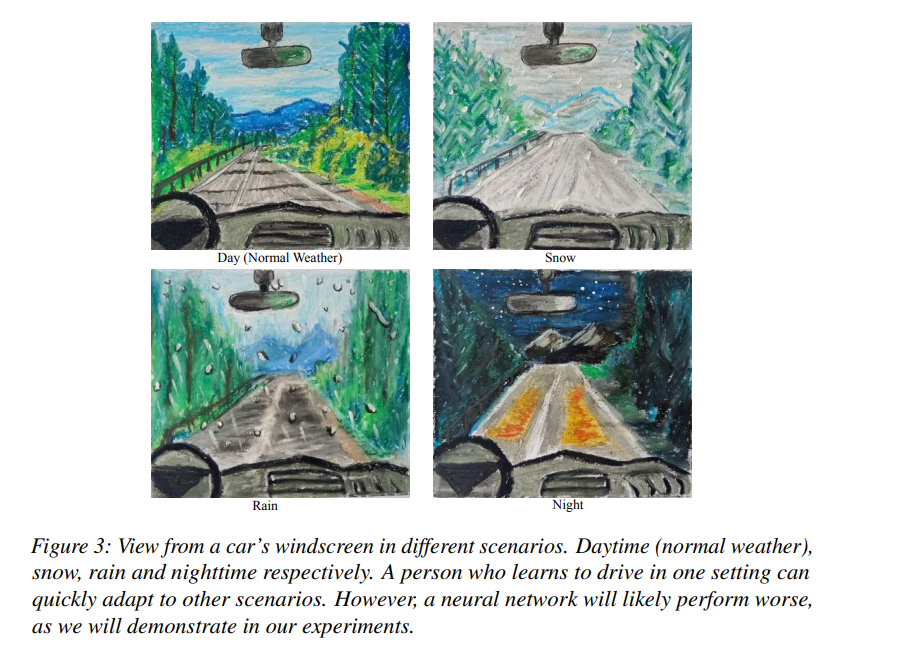

图2中的另一个例子显示了Alsmeerderdijk:原始图像及其在不同绘画风格下的人工变换版本。在原始图像和变换后的图像中,人们可以很容易地识别出道路、运河、停放的汽车、船只、树木、云和房屋。在存在干扰的情况下,人类很容易识别物体。然而,对于神经网络来说,要识别扰动图像中的物体是具有挑战性的,除非网络经过专门的此类变换训练。类似地,专门在晴天收集的数据上训练的自动驾驶汽车网络将在雪天或晚上失败,参见图3。因此,为了使网络智能化,最重要的是对未见过的扰动进行鲁棒性控制。本文不只关注可见的扰动、特定的鲁棒性,而是旨在增强总体的鲁棒性,以及对网络训练过程中未见过的扰动的鲁棒性。

人工智能中的鲁棒性被定义为系统在不同于其设计的精确模型的情况下保持其性能的能力[95]。在本文中,我们不考虑任务的全局鲁棒性,在此任务中,整个系统的性能,例如一辆具有来自不同传感器输入的汽车,会应对扰动。重点是局部视觉鲁棒性,即视觉感知的鲁棒性。本文将扰动分为两类:自然扰动(模糊、雪等),见图3和文献[63],人工设计的对抗性扰动,见图4和文献[50,122]。用于改变输入以欺骗深度神经网络的微小的、难以察觉的、精心设计的扰动被称为对抗性样例,见图4。这些对抗性样本将分类器推到错误的类[122]。定向扰动方法包括迭代快速梯度符号法[82]、基于雅可比矩阵的显著图攻击[98]、单像素攻击[121]、Carlini和Wagner攻击[19]和universal攻击[97]。图4显示了一个对抗性扰动的例子,作者表明,对于一个干净的图像,网络可以正确地检测交通标志。相比之下,对于反向扰动的图像,它无法检测它们,当将其纳入自动驾驶时,可能会导致严重的事故。使神经网络对自然和对抗性扰动具有鲁棒性。