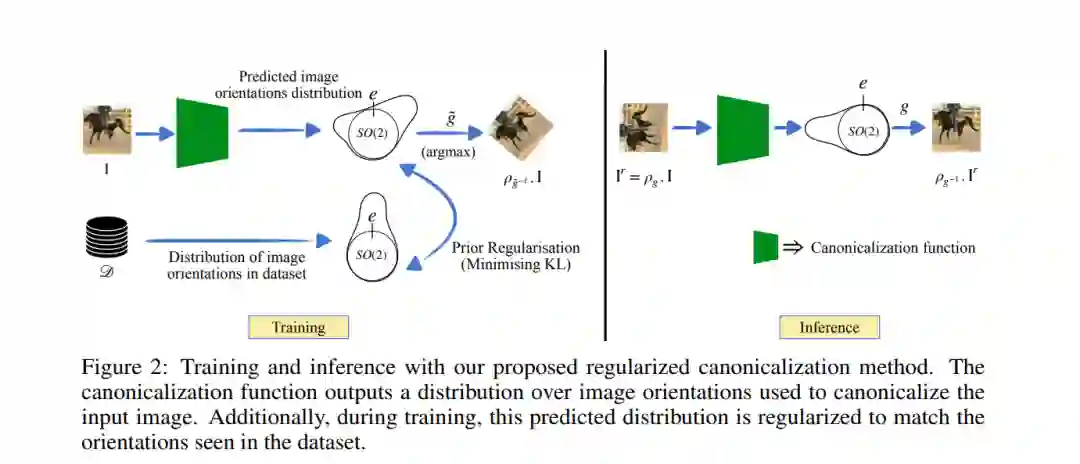

等变网络专为确保对一组输入变换的一致行为而设计,从而提高样本效率并得到更准确和更稳健的预测。但是,为了达到选择的等变性重新设计现有深度神经网络架构的每个组件是一个困难的问题,这可能导致在训练和推断期间的计算昂贵的网络。最近提出的关于等变性的另一种方法,它去除了架构的限制,是使用一个简单的规范化网络,该网络在将其输入到一个无约束的预测网络之前将输入转换为规范形式。我们在这里展示了这种方法可以有效地用于使大型预训练网络等变。然而,我们观察到产生的规范方向可能与训练分布的方向不一致,从而妨碍了性能。使用与数据集相关的先验信息来告知规范化函数,我们能够使大型预训练模型保持等变性同时保持其性能。这大大提高了这些模型对数据的确定性变换(例如旋转)的稳健性。我们相信,这种大型预训练模型的等变性适应可以帮助其具有已知对称性先验的领域特定应用。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

224+阅读 · 2023年4月7日