多模态推荐系统(Multimodal Recommender Systems,MRS)融合了来自用户和物品的异构数据,如文本、图像和结构化信息,以提升推荐性能。大语言模型(Large Language Models,LLMs)的兴起为MRS带来了新的机遇,使其具备语义推理、上下文学习(in-context learning)以及动态输入处理的能力。与早期的预训练语言模型(Pre-trained Language Models,PLMs)相比,LLMs 在灵活性与泛化能力方面具有显著优势,但同时也带来了可扩展性和模型可访问性等方面的挑战。

本综述全面回顾了LLMs与MRS交叉领域的最新研究进展,重点探讨了提示策略、微调方法以及数据适配技术。我们提出了一种新的分类体系,用以刻画融合模式,并识别可从相关推荐领域迁移的通用技术。此外,综述还涵盖了评估指标与数据集的概况,并指出了未来的研究方向。我们的目标是阐明LLMs在多模态推荐中的新兴作用,助力该快速发展领域的后续研究。

1 引言

多模态推荐系统(Multimodal Recommender Systems,MRS)旨在整合用户和物品的多样化信息,包括文本、图像、结构化数据和用户行为等,以构建连贯的推荐流程。传统方法,如协同过滤和神经编码器,常面临数据稀疏、冷启动问题以及模态不对齐等挑战。大语言模型(Large Language Models,LLMs)通过其预训练知识、语义灵活性和推理阶段的适应能力,为解决上述问题提供了新范式。 与早期的预训练语言模型(Pre-trained Language Models,PLMs),如BERT或RoBERTa相比,LLMs(例如GPT-3、PaLM、LLAMA)不仅具备更丰富的世界知识,还支持高级推理能力与基于提示(prompt-based)的控制机制。这使得LLMs能在无需重新训练的前提下处理多样化且不断变化的推荐输入,尤其适用于冷启动与跨领域场景。

本综述旨在探讨LLMs如何重塑多模态推荐系统的设计。我们聚焦于通过提示、训练与数据适配等方式的融合(详见第2节),这些技术也与跨模态学习中的关键组件相互作用,如解耦(disentanglement)、对齐(alignment)与融合(fusion)(第3节)。此外,我们还综合近期研究进展,并指出未来的研究方向(第4节)。为进一步支持后续工作,我们附录中提供了多模态数据集列表(附录A.1)、评估指标结构化分类(附录A.2)以及缩略语对照表(附录A.3)。

**1.1 研究策略

本综述聚焦于LLMs特有能力——推理、提示和模态适配——如何重新定义MRS的设计(第1.3节)。为保持这一焦点,我们有意弱化对传统架构组件(如模态特定编码器)的讨论,这些已在先前综述中被广泛覆盖 [69, 151]。同样,我们也不涉及推荐系统架构的分类(如图神经网络、Transformers等),相关内容已在 [2, 24, 30, 54] 等文献中详尽讨论。 相反,我们强调了以往研究中较少探讨的模态,如表格数据和数值数据,并分析它们如何被集成进LLMs。此外,我们还引入了推荐系统其他分支中的方法(如序列推荐、知识感知推荐),当其LLM方法具有迁移潜力时,也被纳入本综述,以拓展MRS的设计空间并更全面地刻画LLM与MRS的交互方式。

**1.2 与其他MRS综述的区别

尽管已有大量关于MRS的综述,但大多采用基于编码器的分类方法,聚焦于模态特定编码器、融合机制或损失函数等架构组件 [69, 151]。相比之下,我们强调LLMs带来的范式变革,其影响超越了传统编码器管线。 **LLMs 超越编码器范式。**传统综述往往将编码器视为模态表示的核心机制,而LLM驱动的模型改变了这一范式。LLMs支持通过提示工程灵活处理输入,可直接作用于多模态摘要或结构化格式(如JSON、表格文本)。这种能力将模型从静态的编码-解码结构转变为具备上下文推理、意图理解与外部工具交互能力的动态代理。 **基于LLM功能的分类体系。**我们的分类方法不再沿用标准的架构划分,而是基于LLM驱动的融合策略展开,包括提示策略(第2.1节)、训练方法(第2.2节)以及数据类型适配(第2.3节),并结合其在MRS任务中的角色,如解耦与对齐(第3.1与3.2节)。这些维度能更准确地捕捉LLMs如何实现推理与跨模态对齐的新形式。 **纳入可迁移的相关技术。**考虑到LLMs在MRS中的应用尚属新兴,我们拓宽视角,引入了来自邻近推荐领域(如文本、行为推荐)中基于LLM的策略,这些策略虽未直接应用于MRS,但具有高度迁移性,从而拓展了设计空间并揭示可通用的创新模式。

**1.3 分类体系(Taxonomy)

本综述提出了一种面向LLM与MRS融合的新型分类体系,突破了以往基于编码器或损失函数的分类方式 [68, 69, 151]。LLMs的引入带来了以推理能力、提示控制与推理时动态适应为核心的全新设计空间。 该分类体系将相关研究归纳为三个主要类别: 1. LLM方法(第2.1–2.3节):以LLM特有技术为特征,细分为:

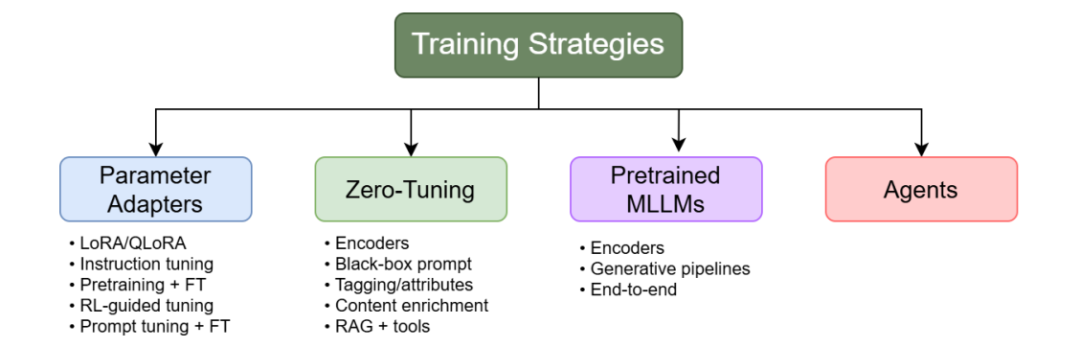

提示技术(第2.1节):包括硬提示(如ID标识符)、软提示、混合模板及推理提示; * 训练策略(第2.2节):涵盖微调(fine-tuning)、参数高效方法(如LoRA、QLoRA)及代理结构; * 数据类型适配(第2.3节):包括将图像、表格、行为数据等非文本模态适配为适用于LLM输入的结构化格式(如摘要或结构化提示); 1. MRS特定技术(第3.1–3.3节):从LLM视角重新审视MRS中的长期挑战:

解耦(第3.1节):通过潜变量建模、对比学习或变分推断实现模态特征的分离; * 对齐(第3.2节):同步不同模态输入,或将外部知识嵌入与LLM表示对齐; * 融合(第3.3节):多模态信息在早期、中间或后期阶段的融合策略; 1. 主要趋势与未来方向(第4节):总结该领域的研究趋势,探讨LLMs在推荐流程中作为“推理代理”的演进角色。

此外,在附录A.2中,我们还提供了标准与新兴评估指标的结构化概览,包括BLEURT等NLP指标以及基于LLM的评估方法;在附录A.1中,补充了覆盖更广领域与模态的多模态推荐数据集。

**1.4 本综述的贡献

现有MRS综述往往忽视LLMs带来的特定挑战与机遇。例如,Liu等人 [69] 仅在未来展望中简要提及多模态LLMs;而聚焦PLMs的推荐综述则多集中于BERT类架构,缺乏对LLMs上下文推理与工具增强能力的系统分析。 本综述填补了这一空白,系统梳理了LLMs在多模态推荐中的研究进展与前沿趋势,并引入邻近推荐子领域中具迁移性的策略。我们的主要贡献包括: 1. 面向LLMs在MRS中的新分类框架:提出一种全新分类法,将LLM在MRS中的融合方式划分为提示策略、参数高效微调方法、模态适配技术与对齐策略等独立设计轴,便于更细致地理解其机制; 1. 跨领域整合与边界拓展:涵盖来自文本、行为等推荐分支的相关方法,如摘要、上下文学习或推理提示,并探讨其在MRS中的迁移潜力; 1. 当前趋势梳理与研究空白识别:对当前研究热点与未充分探索方向进行整合(第4节),明确研究收敛点与亟待突破的环节; 1. 扩展的评估指标与数据资源:提供覆盖MRS特定目标(如多样性、新颖性、多目标权衡)与LLM相关实践的评估指标综述(附录A.2),并汇总了更全面的公开数据集资源(附录A.1)。