导读 本文将介绍复旦大学知识工场实验室关于领域大模型的研究工作。主要内容包括以下几大部分:

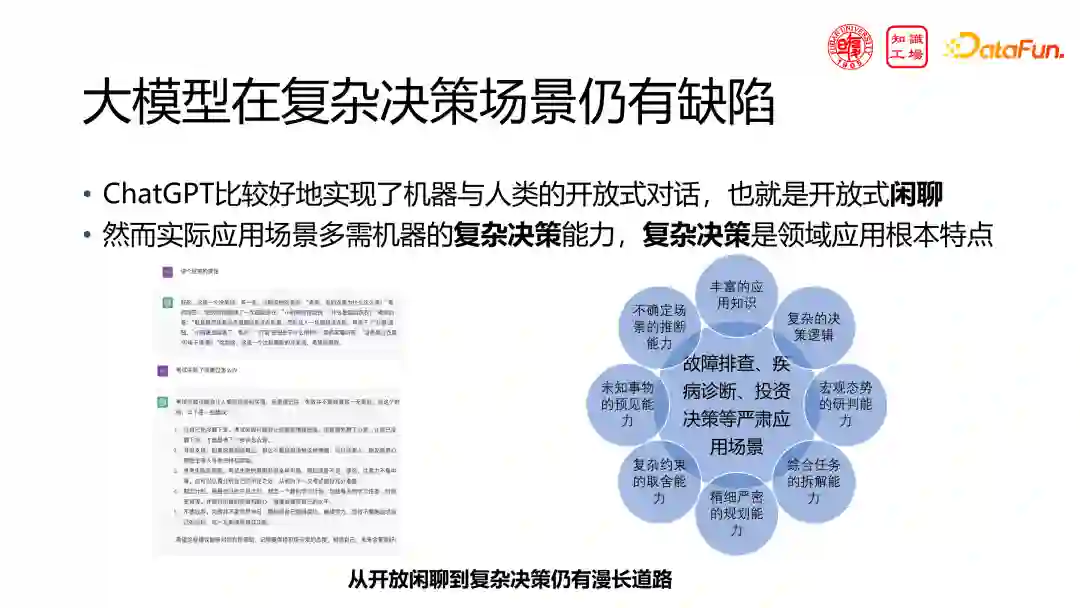

- 背景

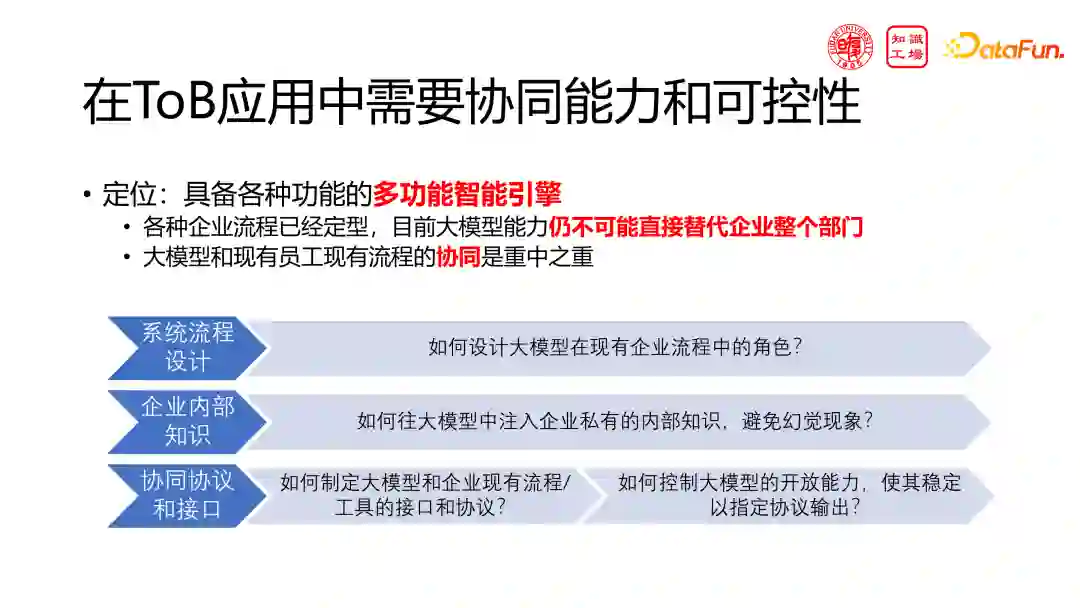

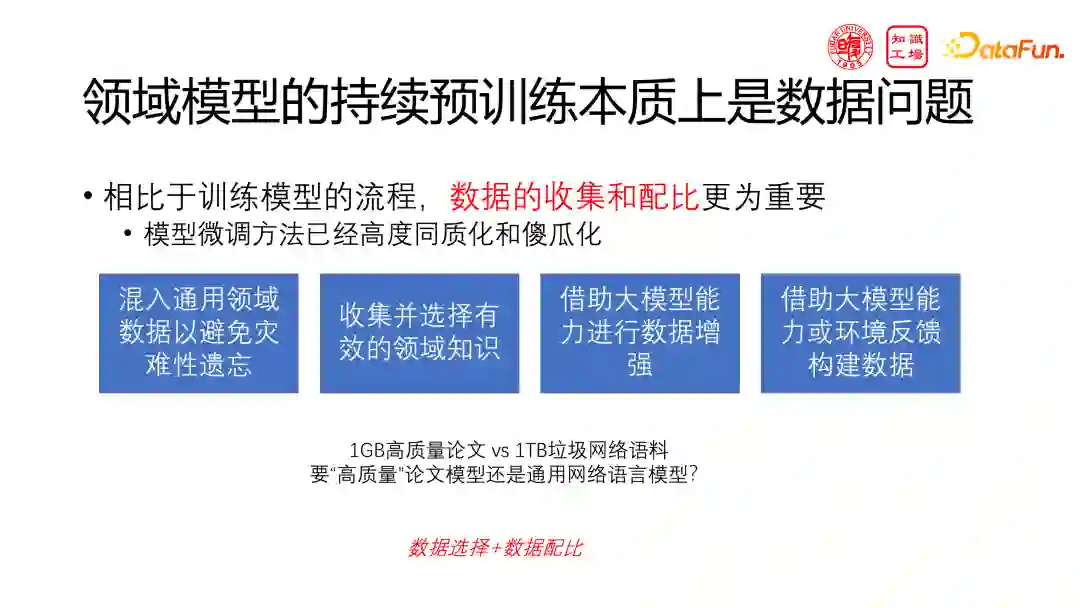

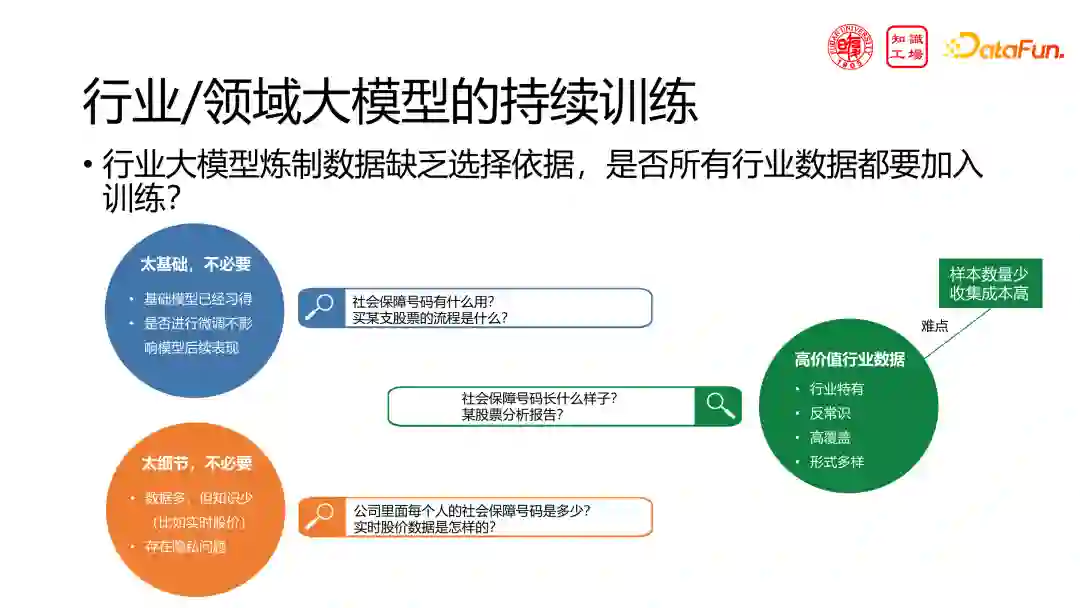

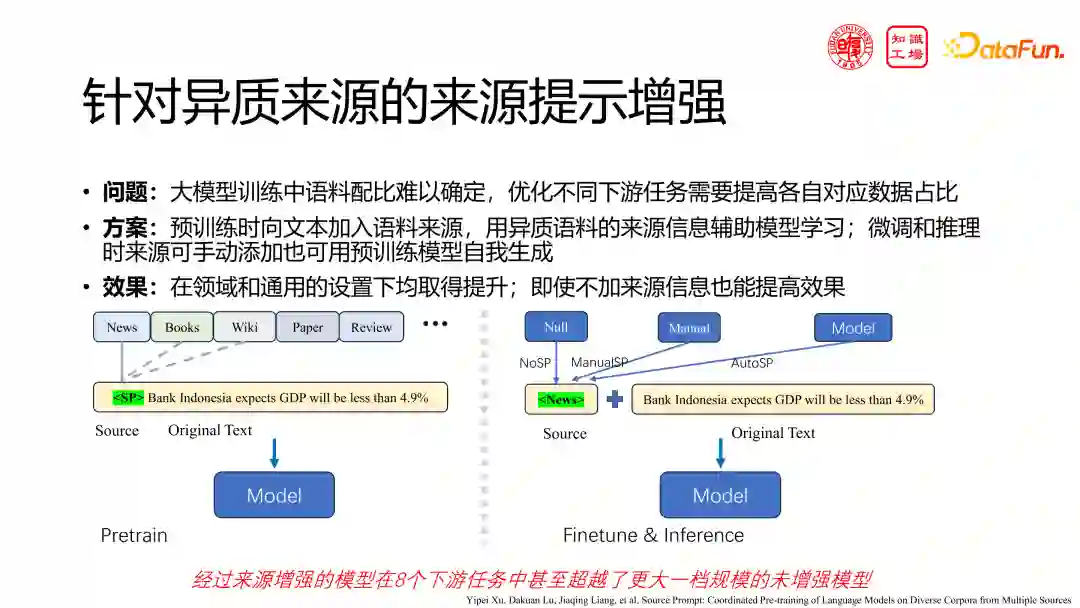

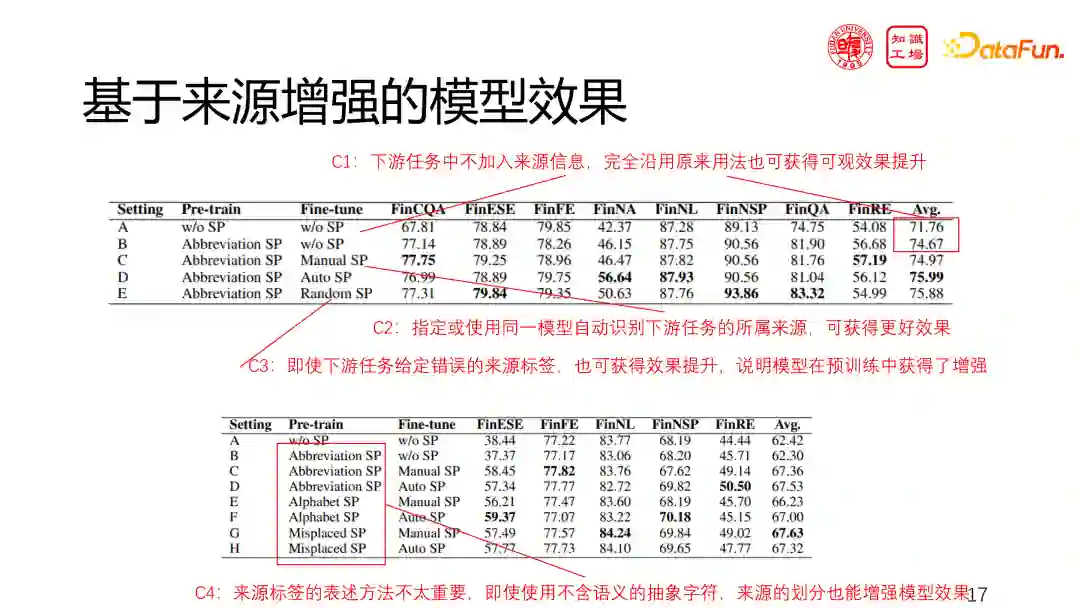

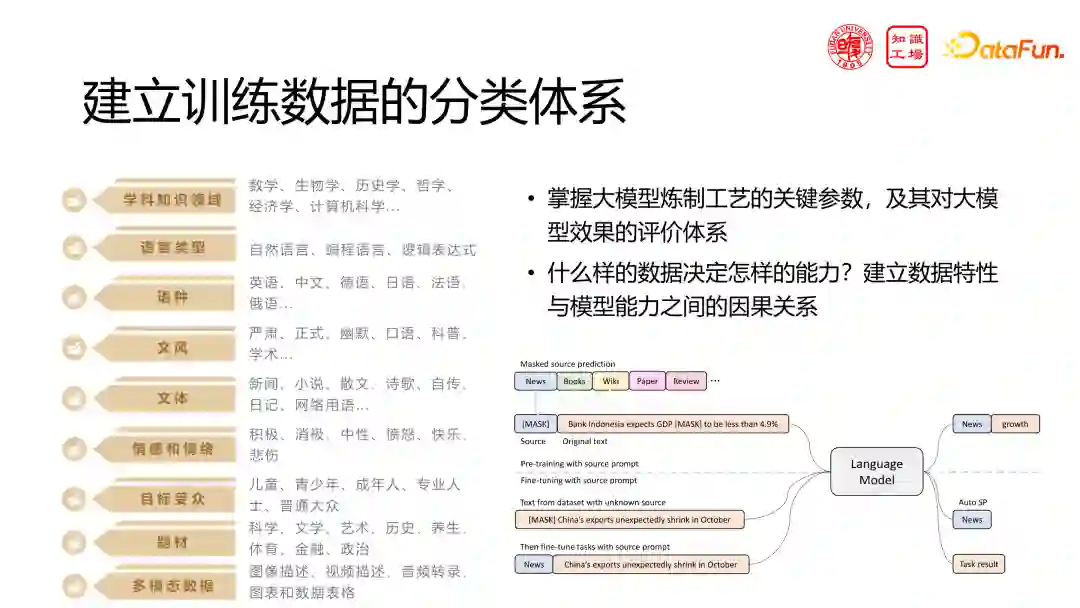

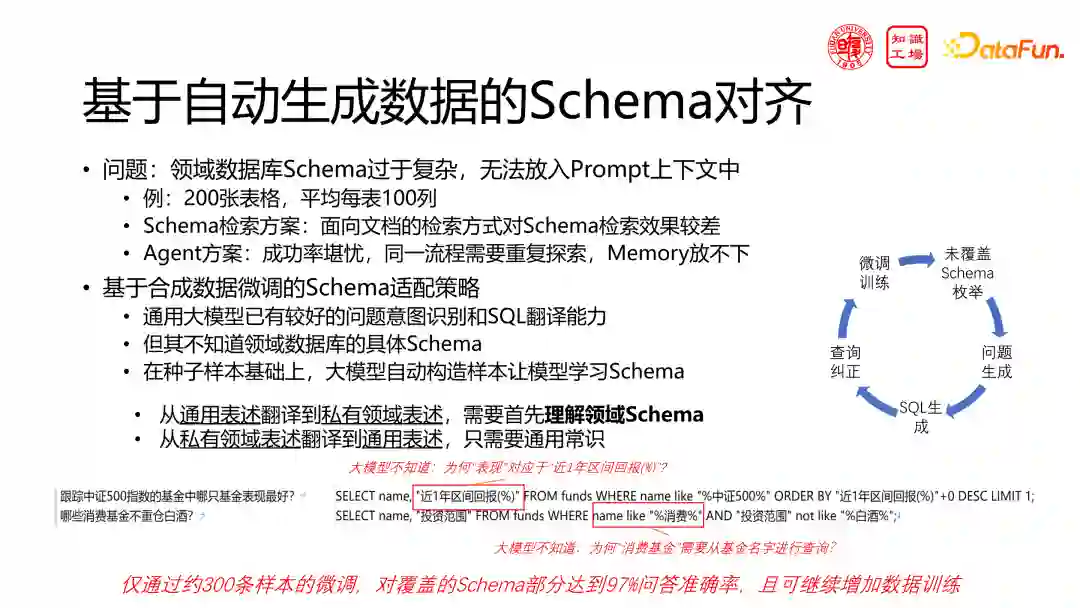

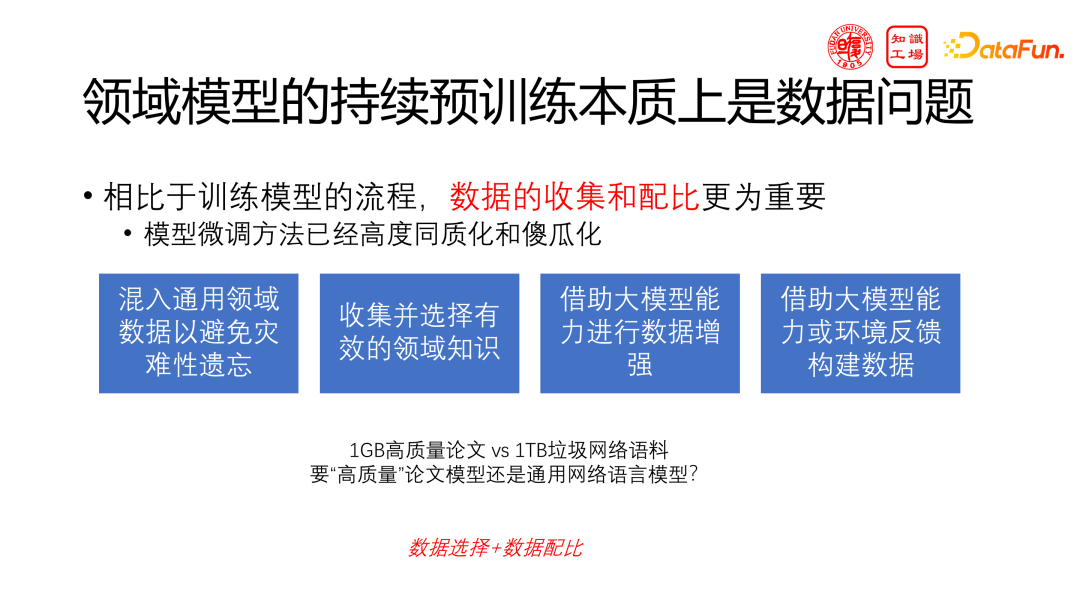

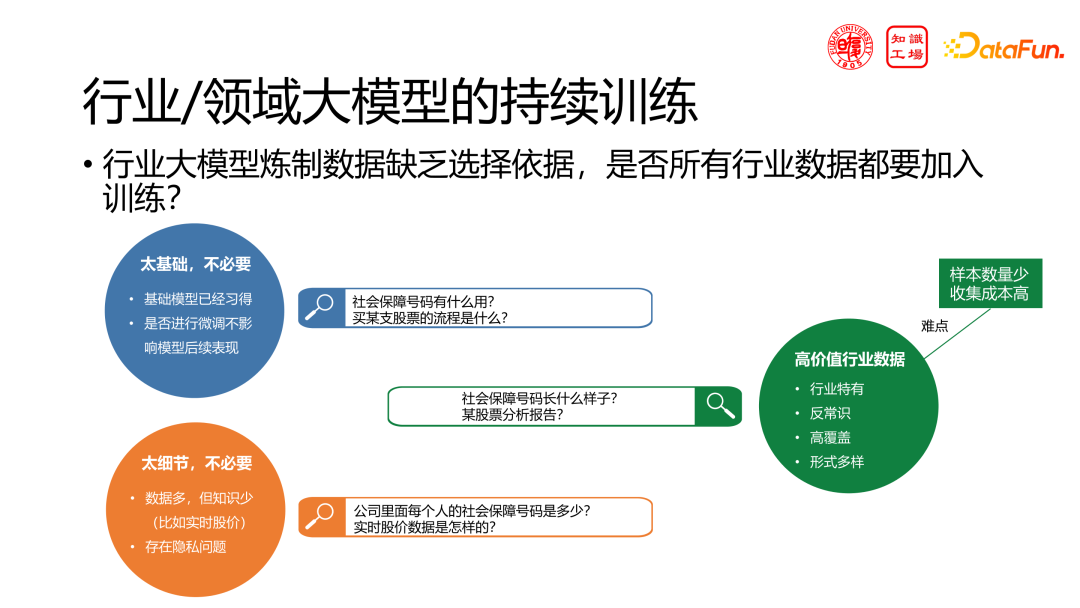

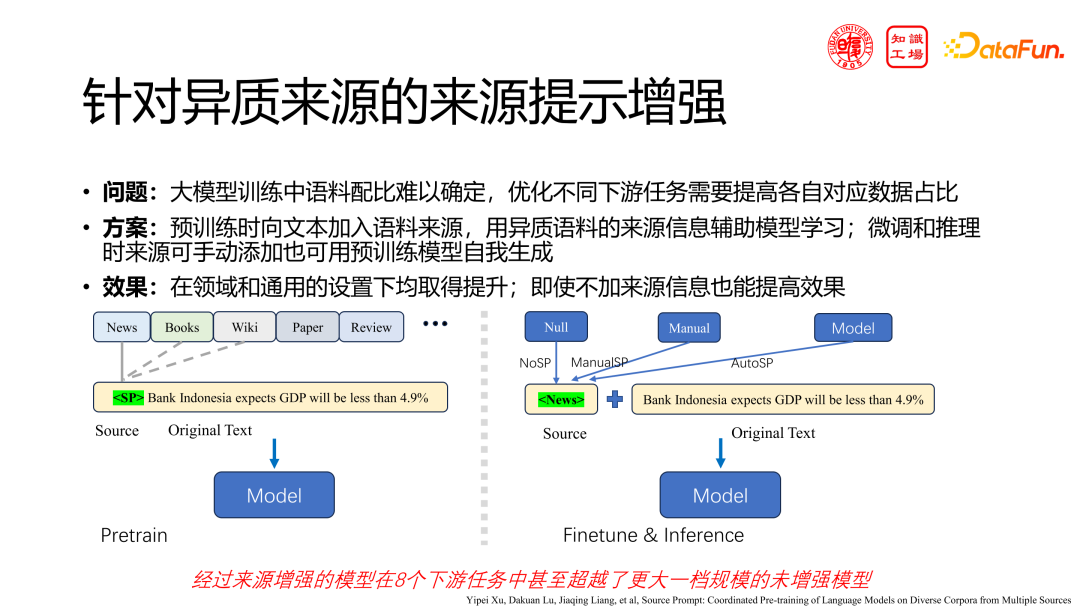

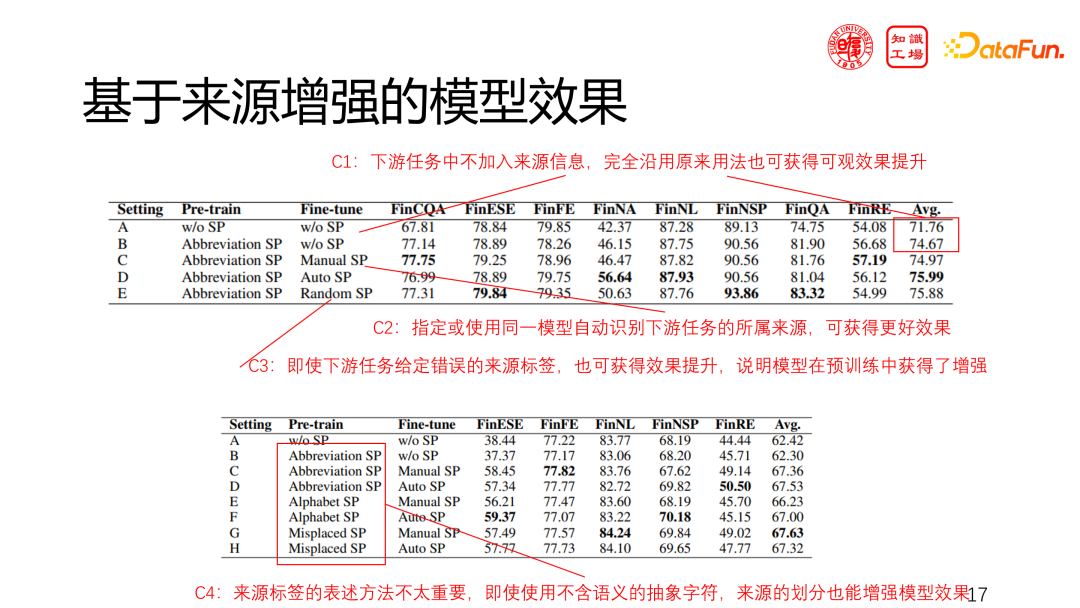

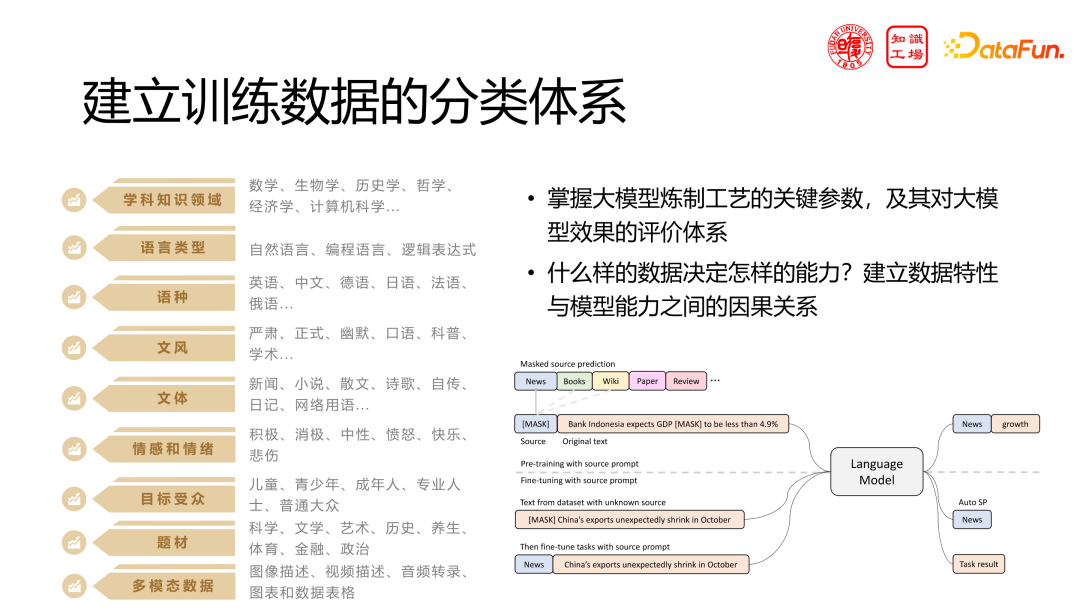

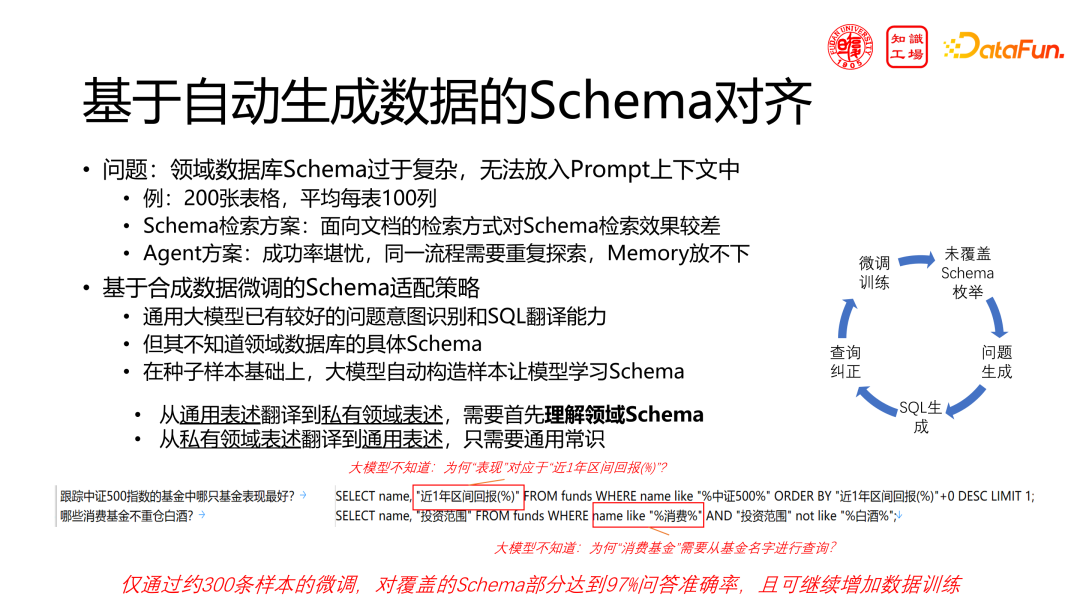

- 大模型的领域适配

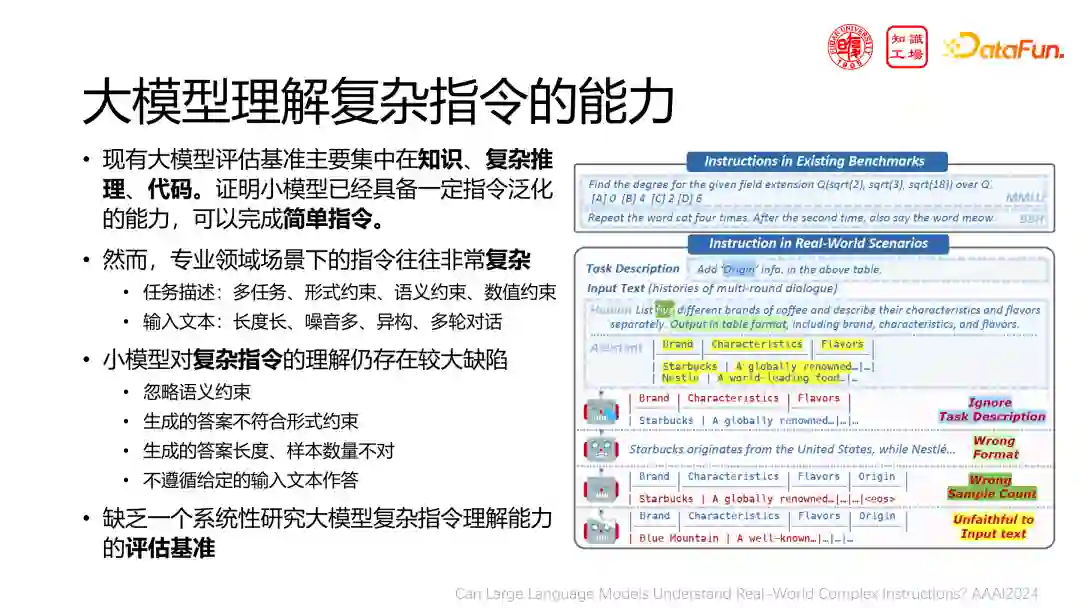

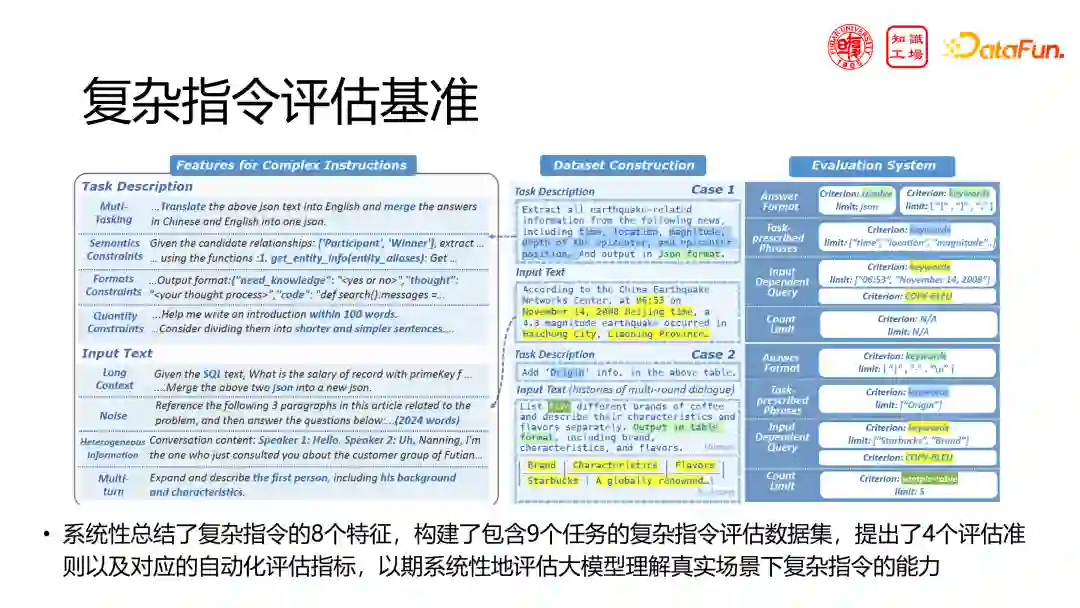

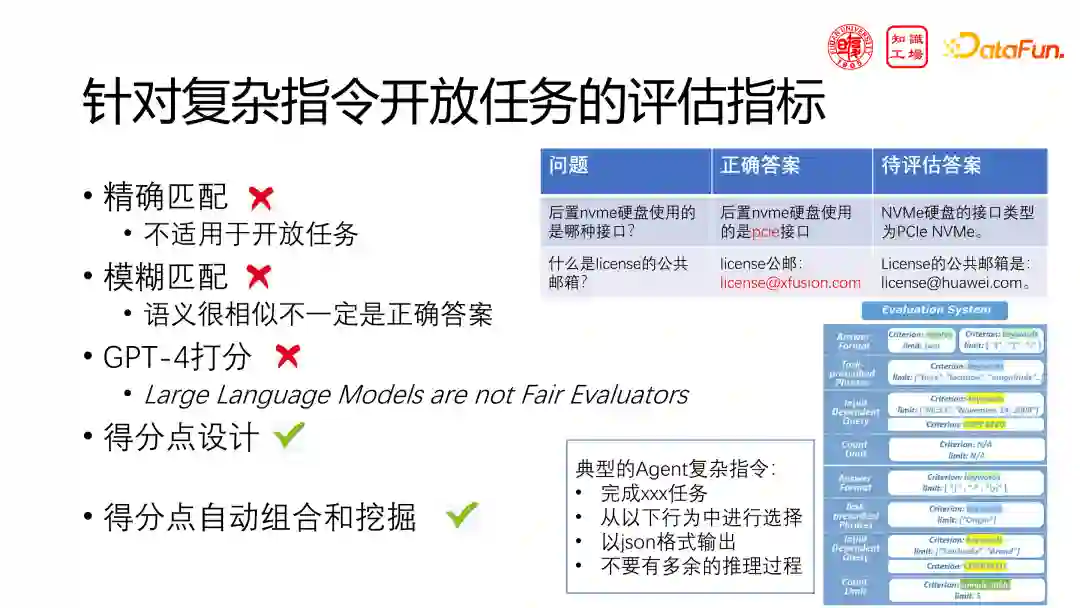

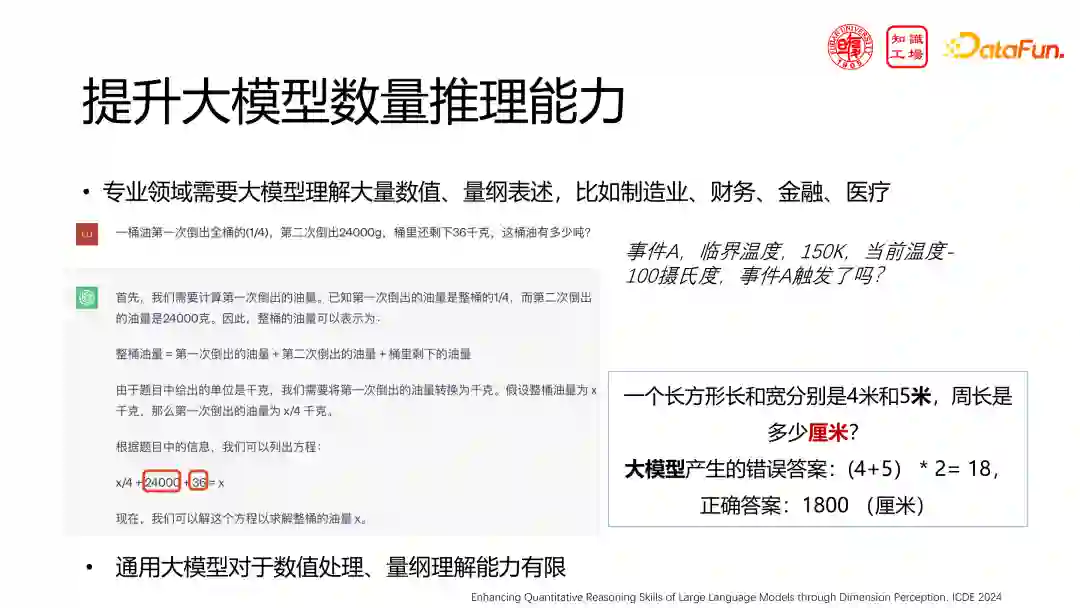

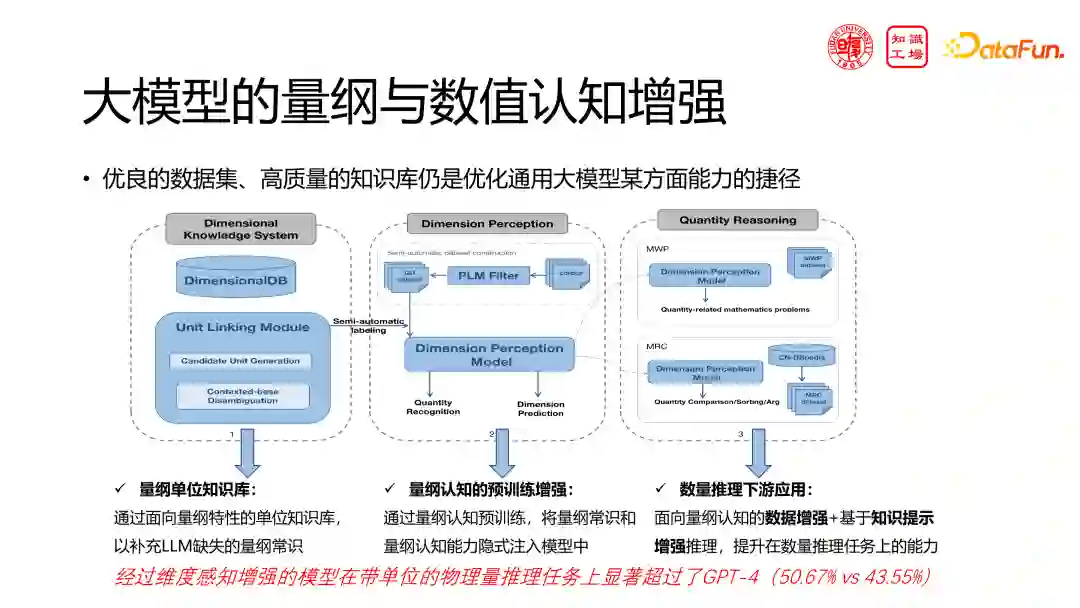

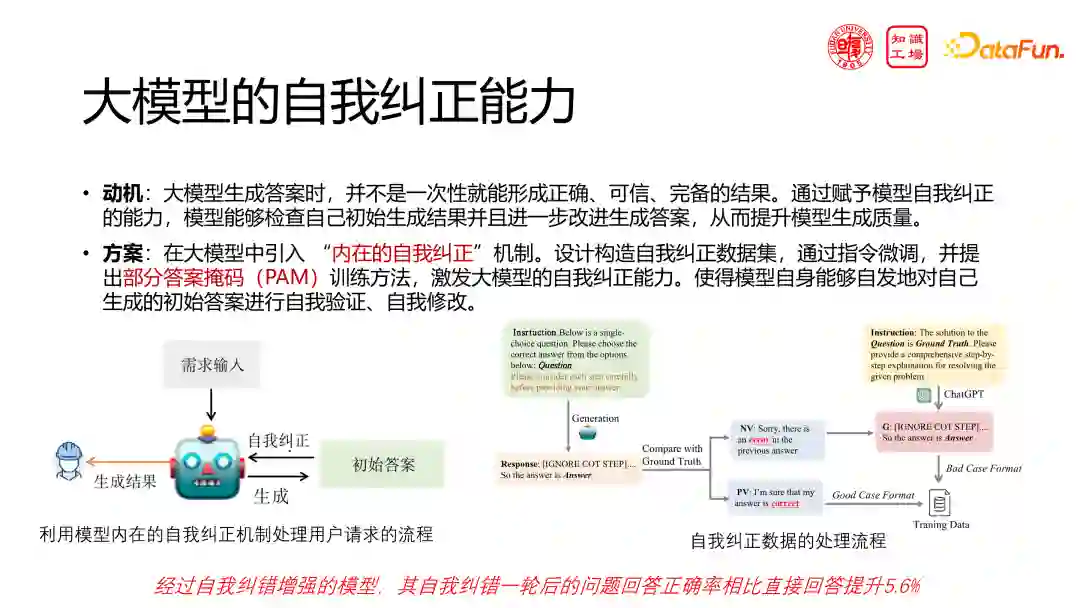

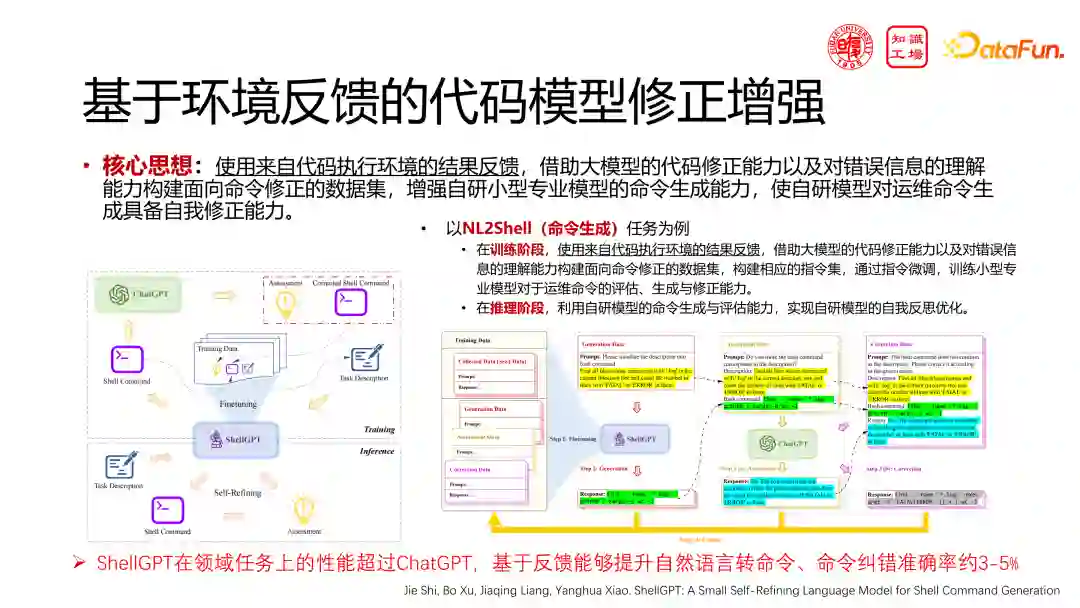

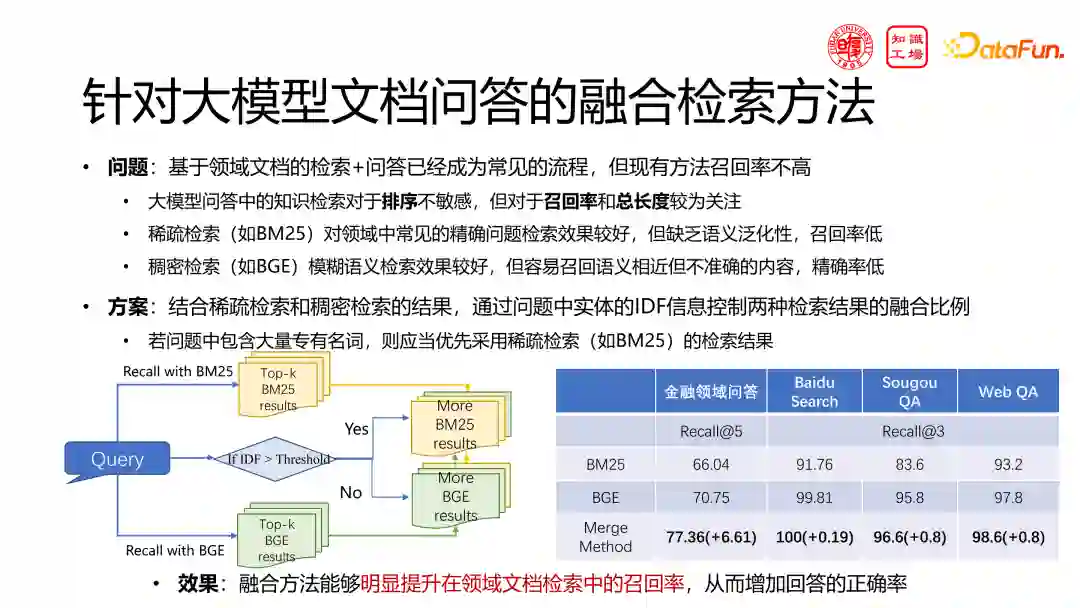

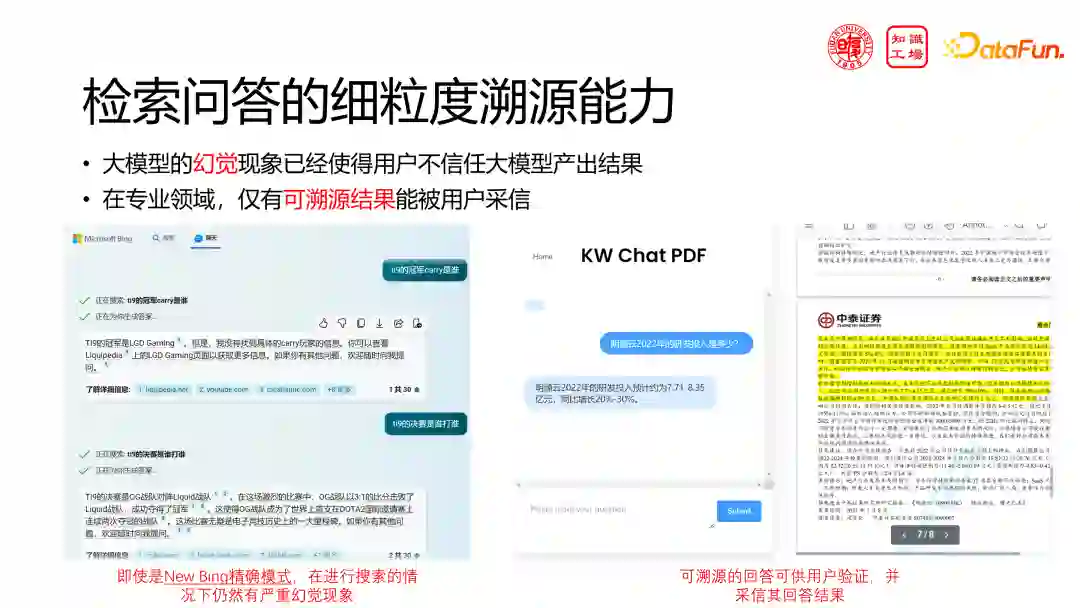

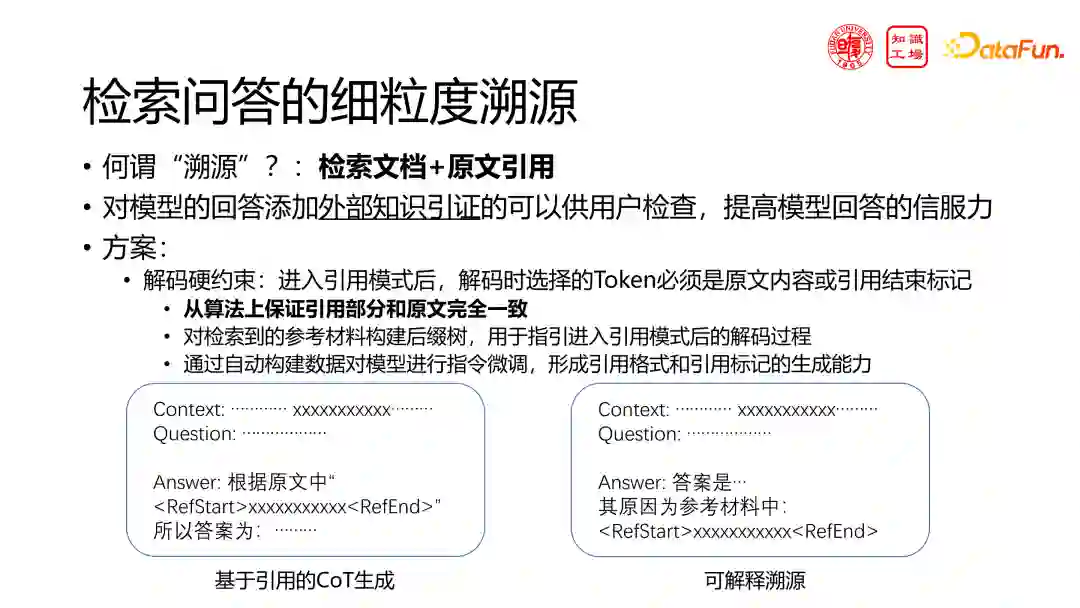

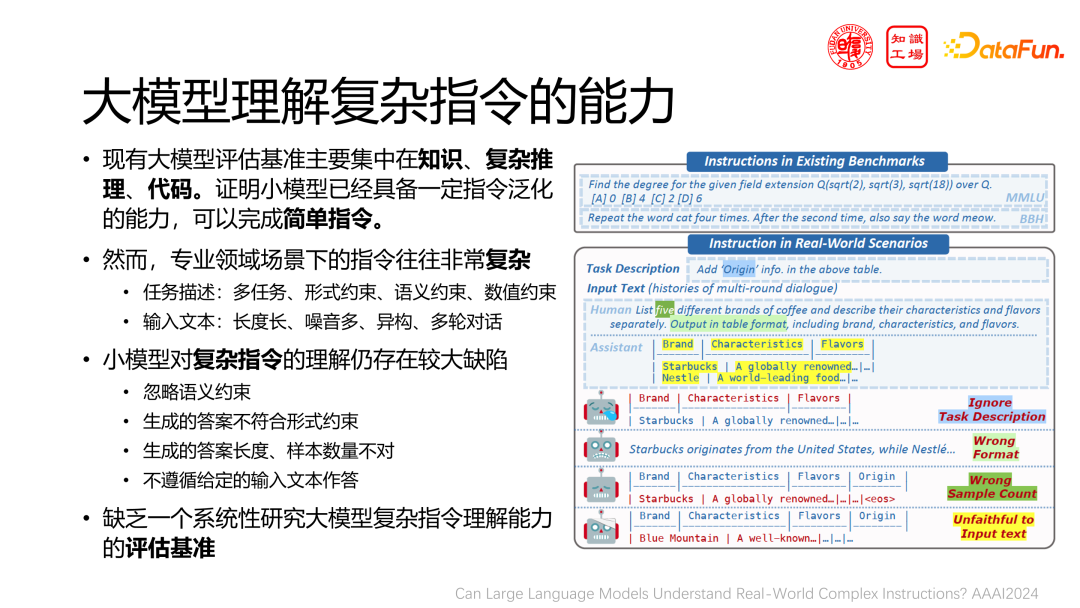

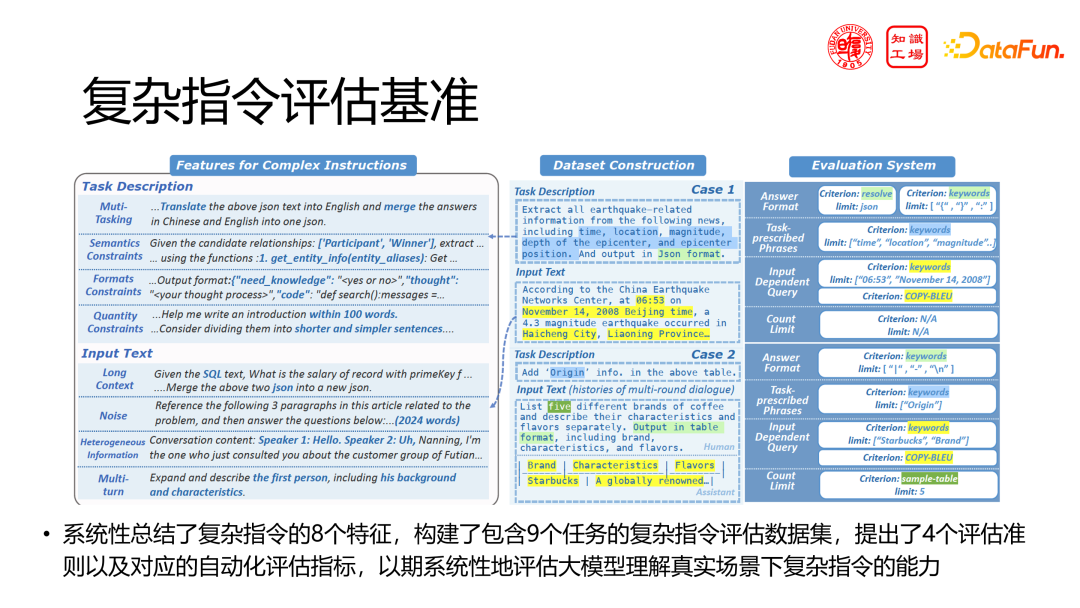

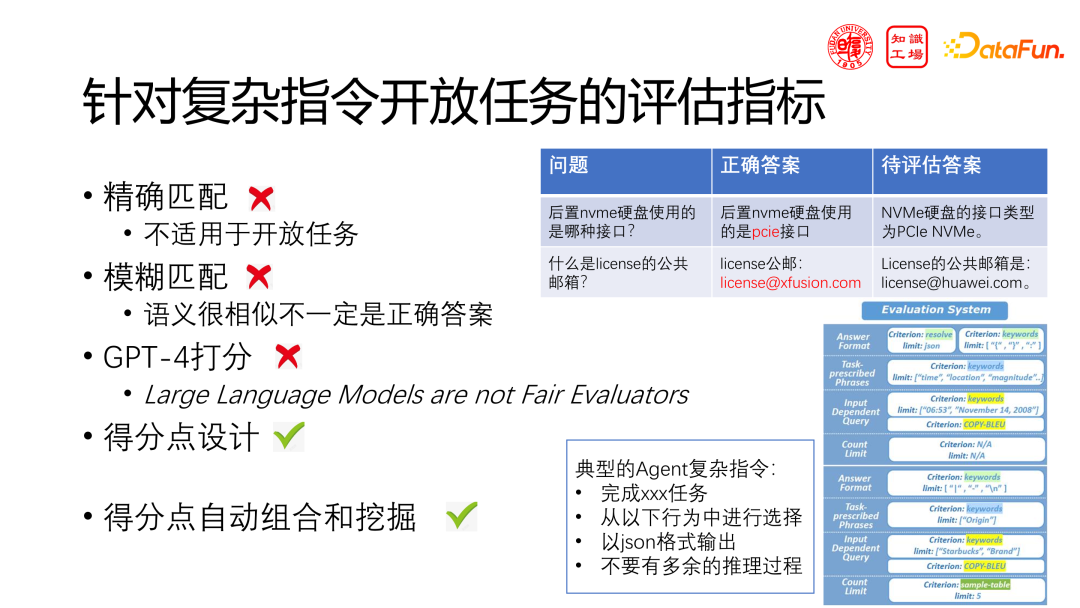

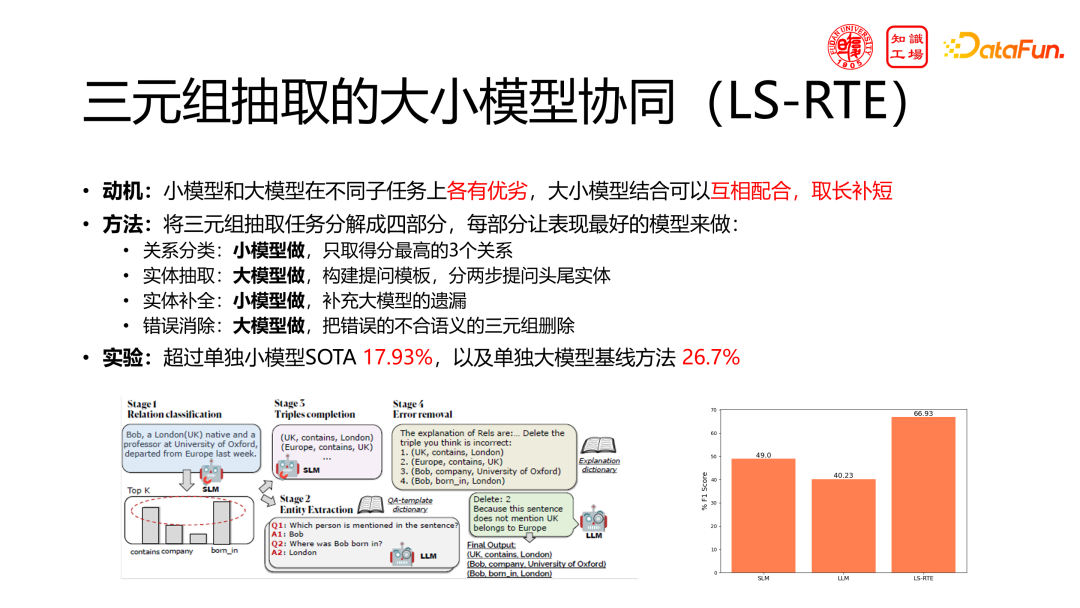

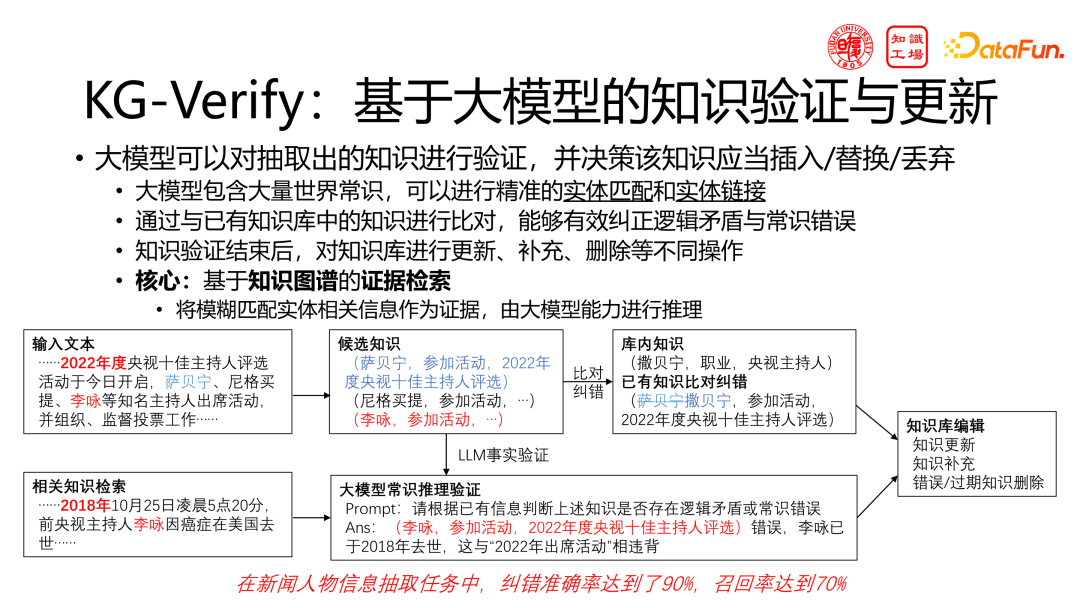

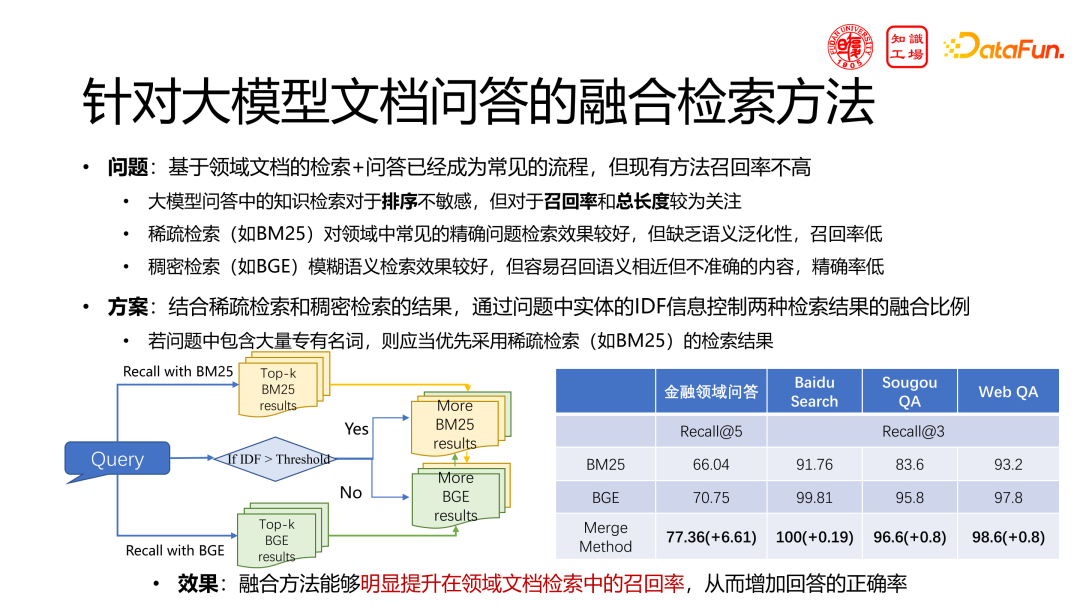

- 大模型的能力提升

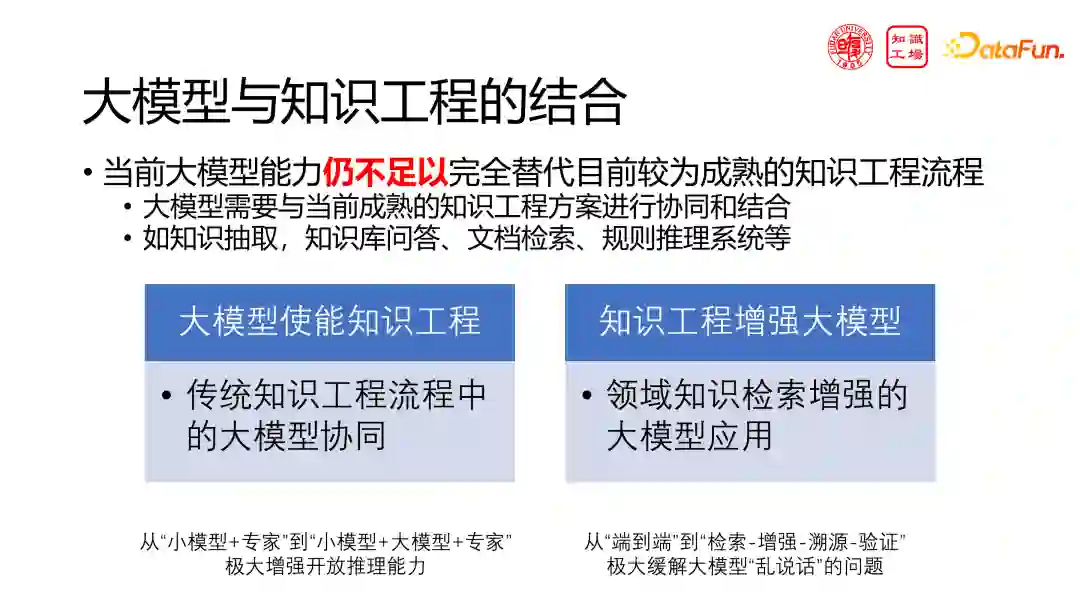

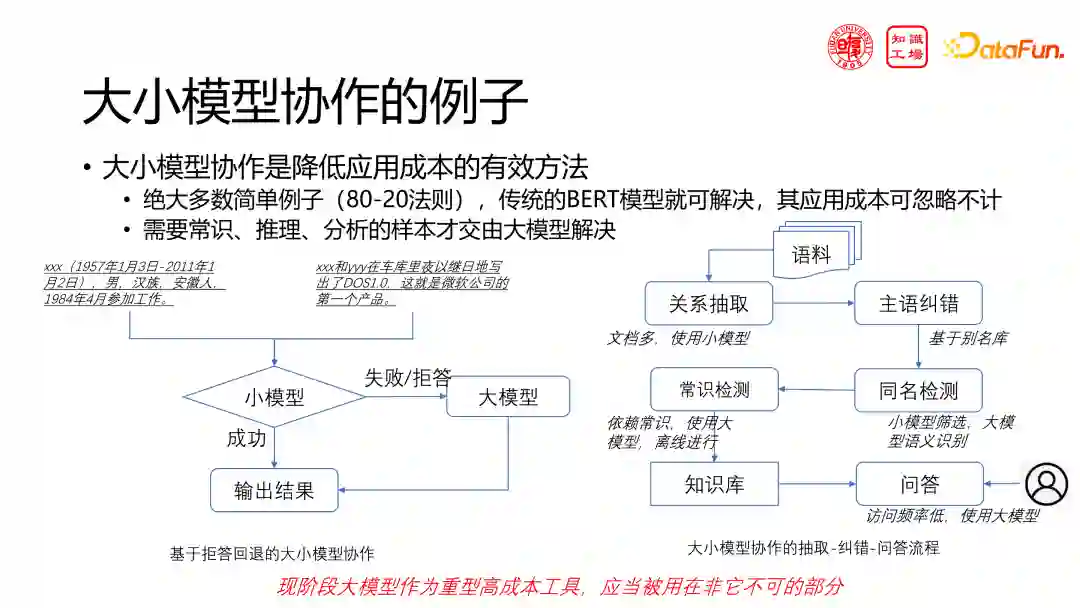

- 大模型的协同工作 分享嘉宾|梁家卿博士 复旦大学 青年副研究员 编辑整理|王甲君 内容校对|李瑶 出品社区|DataFun

01

背景

02****

大模型的领域适配

03

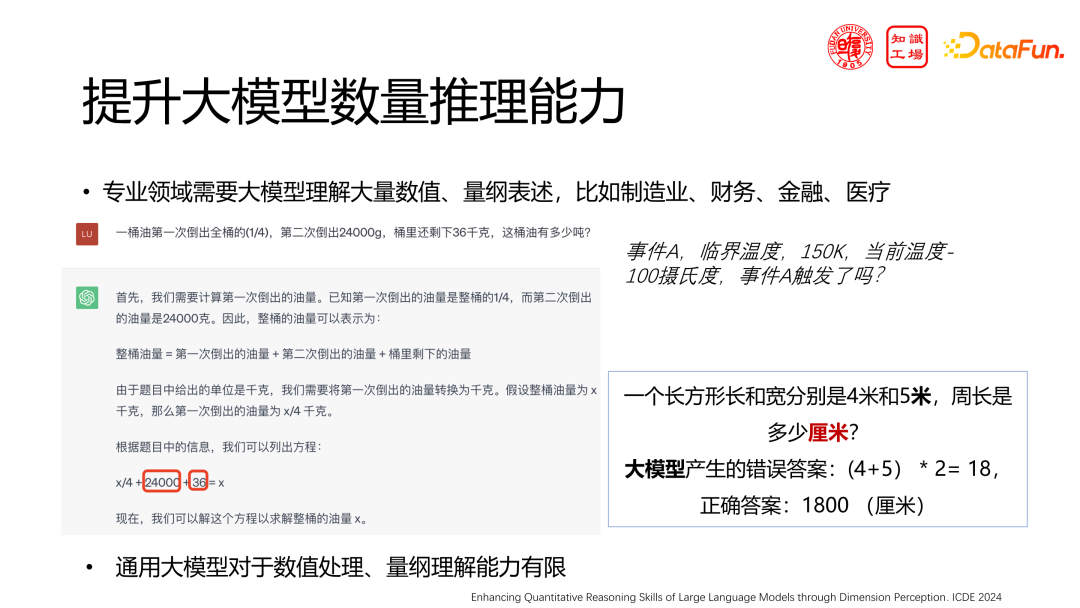

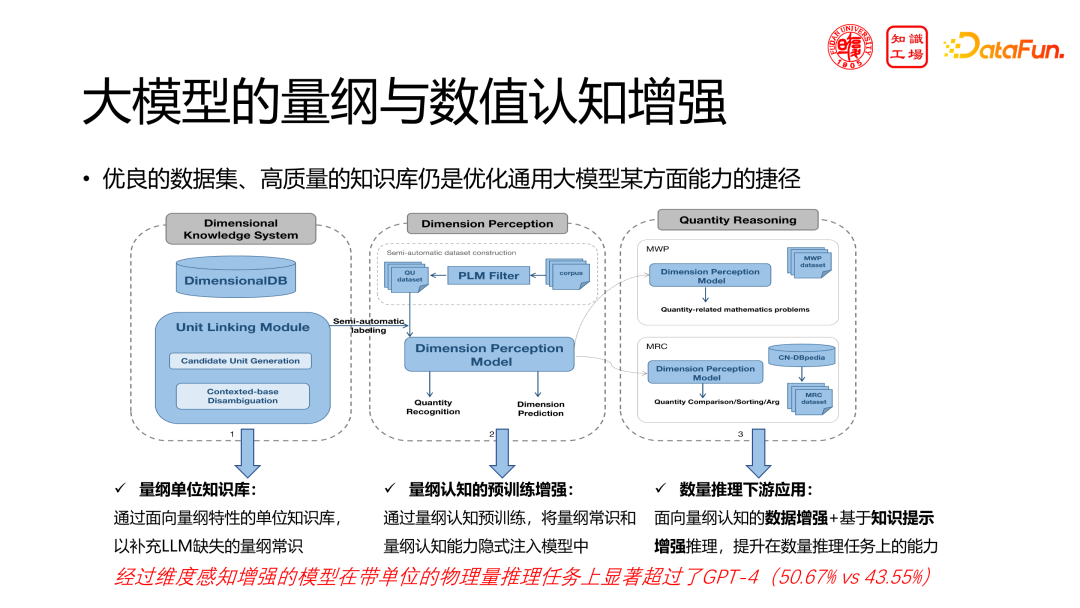

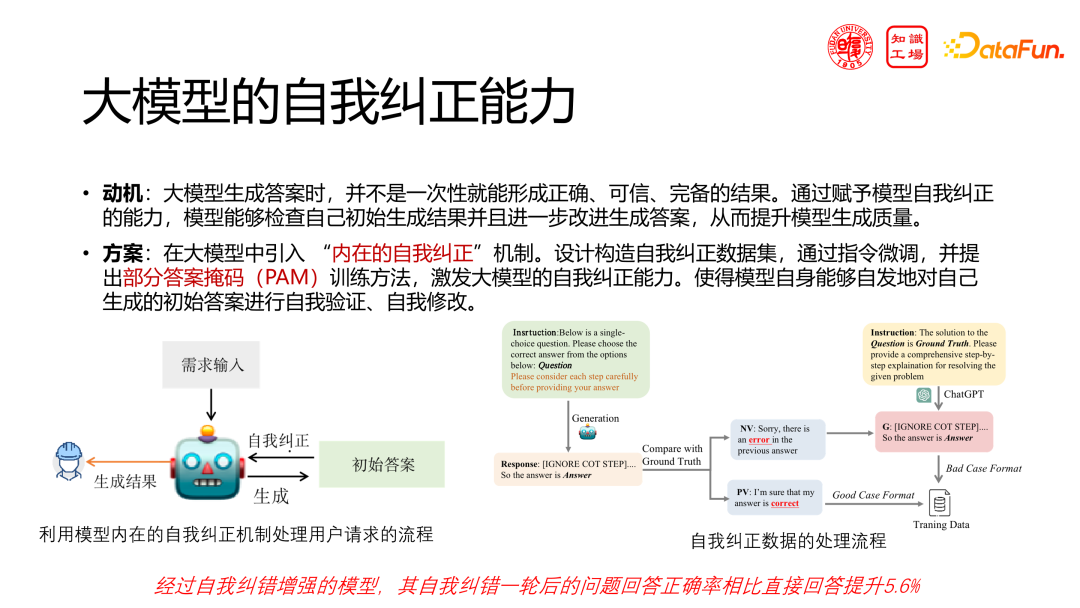

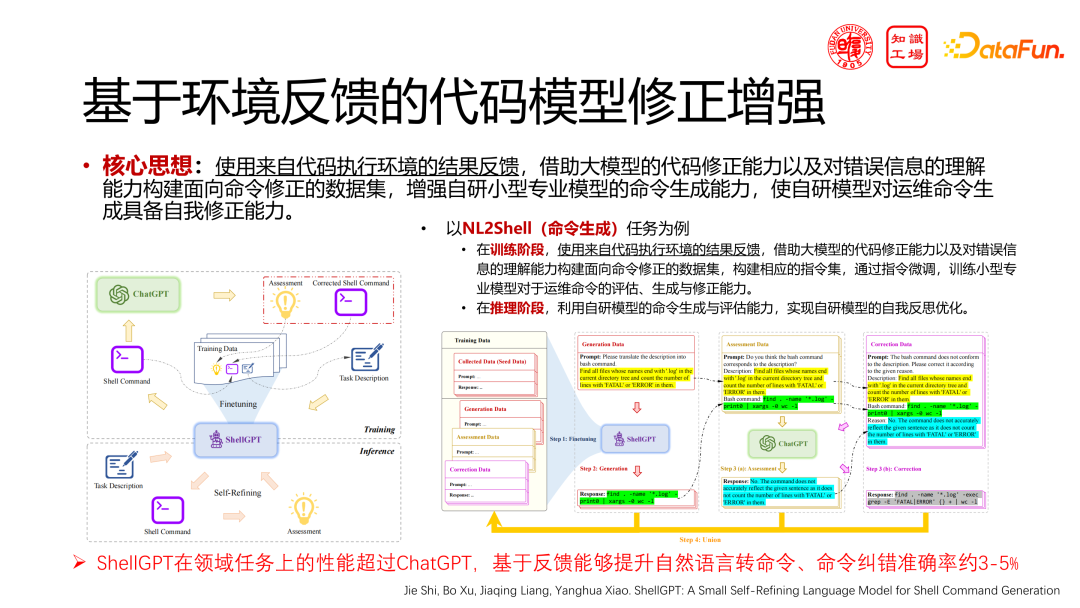

大模型的能力提升

04

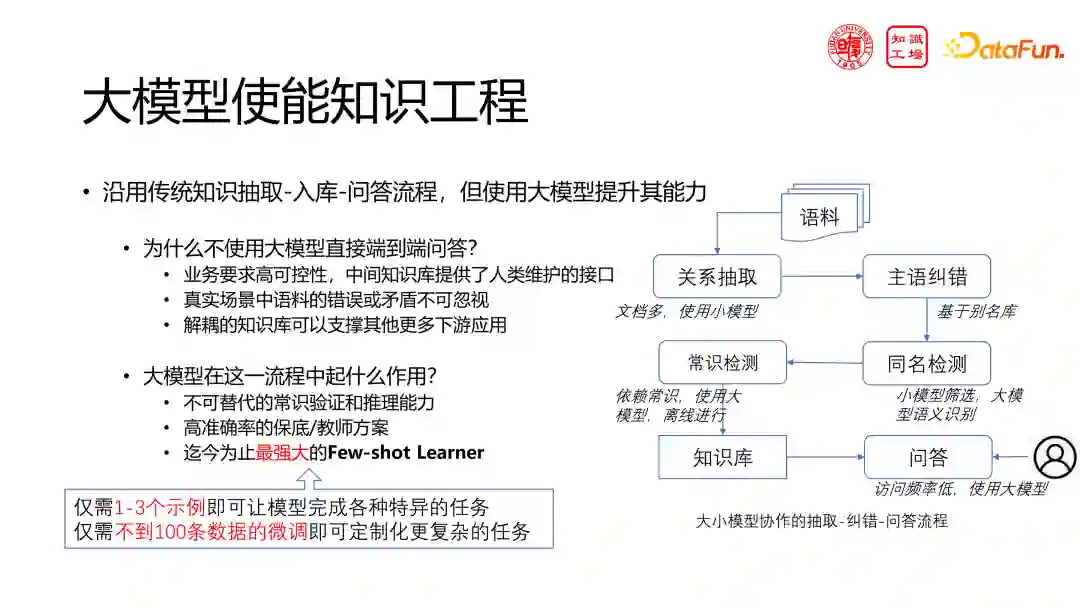

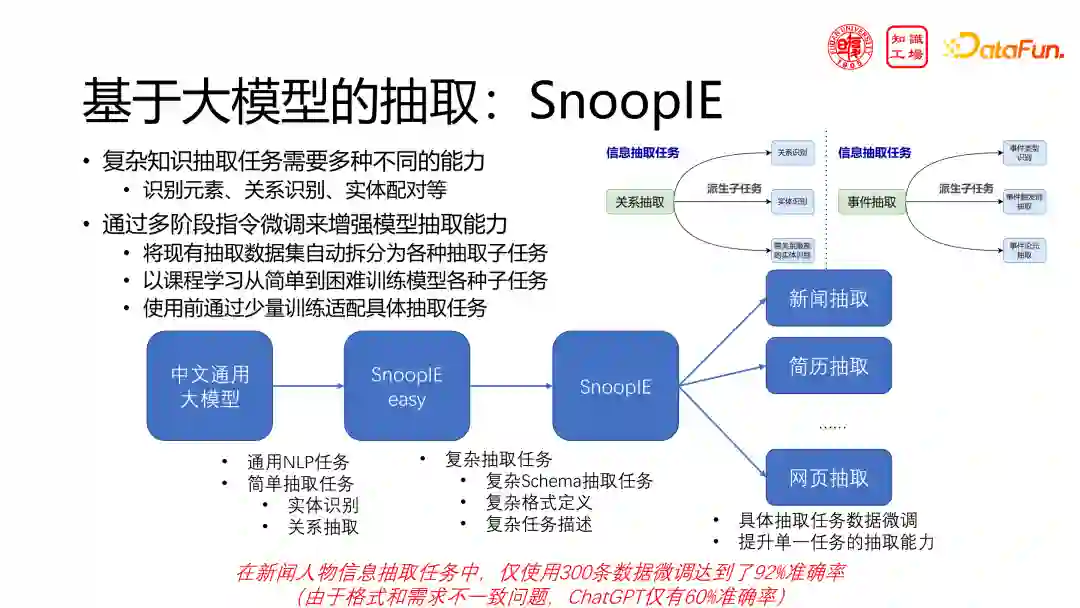

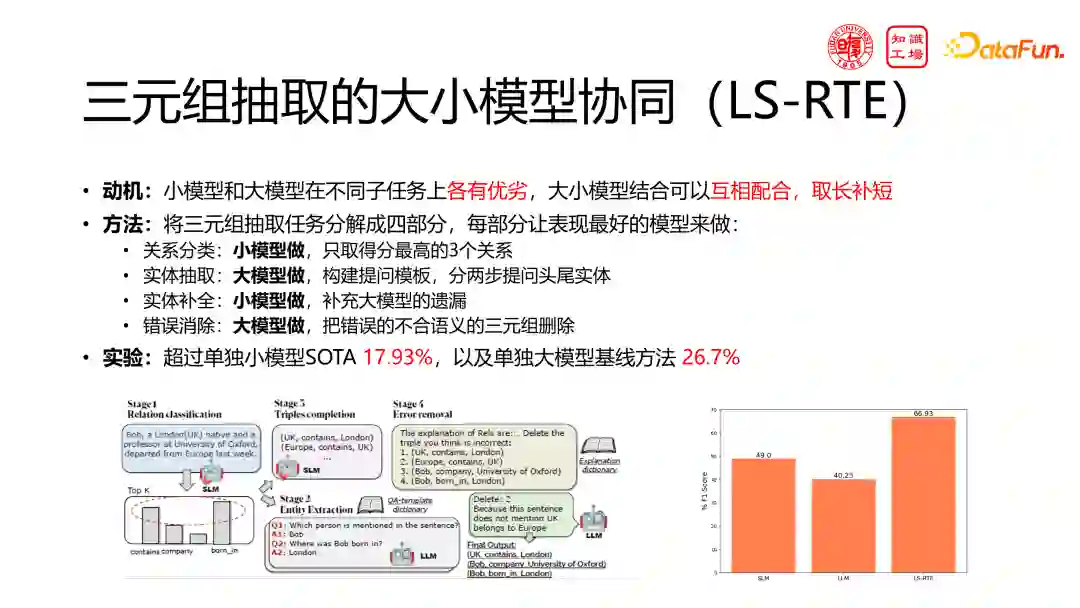

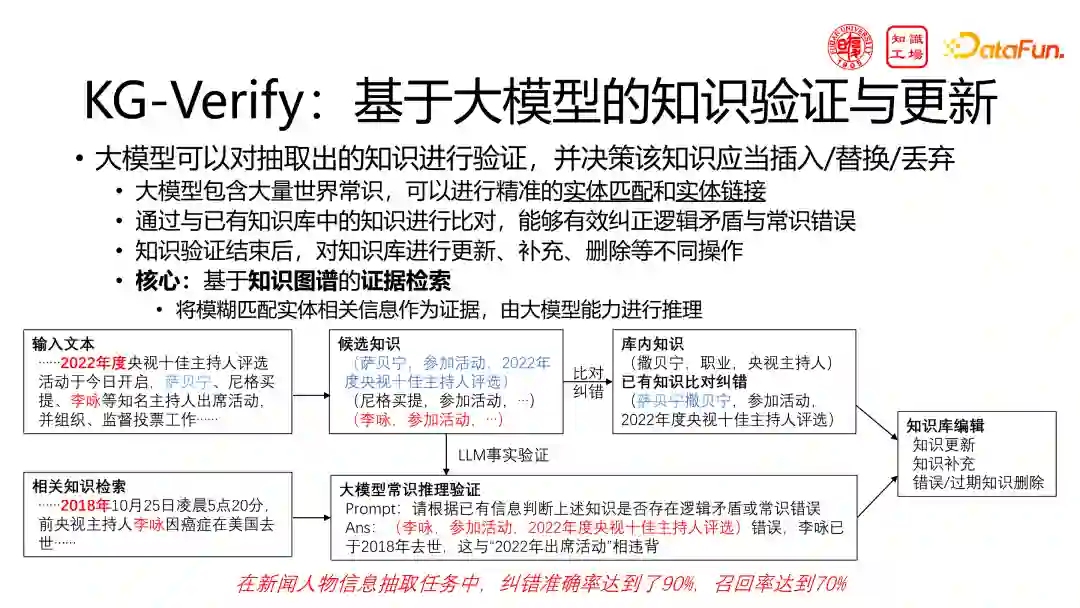

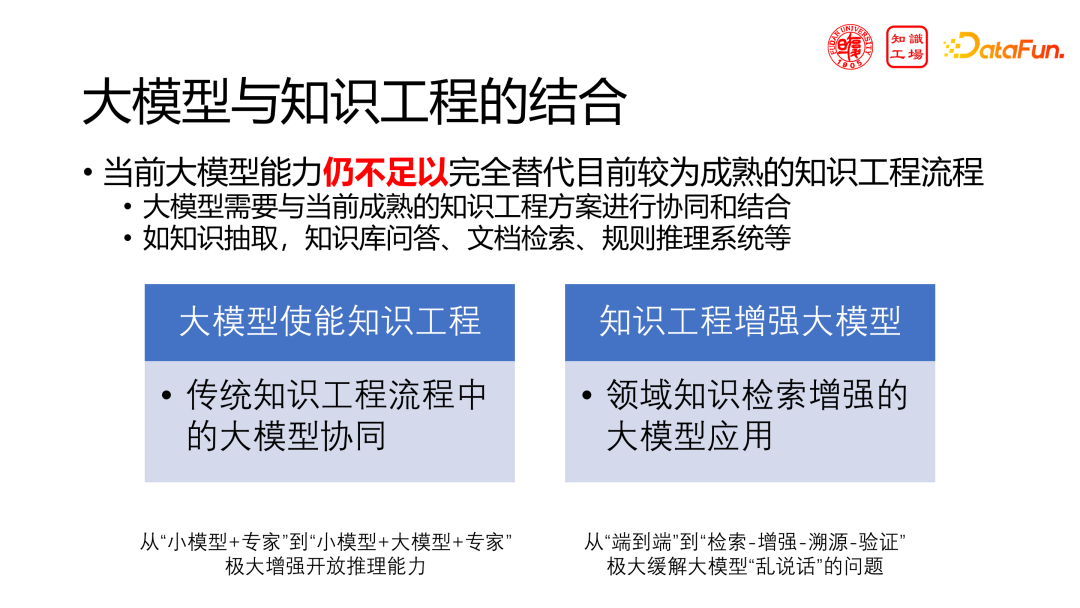

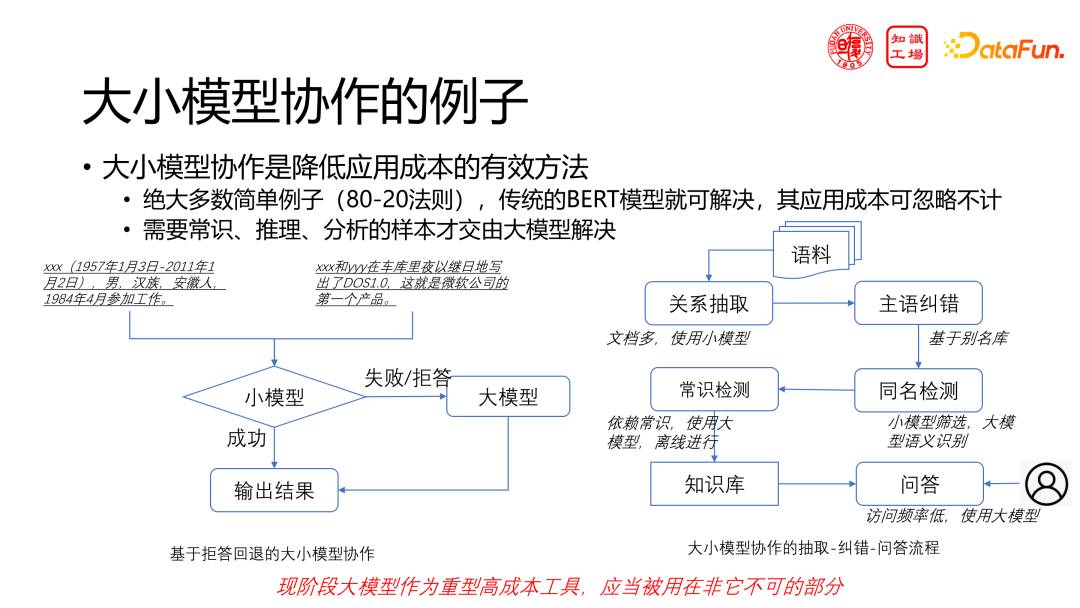

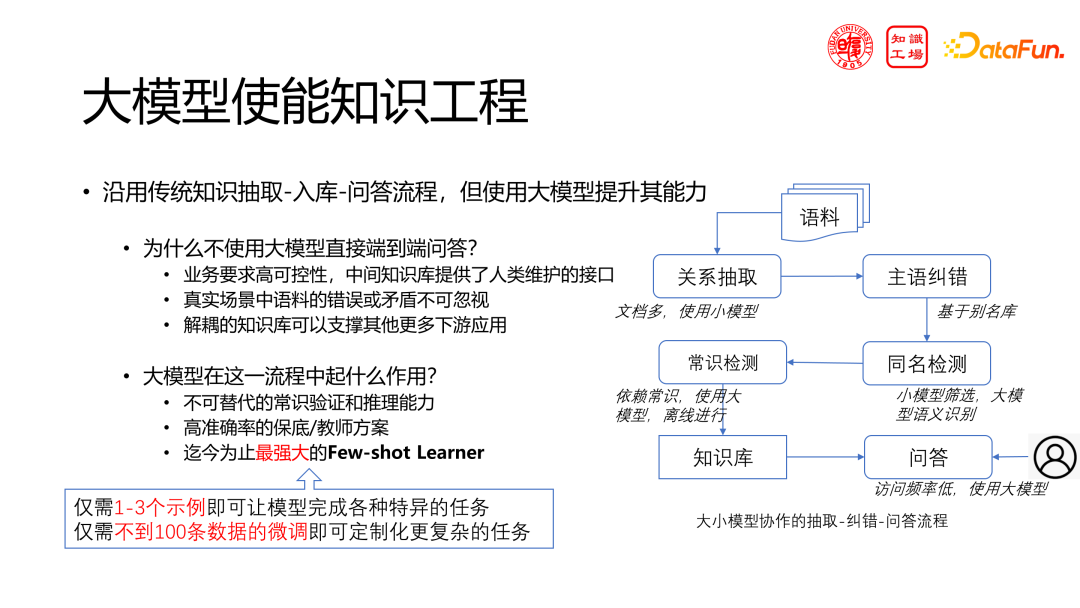

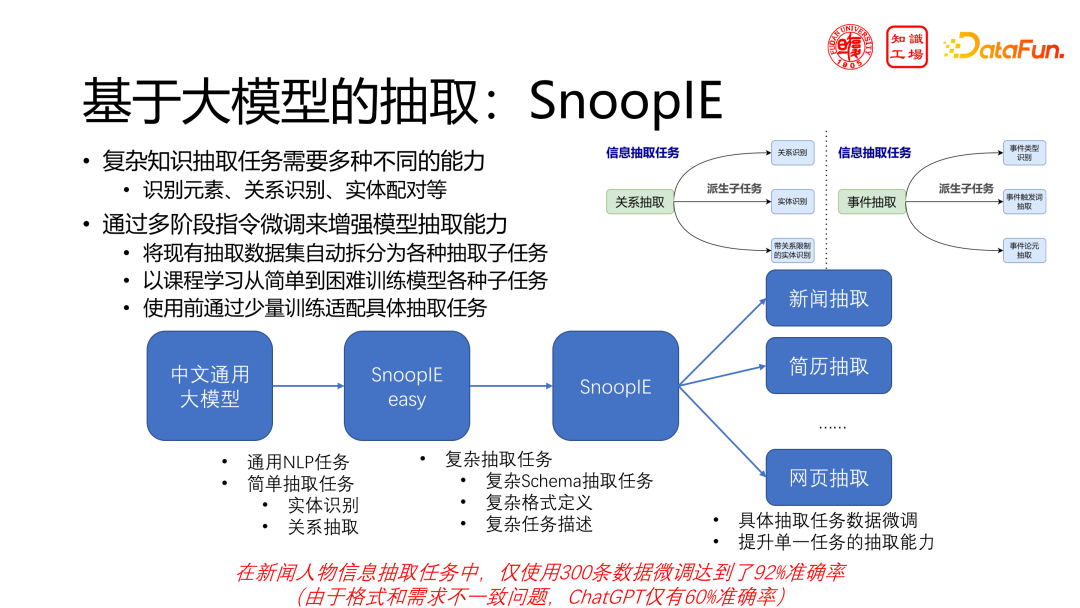

大模型的协同工作

分享嘉宾

INTRODUCTION

梁家卿博士

复旦大学

青年副研究员

梁家卿博士,复旦大学大数据学院青年副研究员,主要研究方向为基于知识图谱与大模型的认知智能。在国际顶级学术会议与期刊(包括 TKDE,AAAI,IJCAI,ICDE 等)发表论文 50 多篇。在应用落地方面,作为技术负责人研发并公开发布了多个知识图谱与大模型应用平台如 CuteGPT、Emo-CuteGPT、CN-DBpedia、ProbasePlus、CN-Probase、“不倒翁”智能问答等,相关产品 API 被工业界与学术界多家单位已调用累计 17 亿次以上,并形成了 16 个专利。有成功训练百亿参数量级别模型的经验和在大规模集群上训练千亿参数量级别模型的经验。先后在国际性的“知识库构建”比赛中荣获第二名;在中国计算机学会和中国中文信息学会的主办的语言与智能技术竞赛“信息抽取”比赛中荣获第一名。主持研发的情感增强大模型 CuteGPT 在上海卓辰信息科技有限公司(帮助其情报信息知识抽取准确率达到 90% 以上)、上海双地信息系统有限公司(帮助其开发了内容管理产品“小孔商业智能 AI 助理”)、上海光唯文化传媒有限公司(应用于其客户在新产品研发业务,新产品销售额超过千万元)等单位实现了落地应用。并且曾获 ACM-ICPC 区域赛金牌、TopCoder Open 全球前 150 名、吴文俊人工智能科学技术奖科技进步奖三等奖、上海市优秀博士毕业生、上海市计算机学会优秀博士论文、华为云最佳论文复现奖、复旦大学超级博士后、上海市超级博士后、中国博士后科学基金面上资助、国家自然科学基金青年基金资助。