协作机器人(即 "cobots")和基于机器学习的智能体正越来越多地进入人类的工作空间,目的是提高生产率、增强安全性和改善生活质量[1, 2]。这些智能体将在动态和新颖的环境中与各种各样的人进行动态交互,使人机团队在医疗保健[3]、制造[4]和搜救[5]等领域更加普遍。在这些领域中,合作者必须目标一致,并保持对其他智能体行为的感知,以避免潜在事故的发生。至关重要的是,智能体必须能够理解用户之间的异同,并为用户提供信息,支持心智模型的调整。

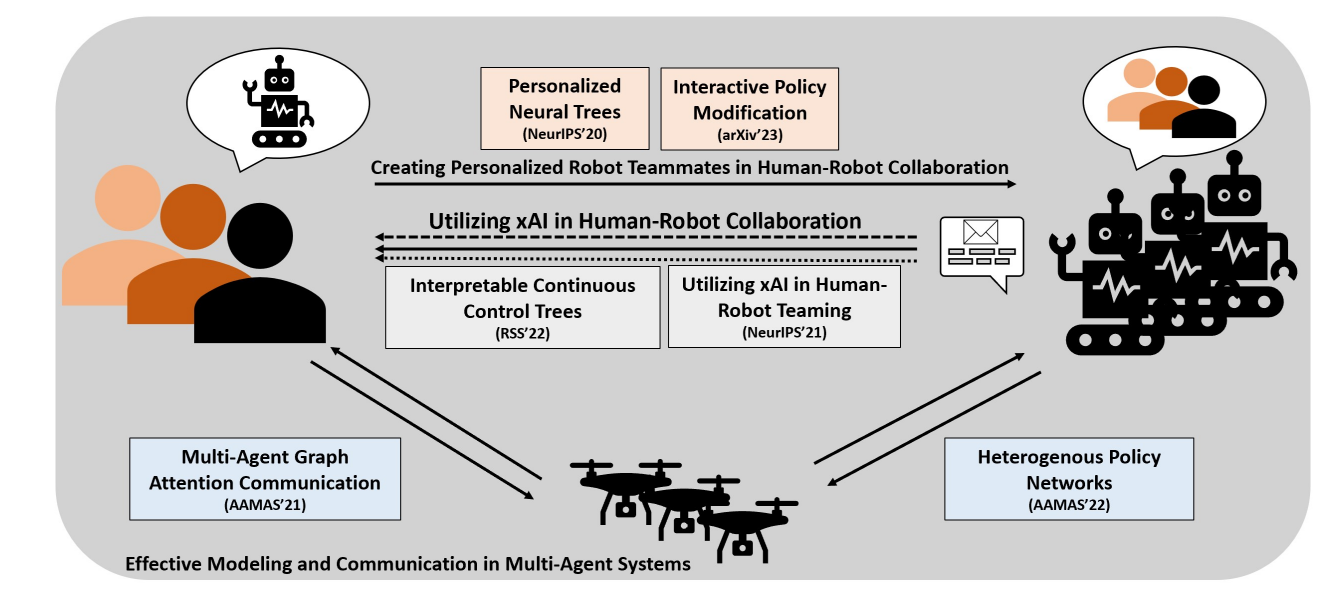

在文中,首先研究了模拟大规模多智能体系统中协作的本质。具体来说,探索了在部分可观测环境中分散机器人之间利用基于上下文的通信技术,发现利用有针对性的通信(第4章)和考虑队友异质性(第5章)有利于生成有效的协调策略[6, 7]。接下来,过渡到人机系统,并开发了一个数据高效、针对特定人员且可解释的基于树的学徒学习框架(第6章),使机器人能够推断并理解异构用户的决策行为[8, 9]。在此基础上,扩展了基于神经树的架构,支持通过强化学习(reinforcement learning)为机器人学习可解释的控制策略[10]。这一进步不仅允许终端用户检查学习到的行为模型,还为开发人员提供了验证控制策略安全性的方法(第 7 章)。随后,描述了可解释人工智能(xAI)技术的实用性,该技术有望在人机协作中增强团队态势感知和共享心智模型开发[11](第8章)。最后,让最终用户能够通过图形用户界面交互式修改可解释的学习策略,以支持重复人机协作范例中的团队发展(第9章)。

本文的贡献如下:

-

创建基于通信的新型多智能体强化学习(MARL)架构: 开发了多智能体图注意通信(MAGIC)[6],这是一种利用目标通信(智能体主动决定 "何时 "和 "与谁 "通信)的多智能体强化学习(MARL)架构,用于在部分可观测环境中的分散智能体之间学习高性能团队协调策略。团队成员通过信息共享和与合作者的模拟体验,开发出一种隐含的共享心智模型。

-

创建支持异构机器人团队的 MARL 架构: 开发了异构策略网络(HetNet)[7],这是一种 MARL 架构,可有效模拟异构机器人团队(即由具有不同状态、行动和观察空间的智能体组成)。通过 HetNet,利用可变编码器-解码器通道来考虑类间信息的异质性,将编码信息 "翻译 "成异构机器人团队中各智能体之间共享的中间语言,从而促进各智能体之间的通信。

-

开发可解释的、针对个人的 "从异质演示中学习"(LfHD)框架: 提出了一种个性化的、可解释的学徒调度算法,该算法通过提取决策标准,推断出所有人类任务演示者的可解释表征,推断出的个性化嵌入与演示者类型的数量无关[8, 9]。通过这种技术,协作机器人可以自主地获得对人类队友决策行为的个性化、隐含的理解,从而使机器人同行的个性化程度更高。

-

开发基于树的模型,该模型可通过基于梯度的现代强化学习方法进行优化,以产生高性能、可解释的策略:介绍了可解释的连续控制树(ICCTs),这是一种可解释的强化学习架构,允许在类似稀疏决策树的表征中进行直接优化[10]。新架构在生产安全、可验证、基于机器学习的自主系统方面迈出了坚实的一步,这些系统已准备好在现实世界中部署并与人类互动。

-

描述可解释人工智能(xAI)在人机协作中的效用: 进行了两项新颖的人类-受试者实验,以量化在人机协作场景中部署 xAI 技术的益处。评估了人类队友通过增强 xAI 技术获得更好态势感知的能力,并量化了 xAI 支持的 SA 对人机团队流畅性的主观和客观影响[11]。重要的是,这些发现强调了为人机协作开发 "正确 "的 xAI 模型以及支持学习这些 xAI 模型的优化方法的重要性。

-

找出通过基于学习的技术产生的智能体在质量上的差距,并探索基于 xAI 的技术作为提高人机协作性能的潜在解决方案。人机协作领域中最先进的协作代理是僵化的,其重点是提高智能体的个性化贡献,而不是人机团队之间的有效协作。为了消除个性化协调与成功人机协作之间的性能差距,探索利用可解释模型和图形用户界面,让最终用户与通过强化学习训练的可解释机器人策略进行交互。这种图形用户界面允许终端用户 "深入 "机器学习模型,调整承受能力或交互式地迭代重新编程行为。重要的是,发现有证据表明,在交互式修改的支持下,用户与白盒智能体组队的效果优于单独与白盒智能体组队的效果。

图 1.1: 该图显示了论文概览。在第 4 章和第 5 章中,利用基于图的架构来有效地模拟和促进多智能体系统中的通信。在第 6 章和第 9 章中,为机器人同行提供了更多个性化服务。在第7章和第8章中,通过使用可解释人工智能技术来促进机器人与人类之间的定向交流。这些内容有助于促进团队内共享心智模型的发展,从而实现高质量的人机协作。