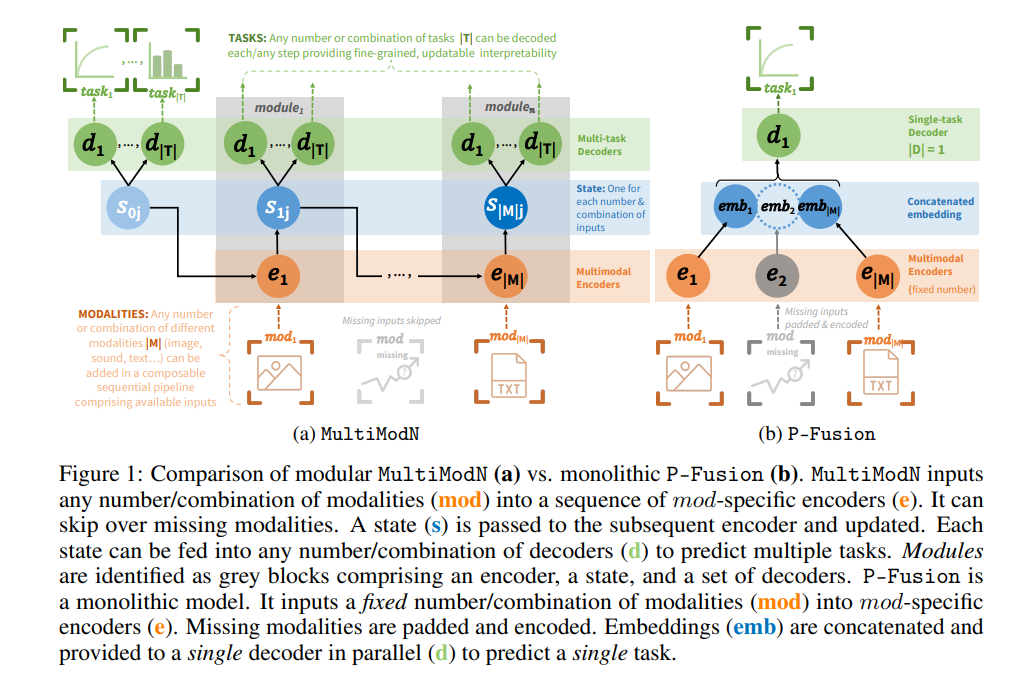

在单一模型中预测多个实际任务往往需要一个特别多样化的特征空间。多模态(MM)模型旨在提取多种数据类型的协同预测潜力,以创建具有跨输入(例如,图像、文本、声音)对齐的语义意义的共享特征空间,这些输入的大小差异极大。大多数当前的MM架构并行融合这些表示,这不仅限制了它们的可解释性,而且还创建了对模态可用性的依赖性。我们提出了MultiModN,一种多模态的模块化网络,它在任何数量、组合或模态类型的序列中融合潜在表示,同时提供关于任何数量或组合的预测任务的细粒度实时预测反馈。MultiModN的可组合管道是可由设计解释的,也是天生的多任务并且对偏斜缺失的基本问题具有鲁棒性。我们对10个实际任务(预测医疗诊断、学术成绩和天气)的几个基准MM数据集进行了四项实验,并显示,与并行融合的基线相比,MultiModN的序列MM融合不会降低性能。通过模拟挑战性的偏见,即缺失非随机(MNAR),本文表明,与MultiModN相反,并行融合基线错误地学习了MNAR,并在面对推断时的不同MNAR模式时遭受灾难性的失败。据我们所知,这是第一种固有的抗MNAR的MM建模方法。总之,MultiModN提供了细粒度的洞察、鲁棒性和灵活性,而不妥协性能。

https://www.zhuanzhi.ai/paper/d1b365aedeee53e22c2eaec14e77c669

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2023年11月9日

Arxiv

42+阅读 · 2023年4月19日

Arxiv

224+阅读 · 2023年4月7日