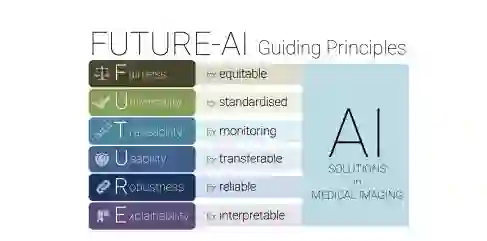

人工智能(AI)的最新进展与当今临床系统产生的大量数据相结合,促进了影像AI解决方案的发展,它贯穿了医学影像的整个价值链,包括图像重建、医学图像分割、基于图像的诊断和治疗计划。尽管人工智能在医学影像领域取得了成功并具有巨大潜力,但许多利益相关者对影像人工智能解决方案的潜在风险和道德影响感到担忧,认为其复杂、不透明,在关键的临床应用中难以理解、利用和信任。尽管有这些担忧和风险,但目前还没有具体的指导方针和最佳做法来指导未来医学影像领域的人工智能发展,以提高信任度、安全性和采用率。为了弥合这一差距,本文介绍了从欧洲五个大型健康影像人工智能项目积累的经验、共识和最佳实践中精心挑选出来的指导原则。这些指导原则被命名为FUTURE-AI,其组成部分包括(i)公平性,(ii)普遍性,(iii)可追溯性,(iv)可用性,(v)稳健性和(vi)可解释性。在一个循序渐进的方法中,这些准则被进一步转化为一个具体的建议框架,用于指定、开发、评估和部署技术上、临床上和道德上值得信赖的人工智能解决方案到临床实践中。

关键词:人工智能,医学影像,可信度,建议,指南

1. 引言

在希望和炒作中,人工智能(AI)被广泛认为是未来医疗领域最有前途和颠覆性的技术之一。由于机器学习技术适合于促进大型复杂数据集的分析,医学影像是过去几年中人工智能发展最多的医学专业[5]。随着大数据和机器学习的出现,医学影像和放射学的整个价值链上都出现了影像人工智能解决方案,包括图像重建[144, 153]、医学图像分割[167, 21]、基于图像的诊断[104, 100]和治疗计划[65, 182]。美国放射学会在线维护的FDA批准的人工智能算法的综合清单也充分说明了该领域的最新发展[7]。

如果得到适当的实施,人工智能有望在未来的医学影像中发挥重要作用,它可以加强医学图像的获取、处理和解释,帮助提取和结合新的信息和影像生物标志物,以加强对病人的评估、预测和决策,从而协助临床医生更有效和更准确地诊断和管理病人。然而,尽管该领域在过去几年中取得了进步和发展,但在临床实践中对影像人工智能技术的采用和部署仍然有限。最近在澳大利亚和新西兰进行的一项临床医生调查显示,虽然绝大多数放射科医生都认为引入人工智能会改善他们的工作,但超过80%的受访者还没有在日常工作中使用人工智能[151]。

同时,许多利益相关者对人工智能在医疗领域的潜在风险、伦理影响和缺乏信任表示担忧,特别是包括医学影像。人工智能工具仍然被视为复杂、不透明的技术,难以被临床医生和患者理解、利用和完全信任[142]。人们担心,当人工智能工具应用于可能与训练条件不同或出乎意料地偏离(哪怕是轻微偏离)的影像条件时,会产生未被发现的错误,给患者带来有害后果。由于现有的影像学数据库通常在性别、种族、地理和社会经济方面是不平衡的,因此存在一种风险,即训练有素的人工智能算法会对代表性不足的群体产生偏见,从而加剧现有的健康差异[157, 85]。还有人担心人工智能工具对经验丰富和经验不足的放射医师的决策和解释技能的影响[132]。

重要的是,目前用于医学影像的人工智能解决方案在开发和验证时,很少有机制能够在其整个部署周期内对其进行监测,定期评估性能的变化,特别是当影像硬件或协议发生变化时,或者随着新的、额外的影像研究和更丰富的数据集的出现,能够持续学习并评估其对人工智能工具的影响。尽管有这些担忧和风险,目前还没有具体的指导方针和最佳做法来指导未来医学影像领域的人工智能发展,以提高信任度、安全性和采用率。欧洲和北美放射学协会最近就放射学中人工智能的伦理挑战发表了一份联合声明,称 "放射学界应从现在开始制定人工智能的伦理和实践准则"[49]。

图1:作者提出的FUTURE-AI指导原则,用于开发、评估和在临床实践中部署可信赖的、安全的和符合道德规范的医学影像AI解决方案。这些指导原则是基于五个大型欧洲医学影像AI实施项目的共识和成熟的最佳实践而定义的。

**本文定义了名为FUTURE-AI的新指导原则,并将其转化为开发未来医学影像领域AI解决方案的具体建议和最佳实践。**建议的指导原则是(i)公平性,(ii)普遍性,(iii)可追溯性,(iv)可用性,(v)稳健性和(vi)可解释性,如图1所示。这些原则以及相关的建议和最佳实践是在五个大型欧洲健康影像人工智能项目(AI4HI网络,包括EuCanImage、PRIMAGE、CHAIMELEON、INCISIVE和ProCancer-I项目)积累的经验和成果基础上确定的。本文所详述的当前建议促进了FUTURE-AI指导原则的应用,并包括一套55个核对点,旨在指导医学影像领域的人工智能设计者、开发者、评估者、最终用户和监管者。以循序渐进的方式,这些指导原则将加强影像人工智能算法的规范、实施、评估和部署,在未来的放射学实践中,这些算法在技术上、临床上和道德上都是值得信赖的。