深度学习已经在多个领域得到了广泛的使用,并取得了令人瞩目的成绩。然而优秀的网络结构设计在很 大程度上仍然依赖于研究者的先验知识和大量的实验验证,整个过程对于人力、算力等资源消耗巨大。因此,能否 让计算机自动地找到最适用于当前任务的神经网络结构成为了当前研究的热点。近年来,研究人员对神经网络结 构搜索(NeuralArchitectureSearch,NAS)进行了各种改进,相关研究工作复杂且丰富。为了让读者对神经网络结 构搜索方法有更清晰的了解,该文从神经网络结构搜索的三个维度:搜索空间、搜索策略和性能评估策略对现有方 法进行了分析,并提出了未来可能的研究方向。

目前,深 度 学 习 已 经 在 机 器 翻 译[1-3]、图 像 识 别[4-6]、语音处理[7-8]等多个领域得到了广泛应用,并 取得了十分优异的成绩。在传统深度学习方法中, 研究人员需要设计大量的特征来描述待解决的问 题,即“特征工程”。而在深度学习时代,神经网络模 型可以完成特征的抽取和学习,但网络结构却需要 人工设计。网络结构设计不仅消耗了大量人力和算 力资源,而且在很大程度上依赖于研究者的先验知 识和经验,由于知识的局限性,很难跳出原有的思维 范式,设计出更优秀的模型。而神经网络结构搜索 是一种让计算机自动地找到最适用于当前任务的神 经网络结构的技术,它的出现将研究人员从设计模 型结构的工作中解放出来。 神经网络结构搜索(NeuralArchitectureSearch), 在神经网络模型中有时也被称作神经网络架构搜索 或简称为网络结构搜索,是自动机器学习中一个必 不可少的环节。20世纪80年代,研究人员已经开 始使用进化算法对神经网络结构进行设计[9],之后 的很多 工 作 也 是 基 于 此 对 网 络 结 构 搜 索 进 行 探 索[10-12]。近些年,随着深度学习技术的发展,网络 结构搜索技术在越来越多任务中受到关注,在图像 分类[13-14]、语义分割[15]、语言建模[16-18]等任务上取 得了很好的结果。

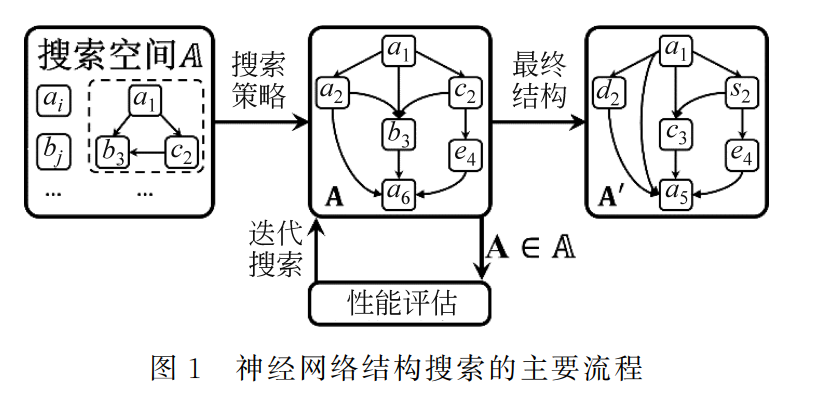

图1展示了神经网络结构搜索方法的主要流 程,其中包括三个主要部分:设计搜索空间、选择搜 索策略以及进行性能评估。