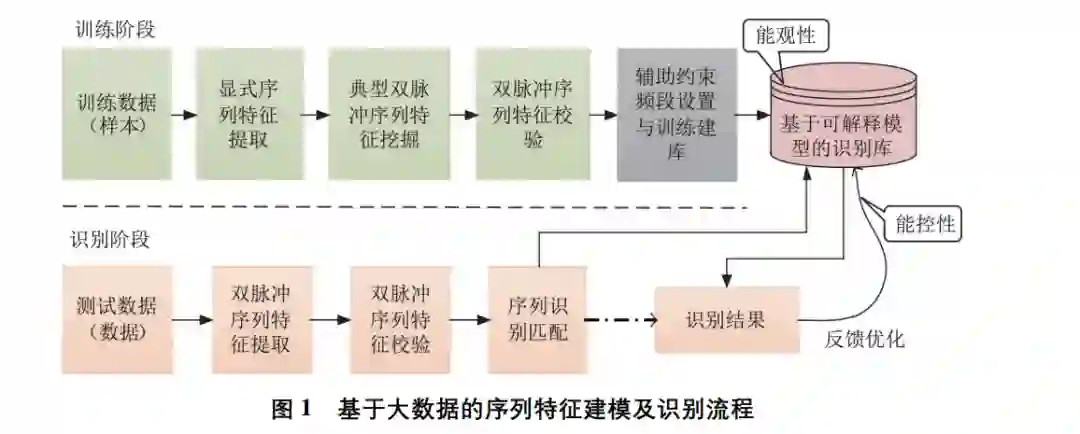

可解释性已成为第三代人工智能的显著特征之一,尤其是反人工智能技术的出现,迫使业 界重新思考人工智能的未来。文中结合电子战面临的现状与挑战,探讨了黑箱模型的困惑、先验知 识的缺位和安全与可信问题,并结合可解释序列特征建模与识别、可解释特征提取与模式识别、基 于知识图谱的子图匹配辨识等初步实践与探索,给出了可解释智能应用思考与建议,旨在为电子战 装备的智能化发展提供技术参考。当前,人工智能( Artificial Intelligence,AI) 日益 成为推动新一轮军事变革的核心驱动力,加速战争 形态向智能化迈进。第一代 AI 以符号主义为核心, 采用物理符号模拟人类认知思维,利用专家知识、算 法,实现了知识驱动的智能; 第二代 AI 以连接主义 为核心,在神经网络中建立“刺激-响应”连接,借助 数据、算法和算力,形成了数据驱动的智能。前两代 AI 从不同侧面刻画人类心智,存在各自的局限性。 第三代 AI 将前两代 AI 相结合,同时利用知识、数 据、算力和算法,建立可解释的 AI 理论方法,实现安 全、可信、可靠的智能应用[1]。 第三代 AI 可解释的最终目的是建立人类对 AI 在认知层面的信任。可解释的内涵包含两方面: 一 是打破黑箱,对智能算法本身的工作机理进行全局 解释; 二是事后剖析,对智能算法的决策结果提供可 理解的局部解释[2]。目前,学术界诸多的军事智能 化研究文献中,较多的关注点仍然是围绕智能算法 的应用适配和效果提升展开,还较少聚焦研究智能 算法在军事应用上的可解释性问题[3-4]。然而对于电磁大数据领域而言,可解释智能应用,才是确保军 事应用安全、可信、鲁棒的根本前提。 本文首先剖析了电子战智能应用的现状和挑 战; 然后,结合可解释脉冲序列特征建模与识别、信 号可解释特征提取与模式识别、知识子图匹配辨识 应用等探索实践情况; 最后,探讨了电子战可解释智 能应用的发展思考与建议,旨在为电子战装备发展 决策、科研工作提供参考。