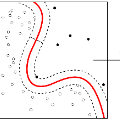

Chest X-ray (CXR) is the most typical radiological exam for diagnosis of various diseases. Due to the expensive and time-consuming annotations, detecting anomalies in CXRs in an unsupervised fashion is very promising. However, almost all of the existing methods consider anomaly detection as a One-Class Classification (OCC) problem. They model the distribution of only known normal images during training and identify the samples not conforming to normal profile as anomalies in the testing phase. A large number of unlabeled images containing anomalies are thus ignored in the training phase, although they are easy to obtain in clinical practice. In this paper, we propose a novel strategy, Dual-distribution Discrepancy for Anomaly Detection (DDAD), utilizing both known normal images and unlabeled images. The proposed method consists of two modules, denoted as A and B. During training, module A takes both known normal and unlabeled images as inputs, capturing anomalous features from unlabeled images in some way, while module B models the distribution of only known normal images. Subsequently, the inter-discrepancy between modules A and B, and intra-discrepancy inside module B are designed as anomaly scores to indicate anomalies. Experiments on three CXR datasets demonstrate that the proposed DDAD achieves consistent, significant gains and outperforms state-of-the-art methods. Code is available at https://github.com/caiyu6666/DDAD.

翻译:切斯特X射线(CXR)是诊断各种疾病的最典型的放射检查;由于昂贵和耗时的注释,发现CXR中异常现象非常有希望;然而,几乎所有现有方法都把异常检测视为单类分类(OCC)问题。它们模拟培训期间仅传播已知的正常图像,并将不符合正常特征的样本作为测试阶段的异常点,因此在培训阶段忽略了大量含有异常点的未贴标签图像,尽管这些图像在临床实践中很容易获得。在本文件中,我们提出了一个新颖战略,即使用已知的正常图像和未贴标签图像来检测非异常点检测(DDDD),使用已知的正常图像和未贴标签图像。拟议方法包括两个模块,即A类和B类。在培训期间,A单元将已知的正常和未贴标签图像作为投入,以某种方式从未贴标签图像中捕捉出异常点特征,而模块B类则只模拟已知的正常图像的分发。随后,A类和B类异点检测模块之间的不易位性(D级)和B类内部的变异性模型显示已设计为稳定的变数。