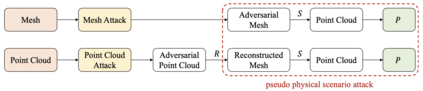

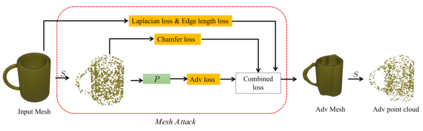

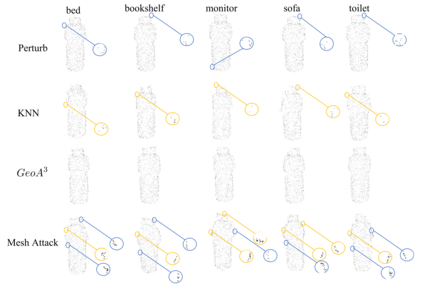

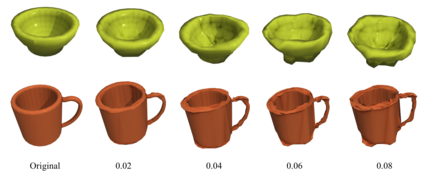

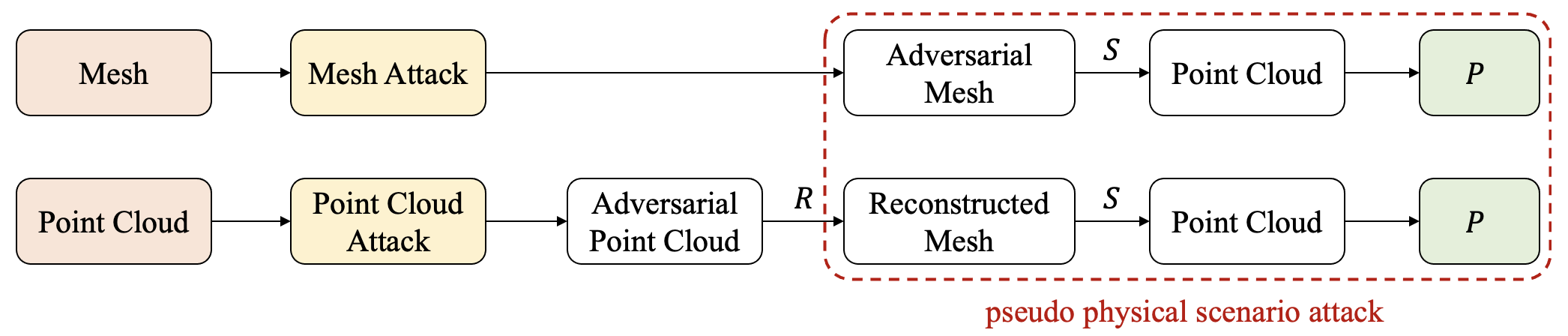

Recently, 3D deep learning models have been shown to be susceptible to adversarial attacks like their 2D counterparts. Most of the state-of-the-art (SOTA) 3D adversarial attacks perform perturbation to 3D point clouds. To reproduce these attacks in pseudo physical scenario, a generated adversarial 3D point cloud need to be reconstructed to mesh, which leads to a significant drop in its adversarial effect. In this paper, we propose a strong 3D adversarial attack named Mesh Attack to address this problem by directly performing perturbation on mesh of a 3D object. Specifically, in each iteration of our method, the mesh is first sampled to point cloud by a differentiable sample module. Then a point cloud classifier is used to back-propagate a combined loss to update the mesh vertices. The combined loss includes an adversarial loss to mislead the point cloud classifier and three mesh losses to regularize the mesh to be smooth. Extensive experiments demonstrate that the proposed scheme outperforms SOTA 3D attacks by a significant margin in the pseudo physical scenario. We also achieved SOTA performance under various defenses. Moreover, to the best of our knowledge, our Mesh Attack is the first attempt of adversarial attack on mesh classifier. Our code is available at: {\footnotesize{\url{https://github.com/cuge1995/Mesh-Attack}}}.

翻译:最近, 3D 深层次的学习模式被证明很容易像 2D 对等方一样受到对抗性攻击。 多数最先进的3D对抗性攻击都具有3D点云层的扰动作用。 要在假物理情景中复制这些攻击, 需要将这些生成的对立3D点云重建成网状, 从而导致对立效应的显著下降。 在本文中, 我们提议3D对抗性攻击名为 Mesh App 的强力3D对抗性攻击来解决这个问题, 直接对3D 对象的网格进行扰动。 具体地说, 在我们的方法的每一次迭代中, 3D 3D 对抗性攻击都是通过一个不同的样板模模块将云点点标出。 然后, 一个点云分解器用来反向阵列一个合并损失来更新网格的脊椎。 合并损失包括误导点云层分类的对抗性损失和三米什 使网格变得平滑。 广泛的实验表明, 拟议的计划比STO 3D 3D 攻击以一个显著的边距, 在假体形的物理情景中, 我们的SATM 尝试在攻击规则下也实现了。