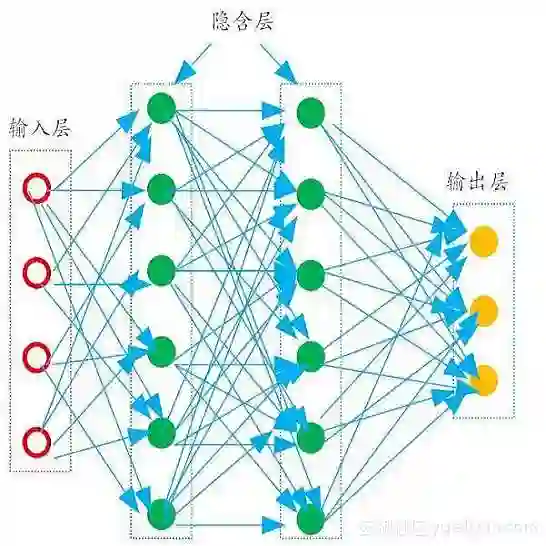

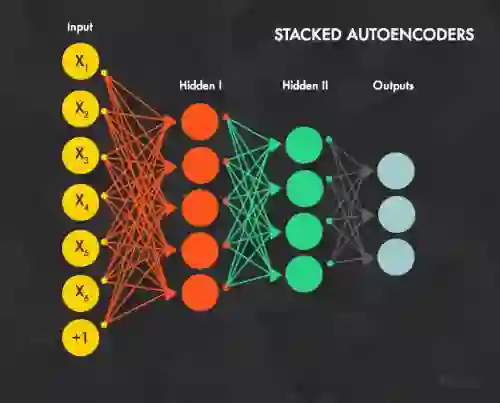

The number of clinical citations received from clinical guidelines or clinical trials has been considered as one of the most appropriate indicators for quantifying the clinical impact of biomedical papers. Therefore, the early prediction of the clinical citation count of biomedical papers is critical to scientific activities in biomedicine, such as research evaluation, resource allocation, and clinical translation. In this study, we designed a four-layer multilayer perceptron neural network (MPNN) model to predict the clinical citation count of biomedical papers in the future by using 9,822,620 biomedical papers published from 1985 to 2005. We extracted ninety-one paper features from three dimensions as the input of the model, including twenty-one features in the paper dimension, thirty-five in the reference dimension, and thirty-five in the citing paper dimension. In each dimension, the features can be classified into three categories, i.e., the citation-related features, the clinical translation-related features, and the topic-related features. Besides, in the paper dimension, we also considered the features that have previously been demonstrated to be related to the citation counts of research papers. The results showed that the proposed MPNN model outperformed the other five baseline models, and the features in the reference dimension were the most important.

翻译:从临床准则或临床试验中获得的临床引文数量被认为是量化生物医学论文临床影响的最适当指标之一,因此,及早预测生物医学论文的临床引证数量对于生物医学的科学活动至关重要,如研究评价、资源分配和临床翻译等;在本研究中,我们设计了一个四层多层多层透视神经网络(MPNNN)模型,用1985年至2005年出版的9 822 620份生物医学论文来预测今后生物医学论文的临床引文数量;我们从三个方面提取了91个文件特征,作为模型的投入,包括论文层面的21个特征、参考层面的35个特征和引用的论文层面的35个特征;在每一个方面,这些特征可以分为三类,即与引文有关的特征、临床翻译相关特征和专题相关特征;此外,在文件层面,我们还考虑了以前证明与研究论文引文相关的特征。结果显示,拟议的MPNNN模型在五个基准层面中超越了其他重要要素。