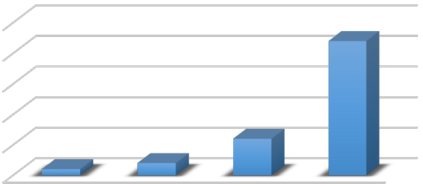

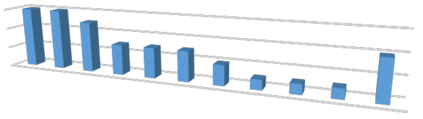

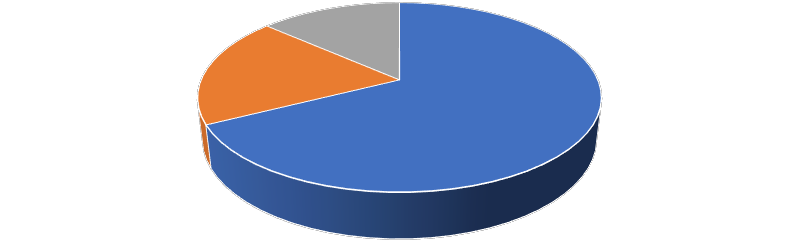

A state-of-the-art systematic review on XAI applied to Prognostic and Health Management (PHM) of industrial asset is presented. The work attempts to provide an overview of the general trend of XAI in PHM, answers the question of accuracy versus explainability, investigates the extent of human role, explainability evaluation and uncertainty management in PHM XAI. Research articles linked to PHM XAI, in English language, from 2015 to 2021 are selected from IEEE Xplore, ScienceDirect, SpringerLink, ACM Digital Library and Scopus databases using PRISMA guidelines. Data was extracted from 35 selected articles and examined using MS. Excel. Several findings were synthesized. Firstly, while the discipline is still young, the analysis indicates the growing acceptance of XAI in PHM domain. Secondly, XAI functions as a double edge sword, where it is assimilated as a tool to execute PHM tasks as well as a mean of explanation, in particular in diagnostic and anomaly detection. There is thus a need for XAI in PHM. Thirdly, the review shows that PHM XAI papers produce either good or excellent results in general, suggesting that PHM performance is unaffected by XAI. Fourthly, human role, explainability metrics and uncertainty management are areas requiring further attention by the PHM community. Adequate explainability metrics to cater for PHM need are urgently needed. Finally, most case study featured on the accepted articles are based on real, indicating that available AI and XAI approaches are equipped to solve complex real-world challenges, increasing the confidence of AI model adoption in the industry. This work is funded by the Universiti Teknologi Petronas Foundation.

翻译:对工业资产的预测和健康管理(PHM)应用到工业资产的预测和健康管理(PHM)的XAI进行最先进的系统审查; 试图对工业资产的预测和健康管理(PHM)中XAI的总体趋势提供概览,回答准确性和可解释性的问题,调查人的作用范围,在PHM XAI中进行可解释性评估和不确定性管理; 2015年至2021年,与PHM XAI(英语)有关的研究文章选自IEEE Xplore、ScienceDirect、SpringerLink、ACM数字图书馆和SCopus数据库(PHMMA准则)。 数据取自35个选定的文章,并用MS.Excel进行了审查。 综合了一些结论。 首先,虽然纪律还很年轻,分析表明XAI在PHM领域日益被接受。 其次,XAI作为执行PHM任务的一种工具,特别是诊断和异常现象检测。 因此,在PHM公司中,XAI的模型研究是现有的方法。 第三,审查表明,PHI XAI文件产生最良好或极可靠的可信任性,最后表明需要企业公司的正确性业绩。