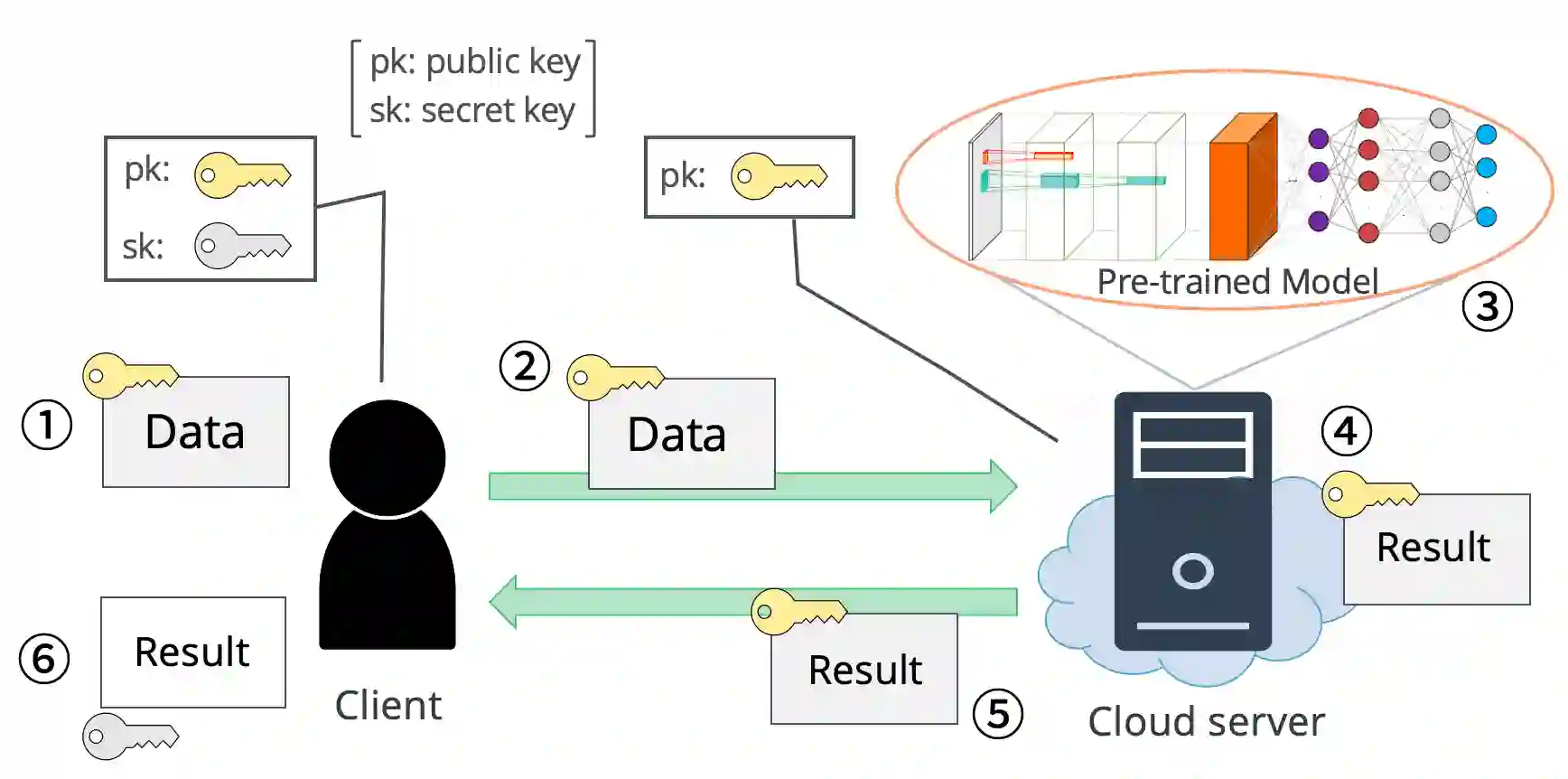

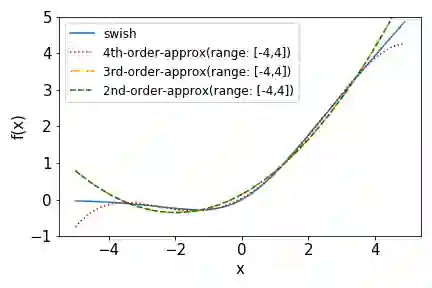

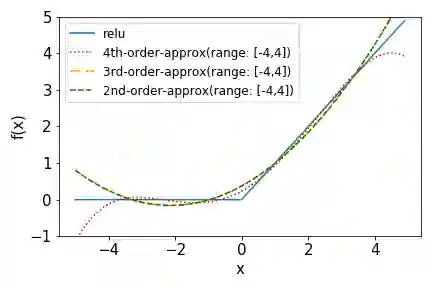

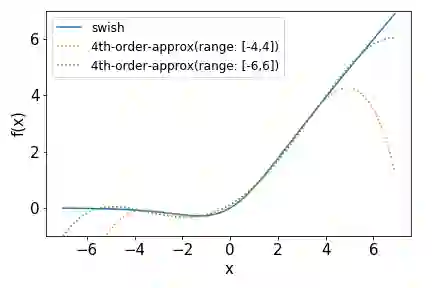

In the big data era, cloud-based machine learning as a service (MLaaS) has attracted considerable attention. However, when handling sensitive data, such as financial and medical data, a privacy issue emerges, because the cloud server can access clients' raw data. A common method of handling sensitive data in the cloud uses homomorphic encryption, which allows computation over encrypted data without decryption. Previous research usually adopted a low-degree polynomial mapping function, such as the square function, for data classification. However, this technique results in low classification accuracy. In this study, we seek to improve the classification accuracy for inference processing in a convolutional neural network (CNN) while using homomorphic encryption. We adopt an activation function that approximates Google's Swish activation function while using a fourth-order polynomial. We also adopt batch normalization to normalize the inputs for the Swish function to fit the input range to minimize the error. We implemented CNN inference labeling over homomorphic encryption using the Microsoft's Simple Encrypted Arithmetic Library for the Cheon-Kim-Kim-Song (CKKS) scheme. The experimental evaluations confirmed classification accuracies of 99.22% and 80.48% for MNIST and CIFAR-10, respectively, which entails 0.04% and 4.11% improvements, respectively, over previous methods.

翻译:在大数据时代,基于云的机器学习作为一种服务(MLaaaS)吸引了相当多的注意力。然而,当处理财务和医疗数据等敏感数据时,出现了隐私问题,因为云服务器可以访问客户的原始数据。云中处理敏感数据的常见方法是同色加密,这样可以对加密的数据进行计算,而无需解密。以前的研究通常采用低度多元绘图功能,如平方函数,用于数据分类。然而,这种技术导致分类准确性低。在本研究中,我们力求在使用同质加密的同时,提高在动态神经网络(CNN)中进行感知处理的分类准确性。我们采用了一种激活功能,在使用第四阶调多元加密的同时,接近谷歌的感应激活功能。我们还采用批次的正常化程序,使Swish功能的投入与输入范围相匹配,以尽量减少错误。我们实施了CNNFN的推论,用微软的简单加密智能图书馆,使用同质神经神经网络(CNN)处理,同时使用同性神经神经网络(CNN)处理,同时使用同质加密加密加密加密加密加密加密加密加密,同时使用同性加密加密加密加密加密加密加密加密加密加密加密加密加密加密系统。我们采用了0KIM-KIM-K-Ky-K48-S-Squrmac-22-Sc-40和CMMLMLMLMLML%C-C-C-C-40-C-C-C-CMC-CMISMLMISC-C-C-C-C-C-CMIS-C-C-C-C-C-CMIS-C-C-C-C-CMIS-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-CMIS-CMIS-CMIS-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-C-CMIS-MIS-C-C-C-C-C-C-C-C-C-