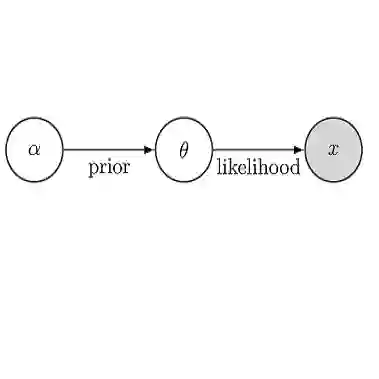

We consider problems of parameter estimation where design variables can be actively optimized to maximize information gain. To this end, we introduce JADAI, a framework that jointly amortizes Bayesian adaptive design and inference by training a policy, a history network, and an inference network end-to-end. The networks minimize a generic loss that aggregates incremental reductions in posterior error along experimental sequences. Inference networks are instantiated with diffusion-based posterior estimators that can approximate high-dimensional and multimodal posteriors at every experimental step. Across standard adaptive design benchmarks, JADAI achieves superior or competitive performance.

翻译:我们研究在参数估计问题中,设计变量可被主动优化以最大化信息增益的场景。为此,我们提出JADAI框架,通过端到端训练策略网络、历史网络与推断网络,实现贝叶斯自适应设计与推断的联合摊销。这些网络通过最小化一个通用损失函数来优化,该函数聚合了实验序列中后验误差的逐步减少量。推断网络采用基于扩散过程的后验估计器实现,能够在每个实验步骤中近似高维、多峰的后验分布。在标准自适应设计基准测试中,JADAI取得了优越或具有竞争力的性能。