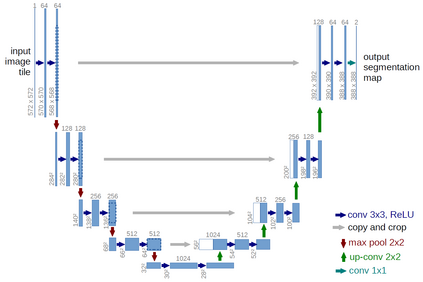

We propose a method to accurately obtain the ratio of tumor cells over an entire histological slide. We use deep fully convolutional neural network models trained to detect and classify cells on images of H&E-stained tissue sections. Pathologists' labels consisting of exhaustive nuclei locations and tumor regions were used to trained the model in a supervised fashion. We show that combining two models, each working at a different magnification allows the system to capture both cell-level details and surrounding context to enable successful detection and classification of cells as either tumor-cell or normal-cell. Indeed, by conditioning the classification of a single cell on a multi-scale context information, our models mimic the process used by pathologists who assess cell neoplasticity and tumor extent at different microscope magnifications. The ratio of tumor cells can then be readily obtained by counting the number of cells in each class. To analyze an entire slide, we split it into multiple tiles that can be processed in parallel. The overall tumor cell ratio can then be aggregated. We perform experiments on a dataset of 100 slides with lung tumor specimens from both resection and tissue micro-array (TMA). We train fully-convolutional models using heavy data augmentation and batch normalization. On an unseen test set, we obtain an average mean absolute error on predicting the tumor cell ratio of less than 6%, which is significantly better than the human average of 20% and is key in properly selecting tissue samples for recent genetic panel tests geared at prescribing targeted cancer drugs. We perform ablation studies to show the importance of training two models at different magnifications and to justify the choice of some parameters, such as the size of the receptive field.

翻译:我们建议了一种方法来精确地获得肿瘤细胞在整个组织学幻灯片中的比例。 我们使用深层的进化神经网络模型来检测和分类H&E沾染组织部分图像中的细胞。 病理学家的标签包括详尽的核位置和肿瘤区域,用来以监督的方式对模型进行训练。 我们显示,将两种模型结合起来,每个模型在不同的放大度下工作,可以同时捕捉细胞层的细节和周围环境,以便能够成功地检测和分类细胞,无论是肿瘤细胞还是正常细胞。 事实上,我们用多种规模的背景信息来调整单细胞的分类,我们的模型模拟了在不同的显微镜放大度中评估细胞神经肿瘤程度和肿瘤程度的病理学家所使用的过程。 然后,通过计算每类中的细胞数量就可以很容易地获得肿瘤细胞细胞的比例。 为了分析整个幻灯片,我们将其分成多个小小的细胞,可以同时处理。 肿瘤细胞的总比率可以进行综合。 我们用一个100个幻灯片的实验, 与6个剖面和组织的肿瘤标定值的分类, 我们用一个精确的直径的直径, 我们用一个精确的精度的精度的精确度的精确度模型来测试, 我们用一个更精确的精确的精确的精确的精确的精确的精确的模型来测试, 。