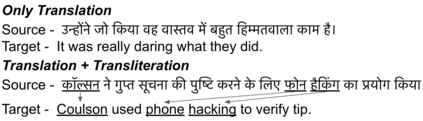

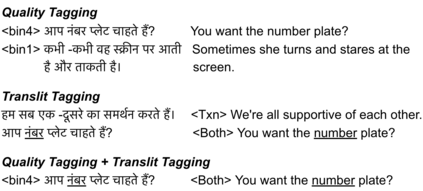

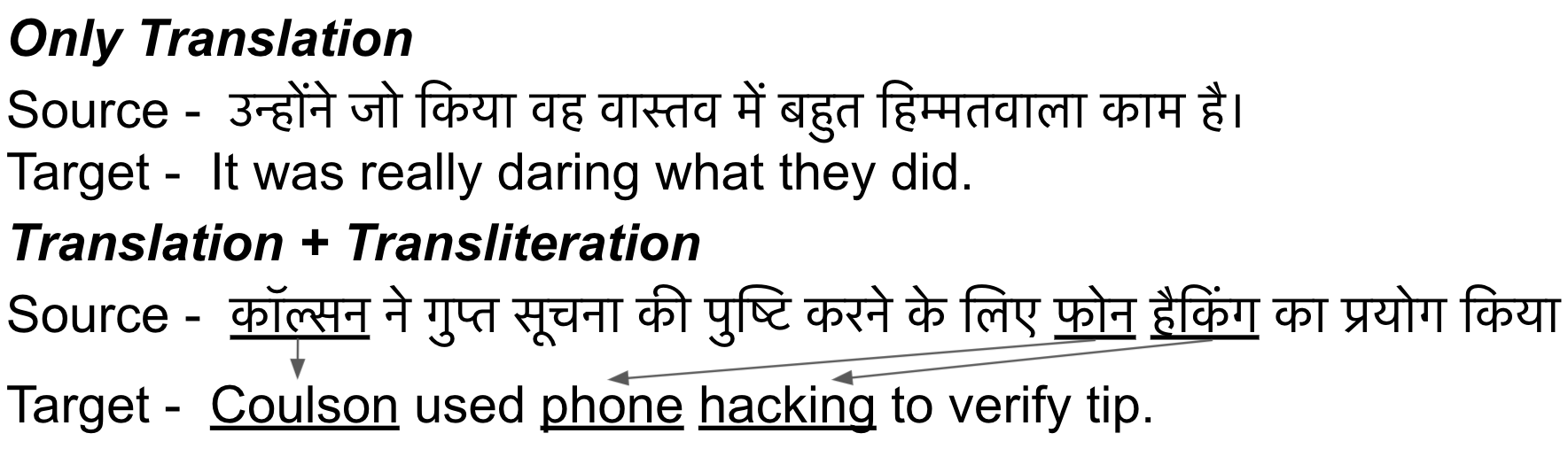

Back-translation (BT) of target monolingual corpora is a widely used data augmentation strategy for neural machine translation (NMT), especially for low-resource language pairs. To improve effectiveness of the available BT data, we introduce HintedBT -- a family of techniques which provides hints (through tags) to the encoder and decoder. First, we propose a novel method of using both high and low quality BT data by providing hints (as source tags on the encoder) to the model about the quality of each source-target pair. We don't filter out low quality data but instead show that these hints enable the model to learn effectively from noisy data. Second, we address the problem of predicting whether a source token needs to be translated or transliterated to the target language, which is common in cross-script translation tasks (i.e., where source and target do not share the written script). For such cases, we propose training the model with additional hints (as target tags on the decoder) that provide information about the operation required on the source (translation or both translation and transliteration). We conduct experiments and detailed analyses on standard WMT benchmarks for three cross-script low/medium-resource language pairs: {Hindi,Gujarati,Tamil}-to-English. Our methods compare favorably with five strong and well established baselines. We show that using these hints, both separately and together, significantly improves translation quality and leads to state-of-the-art performance in all three language pairs in corresponding bilingual settings.

翻译:目标单语言的单语子的回译( BT) 是广泛使用的神经机翻译( NMT) 的数据增强策略, 特别是低资源语言对配。 为了提高可用 BT 数据的有效性, 我们引入 HintedBT -- -- 向编码器和解码器提供提示( 通过标签) 的技术系列。 首先, 我们提出一种新型方法, 通过向模型提供提示( 作为编码器上的源标签 ) 来使用高和低质量 BT 数据。 我们不过滤低质量数据, 而是显示这些提示使模型能够有效地从杂音数据中学习。 其次, 我们解决了预测一个源符号是否需要被翻译或转译到目标语言的一组技术问题, 这在交叉描述翻译任务( 即, 源和目标并不分享书面脚本 ) 中是常见的 。 对于这种情况, 我们建议对模型进行额外的提示( 作为解码配对的标值), 我们建议用额外的提示来提供有关源操作的信息( 透明或纸质地 ), 三个精确的翻译和跨语言的校程 分析 。