北大提出PKU FG-XMedia:细粒度跨媒体检索数据集和评测基准

机器之心发布

作者:Xiangteng He、Yuxin Peng、Liu Xie

北京大学彭宇新教授团队建立了第一个包含 4 种媒体类型(图像、文本、视频和音频)的细粒度跨媒体检索公开数据集和评测基准 PKU FG-XMedia,并且提出了一种能够同时学习 4 种媒体统一表征的深度网络模型 FGCrossNet。该论文已经被 CCF A 类国际会议 ACM MM 2019 大会接收。

-

本文链接:https://arxiv.org/abs/1907.04476

-

数据集链接:http://59.108.48.34/tiki/FGCrossNet -

源码和模型链接:https://github.com/PKU-ICST-MIPL/FGCrossNet_ACMMM2019 -

课题组主页: http://www.wict.pku.edu.cn/mipl -

课题组 Github 主页: https://github.com/PKU-ICST-MIPL

缺乏数据集和评测基准:现有跨媒体数据集一般是针对粗粒度跨媒体检索,而细粒度跨媒体检索还缺乏数据集和评测基准,因此相关研究比较少。

异构鸿沟:这是跨媒体检索面临的经典难题,是指不同媒体类型的数据有着不同的分布和特征表示,导致跨媒体检索十分困难,对细粒度跨媒体检索更是难上加难。

类间差异小,类内差异大:这是细粒度分类面临的挑战。其中,类间差异小是指不同的细粒度类别具有相似的外表(图像、视频)、描述(文本)和声音(音频);类内差异大是指由于视角、光照、描述、背景等不同,相同的细粒度类别又存在外表、描述和声音差异大的现象。上述问题导致难以准确检索特定细粒度类别的媒体数据,相比粗粒度跨媒体检索更具挑战。

建立了细粒度跨媒体检索的公开数据集和评测基准 PKU FG-XMedia;

提出了能够同时学习 4 种媒体统一表征的深度网络模型 FGCrossNet。

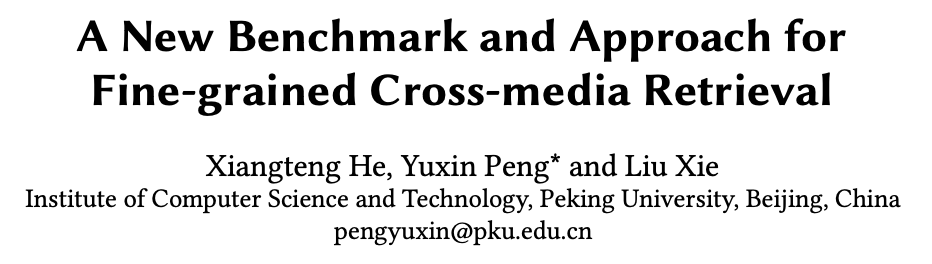

图 1:粗粒度跨媒体检索与细粒度跨媒体检索的区别

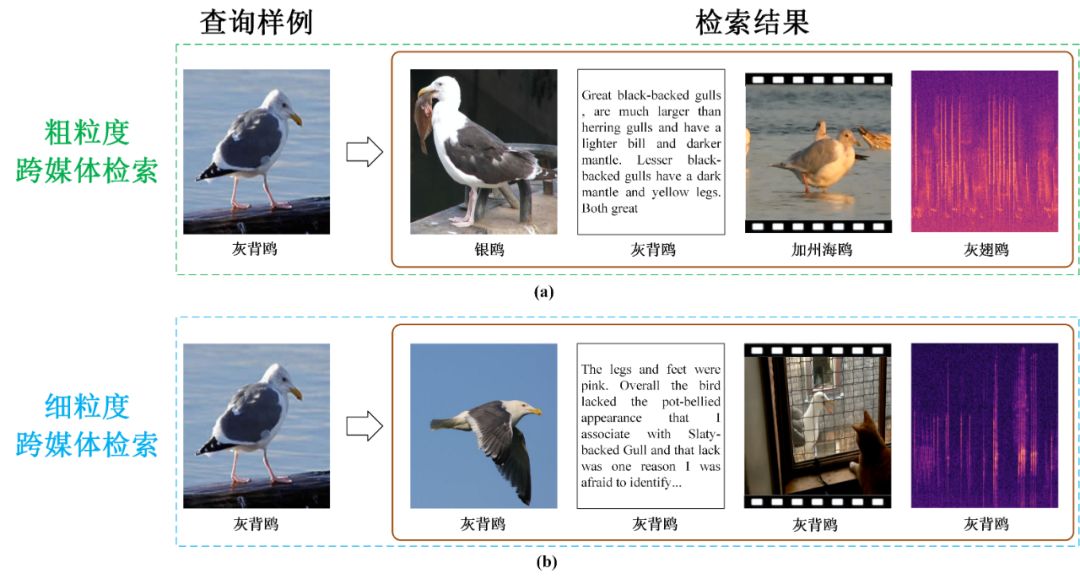

图 2:PKU FG-XMedia 数据集中的样例,如图展示了 7 种细粒度类别的图像、文本、视频和音频数据,其中音频数据用声谱图可视化。

媒体类型多:包含图像、文本、视频和音频 4 种媒体类型;

类别细粒度:包括鸟的 200 个细粒度类别,如灰背鸥、银鸥、加州海鸥和灰翅鸥等;

数据来源多:数据来源于不同的网站,导致数据质量不同,因此增加了检索的难度。

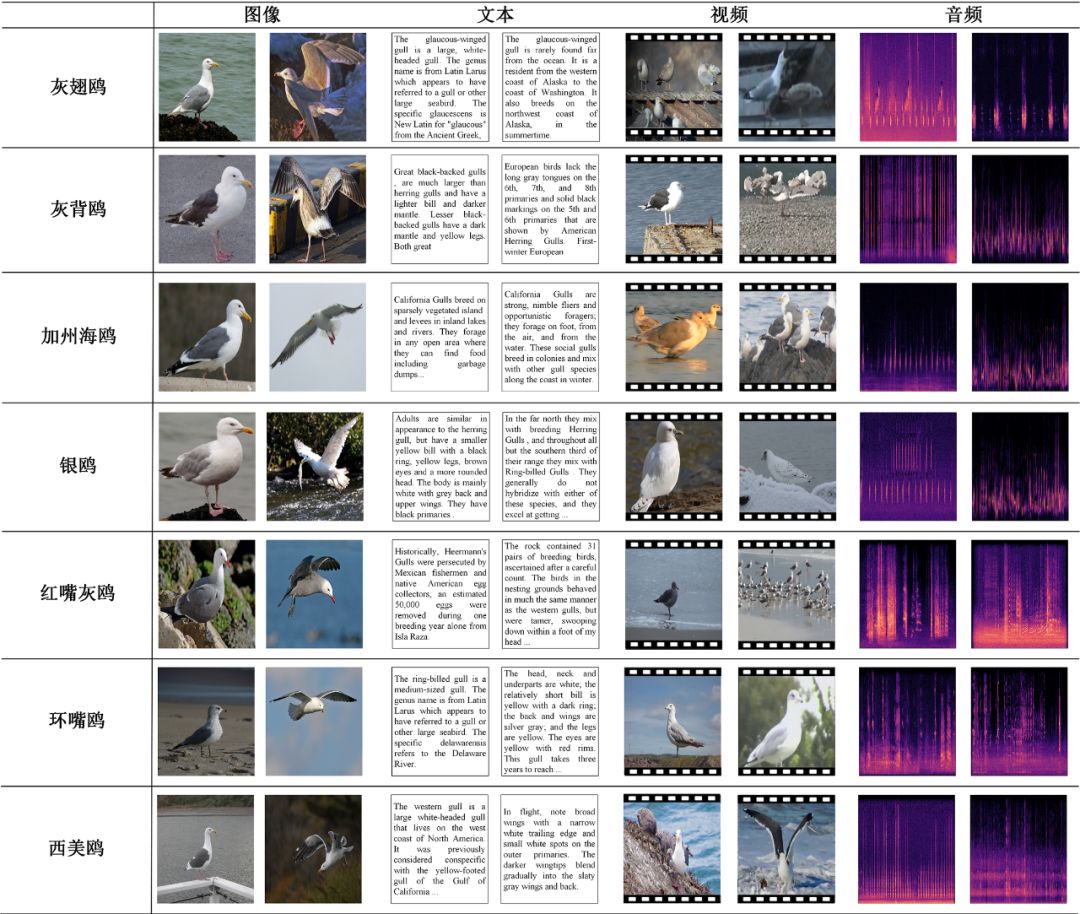

图 3:FGCrossNet 网络框架

分类约束(Classification Constraint):确保细粒度类别统一表征的辨识性;

中心约束(Center Constraint):确保相同细粒度类别统一表征的紧凑性;

排序约束(Ranking Constraint):确保不同细粒度类别统一表征的松散性。

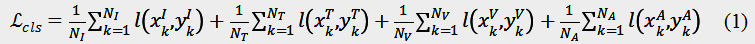

是交叉损失函数,I,T,V,A 分别表示图像、文本、视频和音频。

以图像为例,

是交叉损失函数,I,T,V,A 分别表示图像、文本、视频和音频。

以图像为例,

表示训练集中图像的数目,

表示训练集中图像的数目,

表示第 k 个图像样本的类别标签,

表示第 k 个图像样本的类别标签,

表示第 k 个图像样本的特征向量,在本文实验中为 FGCrossNet 网络模型最后一层全连接层的输出。

需要注意的是,本文采用视频帧进行网络模型的训练,因此

表示第 k 个图像样本的特征向量,在本文实验中为 FGCrossNet 网络模型最后一层全连接层的输出。

需要注意的是,本文采用视频帧进行网络模型的训练,因此

表示的是训练集中视频帧的数目。

表示的是训练集中视频帧的数目。

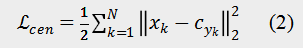

表示训练集中第 k 个样本的特征,在这里不区分媒体类型,因为目的是使得相同细粒度子类别的所有媒体数据的特征相近。

表示训练集中第 k 个样本的特征,在这里不区分媒体类型,因为目的是使得相同细粒度子类别的所有媒体数据的特征相近。

表

示

表

示

细粒度子类别的质心的特征,N 表示训练集中所有训练样本的数目。

细粒度子类别的质心的特征,N 表示训练集中所有训练样本的数目。

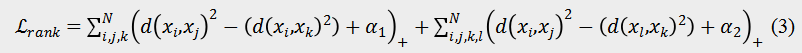

和

和

表示边界阈值用于平衡公式(3)

中的两项。

需要注意的是,在一次训练过程中,网络模型同时接收 4 种媒体的训练样本,且其中两个样本属于相同细粒度子类别,另外两个样本属于其他两个细粒度子类别。

表示边界阈值用于平衡公式(3)

中的两项。

需要注意的是,在一次训练过程中,网络模型同时接收 4 种媒体的训练样本,且其中两个样本属于相同细粒度子类别,另外两个样本属于其他两个细粒度子类别。

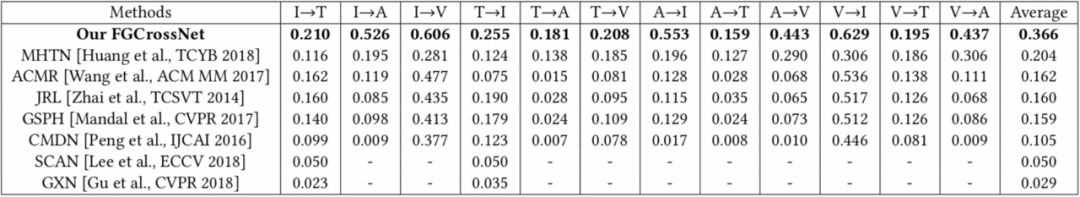

双模态细粒度跨媒体检索(Bi-modality Fine-grained Cross-media Retrieval):查询样例是任意一种媒体数据,检索结果是另外一种媒体数据,表示为 X→Y,其中 X,Y 分别为两种不同的媒体数据。例如,I→T 表示图像检索文本。

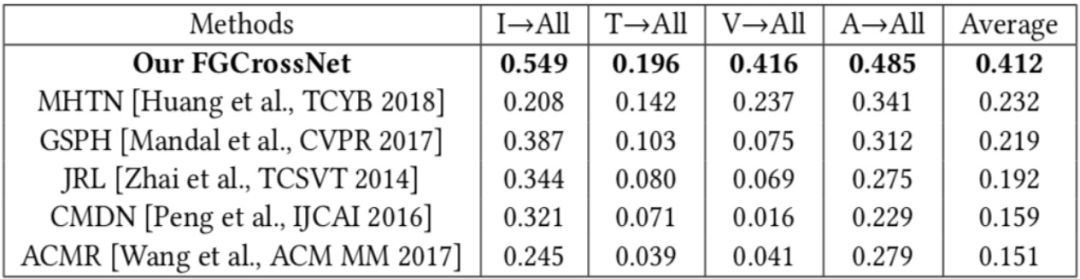

多模态细粒度跨媒体检索(Multi-modality Fine-grained Cross-media Retrieval:):查询样例是任意一种媒体数据,检索结果是 4 种媒体数据,表示为 X→All。例如,I→All 表示图像检索图像、文本、视频和音频 4 种媒体数据。

表 1:本文方法和现有方法在双模态细粒度跨媒体检索任务上的检索准确率(MAP)。

www.jiqizhixin.com/sota

PC 访问,体验更佳