知识图谱可解释推理研究综述

面向知识图谱的知识推理旨在通过已有的知识图谱事实,去推断新的事实,进而实现知识库的补全。近年来,尽管基于分布式表示学习的方法在推理任务上取得了巨大的成功,但是他们的黑盒属性使得模型无法为预测出的事实做出解释。所以,如何设计用户可理解、可信赖的推理模型成为了人们关注的问题。本文从可解释性的基本概念出发,系统梳理了面向知识图谱的可解释知识推理的相关工作,具体介绍了事前可解释推理模型和事后可解释推理模型的研究进展;根据可解释范围的大小,本文将事前可解释推理模型进一步细分为全局可解释的推理和局部可解释的推理;在事后解释模型中,本文回顾了推理模型的代表方法,并详细介绍提供事后解释的两类解释方法。此外,本文还总结了可解释知识推理在医疗、金融领域的应用。随后,本文对可解释知识推理的现状进行概述,最后展望了可解释知识推理的未来发展方向,以期进一步推动可解释推理的发展和应用。

http://www.jos.org.cn/jos/article/abstract/6522

知识图谱(Knowledge Graph)本质是一种语义网络,通常用 (头实体,关系,尾实体)/ ( ,r, t) h 这样 的三元组来表达事物属性以及事物之间的语义关系。自谷歌提出知识图谱概念以来,知识图谱已经为智能 问答、对话生成、个性化推荐等多个 NLP 任务领域提供了有力支撑。虽然目前的知识图谱中存在大量的实 体和事实数据,但是这样大规模的数据仍然不完整,大量缺失的三元组严重限制了这些下游任务的性能。知识推理,这一旨在根据一定的推理机制去预测图谱中缺失三元组的任务,也吸引了学术界越来越多的目 光。

早在 2013 年,Li 等人[1] 提出利用表示学习的方法去做知识推理,通过将实体和关系映射到低维连续 的向量空间,将推理预测任务转化为实体与关系所关联的简单的向量/矩阵操作。鉴于该方法的自由度高、 可计算性好、推理效率高等优点,该类方法在近几年得到了广泛关注和发展,并且广泛的应用在推荐系统、 对话生成等互联网场景。在这些场景下,研究者们更多的关注如何提高知识推理的性能,忽略知识推理发 生错误时的风险问题。即便推理模型在这些场景下产生错误推理时,通常来说,并不会招致非常严重的后果。然而,在当今人工智能技术应用的大趋势下,知识推理不仅可以应用在上述互联网场景,而且越来越 多的被应用在和人类的生产生活息息相关的一些领域(例如,智能医疗[98,99,100]、军事[112] 、金融[90,111]、交 通运输[113,114]),这些领域往往对模型的安全性能要求较高,风险高度敏感。例如,在医疗领域,推理的可 靠性会关系到人的生命安全。通常来说,在这些领域,仅仅获得预测结果是不够的,模型还必须解释是怎 么获得这个预测的,来建立用户和推理模型之间的信任。

随着深度学习的发展,知识推理方法的模型结构越来越复杂,仅仅一个网络就可能包含几百个神经元、 百万个参数。尽管这些推理模型在速度、稳定性、可移植性、准确性等诸多方面优于人类,但由于用户无 法对这类模型里的参数、结构、特征产生直观理解,对于模型的决策过程和模型的推理依据知之甚少,对 于模型的决策过程知之甚少,不知道它何时会出现错误,在风险敏感的领域中,用户仍然无法信任模型的 预测结果。因此,为了建立用户和推理模型之间的信任,平衡模型准确率和可解释性之间的矛盾,可解释 性知识推理在近几年的科研会议上成为关注热点。

尽管有很多学者对知识推理领域进行了深入的研究,并从不同的角度(如分布式表示角度[120] 、图神 经网络角度[121] 、神经-符号角度[119] 等)对推理模型进行梳理和总结。然而,在推理模型的可解释性方面 却缺少深入的对比和总结。为了促进可解释知识推理的研究与发展,本文对现有的可解释推理模型进行了 系统梳理、总结和展望。本文首先阐述可解释性的定义和可解释性在推理任务中的必要性,并介绍常见的 可解释模型划分标准;然后,根据解释产生的方式,对现有的可解释知识推理模型进行总结和归类,并讨 论相关方法的局限性;接着,简单介绍可解释知识推理在金融领域和医疗领域的应用。最后,本文讨论可 解释知识推理面临的挑战以及可能的研究方向。

1 可解释的知识推理

在详细介绍现有的可解释知识推理模型之前,首先介绍知识推理的基本概念,接着对什么是可解释性 (Interpretability),以及为什么要在推理任务中注重可解释性进行介绍,最后对本文的划分标准做简要说明。

1.1 知识推理的基本概念

2012 年,谷歌正式提出知识图谱的概念,用于改善自身的搜索质量。知识图谱通常用 ( ,r, t) h 这样 的三元组表达实体及其实体之间的语义关系,其中 h 代表头实体, r 代表实体之间的关系, t 代表尾实体。例如(詹姆斯·卡梅隆,执导,泰坦尼克号)即是一个三元组,其中头实体和尾实体分别为“詹姆斯·卡梅隆” 和“泰坦尼克号”,“执导”是两个实体之间的关系。代表性的知识图谱,如 DBpedia[108] 、Freebase[53] 、 Wikidata[55] 、YAGO[107] 等,虽然包含数以亿计的三元组,但是却面临非常严重的数据缺失问题。据 2014 年的统计,在 Freebase 知识库中,有 75%的人没有国籍信息,DBpedia 中 60% 的人缺少没有出生地信息 [125] 。知识图谱的不完整性严重制约了知识图谱在下游任务中的效能发挥。因此,如何让机器自动基于知 识图谱中的已有知识进行推理,从而补全和完善知识图谱,成为了工业界和学术界都亟待解决的问题。

总的来说,面向知识图谱的知识推理实质上是指利用机器学习或深度学习的方法,根据知识图谱中已 有的三元组去推理出缺失的三元组,从而对知识图谱进行补充和完善。例如,已知(詹姆斯·卡梅隆,执导, 泰坦尼克号)和(莱昂纳多·迪卡普里奥,出演,泰坦尼克号),可以得到(詹姆斯·卡梅隆,合作,莱昂纳 多·迪卡普里奥)。知识推理主要包含知识图谱去噪[12] 和知识图谱补全(又称之为链接预测)[1,27,94,95]两个 任务[117] ,其中,知识图谱去噪任务专注于知识图谱内部已有三元组正确性的判断;而知识图谱补全专注 于扩充现有的图谱。根据要推理元素的不同,知识图谱补全任务可以进一步细分为实体预测和关系预测。其中,实体预测是指给定查询 ( ,r,?) h ,利用已有事实的关系,推理出另一个实体并由此构成完整三元组, 同理,关系预测则是指给定查询 ( ,?, t) h ,推理给定的头尾实体之间的关系。由于知识图谱中大多数三元组 都是正确的,知识图谱去噪任务通常采用对已有三元组进行联合建模并进一步判断特定三元组是否成立的 方法。在这种情况下,知识图谱补全任务可以转化为知识图谱去噪任务[123,124]。为此,在下面的内容里,本 文以知识图谱补全任务为中心,对相关的可解释性方法进行梳理和总结。

1.2 可解释性及其在知识推理中的必要性

目前学术界和工业界对于可解释性没有明确的数学定义[62] ,不同的研究者解决问题的角度不同,为 可解释性赋予的涵义也不同,所提出的可解释性方法也各有侧重。目前被广泛接受的一种定义由 Miller (2017)[2,42]所提出,指可解释性是人们能够理解决策原因的程度。如果一个模型比另一个模型的决策过程 更简单、明了、易于理解,那么它就比另一个模型具有更高的可解释性。

在某些情况下,我们不必关心模型为什么做出这样的预测,因为它们是在低风险的环境中使用的,这 意味着错误不会造成严重后果(例如,电影推荐系统),但是对于某些问题或任务,仅仅获得预测结果是 不够的。该模型还必须解释是怎么获得这个预测的,因为正确的预测只部分地解决了原始问题。通常来说, 以下三点原因推动了对可解释性的需求:

1、高可靠性要求。尽管可解释性对于一些系统来说并不是不可或缺的,但是,对于某些需要高度可靠 的预测系统来说很重要,因为错误可能会导致灾难性的结果(例如,人的生命、重大的经济损失)。可解释性可以使潜在的错误更容易被检测到,避免严重的后果。此外,它可以帮助工程师查明根 本原因并相应地提供修复。可解释性不会使模型更可靠或其性能更好,但它是构建高度可靠系统 的重要组成部分。

2、道德和法律要求。第一个要求是检测算法歧视。由于机器学习技术的性质,经过训练的深度神经网 络可能会继承训练集中的偏差,这有时很难被注意到。在我们的日常生活中使用 DNN 时存在公 平性问题,例如抵押资格、信用和保险风险评估。人们要求算法能够解释作出特定预测或判断的 原因,希望模型的解释能够使“算法歧视”的受害者诉诸人权。此外,推理模型目前也被用于新 药的发现和设计[124] 。在药物设计领域,除了临床测试结果以外,新药还需要通常还需要支持结 果的生物学机制,需要具备可解释性才能获得监管机构的批准,例如国家药品监督管理局 (NMPA)。

3、科学发现的要求。推理模型本身应该成为知识的来源,可解释性使提取模型捕获的这些额外知识成 为可能。当深度网络达到比旧模型更好的性能时,它们一定发现了一些未知的“知识”。可解释性 是揭示这些知识的一种方式。

1.3 本文的划分标准

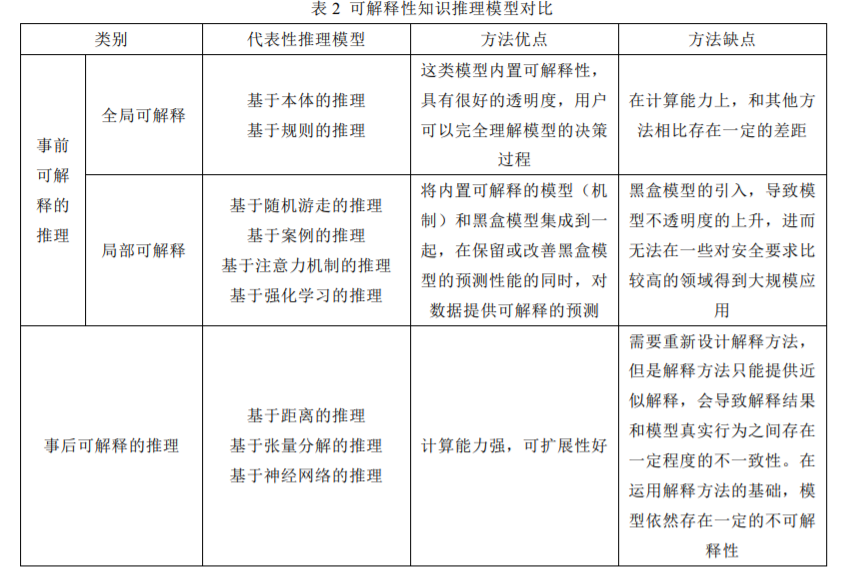

根据不同的划分标准,知识推理模型可以被划分成不同的类别。其中,根据解释产生的方法,可以将 推理模型划分为两大类:事前可解释和事后可解释[41,62,96,97,102,118]。其中,事前可解释模型主要指不需要额 外的解释方法,解释蕴含在自身架构之中的模型。事后可解释性是指模型训练后运用解释方法进行推理过 程和推理结果的解释,解释方法自身是不包含在模型里面的。一种方法被看作能够对黑盒模型进行解释, 是指该方法可以:(1)通过可解释和透明的模型(例如,浅决策树、规则列表或者稀疏线性模型)对模型 的行为进行近似,可以为模型提供全局的可解释;(2)能够解释模型在特定输入样例上进行预测的原因;(3)可以对模型进行内部检查,了解模型的某些特定属性,譬如模型敏感性或深度学习中神经元在某一特 定决策中起到的作用[41] 。值得注意的是,可以将事后解释方法应用于事前可解释的模型上,例如,可以 从敏感性分析的角度对事前模型进行剖析。此外,根据可解释的范围大小----是否解释单个实例预测或整个 模型行为,可以将模型划分为局部可解释和全局可解释两大类[97,96];根据解释方法是否特定于模型,可以 将模型划分为特定于模型和模型无关两种类别[96] 。在接下来的内容里,本文按照解释产生的方式,对知 识推理模型进行总结和归类。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“KGER” 就可以获取《知识图谱可解释推理研究综述》专知下载链接