2020年,你对AI的信任有几分?

马库斯认为,这类夸大的报道满足了读者的阅读兴趣,却带来了不容忽视的“AI鸿沟”: 如果公众、政府和投资界认识不到,他们被灌输了关于人工智能的不符合现实的观念,那么新一轮的AI寒冬可能就会开始。

并且,这一切已经有预兆,包括聊天机器人、医疗诊断、假新闻检测器、自动驾驶汽车等等,过度的承诺往往导致了项目本身的死亡。

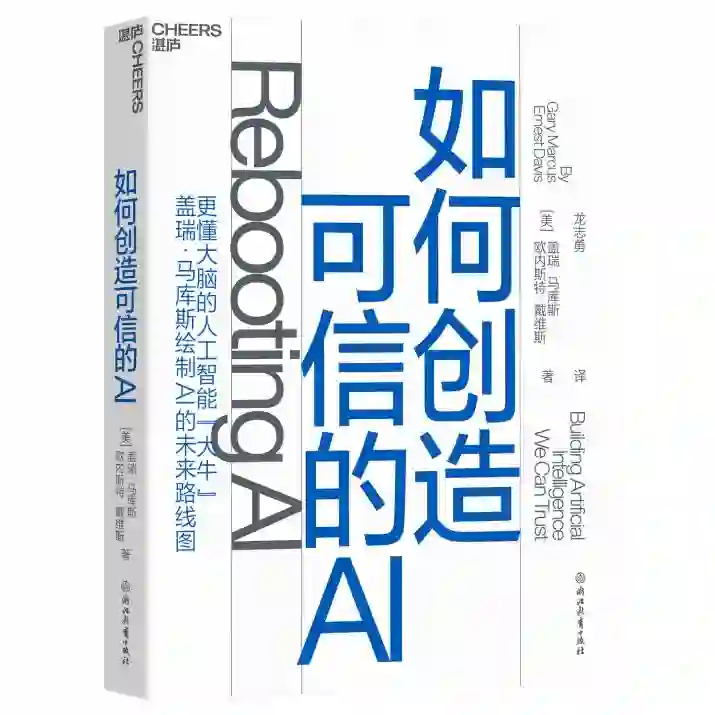

你认同马库斯的观点吗?这类“AI 鸿沟”是如何造成的呢?在新书《如何创造可信的 AI》中,马库斯详细论述了当前 AI 为何不可信赖,以及如何走向拥有常识和深度理解的可信的AI。

当前,人工智能技术已经被广泛地应用,有一些是涉及关键使命的,比如自动驾驶系统,有一些则对社会有着深远的影响,比如信息检索和内容分发等。特别是在应对目前全球面临的由新冠疫情带来的前所未有的挑战中,人工智能技术将起到越来越关键的作用。在这样的关键时机下,做出正确的判断并避免踩坑将是至关重要的,为此,马库斯追根溯源把“AI 鸿沟”归纳为三种“大坑”。

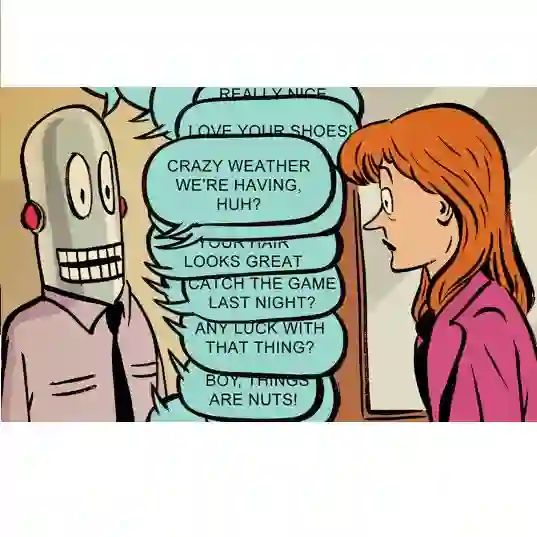

从表面看来,机器的行为常常与人类行为有相似之处,于是我们会不假思索地认为机器也拥有和人类一样的某种思维机制,而事实上,机器并不具备这样的能力。

我们总是控制不住自己,从认知的角度去看待机器(“这台计算机认为我把文件删除了”),根本不在意机器实际遵从的规则是多么的简单通透。 但是,某些完全适合用在人类身上的推论,放到 AI 身上就会大错特错,这种现象称为“基本超归因错误”。

在其他一些案例中,超归因错误甚至会威胁到人们的生命。2016 年,一位特斯拉车主将自己的性命完全交托给了自动巡航系统,据说,他是一边看《哈利·波特》电影,一边任由系统载着他在路上行驶。原本安好的生活就这样被一场事故打破了。

在安全驾驶数十万千米之后,车辆遇到了预期之外的情境:一辆白色运货卡车横穿高速公路,特斯拉直接钻到货车下面,车主当场毙命。车辆似乎向车主发出过几次报警,请他将双手放在方向盘上,但车主似乎心不在焉,没有理会。这场事故背后的道理十分清楚:仅仅因为某些东西在某些时刻貌似拥有智慧,并不意味着它的确如此,更不意味着它能像人类一样处理所有的情况。

“虚幻进步坑”的意思是,误以为 AI 解决了简单问题,就相当于在难题上取得了进步。

IBM 对沃森的大肆吹捧,就属于此类。沃森在 Jeopardy 竞技节目中获胜,被认为是机器在语言理解方面走出了一大步,而实际上并非如此。

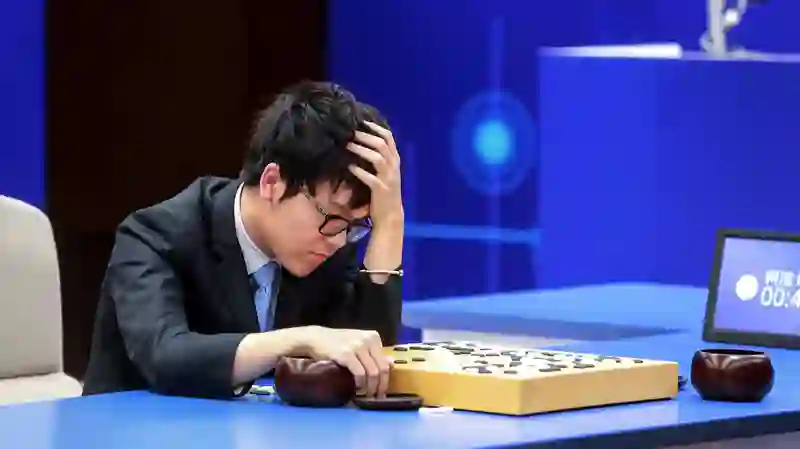

DeepMind 的 AlphaGo 很可能也会走上同样的老路。围棋和国际象棋都属于“完全信息”型游戏,任一时刻,玩家双方都能看到整个棋盘。而在真实世界的场景中,没人能 100% 地肯定任何事,我们所掌握的数据常常充满噪声,七零八落;就算在最简单的情况下,也存在大量的不确定性。

比如我们要去医院看病,恰逢阴天,正在考虑是走着去还是乘地铁。我们不知道等地铁需要多长时间,不知道地铁是否因故障而停在某处,不知道地铁里的人是否已经挤成馅饼,也不知道如果走着去会不会淋雨,不知道如果我们迟到了医生会做何反应。我们只能根据自己掌握的信息来做决策。相比之下,像 DeepMind 的 AlphaGo 那样与自己下 100 万盘围棋,是可以预期的,系统永远也不可能面对不确定性或不完全的信息,更不可能遇到人类交流时的复杂局面。

像围棋这样的游戏,与真实世界还有另外一种本质上的区别。这种区别与数据有关:游戏可以进行完美的模拟,因此,玩游戏的 AI 系统可以轻而易举地获得大量数据。在围棋上,机器可以通过与自己下棋的方法,模拟与人类之间的竞技;如果系统需要数十亿个数据点,就尽可能频繁地与自己对弈;程序员可以在几乎不负担任何成本的情况下,得到完美而清晰的模拟数据。

相比之下,在真实世界中,完美而清晰的模拟数据根本就不存在,也不可能总是运用试错的手法去收集数千兆字节的相关数据。在真实世界中,我们只能用有限的次数来尝试不同策略。

以无人驾驶汽车为例。做出一辆无人驾驶汽车的演示,在安静的道路上保持一条车道向前行驶,是相对简单的事。人们在好几年前就已经做到了。而让系统在富有挑战或预期之外的情境中工作,难度就会大增。

正如杜克大学人类与自动化实验室主任米西·卡明斯所言,问题不在于某辆无人驾驶汽车能在不出事故的情况下跑多少千米,而在于汽车本身的适应能力有多强。用她的话来说,如今的半自动汽车“一般情况下只在极窄极受约束的条件下运行,根本无从得知系统在不同的操作环境和条件下会出现什么状况”。在凤凰城经过了数百万千米的测试,且表现得无懈可击,非常可靠,并不意味着在孟买的季风天气下不会出问题。将车辆在理想情况下(如晴天的乡村公路)的行驶表现与车辆在极端情况下的表现混为一谈,是将整个行业置于生死边缘的重大问题。行业中人对极端情况的存在视而不见,甚至连保障车辆性能的方法论都对极端情况不予理会,直到最近才开始有人翻出旧账。

行业目前的状态,就是拿着数十亿美元在无人驾驶汽车的技术研发上打水漂儿,因为目前这条老路的鲁棒性差得太远,根本不可能让车辆拥有人类水平的可靠性。我们需要的是完全不同的技术思路,只有这样,才能将我们迫切需要的最后那一点点可靠性掌握在手中。

《如何创造可信的 AI》(Rebooting AI:Building Artificial Intelligence We Can Trust )

作者:[美] 盖瑞·马库斯(Gary Marcus ) 欧内斯特·戴维斯(Ernest Davis)

译者:龙志勇

关于人工智能的炒作总是甚嚣尘上,但要得到真正可信的 AI,却远比想象的要复杂得多,超级智能的时代还远没有到来。创造真正可信的 AI 需要赋予机器常识和深度理解,而不是简单地统计分析数据。《如何创造可信的 AI》勾勒了未来人工智能发展的最佳路线图,对当前人工智能的现状进行了清晰且客观的评估,这本书正是马库斯对他关于人工智能观点的最佳总结。