马普所、南洋理工等最新《多模态图像合成与编辑》综述论文,20页pdf

转载机器之心

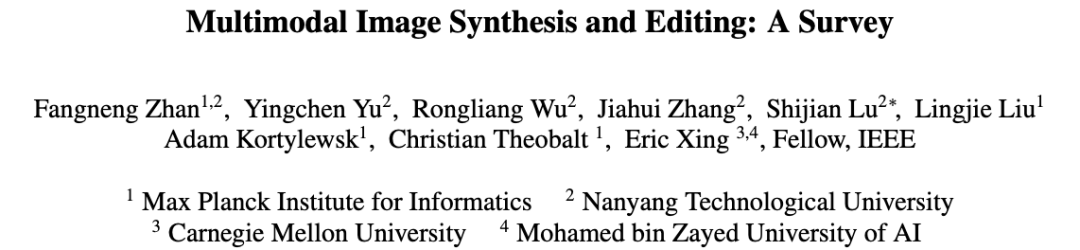

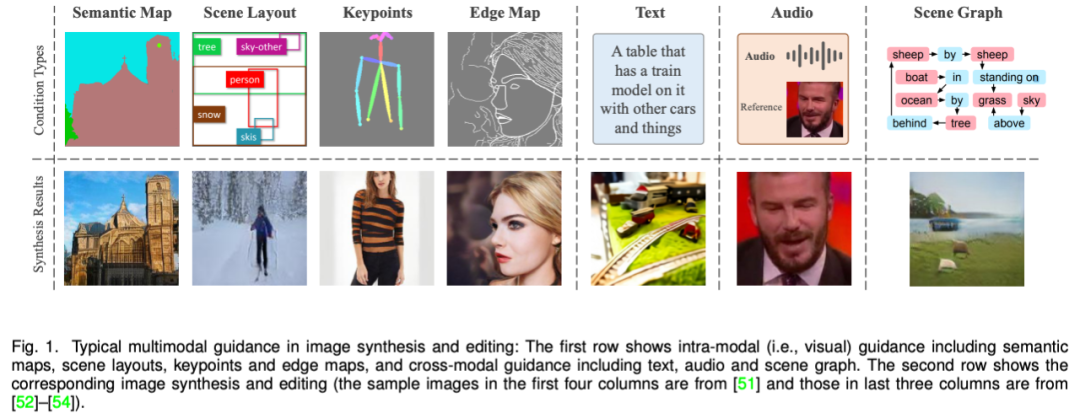

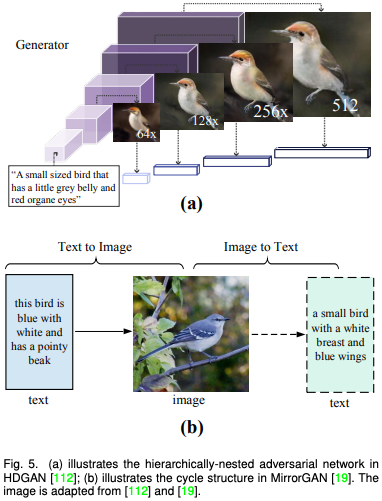

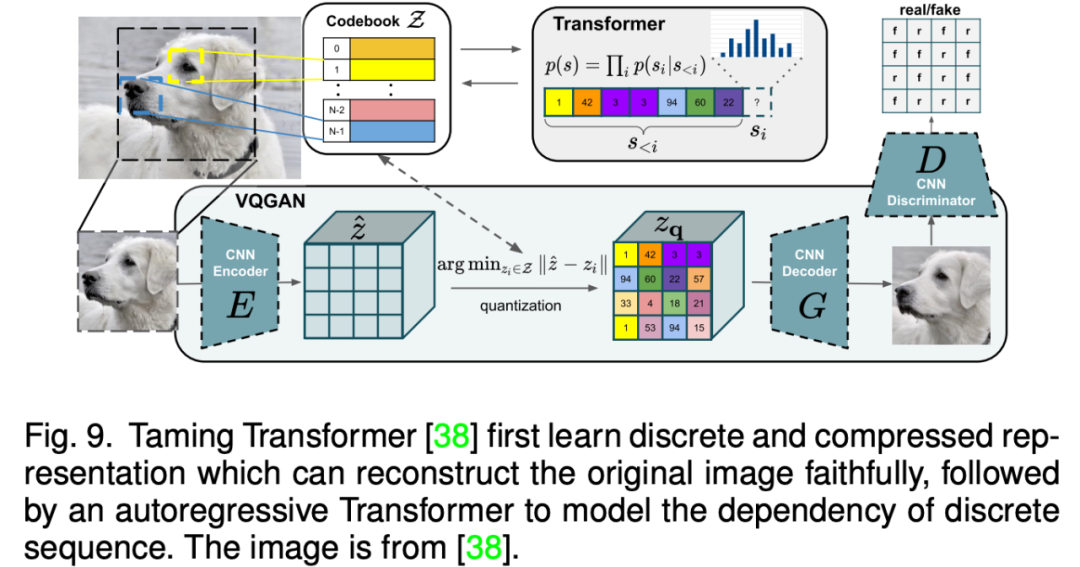

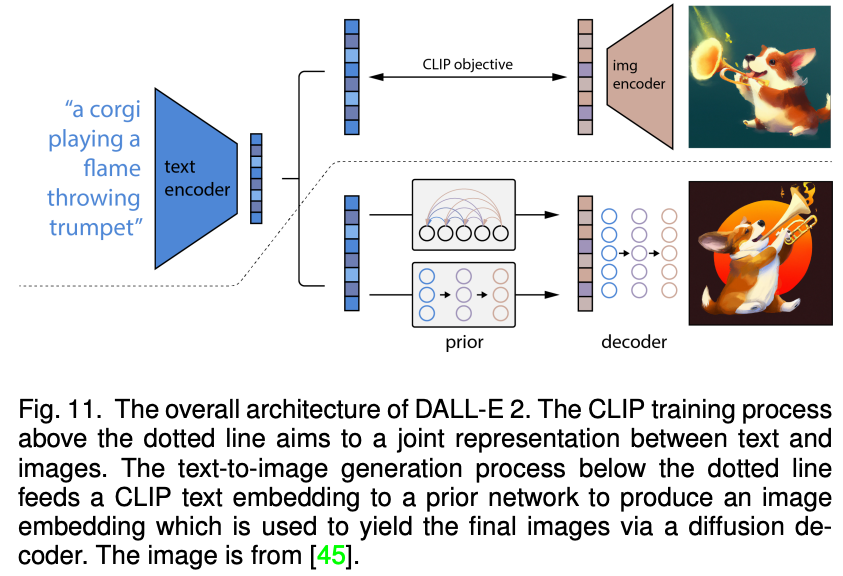

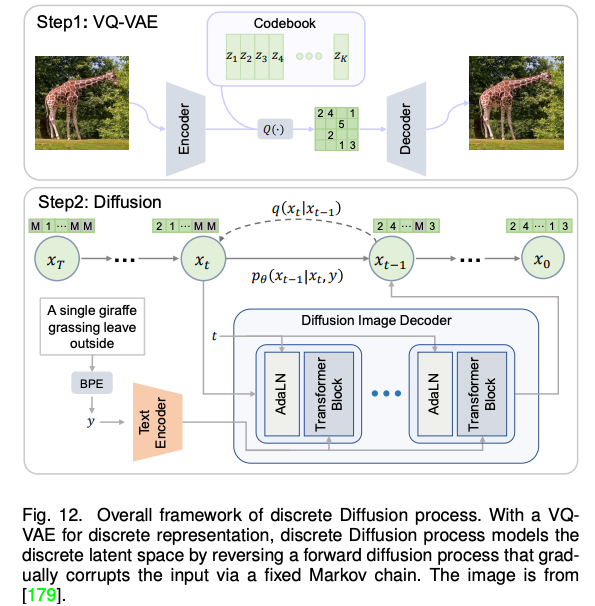

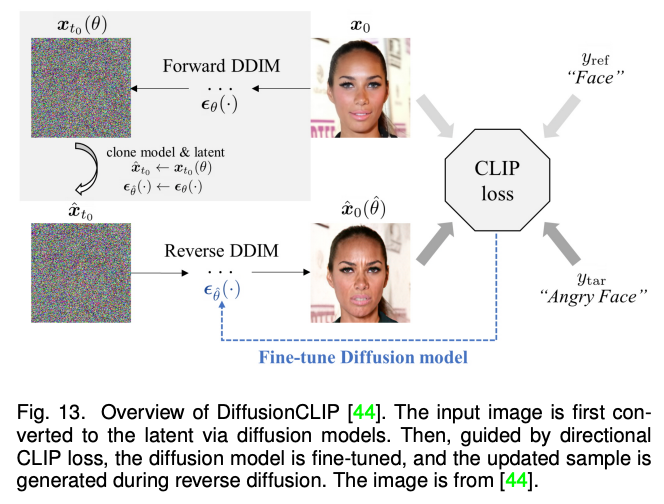

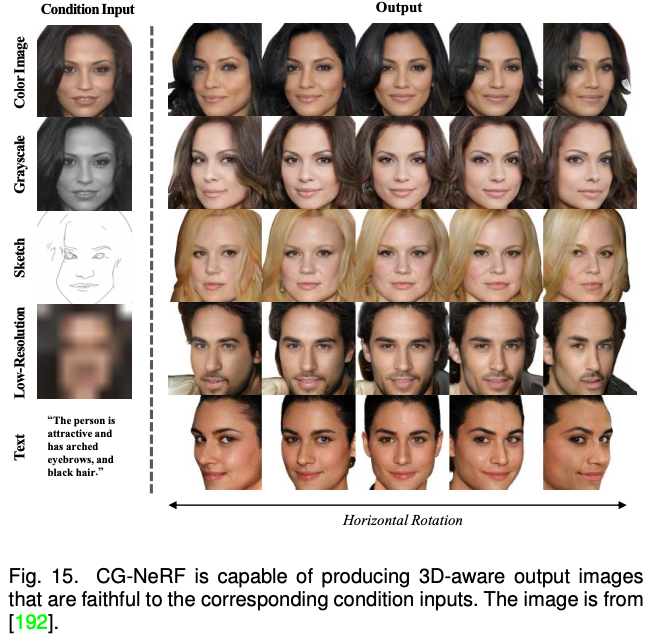

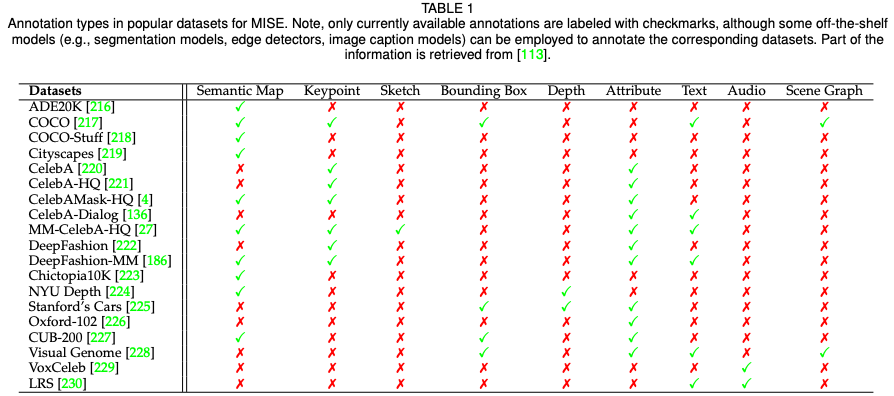

本篇综述通过对现有的多模态图像合成与编辑方法的归纳总结,对该领域目前的挑战和未来方向进行了探讨和分析。

-

项目地址:https://github.com/fnzhan/MISE

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“M20” 就可以获取《马普所、南洋理工等最新《多模态图像合成与编辑》综述论文,20页pdf》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年11月21日

Arxiv

0+阅读 · 2022年11月17日