NIPS2017:一条蠕虫将如何影响神经网络?

编者按:本文作者Wenxi Chen是一名人工智能研究者,以下是他参加NIPS2017其中一个研讨会的收获与心得。本文已获作者授权。

NIPS2017是我参加的第一个会议,在这里我想分享一些关于线虫神经信息处理研讨会(Workshop on Worm’s Neural Information Processing)的想法和启发。希望对你有用。

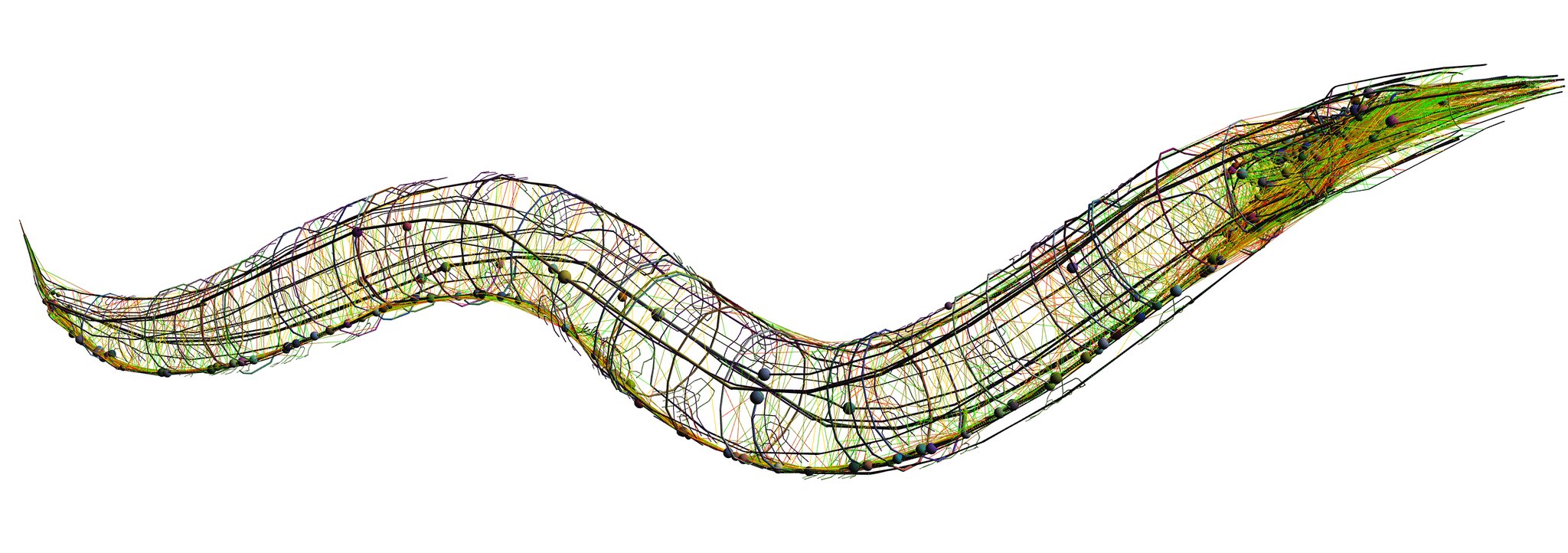

秀丽隐杆线虫(C.Elegans)是蠕虫的一种,虽然它仅有302个神经元来控制它的行为,但其他动物所做的事它都能做到,例如导航、交配、寻找食物等等。因此,此次研讨会意在探讨这种线虫在哪些方面能促进机器学习的发展。会议之前,我从未听说过这种线虫。在听完了演讲者的演讲之后,感到有趣之余我还发现,这些杰出的研究人员并不完全遵循当下流行的机器学习设计模式,因此我认为这是非常值得分享的。

感觉层不仅能嵌入

Netta Cohen教授讲了一个关于秀丽隐杆线虫寻找盐的故事。她认为,线虫的感觉层是随着经验积累而改变的。如果线虫爬到盐上,它对盐就不太感兴趣;如果离开了盐,它就会被盐再次吸引过去。因此,线虫内部的感官机制似乎在不断计算。这种计算绝不止嵌入,事实上,他们就用模拟自适应导航做了坑洞检测实验。

激活(Activation)可以分配给多个神经元

William R. Schafer博士的演讲是关于移除控制线虫肌肉的神经元之后的影响。他们发现了不同类型的神经元与肌肉运动之间的映射。某些神经元对某些运动是必要的,但有些神经元却不是。造成这种差异的原因目前尚不清楚,但是这绝对值得深入研究。然而,我发现这与多层感知器并不矛盾,去除某些神经元对激活(activation)的作用取决于体重。这里可以看一下论文的摘要。

神经元的循环结构

Radu Grosu教授分享了他的团队利用线虫启发式神经网络创造的机器人停车成果。其中的两个设计让这个神经网络十分有趣。首先,整个网络只有10个左右的神经元。其次,每个神经元就像一个触发器。在每组神经元内有循环计算,即从单一神经元返回到它自身。神经网络是利用某些遗传算法训练的。但项目参与者Ramin M. Hasani和Mathias Lechner表示他们用某个梯度算法将其应用到TensorFlow上,显著加快了训练速度。

似乎循环结构能真正减少神经元的数量。希望他们的团队能尽快发布这一工作成果(以及代码)。

生物学中的整体设计

在最后的小组讨论中,另一个有趣的问题是,生物体的神经元和身体通常是高度同步的,如果我们只想设计一个不控制身体的模型,这个问题也许不需要考虑。但如果要设计一个机器人的智能系统,也许我们要思考一下如何才能让机器人协调工作,以及它会有什么好处。

结论

虽然我认为人工智能的设计方式与真实生物体不完全相同,但大自然仍能给我们很多灵感。我曾听过这样一个说法:要想完成人类能做的事,就要先达到老鼠的水平。因此,从秀丽隐杆线虫入手是非常值得的。

参考文献:

A C. elegans inspired robotic model for pothole detection. John Lones, Anthony G Cohn, Netta Cohen

Using network control principles to probe the structure and function of neuronal connectomes [abstract]. William R. Schafer, Gang Yan, et al.

原文地址:wenxichen.github.io/inspirations/2017/12/27/nips-2017-inspirations.html