深度学习主导人工智能时代将结束?万余篇论文梳理AI发展史

来源丨澎湃新闻

从2012年斯坦福大学和谷歌的研究人员让计算机学会识别猫开始,深度学习将人工智能推向了公众的视野,也一直在人工智能领域占据着前沿地位。不论是正在改变医疗和安防行业的图像识别和人脸识别技术,还是语音识别和视频理解,这些人工智能的应用大多都要归功于深度学习。

然而,新技术的突然兴起是人工智能研究的一大特征,近期一份基于16625篇论文的分析报告指出,深度学习主导人工智能领域的趋势正在发生改变。

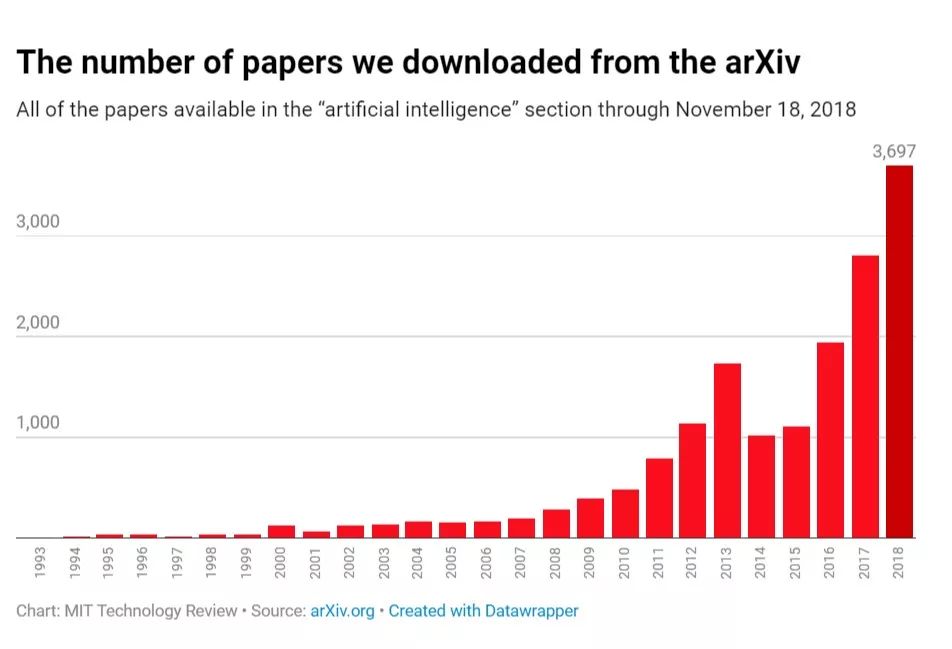

《麻省理工科技评论》最近在全球最大的科学论文开源数据库之一arXiv上收集了16625篇人工智能领域的论文。这些论文的发表时间跨度为25年,最早可追溯到1993年,最晚截止至2018年11月18日。根据论文的摘要和关键词,《麻省理工科技评论》分析了不同人工智能方法的发展趋势并指出:“深度学习的时代即将结束”。

从手动编码转向机器学习

《麻省理工科技评论》的报告发现,在20世纪90年代末至21世纪初的这段时间里,人工智能学者的目光渐渐转向了机器学习。

所谓机器学习,指的是从已知数据中去学习数据中蕴含的规律或者判断规则。

1988年,IBM研究人员发布了一种语言翻译统计方法,将概率原理引入到当时规则驱动的人工智能领域,尝试解决法语和英语之间自动翻译的挑战。这种方法被视为是今天使用的机器学习的基础。

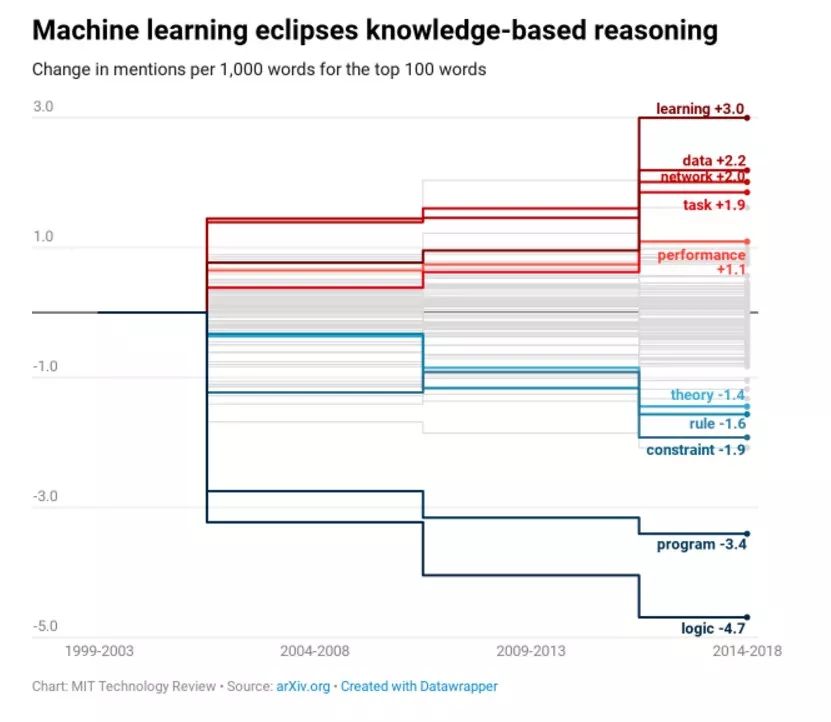

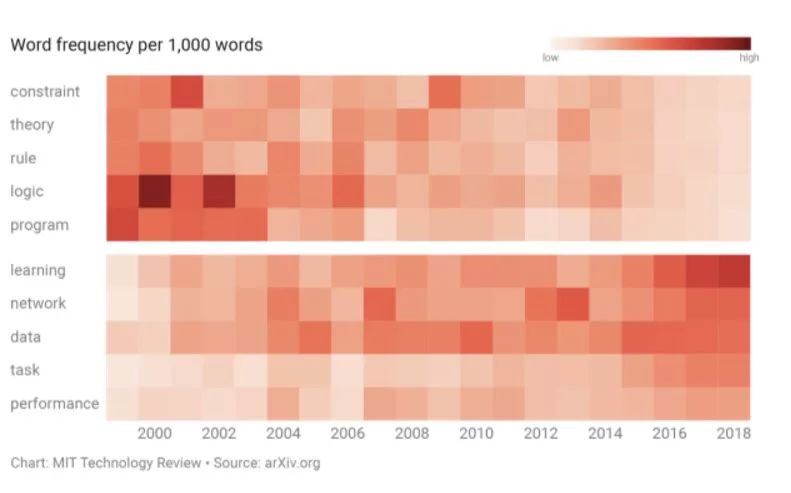

上述报告发现,在20世纪90年代末至21世纪初的人工智能论文中,“逻辑”、“规则”等与知识系统相关的词,数量开始下降,而“数据”、“网络”、“性能”等与机器学习相关的词汇出现的次数快速增长。

《麻省理工科技评论》在报告中给出了这种变化的原因。知识系统需要人为编写规则才能使系统运行,需要极大的人力成本且效率低下,而不要求手动编码的机器学习正好成为“完美替代”。在机器学习中,编程机器会自动从一堆数据中提取规则。

Image Net挑战赛与神经网络

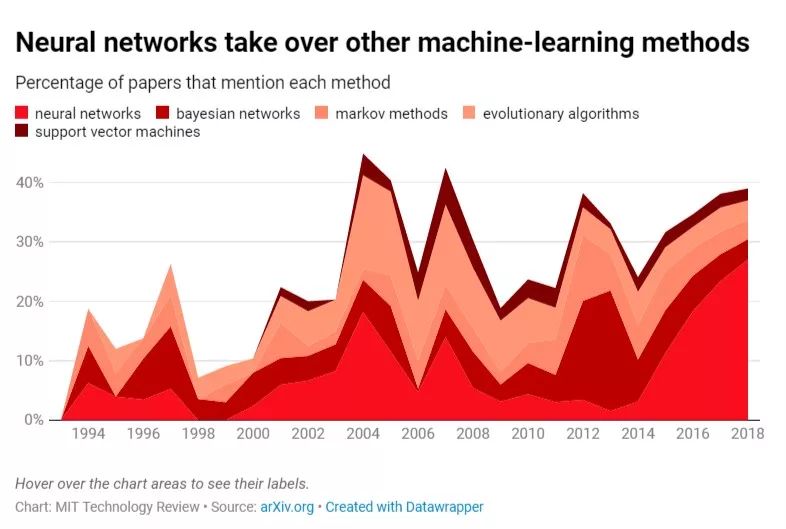

在20世纪90年代至21世纪初,神经网络、贝叶斯网络、进化算法、支持向量机等机器学习的各种方法之间存在着稳定的竞争。但报告发现,2012年的一次突破改变了这一状况,深度学习大大超越了其他方法,一举成为最受重视的机器学习领域。

在2012年一次全球范围的图像识别算法竞赛ILSVRC(也称为 Image Net挑战赛)中,多伦多大学教授、“深度学习之父”杰弗里·辛顿(Geoffrey Hinton)和同事们开发的一个多层神经网络 Alex Net取得了冠军。该多层神经网络以超过10个百分点的惊人幅度实现了图像识别的最佳准确度,大幅度超越了使用传统机器学习算法的第二名。

这次比赛的成果在人工智能学界引起了广泛的震动。从此,以多层神经网络为基础的深度学习被推广到多个应用领域,在语音识别、图像分析、视频理解等诸多领域取得成功。

深度学习是机器学习研究中的一个新的领域,其动机在于建立、模拟人脑进行分析学习的神经网络,它模仿人脑的机制来解释数据,例如图像,声音和文本。

与此同时,一种监督学习下的深度学习模型——卷积神经网络也得到了快速的发展。《麻省理工科技评论》的报告发现了这个增长趋势。数据显示,神经网络相关论文在人工智能论文中所占的比例从2012年的3%一路上升至2018年的27%。

阿尔法狗和强化学习的兴起

强化学习是人工智能的重要分支。在2016年击败围棋世界冠军李世石九段的阿尔法狗,其令世人震惊的博弈能力就是通过强化学习训练出来的。

强化学习的目标是要获得一个策略(policy)去指导行动。例如,在阿尔法狗和李世石的围棋博弈中,这个策略可以根据盘面形势指导阿尔法狗每一步应该在哪里落子。

强化学习会从一个初始的策略开始。通常,初始策略不一定很理想。在学习过程中,决策主体通过行动和环境进行交互,不断获得反馈(回报或者惩罚),并根据反馈调整优化策略。

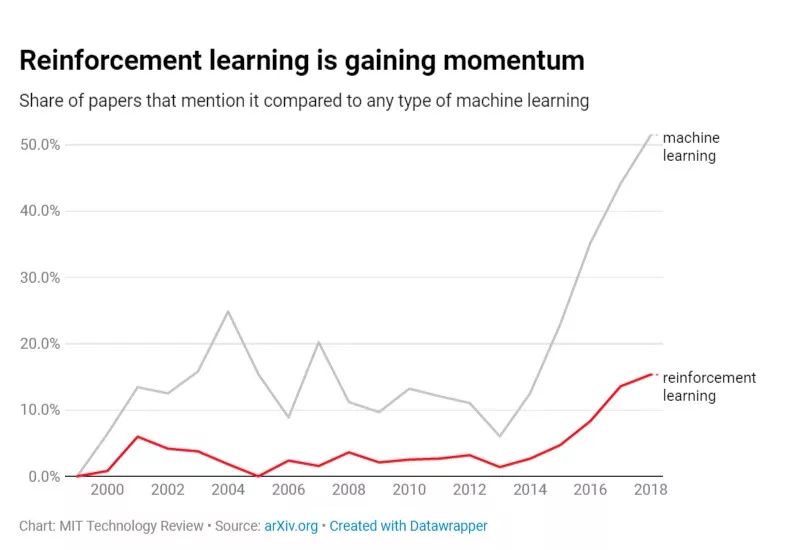

《麻省理工科技评论》发现,最近几年中,提及强化学习的论文数量大幅上升,强化学习论文在人工智能论文中的占比从2015年的4.7%上升为2018年的15.3%。

对于这种上升趋势,华盛顿大学计算机科学教授佩德罗·多明戈斯(Pedro Domingos)表示,强化学习并不是新鲜的理论,但在之前几十年中,它没有发挥出真正的作用。阿尔法狗在围棋比赛中击败世界冠军的里程碑事件,无疑为强化学习的发展带来了深刻影响。

推荐阅读