Transformer!「预训练变换器文本排序」首篇综述书,155页pdf概述BERT类模型文本检索进展

首篇关于Transformer文本排序的书,值的关注!

文本排序的目标是生成从语料库检索到的有序文本列表,以响应特定任务的查询。虽然文本排序最常见的形式是搜索,但在许多自然语言处理应用程序中也可以找到该任务的实例。

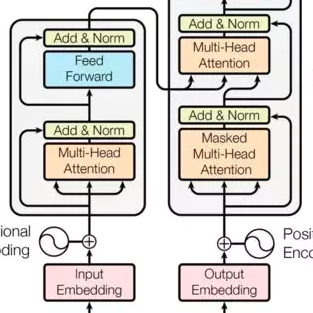

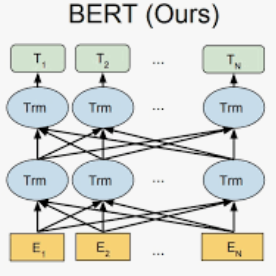

本书提供了Transformer神经网络架构的文本排序的概述,其中BERT是最著名的例子。毫不夸张地说,Transformer和自监督预训练的结合彻底改变了自然语言处理(NLP)、信息检索(IR)等领域。在文本排名的上下文中,这些模型在许多领域、任务和设置中产生高质量的结果。

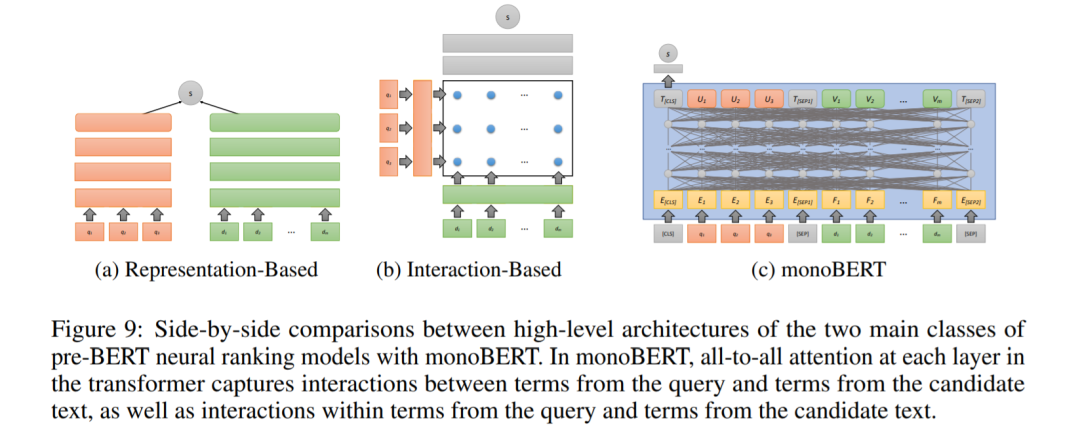

在这项综述中,我们提供了现有工作的综合,作为希望更好地理解如何将transformers应用于文本排序问题的从业者和希望在这一领域继续工作的研究人员的单一切入点。我们涵盖了广泛的现代技术,分为两个高级类别:在多阶段排名体系结构中执行重新排名的transformer模型,以及尝试直接执行排名的密集表示。有许多例子属于第一类,包括基于相关性分类的方法、来自多个文本片段的证据聚合、语料库分析和序列到序列模型。虽然第二类方法还没有得到很好的研究,但使用transformers进行表示学习是一个新兴的和令人兴奋的方向,必将引起更多的关注。在我们的调研中,有两个主题贯穿始终:处理长文档的技术(在NLP中使用的典型逐句处理方法之外),以及处理有效性(结果质量)和效率(查询延迟)之间权衡的技术。

尽管transformer架构和预训练技术是最近的创新,但它们如何应用于文本排序的许多方面已经被比较好地理解,并代表了成熟的技术。然而,仍然存在许多开放的研究问题,因此,除了为文本排序预先设定训练transformers的基础之外,该调研还试图预测该领域的发展方向。

https://www.zhuanzhi.ai/paper/fe2037d3186f4dd1fe3c3ea1fb69f79e

引言

文本排序的目标是生成从语料库检索到的有序文本列表,以响应特定任务的查询。文本排序最常见的形式是搜索,搜索引擎(也称为检索系统)生成一个文本排序列表(web页面、科学论文、新闻文章、tweet等),根据与用户查询的估计相关性排序。在这个上下文中,相关的文本是那些“关于”用户请求的主题并处理用户的信息需求的文本。信息检索(IR)的研究人员称这为ad hoc检索问题。

使用关键字搜索,也称为关键字查询(例如,在web上),用户通常在搜索框中输入一些查询词(例如,在浏览器中),然后返回包含排序文本表示的结果。这些结果被称为排名列表,命中列表,命中,“十个蓝色链接”,或搜索引擎结果页面(serp)。排序文本的表示通常包括标题、相关的元数据、从文本本身提取的内容(例如,突出显示用户查询词的关键字上下文摘要),以及到原始源的链接。虽然有很多文本排序问题的例子(见1.1节),但这个特定的场景是普遍存在的,无疑对所有读者来说都是熟悉的。

本书提供了一种称为transformers的神经网络体系结构的文本排序概述,其中BERT(来自transformers的双向编码器表示)[Devlin et al., 2019],谷歌的发明,是最著名的例子。毫不夸张地说,BERT彻底改变了自然语言处理(NLP)和信息检索(IR),以及更广泛地说,人类语言技术(HLT),一个包罗万象的术语,包括处理、分析和以其他方式操纵(人类)语言数据的技术。在文本排序方面,BERT提供的结果无疑比之前的结果质量更好。这是一个强大的和广泛复制的实证结果,在许多文本排序任务,领域和问题公式。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“PTR” 就可以获取《Transformer!「预训练变换器文本排序」首篇综述书,155页pdf概述BERT类模型文本检索进展》专知下载链接