近年来,人工智能进入了一个飞速发展的阶段,并且已经上升到国家战略层面。然而现有的技术仍然需要大量的数据作为训练基础,不仅代价高昂,有时也很难获得。因此,如何让机器获取像人一样的推理能力以及小样本下的学习问题,成为了重要的探索方向。迁移学习——将在已知领域中学到的知识和经验迁移到不同但相关的未知领域中来解决新问题——正是人工智能解决小样本学习等问题的重要手段。

![]()

一个习惯了靠右行驶的汽车驾驶员怎样去快速适应和转变为靠左行驶呢?如果能找到两种不同环境下的不变量——驾驶员的座位都靠近马路中间而不是马路两侧,驾驶员就可以凭借已有的经验,快速掌握新问题的解决方法,做到举一反三。虽然人工智能要达到这种人类级别的推理能力还有很长的路要走,但是人工智能面向工程化的目标却可以通过迁移学习完成,并且在越来越多的真实应用中得到验证。

![]()

香港科技大学杨强教授带领其学生、博后研究员和助理研究员在多年研究基础上撰写完成了首本迁移学习专著(英文版 Transfer Learning、中文版《迁移学习》皆已出版),深耕研究近三十年,见证了从 21 世纪初到 2019 年该领域被 Gartner 公司技术曲线收录为新兴技术的全过程,也是引领迁移学习发展的带头人。

提到迁移学习,对人工智能和机器学习知识有所了解的人可能会想到若干关联词:知识重用、终身学习、多任务学习、多视角学习、增量学习、永无止境学习、领域自适应、预训练和微调等。一方面这反映了迁移学习涉及广泛的知识面,使得想入门这个领域的人不知从何处入手,另一方面也反映了迁移学习各种不同的研究角度都有一套独特的框架和描述逻辑,这增加了这个领域的入门难度。

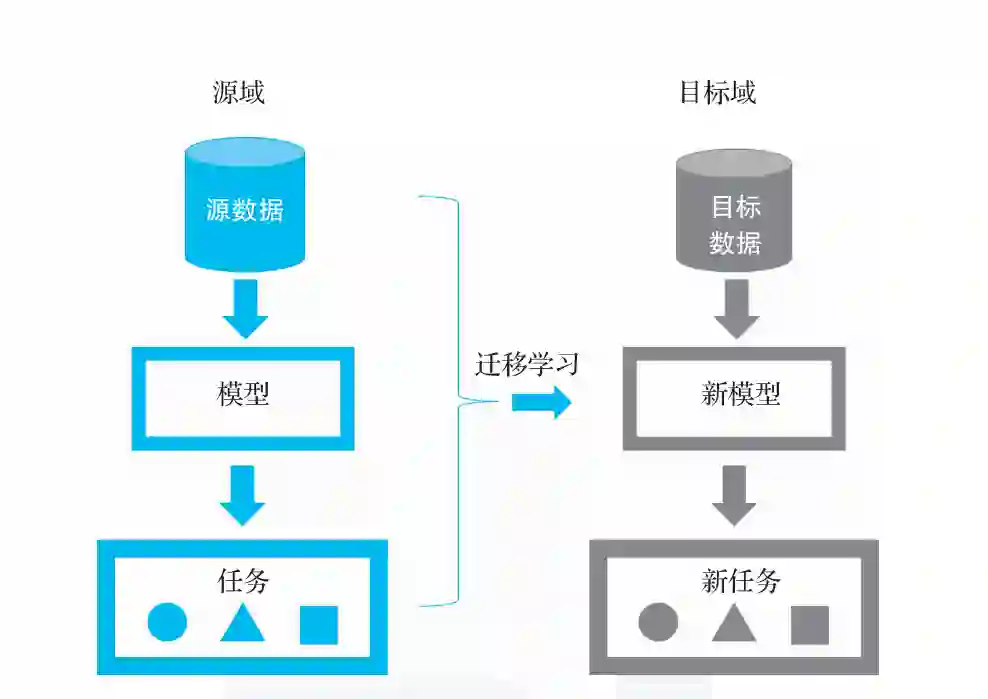

作为机器学习的一个子领域,迁移学习虽然有着看似明确的目标,即用已有的知识帮助完成新任务,但是会遇到一个麻烦:对于某个具体的应用问题,解题思路看起来千差万别,不同领域的研究人员在各自领域的思想下设计出来的算法犹如万花筒,让人眼花缭乱。从学习的角度来看,这是因为缺乏一条清晰的脉络,使人摸不清主干在哪里,从而无法搭建知识的宫殿和体系。

![]()

《迁移学习》的出版为有志于入门该领域的读者带来了福音。一般来说,入门一个领域都是从基础概念和工具入手,在此基础上建构分析各种具体问题的指导原则和方法,从而在面临一个新的问题时,可根据条件选择适当的工具并加以分析和解决。那么,迁移学习有所谓的基础概念和工具吗?

该书的第一部分正是介绍迁移学习的基础知识。迁移学习的算法虽然琳琅满目,但可以抽象和归纳出一些共同点,将其纳入一套学习框架之中,成为迁移学习的相关理论。此外,尽管这个领域不断涌现新论文和比较全面的调研综述,但它们要么在自身的具体问题上使用迁移学习,从而使得对迁移学习的介绍分散在各处,要么像专题博士论文那样,为了强调逻辑性只深入介绍迁移学习的某种算法,从而导致知识覆盖不全面,而这本书的出现弥补了领域内缺乏成体系教材的巨大空白。

迁移学习属于人工智能和机器学习的进阶内容,所以该书对初次阅读的读者可能会造成一种「要接受诸多新概念、新术语和新算法」的不适感。读者熟悉的典型人工智能教材介绍的可能是搜索、智能体、推理、决策,典型机器学习教材介绍的可能是线性模型、决策树、支持向量机、神经网络,而该书却不是这样:打开目录,发现诸如实例、特征、模型之类的词都是自己熟悉的,而加上「迁移」二字就感到有些陌生了,虽然隐约觉得与机器学习知识有关系,但依然一头雾水。

这里也会提供一些阅读方法指导。既然迁移学习是机器学习的一个子领域,就必然有一些概念是相同的。

前面提到,由于迁移学习本身是机器学习的进阶内容,因此读者必须具备机器学习的基础知识,至少应该系统地学过机器学习的专门教科书。另外,读者须具有较为扎实的理工科高年级本科生数学知识,包括线性代数和概率统计。

该书除绪论和结束语外分为两个部分:迁移学习的基础和迁移学习的应用。第一部分共 13 章,每章介绍一种迁移学习的问题,又可划分为三大块:第一块是迁移学习的 4 种方法,每种方法对应一章;第二块是迁移学习的 8 个子领域,每个子领域对应一章;第三块是迁移学习的理论,单独一章。第二部分共 8 章,每章介绍一种迁移学习的应用。

开篇的

绪论

必读(第 1 章),因为它涵盖了迁移学习的核心概念。本章先介绍设计迁移学习算法的三个核心概念:何时迁移、迁移什么和如何迁移。直白地说,何时迁移就是在对解决新问题有帮助的时候迁移旧知识,如果没有帮助甚至有害就不迁移。我们可以将其假想成物理学中的麦克斯韦妖:一个知识容器里面有两格,分别对应新任务和旧任务,中间由「妖」控制着一扇门。当旧任务格子里面的知识对解决新任务有帮助的时候,门就打开;当旧任务格子里面的知识对解决新任务没有帮助甚至有害的时候,门就关闭。门何时打开又何时关闭,就对应着何时迁移。然后介绍迁移学习的 4 种方法:基于样本的迁移、基于特征的迁移、基于模型 / 参数的迁移以及基于关系的迁移。接着介绍迁移学习与现有机器学习范式(有监督学习、半监督学习、主动学习、多任务学习)的关系。最后,本章提纲挈领地纵览了第二部分包含的迁移学习的各种应用,如果读者对某一方面特别感兴趣,也可以据此直接跳到对应章节深入阅读。另外,本章还涵盖了该书涉及的数学符号和核心术语的定义。值得一提的是,本章的「历史笔记」小节也颇为有趣,揭示了迁移学习早在 20 世纪 80 年代就植根于人工智能先驱的工作之中,使人觉得这一领域既沧桑又年轻。

如前所述,绪论提到的迁移学习的 4 种方法可以划分为第一部分的第一块,每种方法对应一章。这四种迁移学习的方法都是在回答如何迁移的问题,即指定一个迁移学习方法采用何种形式进行迁移。

我们知道,机器学习算法需要训练数据,训练数据表示成一条一条的样本,比如一张图片、一则新闻、一个视频。基于样本的迁移是指,不同的样本对于完成新任务的重要程度是不一样的——有时候这条样本重要,有时候那条样本关键。这时就可以为每条样本学习一个权重,来表明它们对知识迁移的贡献程度,也就是说,知识以样本权重的方式被迁移到新任务上。我们常常说真理掌握在少数人手中,就是一样的道理。

一般来说,有了训练数据,它的输入就对应一个原始输入空间,比如,一则新闻的原始输入空间就是由许多词构成的空间。这导致的一个问题是,已有知识所在的原始输入空间可能与要解决的新任务的原始输入空间并不重叠,阻碍了知识的直接复用。这时,基于特征的迁移就学习一个抽象的特征空间,使得已有知识可以通过这个抽象的特征空间方便地迁移到新任务上。可以将此看作学习一种通用的特征表示,在各个任务之间都可以转换。举个例子,线性代数中有基底的概念,例如二维空间的基底就是常数的笛卡儿坐标系,有了这个坐标系,所有的样本就可以表示成各个基底对应的系数,这些系数就是样本的一种新表示。如果对于一个新任务的样本也使用同样的基底,就能得到一种新表示。不知不觉之间,知识就以共享基底的形式迁移到新任务上了。

在现今如火如荼的预训练模型和深度学习研究中,基于模型的迁移成了新的宠儿。预训练的基本做法是,先在大量易获得的数据上训练一个多层的深度通用模型,然后利用新任务上的少量有标记的数据对这个深度通用模型进行微调,以达到私人定制的效果。背后的原理在于,这个通用模型捕捉了问题的结构,是「放之四海而皆准」的通用知识,于是知识就以这种形式迁移到了新任务上。

这种方法与其他三种方法都不一样,因为它不再独立地看待样本,而是考虑样本之间的关系。机器学习中与其对应的概念就是样本之间不再是独立同分布的。举个例子,学术领域中一篇论文和一个作者之间就存在一种创作关系,就像电影领域中一部电影和一名导演之间也存在一种创作关系,这种跨领域存在的相似关系,就是基于关系的迁移中知识迁移的形式。

![]()

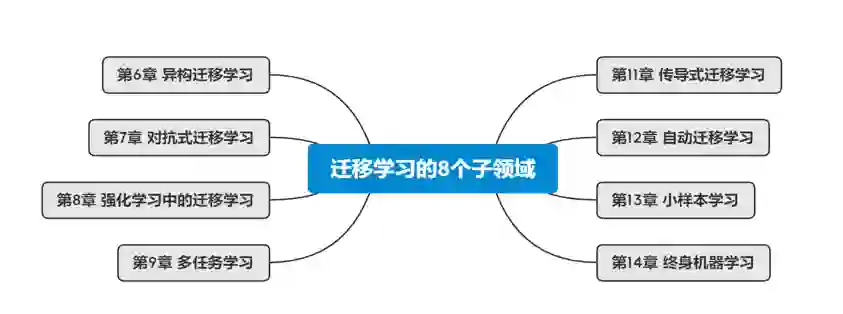

接下来,进入第一部分的第二块,即迁移学习的 8 个子领域,每个子领域对应一章。先要说明的是,这些子领域之间并不是正交的,而是应该将其看作迁移学习的 8 种工具,可以搭配使用。

异构迁移学习

处理的是两个领域之间的特征表示完全不同的情况,比如,如何从图片的像素特征建立一条桥梁到文本的离散值特征呢?可以从更高层的语义信息入手,比如一张狗的图片正好也对应着一篇介绍狗的文章,这样两者之间的高层语义信息「狗」就建立了它们之间的联系。

对抗式迁移学习

就是在迁移学习中使用生成式建模的机器学习技术,或者是基于对抗学习的技术设计开发迁移学习算法。这就有些类似人类的能力了:一边创造与生成,一边判断与学习,两者形成一种博弈。例如,可以从一个领域的样本生成另一个领域的样本,同时判断后者是生成的还是真实存在的。

我们常说要先学走再学跑,

传导式迁移学习

正是处理两个领域相差甚远、无法一步到位的情况,创造一个中间领域作为垫脚石,以允许知识在两个领域之间跳跃。举个例子,我们有一个图像分类数据集可用,而目标任务却是通过某个地区的卫星图像来判断该地区的贫困程度。为了完成目标任务,我们可以找一个与这两个领域都有关系的中间领域,例如城市夜晚的灯光亮度。想一想是不是很有道理:将图像分类的知识迁移到夜晚图像的灯光亮度预测,然后将夜晚图像的灯光亮度信息迁移到卫星图像的地区贫困程度预测(一个地区的夜景越亮,贫困程度就越低)。

本文的开头提到过,

小样本学习

是解决训练样本严重不足或者收集训练样本的代价高昂等问题的有效工具,实际上是在向人类可以通过很少的例子学习一个新概念的能力迈进。虽然随着信息技术的发展,产生了大量的数据,但是特定领域仍然面临数据短缺的问题,这对机器学习来说是很难解决的。从 20 世纪 90 年代的孪生网络到近期的贝叶斯概率方法,研究者仍在持续探索和研究这个领域。

多任务学习

与迁移学习紧密相关。一般来说,迁移学习只有一个主要任务,而多任务学习有若干平等的任务。

终身机器学习

与迁移学习也紧密相关。一般来说,迁移学习的知识源头只是最近的一个或者几个,而终身学习的知识源头是历史上所有的任务,因此要解决遗忘的问题。

自动迁移学习

顾名思义就是让迁移学习自动完成,而不是人工的工程设计。这其实是把迁移学习上升到这样一个层次:现在积累的知识已经不是传统的权重和参数等具体的领域,而是关于迁移学习本身,将这种迁移学习经验的积累作为一种训练数据,学习一个能完成自动迁移学习的调参模型。也就是说,现在的一次训练是一个三元组,第一元是一个领域,第二元是另一个领域,第三元是这两个领域之间的迁移学习算法,而这条训练样本的标记就是这个三元组的性能提升。自动迁移学习与现今的研究热点神经网络架构搜索等紧密相关,它们都属于自动机器学习。

强化学习中的迁移学习

顾名思义就是把迁移学习用于强化学习的相关问题,主要区别于在传统的分类、回归等学习问题上的应用。

![]()

机器学习有自己的理论,即学习理论,同样,迁移学习也有自己的理论。这是第一部分的第三块的内容(第 10 章),即「迁移学习理论」。虽然本章属于「迁移学习的基础」部分,但其内容却并不基础。本章是理论基础,学习理论要建立训练样本数量与算法泛化误差的一般关系(上下界关系),工具是图灵奖得主 L. Valiant 提出的概率近似正确(PAC)学习。类似地,迁移学习理论也能帮助建立学习系统能力的保证。曾备受关注的支持向量机就是在统计学习理论指导下设计的一个实用算法,它的作者之一 V. Vapnik 有一句名言:「没有什么比一个好的理论更有实践性。」有志于深读本章的读者可以参考周志华教授等著的《机器学习理论导引》作为本章的导引。

![]()

掌握了第一部分的基础概念和工具,就可以更好地理解、运用和分析各个应用领域中的迁移学习了。

正如前面提到的,预训练式的迁移学习方法在深度模型中有广泛的应用,尤其是

计算机视觉

和

自然语言处理

。另外,在自然语言处理和人机交互的交叉领域

对话系统

中,强化迁移学习有着广泛的应用。由于在

生物信息学

和生物成像领域,小样本问题尤为突出,故迁移学习也有着广泛的需求。由于不同城市之间的数据规模不同,在

城市计算

和智慧城市领域,迁移学习也有着广泛的应用。与此相关联,在与移动计算相关的

行为识别

领域,每次更换一个场景和位置时,由于没有足够的感知器来捕捉信号和数学,因此迁移学习也是缓解此种情况下新场景训练样本不足的问题的重要方法。针对一种经典的场景,即

推荐系统

,迁移学习更是发展出多种算法,包括基于模型的迁移学习、基于样本的迁移学习等。随着隐私保护越来越受到重视,把多个领域的数据样本集中起来训练的传统学习方式面临隐私泄露风险和法律问题,

隐私保护的迁移学习

应运而生。除了差分隐私等技术,特别地,杨强教授的最新研究方向把联邦学习和迁移学习结合起来,联邦迁移学习为隐私保护的迁移学习提供了一种新的范式。

![]()

杨强,微众银行首席人工智能官,香港科技大学计算机科学与工程系讲席教授,第四范式有限公司联合创始人,ACM、AAAI、IEEE、IAPR、CAAI 和 AAAS 会士,香港人工智能与机器人学会理事长,AAAI 2021 主席。曾任 IJCAI 理事长和多个国际顶会主席,包括 IJCAI 2015、ACM KDD 2012 等。

曾获 2004/2005 ACM KDDCUP 冠军、2017 ACM SIGKDD 杰出服务奖、2018 AAAI 创新人工智能应用奖、2019 CAAI 吴文俊人工智能科学技术杰出贡献奖。曾任华为诺亚方舟实验室创始主任和香港科技大学计算机系主任。曾创立 i IEEE Transactions on Big Data /i 和 i ACM Transactions on Intelligent Systems and Technology /i 期刊并任主编。著有《智能规划》《学术研究:你的成功之道》《软件工程中基于约束的设计恢复》和《联邦学习》。

![]()

张宇,南方科技大学计算机科学与工程系副教授,2011 年在香港科技大学计算机科学与工程系获博士学位。在国内外顶级人工智能会议及期刊上发表论文约 70 篇。曾获 UAI 2010 和 PAKDD 2019 的最佳论文奖,以及 2013 年 IEEE/WIC/ACM 网络智能国际会议最佳学生论文奖。

![]()

戴文渊,第四范式有限公司创始人兼首席执行官。曾任百度首席架构师和高级科学家、华为诺亚方舟实验室首席科学家。入选 2017 年《麻省理工科技评论》中国青年科技创新人才榜(TR35)发明家和 2017 年《财富》中国 40 位 40 岁以下商界精英。

![]()

潘嘉林,新加坡南洋理工大学计算机科学与工程学院教务长讲座副教授。2018 年被《IEEE 智能系统》评选为 “10 大 AI 青年科学家”(AI 10 to Watch)。

最后,为了满足读者们的学习热情,机器之心特别向读者赠送 20 本《迁移学习》。读者可以在留言区写下自己对于迁移学习的理解或学习动机,获赞最多的前 20 名读者将获赠此书。

新书已开售,点击阅读原文获取详情。