【深度】北京理工大学夏元清教授等:基于压缩动量项的增量型ELM虚拟机能耗预测

【导读】在基础设施即服务的云服务模式下,准确的预测虚拟机的能耗,对不同物理机之间进行虚拟机调度的调度策略和迁移合并策略的制定具有重要意义,同时可以降低能源消耗,有益于环境保护,而且有利于制定合理的定价策略。

邹伟东, 夏元清. 基于压缩动量项的增量型ELM虚拟机能耗预测. 自动化学报, 2019, 45(7): 1290-1297.

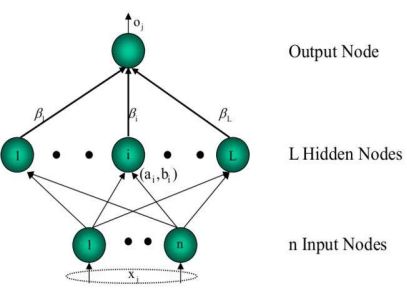

虚拟机能耗模型具有非线性、强耦合和时变性的特征, 物理服务器的负载、CPU利用率和内存利用率都会对虚拟机能耗预测产生重要影响, 因此, 它的预测模型难以通过机理法用简单的数学公式或传递函数进行描述。当前伴随人工智能技术的快速发展, 研究人员利用人工智能技术解决虚拟机能耗预测的相关问题, 其中基于神经网络的机器学习方法在虚拟机能耗预测中的应用尤其突出。神经网络能加快计算速度, 可利用有限的参数描述较为复杂的系统。神经网络建模相对于机理建模方法的主要优点是无需具体的数学公式,更适用于长期预测, 它能更灵活地获取虚拟机能耗参数和非线性特性, 使得神经网络对虚拟机能耗建模更具有吸引力。鉴于神经网络在建模中的优势, 其在虚拟机能耗建模中的应用越来越广泛。但支持向量机(SVM)、BP神经网络、RBF神经网络等传统神经网络需人为设定许多的神经网络训练参数, 以迭代的方式更新参数, 容易陷入局部优化, 导致网络训练误差较大。

近年来, 增量型极限学习机(Incremental Extreme Learning Machine, I-ELM)在机器学习中备受青睐, 其原因在于增量型极限学习机的算法步骤少, 不需要迭代更新一些神经网络参数, 学习速度非常快, 并且不会产生局部最优解, 具有良好的泛化性能, 有效地克服了传统神经网络所存在的诸多缺陷, 充分发挥了其在机器学习中的巨大优势, 也促进了人工智能的进一步发展。I-ELM采用增量式算法自适应地选取隐含层节点, 在算法迭代过程中随机产生隐含层节点参数, 利用最小二乘法计算其所对应的输出权值。尽管算法实现简单, 但是增量型极限学习机中存在输出权值较小的隐含层节点, 导致许多隐含层节点对最终网络输出起到的作用很小。大量冗余的隐含层节点只能增加网络结构的复杂性, 降低学习效率; 同时, 由于收敛速率较低, 增量型极限学习机通常需要更多的隐含层节点, 有时甚至超过学习样本的数量,因此研究高效的预测方法对虚拟机能耗预测具有十分重要的意义。

ELM网络结构

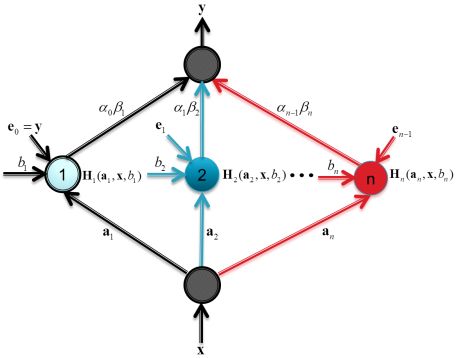

针对基于传统的增量型极限学习机(I-ELM)的预测模型存在许多降低虚拟机能耗预测准确性和效率的冗余节点, 在现有I-ELM模型中加入压缩动量项将网络训练误差反馈到隐含层的输出中使预测结果更逼近输出样本, 能够减少I-ELM的冗余隐含层节点, 从而加快I-ELM的网络收敛速度, 提高I-ELM的泛化性能。

基于压缩动量项的增量型极限学习机拓扑结构图

本文分析了国内外虚拟机能耗预测和增量型极限学习机的研究进展, 针对增量型极限学习机因存在大量冗余节点, 致使网络结构复杂, 降低网络收敛速度, 通过引入压缩动量项优化增量型极限学习机网络结构, 提出了基于压缩动量项的增量型ELM虚拟机能耗预测方法, 实现了对虚拟机能耗的高效精准预测。然而本文仅针对5个虚拟机进行预测建模, 如何对大规模的虚拟机集群进行预测建模,仍需进一步进行实验验证。

作者简介

邹伟东, 北京理工大学自动化学院博士后. 主要研究方向为极限学习机、云数据中心优化调度管理.

E-mail: zouweidong1985@163.com

夏元清, 北京理工大学自动化学院教授. 主要研究方向为云控制、云数据中心优化调度管理、智能交通、模型预测控制、自抗扰控制、飞行器控制和空天地一体化网络协同控制. 本文通信作者.

E-mail: xia_yuanqing@bit.edu.cn

来源:AAS自动化学报

【重要通知】关于开展2019年度中国自动化学会会士候选人提名工作的通知

【重要通知】关于2019年度CAA科学技术奖励推荐工作的通知

【重要通知】关于开展2019年度中国自动化与人工智能创新团队奖推荐工作的通知

【CAA】中国自动化学会选举产生第十一届理事会领导机构(内附名单)

热烈祝贺中国自动化学会常务理事、火箭军工程大学教授胡昌华荣获中共中央军委通令记功

地址:北京市海淀区中关村东路95号

邮编:100190

电话:010-82544542(综合)

010-62522472(会员)

010-62522248(学术活动)

010-62624980(财务)

传真:010-62522248

邮箱:caa@ia.ac.cn

官方微信公众号(英文)

名称:CAA OFFICIAL

微信号:caaofficial

会员微信公众号

名称:CAA会员服务

微信号:caa-member