2019年Reddit机器学习17个高赞项目:AI德扑大师、StyleGAN等上榜

新智元报道

新智元报道

来源:Medium

编辑:大明

【新智元导读】本文是Medium网友整理的2019年Reddit机器学习板块热门高赞项目资源汇总,既有Facebook、英伟达等大厂的作品,也有网友自制的有趣小尝试,共17个项目,按热度高低排序,一起看看吧!戳右边链接上 新智元小程序 了解更多!

本贴总结了2019年Reddit机器学习板块中分享的17个令人印象深刻的项目、研究、demo以及更多相关内容。其中既包括AI大厂的高光项目(GPT-2、StyleGAN等),也有小团队甚至个人做出的有趣的东西。希望小伙伴们能在这些精选资源中获得自己的收获。

1,少量无监督的图像到图像翻译(913⬆️)

“本项目的灵感来自人类自身。人可以从少量示例中获取新对象的本质,并进行概括。本项目实现了一种无监督模式的图像到图像转换算法,在测试时仅由几个示例图像加以确定,就能用于之前未见过的新目标类。

资源地址:https://github.com/NVlabs/FUNIT

2,二次元小姐姐生成器(521⬆️)

作者提出了一种能够绘制漫画的人工神经网络。Waifu可选择喜欢的角色,并在此基础上生成喜欢的动漫。

资源地址:https://waifulabs.com/

3,最大的机器学习数据集列表(499⬆️)

本列表收录了一系列可以用于机器学习实验的机器学习数据集。这种资源肯定可以减少在线查找数据集所需的时间。数据集按任务类别/领域进行细分,包括:计算机视觉,自然语言处理,自动驾驶,质量检查,音频、医疗应用,还可以选择按许可类型排序。

资源地址:https://www.datasetlist.com/

4,数据集:480000条“烂番茄”影评资源库,已标记为新鲜/烂(464⬆️)

作者在互联网上收集大量的“烂番茄”网站的影评,这些数据在NLP任务中可能非常有用。

资源地址:

https://github.com/nicolas-gervais/6-607-Algorithms-for-Big-Data-Analysis/blob/master/scraping%20all%20critic%20reviews%20from%20rotten%20tomatoes

数据集可在Google云盘上下载

https://drive.google.com/file/d/1N8WCMci_jpDHwCVgSED-B9yts-q9_Bb5/view

5,使用ML创建“猫门”,当猫嘴里有猎物时会自动锁门(464⬆️)

这篇文章是关于使用机器学习创建的猫门。视频中的讲者创建了一个“猫门”,如果猫的嘴里有东西,就会自动锁门15分钟。这能防止猫咪将死动物带入房屋。作者将摄像头连接到猫的门上,然后应用机器学习来检查猫的嘴里是否有东西。

视频:https://youtu.be/1A-Nf3QIJjM

6,基于神经点的图形(415⬆️)

作者提出了一种基于点的新方法来对复杂场景进行建模。使用原始点云作为场景的几何表示。然后用可学习的神经描述符扩充每个点。神经描述符对局部几何形状和外观进行编码。通过将点云进行栅格化,从新视点传递到深度渲染网络中,获得新的场景视图。

论文:https://arxiv.org/abs/1906.08240

7,AdaBound:一种基于PyTorch实现的优化器,训练速度堪比Adam,质量堪比SGD(ICLR 2019)

AdaBound是一种优化程序,旨在提高不可见的数据的训练速度和性能,可用PyTorch实现。

资源地址:https://github.com/Luolc/AdaBound

8,Facebook与卡内基梅隆大学联合打造德州扑克AI,在6人比赛中击败职业玩家(390⬆️)

“Pluribus是第一款能够在六人无限注德州扑克击败人类专家的AI,这是AI第一次在超过两个玩家的复杂游戏中击败顶级人类玩家。

Facebook博客:https://ai.facebook.com/blog/pluribus-first-ai-to-beat-pros-in-6-player-poker/

9,各种ML模型的NumPy实现(388⬆️)

作者在项目页面上:“ numpy-ml是越来越多的专门用NumPy和Python标准库编写的机器学习模型、算法和工具的集合。”

资源:https://github.com/ddbourgin/numpy-ml

10、17种深度强化学习算法的PyTorch实现(388⬆️)

作者列出了17种深度强化学习算法的PyTorch实现。包括DQN,DQN-HER,DoubleDQN,REINFORCE,DDPG,DDPG-HER,PPO,SAC,离散SAC,A3C,A2C等。

资源:

https://github.com/p-christ/Deep-Reinforcement-Learning-Algorithms-with-PyTorch

11、100万张AI生成的假脸(373⬆️)

用NVIDIA的StyleGAN生成的100万张假脸。这些脸看起来与真人完全一样。

资源:https://archive.org/details/1mFakeFaces

12,教神经网络开车(358⬆️)

“本项目教神经网络如何驾驶汽车。这个网络很简单,具有固定数量的隐藏节点(没有NEAT),没有偏差。然而,经过短短几代的学习,它成功学会了快速安全地驾驶汽车。“该网络通过随机突变后成功学会了开赛车。”

视频:https://youtu.be/wL7tSgUpy8w

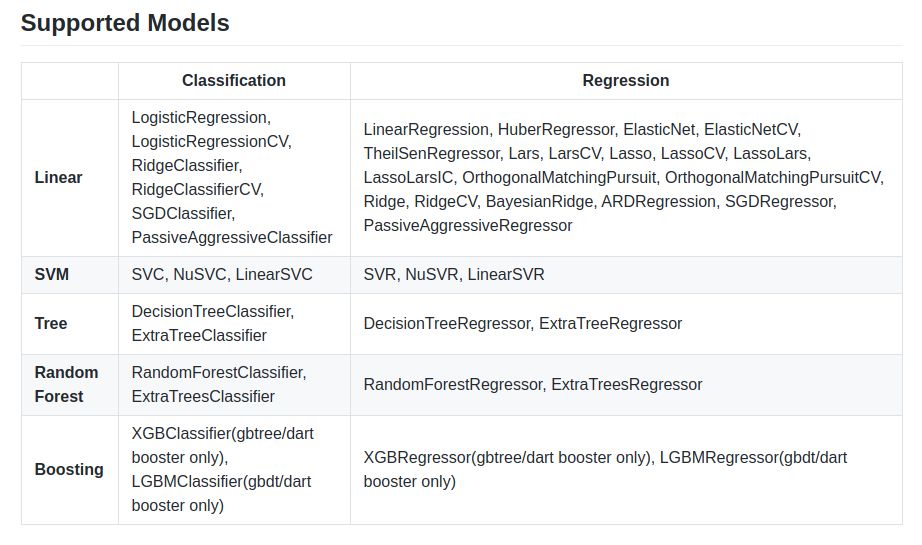

13,一个简单库,将机器学习模型转换为本地代码(Python / C / Java)(345⬆️)

m2cgen(模型2代码生成器)是一个轻量级库,可以提供简便方法,将经过训练的统计模型转换为本地代码。(支持Python,C,Java,Go,JavaScript,VisualBasic,C#)。”

地址:https://github.com/BayesWitnesses/m2cgen/

当前支持的模型如下:

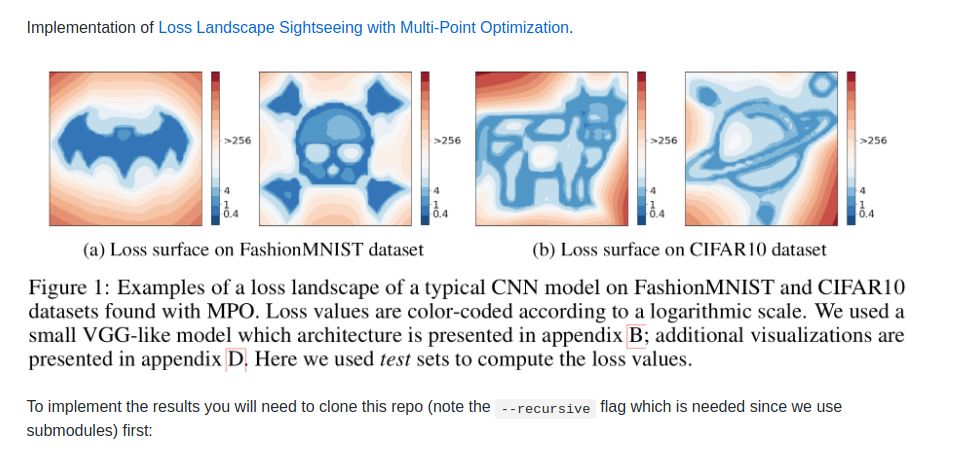

14,探索神经网络的损失情况(339⬆️)

摘自作者的帖子:“该帖子是为了在神经网络的损失平面中找到不同的模式。通常,损失最小值处就像是一个坑,其周围是随机分布的丘陵和山脉,但也存在更有意义的坑,如下图所示。

资源:https://github.com/universome/loss-patterns

论文:https://arxiv.org/abs/1910.03867

“结果表明,我们几乎可以找到自己喜欢的任何损失的最小值。有趣的是,结果的横向模式对于测试集也仍然有效,也就是说,这是一种很可能在整个数据分布上都有效的属性。”

15,OpenAI基于GPT-2的Reddit 机器人(343⬆️)

本项目构建了一个由OpenAI的GPT-2驱动的Reddit机器人。相关代码可以在下面的资源中找到。

资源:https://github.com/shevisjohnson/gpt-2_bot

16,Super SloMo:一个卷积神经网络,可将任何视频转换为slomo视频(332⬆️)

论文:https://people.cs.umass.edu/~hzjiang/projects/superslomo/

代码:https://github.com/avinashpaliwal/Super-SloMo

17,NLP的预训练模型库:Bert,GPT,GPT-2,Transformer-XL,XLNet,XLM(306⬆️)

这是用于NLP的预训练Transformer模型的开源库。它具有六种架构,分别是:

Google的BERT

OpenAI的GPT和GPT-2

Google / CMU的Transformer-XL和XLNet

Facebook的XLM

该库为这些架构提供了27种预训练的模型权重。

资源:https://github.com/huggingface/transformers

原文链接:

https://heartbeat.fritz.ai/best-of-machine-learning-in-2019-reddit-edition-5fbb676a808

-

与国内外一线大咖、行业翘楚面对面交流的机会 -

掌握深耕人工智能领域,成为行业专家 -

远高于同行业的底薪 -

五险一金+月度奖金+项目奖励+年底双薪 -

舒适的办公环境(北京融科资讯中心B座) -

一日三餐、水果零食

新智元邀你2020勇闯AI之巅,岗位信息详见海报: