GPT-3杀入漫威宇宙!二次元小伙用它生成蜘蛛侠续集

![]()

新智元报道

新智元报道

编辑:袁榭 拉燕 好困

【新智元导读】GPT-3的成就目录中又新添一项:成功生成了戏剧结构完备、语言通顺的28页《蜘蛛侠·英雄回不去家》电影剧本了。

既然GPT-3能循理路精炼总结语料文本,写诗可以、写rap歌词可以,那么照猫画虎写小剧本,也不是不可以的……吧?

其实真是可以的,而且有人已经如此操作了。

AI新玩法:生成蜘蛛侠电影剧本试试?

AI新玩法:生成蜘蛛侠电影剧本试试?

Youtube上的简笔动漫Up主Bradius尝试向高难度挑战:拿GPT-3生成一个蜘蛛侠系列电影剧本。

在看完《蜘蛛侠:英雄无归》后,Bradius觉得这部电影好好看、只看单一版本实在太浪费了。为何不拿AI生成蜘蛛侠电影的衍生「续集」剧本呢?

虽然蜘蛛侠这个IP在被漫威买回去前后,每部戏都是成本至少过亿美元的大制作,《英雄无归》的成本是两亿美元。

不过大制作的钱是花在大明星、大布景、大特效、大宣发上,剧本嘛……无非是过场+打斗+青春恋爱+「能力越大责任越大」的叔叔/阿姨死掉桥段。

用AI挑战一下人类编剧,应该没问题!

RNN做编剧失败:台词多乱码

RNN做编剧失败:台词多乱码

首先,Bradius用谷歌Colab推出的一款基于「递归神经网络」(RNN)的文本生成器尝试了两次。

我们来看看都生成了什么东西出来:

「彼得走了过去,不断用手抓着自己的头发...」

彼得:「我难以置信你居然要『过他』?」

「彼得?」

「彼得张了张嘴,但是并没有发出声音。」

「突然,米歇尔的脸上浮现出了一抹笑容。」

米歇尔:「我只是在开玩笑啦。」

「我不在乎。」

「拜拜。」

彼得:「好吧,那接下来我们应该跑点#¥%…*&...」

米歇尔:「噢,是的,嗯,我真的不是很想庆祝~!#¥%……&*」

等等...看到这里先打住,有没有发现,其实挺不通顺的?

从第二句的「过他」开始,画风就开始不对了。更不必说后面都开始生成一些乱七八糟的东西,什么drissanced、cobbwice。

小编看到还以为是什么技术词汇,没想到一查,根本查无此词。

......那不就是狗屁不通吗?

紧接着,作者又突发奇想,打算把蜘蛛侠系列的所有电影剧本文本全都灌进RNN。

并且,这次要让模型被这些语料训练200次,看看效果如何。

彼得:「拉拉扯扯。」

「冯·托克斯吗?K Rimp用。」

「他们不多。」

「噢。」

「哦不。」

打住吧。键盘上撒一把米让小鸡来啄都比这个效果好。

这比上次还要差,可以说通篇都是胡言乱语。生成的文本好像把所有电影里的人物形象、性格、剧本风格全都乱七八糟的揉在一起了。

看来,用RNN这个办法行不通。

没关系,作者还有Plan B。

GPT-3做编剧大成功:剧本饱满且有戏剧张力

GPT-3做编剧大成功:剧本饱满且有戏剧张力

拿Jeff Dean家的RNN文本生成器没搞定,那用其他家的文本生成AI试试看?

Bradius发现现在基于GPT-2的文本生成API已经俯首可得了,但……GPT-3不是早就出了么?

Bradius盛赞GPT-3是「用整个互联网训练出的」、是「全网最聪明的AI」,决定就拿它来写蜘蛛侠「续作」剧本。

加持GPT-3的偷懒人类,只要输入一句「以下是漫威宇宙中下一部蜘蛛侠电影的整个泄露剧本」,AI就哗哗输出了28页戏剧结构完备工整的合规电影剧本。

这剧本故事结构齐全,也带有漫威宇宙中的特色梗。

Bradius本以为AI不能取代人类编剧、输出匹敌作品,结果拿到28页长的过硬剧本,自己也懒得全部画成动画再做视频了,只做个简洁版。

Bradius还表示,因为联系不上荷兰弟,所以动画里的蜘蛛侠他自己配音了,「想必荷兰弟不会介意的」。

以下是恶搞版《蜘蛛侠》续集《英雄回不去家》之简版「预告片」:

出片头:「Bradius工作室出品,与索尼无关,索尼不要起诉我。」

手机响起,梅姨的声音切入:「彼得,我会永远伴随你身边。」

年幼的彼得·帕克怒白:「在我需要的时候,你从来不在我身边!我去上学去了,而且不会回来了!」

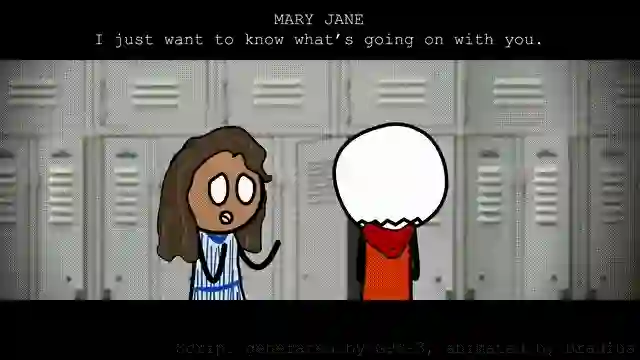

学校里,玛丽·简拦住彼得·帕克:「你现在到底怎么了?我很担心。」

彼得·帕克绕过玛丽·简:「我很好,不关你事。」

玛丽·简摇头:「你现在好像不认识我了一样。」

彼得·帕克:「可能咱们的确没有真认识过!」

切镜头,布景换掉作为幕后大反派的漫威高管办公室,色调只有黑白两色。

漫威高管1:「你说下一部蜘蛛侠电影的预算要裁掉两亿美元?」

漫威高管2:「是的。」

再切镜头,打戏专用胡渣肌肉男反派Kraven穿越登场,念白:「你想跑哪去,迈尔斯?你以为逃得掉么?」

(迈尔斯·摩拉勒斯是多重宇宙设定中的另一个黑人蜘蛛侠。)

彼得·帕克与迈尔斯·摩拉勒斯两个红黑蜘蛛侠围殴Kraven。

红黑蜘蛛侠打斗中渐落下风。正在危急时,突然有无名黑枪射杀Kraven。

彼得·帕克被捉进局子里,审讯室里的查案人员说:「你年纪小小,救人多多,但你现在麻烦大了。」

彼得·帕克从审讯室墙角的孔洞溜走。

镜头切到一台笔记本电脑上,屏幕中是新闻播报:「本台刚刚获悉,某杀人嫌疑犯从警方羁押中逃脱,现下落不明。」

笔记本电脑合上,全身镜里的彼得·帕克穿上红蜘蛛侠套装。

最后,出预告片尾广告词。

这个剧本,有过门、有转折、有起伏、有悬念。节奏张弛相间,素材丰富多元。是不是非常过硬、毫无机器生成痕迹?

有人评论得更到位:「虽然没看,但感觉比《莫比乌斯》要好得多。」

(《莫比乌斯》是漫威宇宙新出的、Jared Leto主演的科技风吸血鬼题材渣片,口碑仆街,IMDB评分5.2,烂番茄评分17%)

拿GPT-3生成剧本的不止Bradius一个。

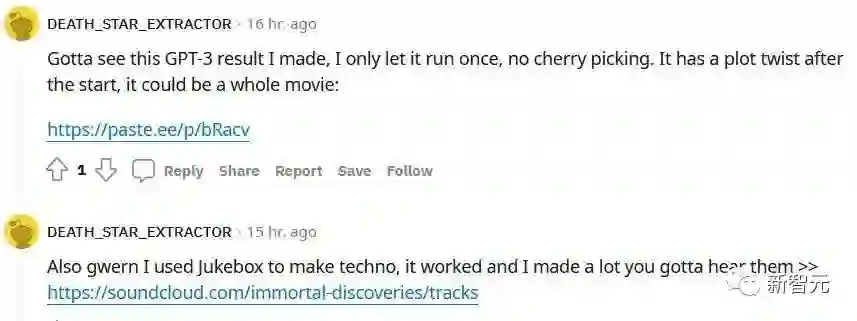

在纪念GPT-3面世两周年的帖子里,也有一位ID为「死星挖掘机」的网友,只调了下词频等参数,拿GPT-3一次性生成了一段「冰箱落地砸断我腿」的家庭情景剧小剧本。还配了曲调,当成卡拉OK来唱。

虽然批评者称GPT-3不脱高级复读机范畴、完全只靠大力出奇迹。但由此可见,如此高档的复读机,已经可以通过深度学习,从自然语言的文本中提取出叙述的理路。

参考资料:https://www.youtube.com/watch?v=7sOmGa6cqFE