ICML | 最佳论文作者系华人;Google独占入选论文的6.3%

作为国际顶级的机器学习会议,ICML与NIPS一起,成为了机器学习与人工智能研究领域影响力极高的两个主要会议。今年的ICML于8月6在澳大利亚悉尼开幕,为期六天。

早在5月时,ICML 2017被接受的论文就已经公布了。今年的ICML收到了创纪录的1676篇论文,434篇被接受,录取率为 25.89%,创下了新记录。

今天,ICML公布了2017 公布了最佳论文、Test of Time Award 、荣誉提名论文,本次共7篇获奖论文。以下由乌镇智库带你梳理这七篇优秀论文。(后附论文下载地址)

ICML获奖论文

ICML 2017最佳论文奖

最佳:Understanding Black-box Predictions via Influence Functions

作者:Pang Wei Koh, Percy Liang

简介:如何解释黑箱模型的预测呢?这篇论文利用影响函数(稳健统计学中的经典技术),通过学习算法跟踪模型的预测并追溯到训练数据,从而确定对给定预测影响最大训练点。为了将影响函数扩展到现代机器学习中,论文中设计了一个简单,高效的实现,仅需梯度oracle访问和Hessian矢量积。而且即使在非凸和非微分模型上,影响函数的近似值算法仍然可以提供有价值的信息。在线性模型和卷积神经网络中,论文中也证明,影响函数可用于理解模型行为,调试模型,检测数据集错误,甚至是生成视觉上无法区分的训练集攻击。

论文下载:

https://arxiv.org/pdf/1703.04730.pdf

值得一提的是,最佳论文的两位作者都是华人。

荣誉奖(Honorable Mentions)

论文:Lost Relatives of the Gumbel Trick

作者:Matej Balog, Nilesh Tripuraneni, Zoubin Ghahramani, Adrian Weller

简介:Gumbel是从离散概率分布中抽样或估计其规格化配分函数的方法,它会以特定方式重复地对分布进行随机扰动,每次解决最可能的配置。论文中得出了一系列相关方法,其中包括Gumbel,这些新方法在几种情况下具有优异的属性,同时仅需最小的额外计算成本。特别的,要让Gumbel在离散图模型中产生计算优势,Gumbel扰动通常会被低秩扰动(low-rank perturbation)取代。而论文中的一种新方法,可以为Gibbs分布生成一系列连续抽样器。论文最后还展示了,Gumbel的简单的解析形式如何得到额外的理论成果。

论文下载:

https://arxiv.org/pdf/1706.04161.pdf

论文:Modular Multitask Reinforcement Learning with Policy Sketches

作者:Jacob Andreas, Dan Klein, Sergey Levine

简介:论文描述了一个以策略草图(policy sketches)为指导的多任务深度增加学习框架。草图使用指定的子任务序列注释任务,提供关于任务之间的高级结构关系的信息,但没有如何实现的信息。为了从草图中学习,论文中提出了一个将每个子任务与模块化子策略相关联的模型,并通过在共享子策略之间绑定参数,共同最大限度地提高对完整任务特定策略的回报。论文中在三种环境中评估了方法的有效性,包括离散和连续控制环境,以及仅在完成一些高级子目标之后才能获得稀少奖励的情况。实验表明,用论文中的方法学习草图指导的策略,比现有的学习特定任务策略或共享策略的技术表现更好。

论文下载:

https://arxiv.org/pdf/1611.01796

论文:A Unified Maximum Likelihood Approach for Estimating Symmetric Properties of Discrete Distributions

作者:Jayadev Acharya, Hirakendu Das, Alon Orlitsky, Ananda Suresh

论文下载:

http://people.ece.cornell.edu/acharya/papers/pml-opt.pdf

ICML 2017 “时间考验”奖(Test of Time Award)

最佳:Combining Online and Offline Knowledge in UCT

作者:Sylvain Gelly and David Silver

简介:UCT算法使用基于样本的搜索在线学习值函数。 TD(λ)算法可以离线学习一个价值函数,用于策略分配。我们考虑了在UCT算法中组合离线和在线值函数的三种方法。首先,在Monte-Carlo模拟中,离线值函数被用作默认策略。其次,UCT值函数与快速在线估计的行动值(action value)相结合。第三,离线值函数用作UCT搜索树中的先验知识。我们在9 x 9 Go GnuGo 3.7.10中评估这些算法。第一种算法比随机模拟策略优于UCT,但令人惊讶的是,比更弱的手工模拟策略更差。第二种算法完全胜过UCT。第三种算法胜过拥有人工先验知识的UCT。我们将这些算法结合在MoGo中,它是世界上最强大的9 x 9 Go程序。每种技术都显著提高了MoGo的发挥力度。

论文下载:

http://suo.im/2Ki4I

荣誉奖(Honorable Mentions)

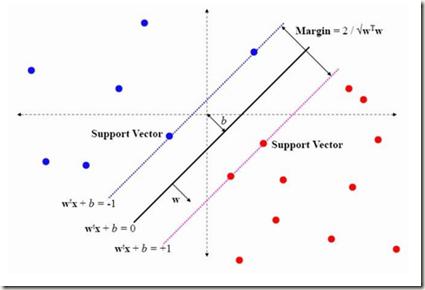

论文:Pegasos: Primal estimated sub-gradient solver for SVM

作者:Shai Shalev-Shwartz, Yoram Singer, Nathan Srebro

简介:我们描述和分析了一个简单有效的随机子梯度下降算法,用于解决支持向量机(SVM)提出的优化问题。我们证明获得精度εε求解所需的迭代次数为Õ(1 /ε)O〜(1 /ε),其中每次迭代在单个训练样本上运行。相比之下,先前对SVM的随机梯度下降法的分析需要Ω(1 /ε2)Ω(1 /ε2)迭代。如先前设计的SVM求解器,迭代次数也以1 /λ线性缩放,其中λ是SVM的正则化参数。对于线性内核,我们的方法的总运行时间是Õ(d /(λε))O〜(d /(λε)),其中d是每个示例中非零特征数量的约束。由于运行时间不直接取决于训练集的大小,因此得到的算法特别适合于从大型数据集学习。我们的方法也扩展到非线性内核,同时仅基于原始目标函数,尽管在这种情况下,运行时确实依赖于训练集大小。我们的算法特别适用于大文本分类问题,在这些问题中,我们展示了超过以前的SVM学习方法的数量级加速。

论文下载:

http://suo.im/2kC6PR

论文:A Bound on the Label Complexity of Agnostic Active Learning

作者:Steve Hanneke

简介:我们研究了不可知PAC模型中基于池的主动学习的标签复杂度。 具体来说,我们得出了Balcan,Beygelzimer和Langford提出的A2算法所做的标签请求数量的一般界限(Balcan et al. , 2006)。 这代表了不可知PAC模型中标签复杂度的第一个非常重要的通用上限。

论文下载:

http://suo.im/2wFVX3

腾讯AI Lab入选四篇论文

据了解,腾讯 AI Lab 也有四篇论文入选 ICML 2017,此前,腾讯AI lab曾有六篇论文入选CVPR。在人工智能的几大主要领域,腾讯越发体现出自己的优势。

本次入选论文分别是:

Efficient Distributed Learning with Sparsity

高效的分布式稀疏学习

论文作者:王佳磊(芝加哥大学),Mladen Kolar(芝加哥大学), Nathan Srebro(丰田芝加哥技术研究院),张潼(腾讯 AI Lab)

论文简介:论文中介绍了一种新颖、高效的分布式稀疏学习方法,数据可以随机分配在多台计算机中进行学习。在所提方法的每一轮中,下属工作计算机会根据其上的数据计算损失梯度,总计算机则会对一个偏移的 L1 正则化损失最小值问题求解。可以证明,在经过一定数量的循环后,这个分布式方法的估计误差可以达到中心化计算的同等水平,而循环数量仅仅与计算机数目的对数成正比,而且与问题中其它的参数无关。

论文地址:

http://t.cn/R9WJQac

Projection-free Distributed Online Learning in Networks

无需投影的网络中的在线分布式学习

论文作者:张文鹏(清华大学计算机系),Peilin Zhao(蚂蚁金服人工智能部),朱文武(清华大学计算机系“千人计划” 教授,IEEE、AAAS、SPIE Fellow),Steven C. H. Hoi(新加坡大学信息系统学院),张潼(腾讯 AI Lab)

论文简介:条件梯度算法由于其应对大规模机器学习问题时高效的特点,近几年来重新成为了研究的热门话题。然而,目前为止的研究都没有考虑过在线分布式环境下的算法表现,这种情况下本地的计算量就很轻微。在这篇论文中,作者们提出了在线分布式状况下的条件梯度算法,通过应用简单得多的线性优化步骤,避免了算法副本中高成本的投影操作,填补了这一研究空白。作者们在所提的算法中加入了一个约束边界,它是网络大小和拓扑形式的函数,对于更小的图或者连接状况更好的图,这个边界就会越小。根据两个真实的大规模数据集进行的多类别分类任务实验表明了所提算法带来的计算优势,并且验证了理论的约束边界。

论文地址:

http://t.cn/R9WJdob

GSOS: Gauss-Seidel Operator Splitting Algorithm for Multi-Term Nonsmooth Convex Composite Optimization

GSOS:用于多项非平滑凸组合优化问题的高斯 - 赛德尔算子分裂算法

论文作者:沈力(腾讯 AI Lab),刘威(腾讯 AI Lab),Ganzhao Yuan(中山大学),Shiqian Ma(香港中文大学)

论文简介:这篇论文中介绍了一种快速的“高斯 - 赛德尔”算子分裂算法(Gauss-Seidel Operator Splitting,GSOS),用于解决多项非平滑凸组合优化问题;这种算法未来可以在机器学习、信号处理和统计中得到广泛运用。所提的 GSOS 算法继承了高斯 - 赛德尔算法的优点,能够加速优化过程,并且借助算计分裂技巧降低了计算复杂度。另外,作者们还开发了一种新技术来为GSOS算法建立全局收敛。具体来说,作者们首先重构GSOS的迭代过程,通过应用算子优化理论让它成为一个两步的迭代算法。接下来,作者们基于这个两步的迭代算法重构建立了GSOS的收敛。最后,作者们应用这种GSOS算法解决重叠群套索和图引导稠套索问题。数值实验结果表明所提的GSOS算法在效率和有效性方面都比当前最好的方法有提升。

论文地址:

http://t.cn/R9WiZge

Scaling Up Sparse Support Vector Machines by Simultaneous Feature and Sample Reduction

同时降低特征和样本数量,提高稀疏SVM的规模

论文作者:张卫忠(浙江大学计算机系),Bin Hong(密歇根大学),刘威(腾讯 AI Lab),Jieping Ye(密歇根大学),Deng Cai(浙江大学计算机系),Xiaofei He(浙江大学计算机系),Jie Wang(密歇根大学)

论文简介:稀疏支持向量机(SVM)是一种常见的分类方法,它可以同时学习一组数量不多、解释性强的特征并找到支持向量。这种方法在许多实际应用中都取得了不错的效果。然而,在样本数量非常多、特征维度非常高的大规模问题中,求稀疏SVM仍然是一个有难度的问题。作者们注意到稀疏SVM会导致特征空间和样本空间都出现稀疏性,从而提出了一种全新的方法,它基于对原始和双重优化SVM的精确估计,然后同时找到能够确认与输出相关的支持向量和样本。这样,作者们就可以从训练过程中去掉已经找到的非活动样本和特征,从而在不降低正确率的前提下显著降低内存占用和计算成本。据作者们所知,所提的这种方法是第一个用于稀疏SVM的统计性特征和样本削减方法。论文中分别基于生成的和真实数据集进行了实验(真实数据集例如包含大约2千万样本和3千万特征的kddb数据集),结果表明所提的方法相比现有方法得到了明显提升,而且所提的方法有若干数量级的速度提升。

论文地址:

http://t.cn/R9Wib0b

工业界论文比重增加

此外,值得注意的是,本次ICML大会,科技公司大批量涌入,占据了论文数量的四分之一,而Google便独占了6.3%。

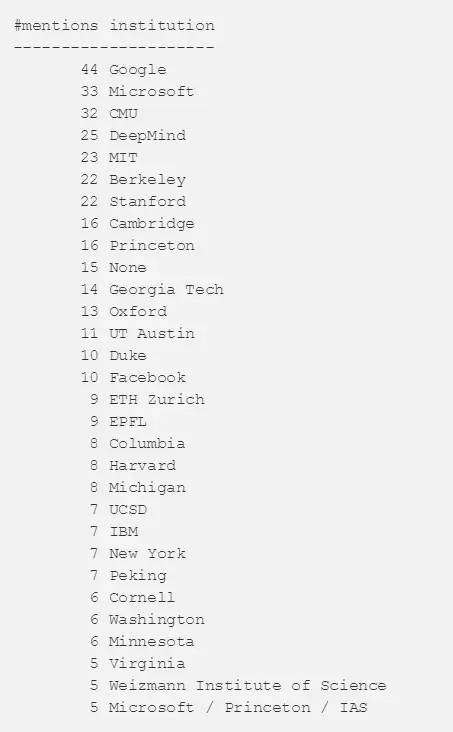

对所有论文进行分析,我们发现,所有论文中共出现了961个机构名称,其中420个只出现了一次。论文数前30名的机构如下:

统计中Google和微软的论文数排在了前两名,CMU排第三。需要注意的是,统计中Google、Google公司、Google大脑和Google Research都属于一个类别,同样的还有斯坦福和斯坦福大学。一篇论文中多个人属于同一机构时会合并。

从这些统计中也可以看出,工业界发表的论文占了不小的比例。Karpathy统计了一些比较知名的工业界实验室的论文状况,比如DeepMind、Google、微软、Facebook、IBM、迪士尼、亚马逊和Adobe,发现他们的论文占论文总数的14%。而如果算上其它不太知名业界公司的论文,他认为约20-25%的论文有公司参与。也就是说,ICML 2017的论文中约四分之三是完全来自学术界。

另外,由于DeepMind和Google可以算一家,加在一起它们共参与60篇论文,占总论文的6.3%。

逐年分析这些论文可以发现,在2011年时很少有工业界研究出现在ICML上。而现在公司的参与有了很显著的提高。不过学术界仍然做得很好,贡献了很大一部分论文。

还有其它一些比较有趣的统计数据。

以第一作者身份论文被接受最多的是一位中国研究者朱泽园,他有5篇论文被接受。他如今在北美的微软研究院工作。

对第一作者所在机构进行统计,排名前五的是CMU(25),Google(19),DeepMind(15),MIT(14)和UCB(14),可见Google的实力。微软研究院以10篇排在第七。

纯数量统计并不能反应真实的研究状况,一个更重要的指标或许是论文被引用的情况,毕竟论文不是生来平等的。工业界与学术界内容被引用的情况如何,这点还没有统计。

ICML也也是窥见机器学习最新趋势的途径之一。深度学习当然是重要的内容,但经检索标题发现,只有6篇文章含这一关键词。其它出现频率较高的研究领域还有:强化学习,随机及高斯过程,嵌入(embeddings),贝叶斯优化,AutoML(用机器学习探索神经网络架构)等。

除了论文,ICML上最受关注的要属每天的主题演讲了。今年大会安排了四场主题演讲,涵盖了AI的前沿、应用和社会影响等方面。

四大演讲主题

牛津大学Peter Donnelly

他演讲的主题是:基因组学、大数据与机器学习:理解生命图普,推动医疗革命。

演讲会通过具体的例子来说明,将机器学习和其他推理工具应用于基因组数据的机会和挑战。

Donnelly是维康信托中心人类遗传学研究室主任和牛津大学统计学教授,以及Genomics Plc公司CEO。他是牛津大学博士,曾任伦敦大学和芝加哥大学教授。早期研究工作涉及人口遗传学随机模型的开发,后来逐渐开发研究遗传和基因组数据统计方法。和团队开发了多种广泛使用的统计算法,包括STRUCTURE和PHASE。他还领导了一个名为wWGS500的项目,在其中牛津大学与Illumina合作,对500名具有一系列临床条件的个体进行测序,以评估临床医学中全基因组测序的短期潜力,这一项目也是NHS 100000基因组计划的前身。

过去10多年,基因测序的成本呈指数级下降,而未来10多年,或许会有近10亿人进行基因测序。海量的基因数据与个人的病历信息和可穿戴设备信息的结合,将显著提高我们评估个体健康风险、预测健康状况以及做出个性化治疗的能力。

哈佛大学Latanya Sweeney

她的演讲主题是:AI设计者如何影响公民生活

作为哈佛大学政府和技术学院教授,Sweeney的使命是开发和运用技术,来评估和解决社会、政治和管理问题。她的重点研究领域是技术对人类的影响,她本人还是Technology Science总编辑 。她对数据隐私也很感兴趣,是哈佛数据隐私实验室主任。

她认为,技术设计者(Technology designer)是新的决策者。虽然他们没有经过选举,而且大多数人不知道他们的名字,但正是他们开发工具和创新时做出的决定,影响了那些能规范我们日常生活的代码。 隐私和安全是新技术的第一个挑战,而随着技术的进步,生活的方方面面都会被重新定义。

DeepMind的Raia Hadsell

她的演讲主题是:迈向现实世界的加强学习

她是DeepMind的高级研究科学家,在深度学习和机器人领域有10多年研究经验。她早期的研究与用暹罗网络进行多学科学习有关,这可以用于不变特征学习。她的博士导师是Yann LeCun,后来加入CMU的机器人研究所,以及SRI International。她在2014年初加入了DeepMind,开始研究通用人工智能。她目前的研究侧重于AI代理和机器人系统持续学习的挑战。

深度强化学习已经迅速发展成为颇具潜力的人工智能研究领域,大量的雅达利游戏也被用于许多基础开发的主要基准。随着研究的成熟,更重要的是开发复杂的学习系统,以解决更复杂的任务。她届时会介绍DeepMind的最近研究,这些研究与在现实世界和具有复杂任务结构的挑战性环境中进行端到端学习有关。

马克斯·普朗克智能系统研究所Bernhard Schölkopf

他的演讲主题是:因果学习

Schölkopf的主要研究领域是机器学习和因果推理。他将研究应用于许多不同的领域,比如生物医学问题、计算摄影和天文学。他曾在AT&T贝尔实验室和英国的微软研究院工作。他是德国科学院的成员,获得过国际模式识别协会的J.K. Aggarwal奖。

在机器学习中,会使用数据来自动寻找依赖关系,目的是对未来进行预测。大多数机器学习方法都建立在统计学上,当然也可以进一步分析数据在统计依赖性后的因果结构。Schölkopf认为,这样的因果知识可以帮助在机器学习任务中做出预测。他在演讲中也会提到因果模型对机器学习任务的影响,如迁移学习和半监督学习。

部分内容引用自“雷锋网”,作者:张弛、刘芳平

推荐阅读

《乌镇指数:全球人工智能发展报告2017》框架篇