Google “推翻”无监督研究成果!斩获 ICML 2019 最佳论文

作者 | 夕颜、Just

出品 | AI科技大本营(ID:rgznai100)

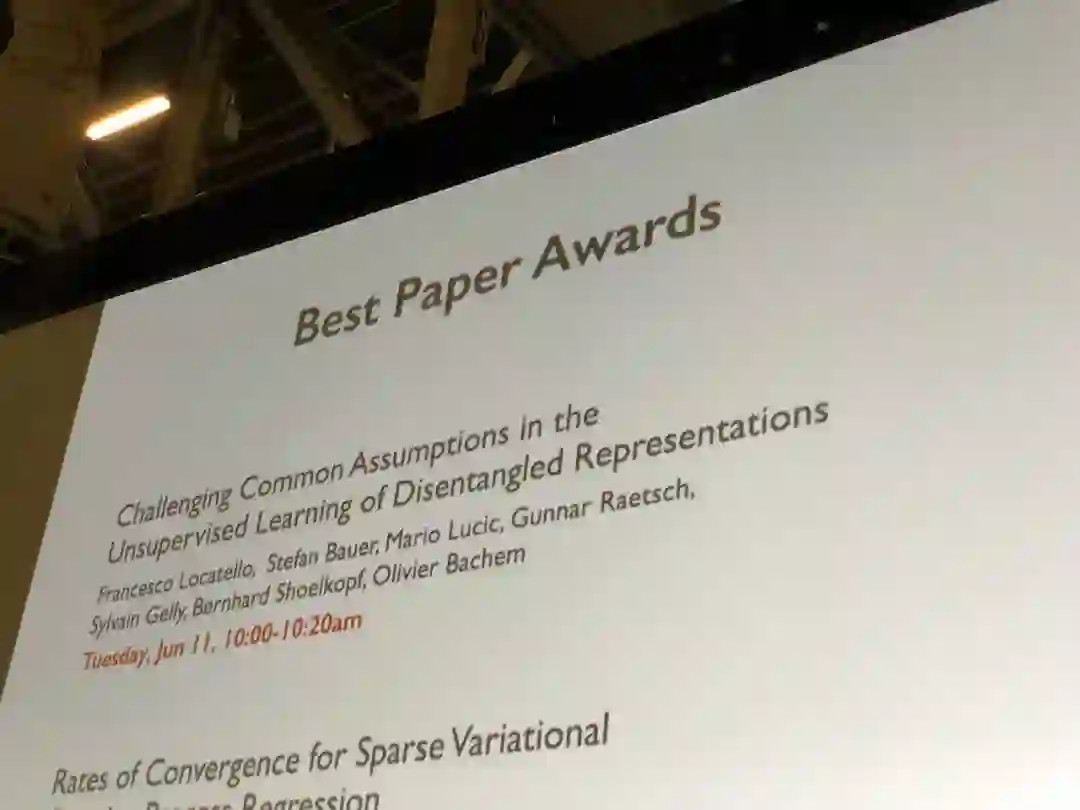

6 月 11 日,在美国加州长滩举行的 ICML 公布了 2019 年最佳论文奖,来自苏黎世联邦理工大学、谷歌大脑等的团队和英国剑桥大学团队摘得最佳论文奖项,此外,大会还公布了 7 篇获最佳论文提名的论文,获奖团队来自 DeepMind、牛津、MIT 等。据统计,此次大会共收到 3424 篇提交论文,深度学习、通用机器学习、强化学习、优化是提交最多的子领域,但最终录取的论文仅有 774 篇,谷歌更是成为被接受论文最多的霸主。

首先,我们来揭晓本届 ICML 两篇最佳论文:

Challenging Common Assumptions in the Unsupervised Learning of Disentangled RepresentationsRates of Convergence for Sparse Variational Gaussian Process Regression

最佳论文简介

论文标题:挑战无监督学习解耦表示中的常见假设

Challenging Common Assumptions in the Unsupervised Learning of Disentangled Representations

团队:来自苏黎世联邦理工学院(ETH Zurich)、MaxPlanck 智能系统研究所及谷歌大脑;

作者:Francesco Locatello, Stefan Bauer, Mario Lucic, Gunnar Rätsch, Sylvain Gelly, Bernhard Schölkopf, Olivier Bachem

论文地址:http://proceedings.mlr.press/v97/locatello19a/locatello19a.pdf

论文摘要:

无监督学习解耦表示背后的关键思想是,真实世界是由一小部分可解释的变量因子生成,这些因子可以通过无监督学习算法进行恢复。在这篇论文中,我们提出对这一领域最新进展有了清醒认知,并且挑战了某些常见假设。

首先,我们从理论上表明,如果没有对模型和数据的归纳偏差,无监督学习解耦表示基本不可能存在;其次,在七种不同的数据集中,我们以一种可重复的大规模实验研究中训练了超 12000 个模型,使用了最重要的方法和评估指标。我们观察到,尽管用不同的方法成功的促进了相应损失“鼓励”属性,但如果没有监督,则很难识别出好的解耦模型。

此外,增加解耦似乎不会降低下游任务学习样本的复杂性。我们的结果表明,解耦学习的未来研究工作应该明确归纳偏见和(隐式)监督的作用,研究该强制解耦学习表示的具体好处,并且考虑有多种数据集的可重复的实验设置。

2. 论文标题:稀疏高斯过程回归变分的收敛速度

Rates of Convergence for Sparse Variational Gaussian Process Regression

团队:英国剑桥大学、机器学习平台 Prowler.io

作者:David R. Burt,Carl E. Rasmussen,Mark van der Wilk

论文地址:https://arxiv.org/pdf/1903.03571.pdf

论文摘要

对高斯过程后验(Gaussian process posteriors)的优秀变量近似法的提出避免了数据集大小为N时 O(N3) 的缩放。它们将计算成本减少到了 O (NM2),其中 M≤N 是诱导变量的数量,其总结了这一过程。

尽管虽然 N 的计算成本似乎是线性的,但算法的真实复杂性取决于 M 如何增加以确保近似质量。我们通过表征 KL 散度(KL divergence)向后验的上限行为来解决这个问题。我们证明了在高概率下,M 的增长速度比 N 慢,可以使 KL 的散度任意地减小。

一个特别有意思的例子是,对于具有 D 维度的正态分布输入的回归,使用流行的 Squared Exponential 核 M=O(logD N)就足够了。 我们的研究结果表明,随着数据集的增长,高斯过程后验可以近似地逼近,并为如何在连续学习场景中增加M提供了具体的规则。

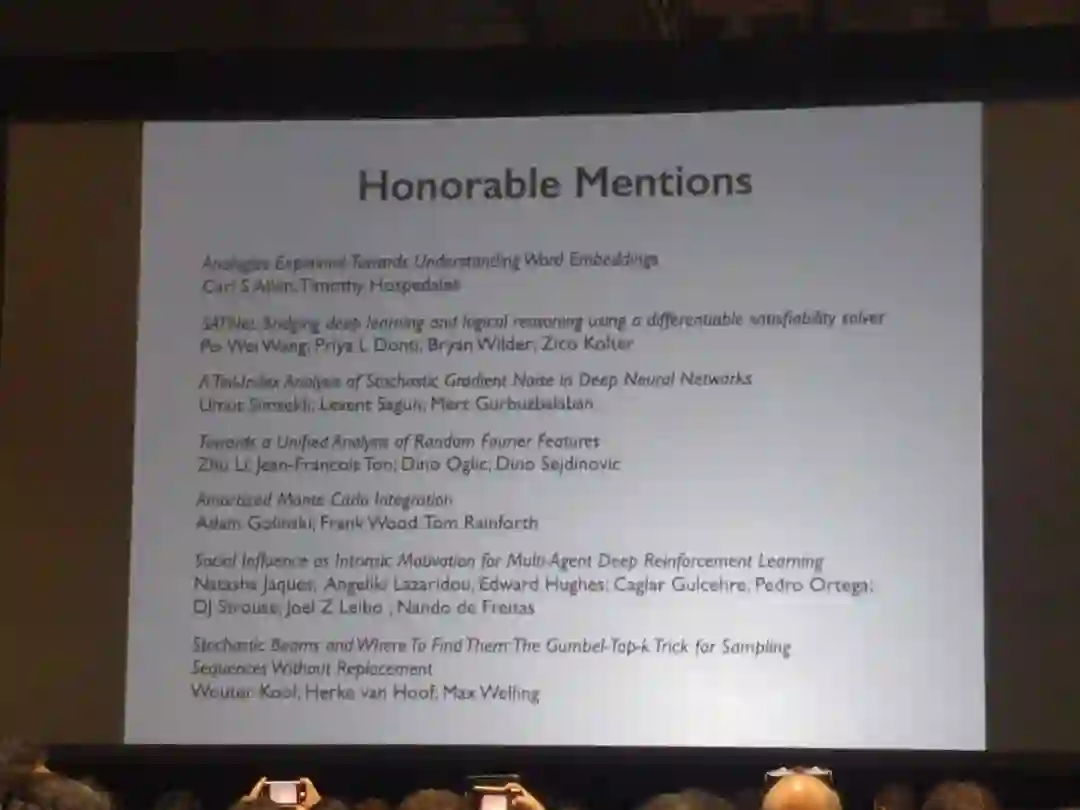

7 篇最佳论文提名

Analogies Explained: Towards Understanding Word Embeddings

作者:CarlAllen1,Timothy Hospedales,来自爱丁堡大学。

论文地址:https://arxiv.org/pdf/1901.09813.pdf

SATNet: Bridging deep learning and logical reasoning using a differentiable satisfiability solver

作者:Po-WeiWang1,Priya L. Donti1,Bryan Wilder,Zico Kolter,分别来自卡耐基梅隆大学、南加州大学、Bosch Center for Artificial Intelligence。

论文地址:https://arxiv.org/pdf/1905.12149.pdf

A Tail-Index Analysis of Stochastic Gradient Noise in Deep Neural Networks

作者:Umut Şimşekli,Levent Sagun, Mert Gürbüzbalaban,分别来自巴黎萨克雷大学、洛桑埃尔科尔理工大学、罗格斯大学。

论文地址:https://arxiv.org/pdf/1901.06053.pdf

Towards A Unified Analysis of Random Fourier Features

作者:Zhu Li,Jean-François Ton,Dino Oglic,Dino Sejdinovic,分别来自牛津大学、伦敦国王学院。

论文地址:https://arxiv.org/pdf/1806.09178.pdf

Amortized Monte Carlo Integration

作者:Adam Golinski,Yee Whye Teh,Frank Wood,Tom Rainforth,分别来自牛津大学和英属哥伦比亚大学。

论文地址:http://www.gatsby.ucl.ac.uk/~balaji/udl-camera-ready/UDL-12.pdf

Social Influence as Intrinsic Motivation for Multi-Agent Deep Reinforcement Learning

作者:Natasha Jaques, Angeliki Lazaridou, Edward Hughes, Caglar Gulcehre, Pedro A. Ortega, DJ Strouse, Joel Z. Leibo, Nando de Freitas,分别来自MIT媒体实验室、DeepMind和普林斯顿大学。

论文地址:https://arxiv.org/pdf/1810.08647.pdf

Stochastic Beams and Where to Find Them: The Gumbel-Top-k Trick for Sampling Sequences Without Replacement

作者:Wouter Kool, Herke van Hoof, Max Welling,分别来自荷兰阿姆斯特丹大学,荷兰ORTEC 和加拿大高等研究所(CIFAR)。

论文地址:https://arxiv.org/pdf/1903.06059.pdf

论文统计

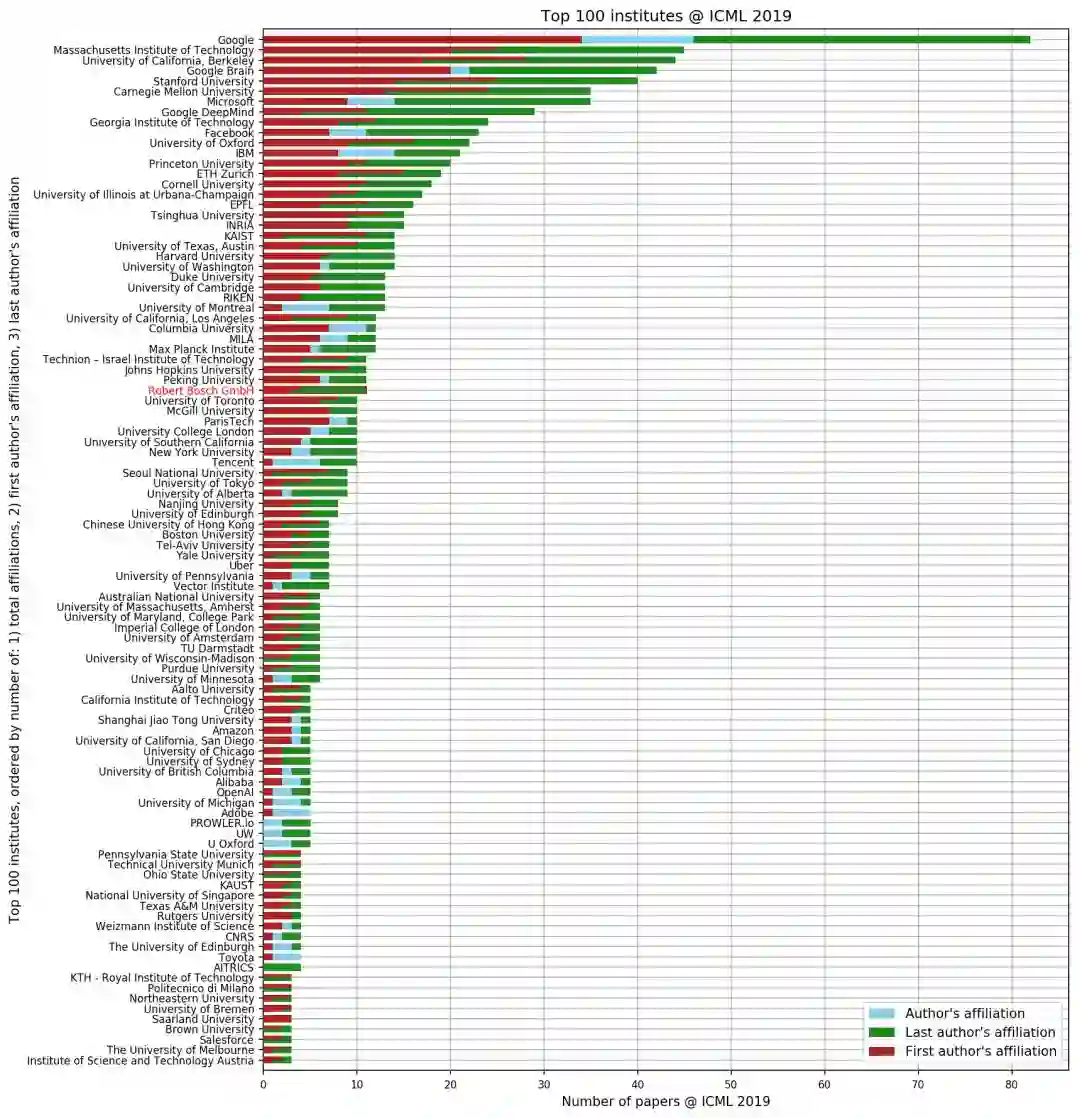

早在一个月前,Reddit上便有网友根据 ICML 2019 大会官网公布的接收论文情况进行统计( https://icml.cc/Conferences/2019/Schedule?type=Poster),总结了这次大会接收论文最多的机构、贡献最多的作者等。

贡献最多的机构:谷歌、麻省理工、加州大学伯克利分校。

统计结果显示, ICML 2019 接收论文最多的机构前三甲分别为谷歌( 80 多篇)、麻省理工学院(40 多篇)以及加利福尼亚伯克利大学(40 多篇)。

此外,国内的清华、北大也榜上有名,分别位列 18 和 34 名,腾讯位列 42 名,而阿里巴巴在 Top100 更靠后一点。

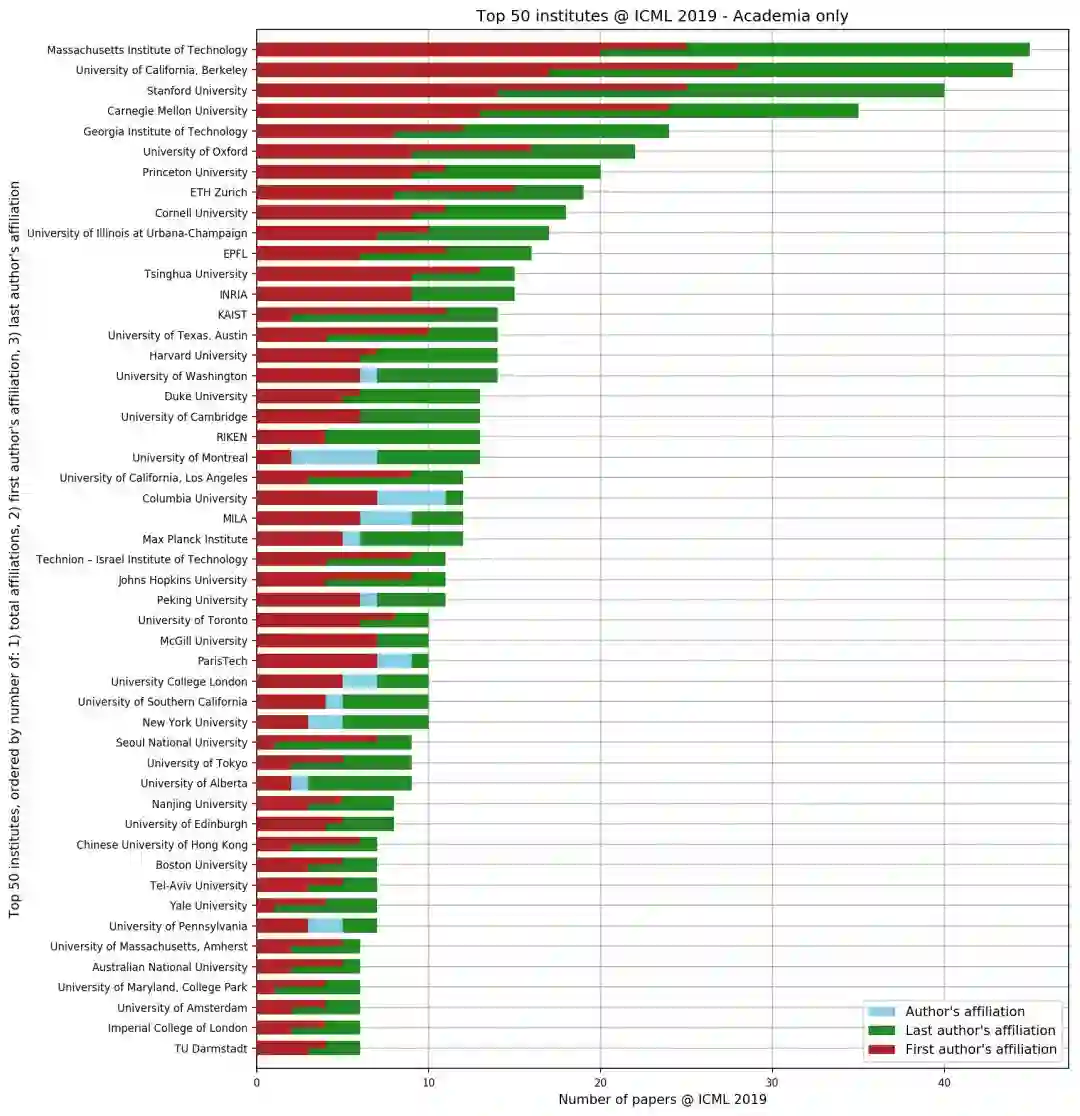

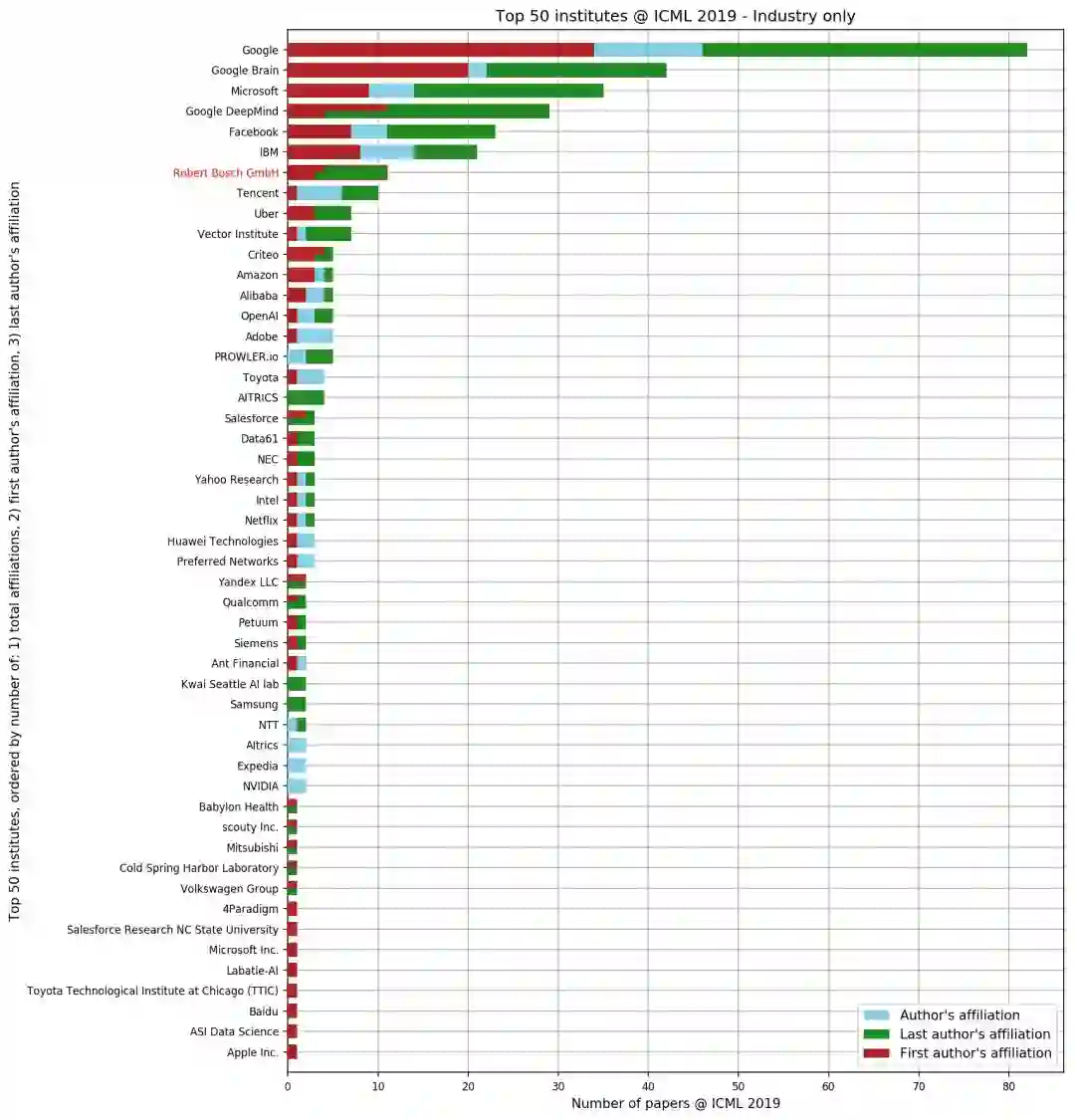

按照学术和工业划分,接收论文数量最多的机构分别为:

学术:麻省理工大学、伯克利大学、斯坦福大学。

工业:谷歌、谷歌大脑、微软。

学术和工业论文的统计情况:

452 篇论文(58.4%)纯属学术研究;

60 篇论文(7.8%)纯粹来自工业研究机构;

262 篇论文(33.9%)与作者隶属于学术界和工业界。

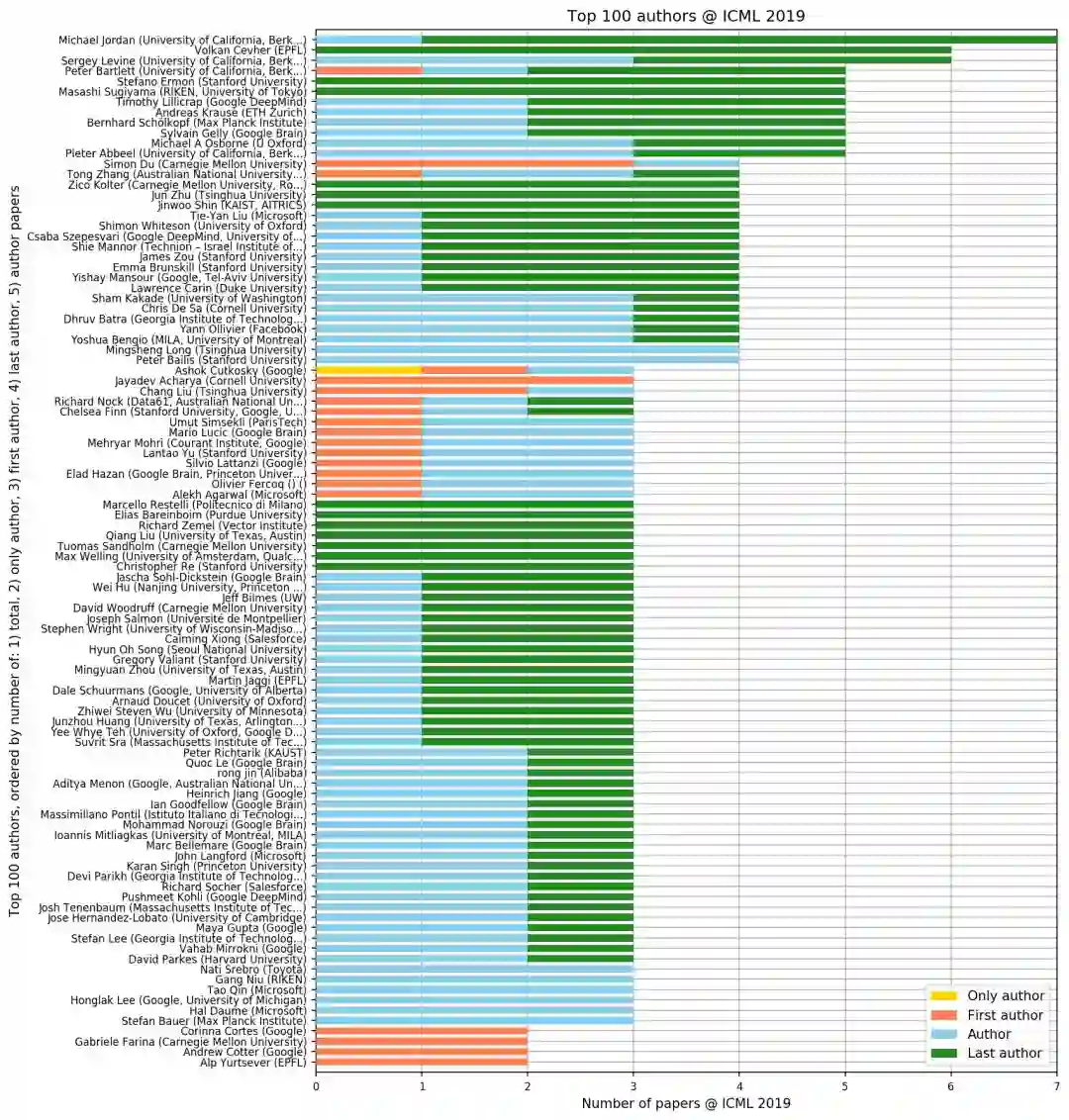

贡献最多作者:机器学习大牛 Michael Jordan

此外,ICML 2019 论文贡献最多的作者当属加州大学伯克利分校的机器学习大牛学习 Michael Jordan,被接收论文有 7 篇。其次是 EPFL(洛桑联邦理工学院)教授 Sergey Levin、加州大学伯克利分校的 Volkan Cevher 和 Peter Barlett。不得不说,加州大学伯克利分校真是人才辈出。

同时,我们还在这份榜单上看到了国内清华大学计算机科学与技术系的教授朱军、微软亚洲研究院的刘铁岩、清华大学软件学院的龙明盛等华人的身影。

据了解,今年 ICML 共提交 3424 篇论文,其中录取 774 篇,论文录取率为 22.6%。录取率较去年 ICML 2018 的 25% 有所降低。事实上,这与其他顶级会议的论文录取情况十分相似,比如计算机视觉领域顶会 CVPR 2019 的录取率接近 25.2%,比去年的 29% 相比也有所下降。可以看出,近年来人工智能顶级会议的热度虽不减,但录取困难程度在不断提升。

关于今年的获奖和提名论文,大家认为公正吗?对于论文研究成果你有什么看法?欢迎在留言区讨论。

【END】

6月29-30日,2019以太坊技术及应用大会特邀以太坊创始人V神与以太坊基金会核心成员,以及海内外知名专家齐聚北京,聚焦前沿技术,把握时代机遇,深耕行业应用,共话以太坊2.0新生态。扫码即享优惠购票!

热 文 推 荐

戳他了解更多↓↓↓

☞回报率850%? 这个用Python优化的比特币交易机器人简直太烧脑了...

☞谷歌用1.2万个模型“推翻”现有无监督研究成果!斩获ICML 2019最佳论文

点击阅读原文,精彩继续。