WWW22 | 图表示学习之时序的事件和节点动态

1. 引言

时序图表示学习已经引起了学者极大的关注, 因为现实世界中时序图很普遍。「然而,现有的作品大多采用时序图的离散快照,或者对新节点无法进行归纳处理,或者没有建模燃点效应,这是事件影响另一个事件发生的能力」。在这项工作中,我们提出了 TREND,一种新的时序图表示学习框架,由时序的事件和节点动态驱动,建立在基于霍克斯过程的图神经网络 (GNN) 之上。TREND 有几个主要优点:

-

(1) 它是归纳性的,因为它基于 GNN 架构; -

(2) 使用霍克斯过程捕捉到了事件之间的燃点效应; -

(3) 作为我们的主要创新,它通过整合事件和节点动态, 捕捉事件的个体和集体特征, 以获得对时序过程的更精准建模。

使用了四个真实世界数据集的大规模实验证明了我们提出模型的有效性。

本工作由新加坡管理大学完成。相关成果已被中国计算机学会推荐A类国际会议WWW 2022录用。

2. 模型细节

2.1 时序图

2.2 霍克斯过程

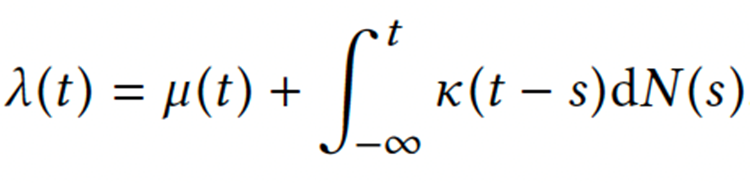

点过程通过假设时间 t 之前的历史事件可以影响当前事件的发生来对离散的连续事件进行建模。条件强度函数表征连续事件的到达率,可以定义为给定所有历史事件在一个小时间窗口内发生的事件数。霍克斯过程是一个典型的时间点过程,其条件强度函数定义如下,其中 μ(t) 是特定事件的基础强度,表示时间 t 的自发事件到达率;κ(∙)是一个核函数,它模拟过去历史对当前事件的时间衰减效应,通常采用指数函数的形式。霍克斯过程的条件强度函数表明,当前事件的发生不仅取决于上一时间步的事件,而且还受到具有时间衰减效应的历史事件的影响。这种属性对时序链路形成序列进行建模是可取的,因为当前邻居的形成可能会受到最近事件的更高强度的影响,而在较长历史中发生的事件对当前发生的目标事件的贡献较小。

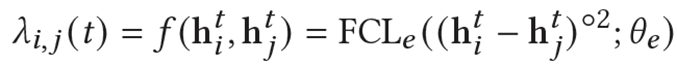

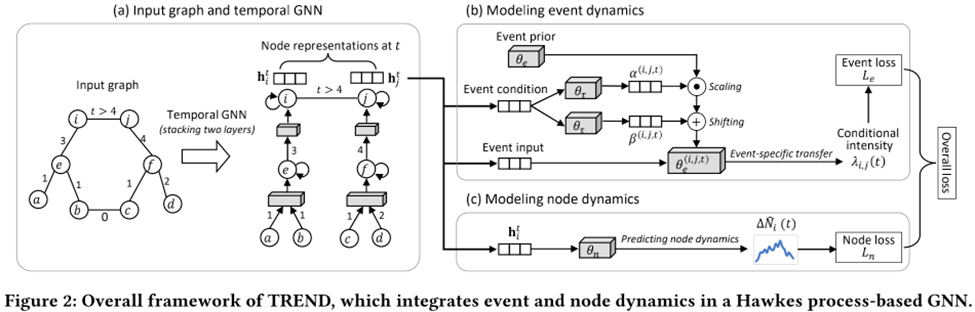

2.3 建模事件动态

实现上述条件强度函数的关键是适配时序GNN一个转移函数 f, 在这里, 我们用一个全连接层来拟合该转移函数,

其中, θ_e 代表该全连接层的参数, [(h_i^t-h_i^j)]^o2 代表 h_i^t 与 h_i^j 的元素对应的差的平方。

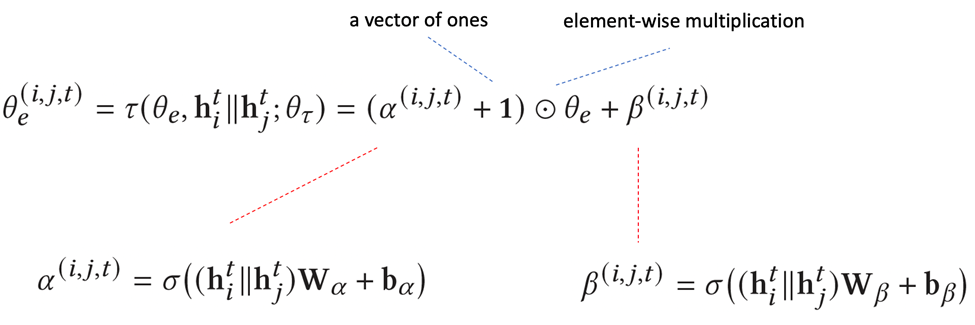

同时,我们认识到每个事件都有自己独一无二的特点,因为不同的事件通常是在不同的上下文和时间段形成的。为了在个体层级上精确捕捉事件的独特性,我们学习了一个事件先验 ,它可以快速被调整为每个事件的定制模型,而无需训练大量的模型。

其中,⨀ 代表元素对应的向量相乘,1是一个所有元素为1的向量, 确保拉伸集中在1左右。注意, θ_e 包含了〖FCL〗_e的参数, 在这步操作里, 我们把它拉平成一个向量。

2.4 建模事件动态

虽然事件可以单独不同,但它们不会孤立地发生。特别是它们的行为共同受其共同节点的约束。因此,我们建议在节点级别管理节点的集体特征,以捕捉节点的“事件趋势”。更具体地说,节点动态或节点在时间 𝑡 的事件趋势可以通过节点在 𝑡 时刻发生的新事件的数量来量化,表示为∆N_i (t)。我们用一个全连接层构建了节点动态估计器,拟合给定节点上𝑡 时刻发生的新事件的数量:

其中, ∆N ̂_i (t) 是预测的节点 i 在 𝑡 时刻发生的新事件的数量 。

2.5 模型框架

TREND的总体框架如图2所示。首先,在图 2(a) 中,输入时间图经过时序GNN多层聚合,其输出表示用作建模事件和节点动态的输入。GNN 层聚合了自我信息和历史邻居的信息,这些信息是实现霍克斯过程中条件概率强度的构建元素。接下来,我们对事件动态进行建模以捕捉事件的个体特征,如图 2(b) 所示。我们执行以该事件作为条件的,可学习的神经网络变形,来为输入事件定制化地调整θ_e, 从而产生特定于该事件的转移函数以在霍克斯过程中生成条件强度。此外,我们对节点动态进行建模以在节点级别捕获事件的集体特征,如图 2(c) 所示。我们构建了一个估计器来预测跨节点和时间的节点动态,它控制同一节点上发生的事件的行为。最后,我们整合事件和节点损失,共同优化事件和节点动态。

3. 实验

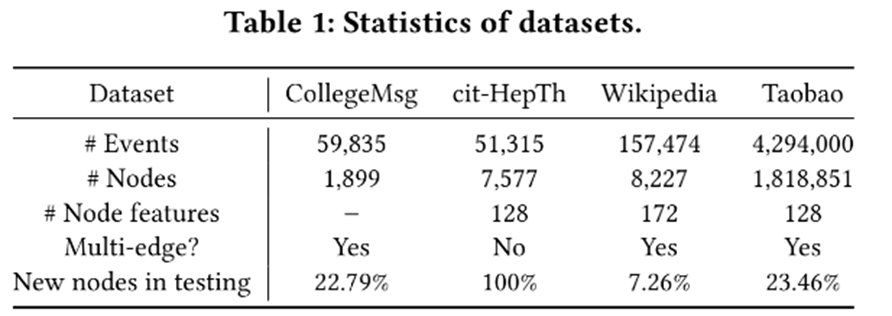

我们在四个公开的时序网络上做实验, 包括:CollegeMsg, cit-HepTh, Wikipedia, Taobao。

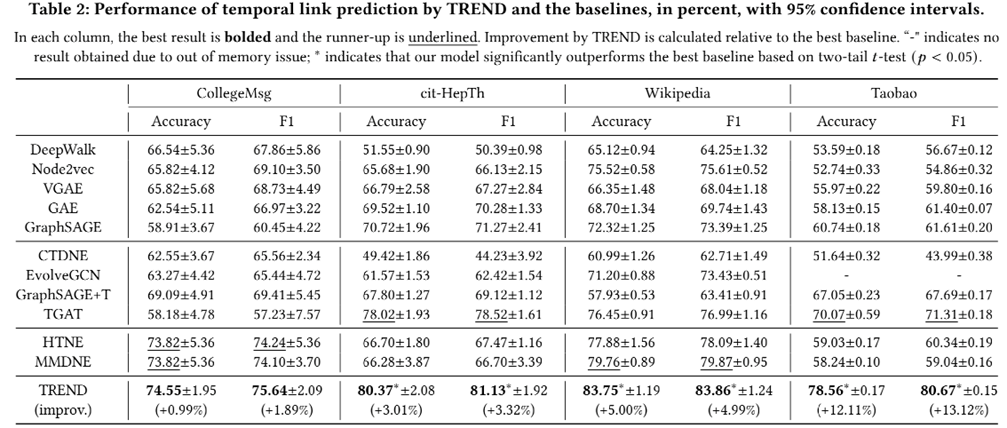

我们将 TREND 与来自三个类别的具有竞争力的基线进行比较, 他们包括:静态方法, 动态方法, 霍克斯过程方法。在表 2 中,我们将 TREND 的性能与主要任务的基线进行了比较。总的来说,我们的方法在所有方法中表现最好,展示了基于霍克斯过程的GNN 一起建模时序的事件和节点动态的好处。

如有疑问或希望进行进一步的讨论, 请发邮件至 zhwen.2019@phdcs.smu.edu.sg 原文链接:https://arxiv.org/abs/2203.14303