7月11日,DeepMind的一项研究再次登上了Nature子刊。

论文地址:https://www.nature.com/articles/s41562-022-01394-8

不过,在聊这个项目之前,我们需要先举一个例子便于大家理解。

假如我拿着一根笔站在你面前,然后我把笔藏在身后,你是不是就看不见这支笔了?

这么简单的道理,不光你懂,就连两个月大小的婴儿都明白。

但背后的原因就很耐人寻味了。科学家很好奇,为什么人会天生就懂这个道理?

我们把「笔放身后看不见但笔还在」叫做万千物理学常识中的一个,而DeepMind的科学家就是要让AI和小婴儿比一比物理学常识。

普林斯顿大学的Luis Piloto和他的同事开发了一个深度学习AI系统,这个系统可以理解一些物理学世界的常识性规律。

通过这种方式,未来的计算机模型就可以更好的模仿人类思维,用一个有着和婴儿相同认知的模型来解决问题。

通常意义上,任何AI模型一开始都是白纸一张,然后用各种各样的例子来训练这个模型。通过输入的数据和例子,模型产生了知识。

婴儿学东西并不是从零开始,而是一降生就带着一些对客观事物的预判。

还是拿上面那个藏笔举例子。婴儿天生就知道,笔就算藏起来了也还在。

这是接下来实验的底层逻辑。即:婴儿在出生时就有一些核心的假设,而这些假设会让他们在之后成长的过程中朝着正确的方向发展,而他们的知识也会随着时间的推移、经验的增多变得越来越精炼。

Piloto想,一个模仿婴儿行为模式的深度学习人工智能,是不是要比一个一开始白纸一张,单纯靠经验学习的人工智能模型表现要好?

他们首先进行的是传统的办法(简称白纸一张)。他们给了AI模型一些物体的视觉动画,让AI进行学习,比方说一个方块从斜坡上滑下来,或者是一个球弹向墙壁。

AI模型检测了这些动画中的运动模式,然后研究人员就开始着手测试,模型能不能预测一些其它物体的运动结果。

而另一边,模仿婴儿的人工智能模型在一开始就有了一些「原则」,而这些「原则」的来源就是婴儿对物体之间运动、交互的一些先天的假设。

举个简单的例子,婴儿知道两个物体不可能穿过彼此,一个物体不可能凭空升起来等等。

而实际上,婴儿先天就知道的物理学常识不止上面提到的这两点。完整版是以下五点:

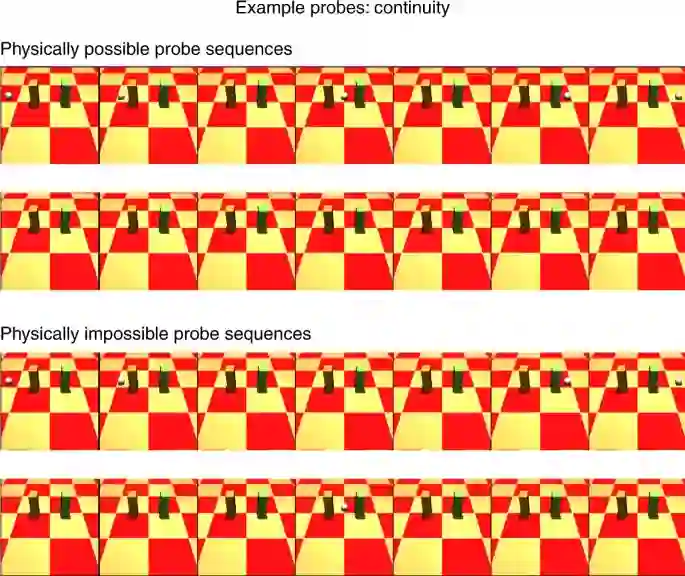

1. 连续性:物体不会从一个地方传送到另一个地方,而是在时间和空间中有一定的连续路径。

基于这五点认知,如果你给婴儿表演个魔术啥的,然后发生了违背他们预设认知的现象,他们是能知道你在整花活的,他们也知道反常识的现象并不是事物本来的样子。

虽然但是,婴儿还是没大一点的孩子见识广,婴儿会长时间观察出现的反常识现象,然后和自己预设的认知进行比对,最终才能得出有人在变戏法的结论。

说到这里不禁想起了一个之前热度很高的视频,爸妈躲在床单后面,上下晃动床单几次之后,藏在床单后面的同时,快速躲到身后的房间里。婴儿在床单消失后没看到爸妈的身影,就会站在那里思索一会儿,琢磨爸妈去哪儿了。

这里还有一个有意思的点。那就是婴儿在看到反常识的现象之后,还会表示出「惊讶」,听起来这是很显然的事,但研究人员把这种独特的表现也复刻到AI那里去了。

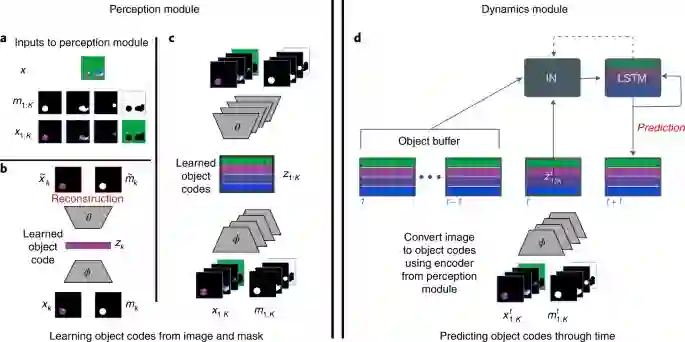

Piloto设计的AI模型名叫PLATO(Physics Learning through Auto-encoding and Tracking Objects),也就是「柏拉图」。

PLATO接受了差不多30个小时的视频训练,这些视频展示了物体是如何进行一些简单运动的,然后训练模型来预测这些物体在不同情况下的运动。

有意思的是,模型最终习得了上述提到的五点物理学常识。

而当观看的视频中出现了反常识的现象时,PLATO也能像婴儿一样,表现出一定程度的惊讶。

Piloto和他的同事们发现,传统训练方法(白纸一张)的AI模型表现不错,但是不比不知道,一比吓一跳。模仿婴儿的AI模型PLATO的表现要好的多得多。

因为有了预设认知的加持,后一种模型可以更精确地预测一个物体的运动,可以把预设的认知应用到新的物体运动动画中去,并且训练模型所用的数据集规模也会小一点。

Piloto团队总结到,虽然通过后天学习和经验积累很重要,但这并不是全部。

他们的研究直指一个经典的问题——什么是人类与生俱来的,什么又是后天学习的。

而下一步,就是把这种关于人类的认知应用在AI的研究中。

但是,Piloto强调,PLATO并不是要设计成婴儿行为模型的,我们只是借用婴儿认知的一些方式来反哺人工智能。

PLATO的仿真系统:前馈感知模块(左)和循环动态预测器模块(右)

温哥华不列颠哥伦比亚大学的计算机科学家Jeff Clune也表示,把AI和人类婴儿的学习方式相结合是一个比较重要的方向。

而此时此刻,Clune正和其他研究人员一道,开发独属于他们的理解物理世界的算法的方法。

Luis Piloto是论文的一作,也是通讯作者。

他于2012年获得罗格斯大学计算机科学学士学位,随后又去普林斯顿大学攻读,并分别于2017年和2021年获得神经科学的硕士和博士学位。

2016年,他正式加入DeepMind,成为一名研究科学家。

https://www.nature.com/articles/d41586-022-01921-7

https://www.nature.com/articles/s41562-022-01394-8

https://theconversation.com/researchers-trained-an-ai-model-to-think-like-a-baby-and-it-suddenly-excelled-186563

公众号后台回复“目标检测综述”获取目标检测(2001-2021)综述PDF~