基于小样本学习的图像分类技术综述(中文版),19页pdf

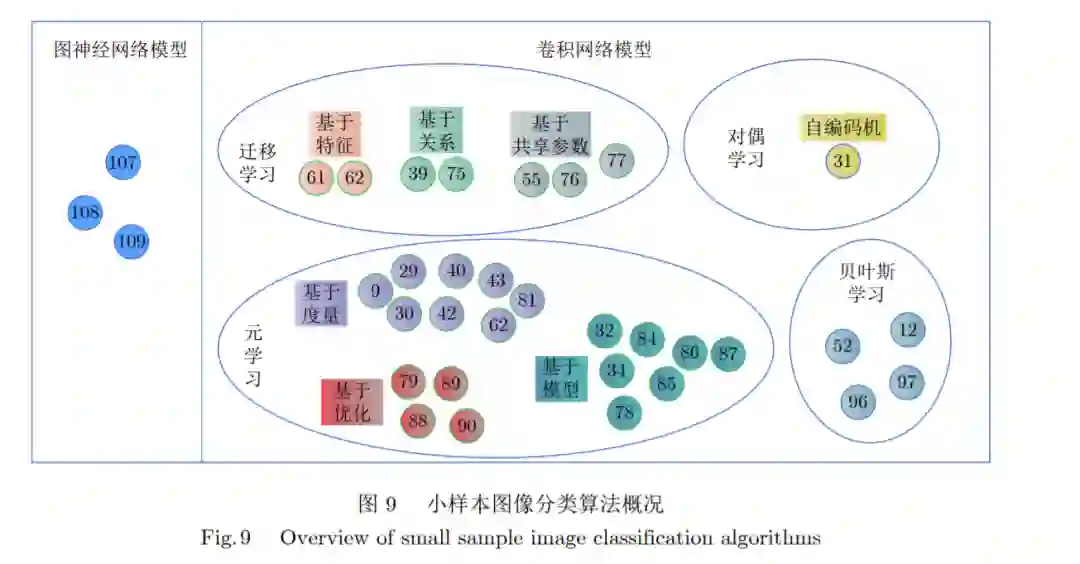

摘要: 图像分类的应用场景非常广泛, 很多场景下难以收集到足够多的数据来训练模型, 利用小样本学习进行图像分类可解决训练数据量小的问题. 本文对近年来的小样本图像分类算法进行了详细综述, 根据不同的建模方式, 将现有算法分为卷积神经网络模型和图神经网络模型两大类, 其中基于卷积神经网络模型的算法包括四种学习范式: 迁移学习、元学习、对偶学习和贝叶斯学习; 基于图神经网络模型的算法原本适用于非欧几里得结构数据, 但有部分学者将其应用于解决小样本下欧几里得数据的图像分类任务, 有关的研究成果目前相对较少. 此外, 本文汇总了现有文献中出现的数据集并通过实验结果对现有算法的性能进行了比较. 最后, 讨论了小样本图像分类技术的难点及未来研究趋势.

地址:

http://www.aas.net.cn/cn/article/doi/10.16383/j.aas.c190720

图像分类是一个经典的研究课题, 典型的图像分类算法涉及两个问题, 一是如何对图像特征进行更好的表示, 二是如何学习好的分类参数. 随着卷积神经网络(Convolutional neural networks, CNN)的设计越来越深层化, 图像特征的表示能力越来越强, 同时也能对图像进行自动分类. 在CNN提出之前, 人类通过人工设计的图像描述符对图像特征进行提取, 效果卓有成效, 例如尺度不变特征变换(Scale-invariant feature transform, SIFT)[1]、方向梯度直方图(Histogram of oriented gradient, HOG)[2], 还有词袋模型(Bag-of-words, BoW)[3-6]等, 但是人工设计特征通常需要花费很大精力, 并且不具有普适性. 基于CNN的深度学习在2012年的ILSVRC挑战赛上取得了巨大成功, 同时由于大数据、计算硬件的发展以及反向传播算法[7]的提出, 深度学习在图像分类领域[8]表现出优异性能.

深度学习的优势有赖于大数据, 在大数据的驱动下, 机器能够进行有效学习, 然而数据量不足会导致模型出现过拟合等问题, 虽然简单的数据增强(Data augmentation, DA)和正则化技术可以缓解该问题, 但是该问题并没有得到完全解决[9], 故针对小数据集的小样本学习成为了解决这类问题的关键技术. 2003年Li等首次提出了One-shot learning问题并利用贝叶斯框架[10-11]对视觉对象进行学习, 与之相比, 深度学习技术在小样本图像分类任务上具有更大的潜力. 小样本学习的产生有两个因素, 一是训练数据量少. 比如在医疗领域, 医学影像的产生来源于病例, 通常少量的病例并不能够辅助机器对医疗影像进行分析. 二是让机器学会以人类的方式进行学习, 即类人学习. 人类能够在获取少量样本的情况下, 对样本进行分类和识别, 并且具有快速理解新概念并将其泛化的能力[12], 小样本学习的目的之一就是让机器以人类的学习方式完成任务. 小样本学习目前在目标识别[13]、图像分割[14]、图像分类与检索[15]等多种图像处理任务中都有应用, 文献[16-19]从样本数量、带标签样本的数量、先验知识的作用等不同角度对小样本学习技术进行了分类讨论和分析.

在2010至2015年间, 大量的文献利用语义迁移来解决训练样本不足的问题. 例如, Mensink等[20-21]借鉴了聚类和度量学习的方法对ImageNet数据集进行分类, 并且探索了KNN (K-nearest neighbor)和NCM (Nearest class mean)分类器, 通过对每个类的语义描述, 学习一个度量, 使其在训练和测试类别间共享, 达到迁移效果; 文献[22]将语义知识迁移扩展到直推式学习, 利用已知类别推测未知类别的表示, 计算未知类别的样本相似性, 在构建数据空间分布关系时, 将数据投影到低维的语义空间, 再进一步寻找数据的空间分布, 并在AwA (Animals with attributes)[23]、ImageNet[24]以及MPII composites activities[25]数据集上取得很好的分类效果; 文献[26]提出直推式多视图嵌入框架来解决领域漂移问题, 利用异构多视图标签传播来解决原型稀疏性问题, 有效利用了不同语义表示提供的互补信息, 并在AwA、CUB (Caltech-UCSD-Birds)[27]、USAA (Unstructured social activity attribute)[28]数据集上取得了很好效果; Fu等[28]为解决带有稀疏和不完整标签的社交媒体数据的属性学习问题, 利用零样本学习思想提出了一种学习半潜在属性空间的模型, 它能够表达用户自定义和潜在的属性信息, 在USAA数据集上取得很好的效果. 这些文章针对的多是零样本学习问题, 本文主要介绍小样本下的图像分类算法, 因此综述算法更集中于Few-shot learning.

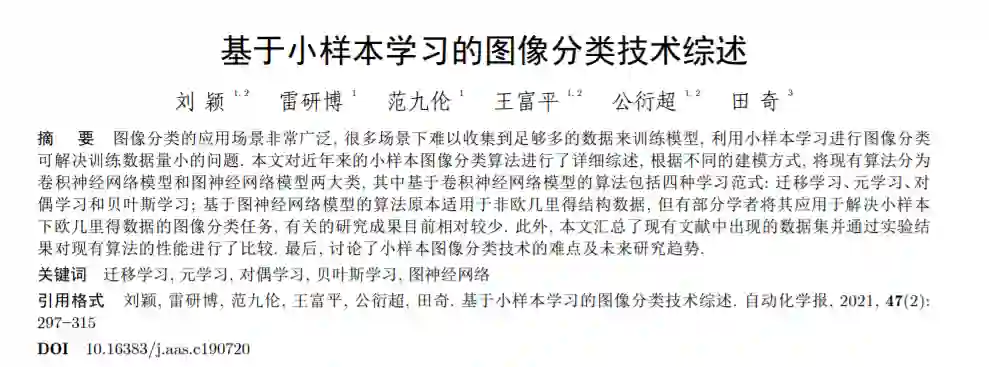

近年来现有文献中基于小样本学习的图像分类算法都是采用深度学习. 将深度学习中的技术用于小样本学习中, 比如使用数据增强技术来增加样本的数量, 通过注意力机制和记忆力机制来对图像特征进行提取, 设计提取特征网络和分类器之间的映射关系, 与此同时, 迁移学习、元学习、对偶学习、贝叶斯学习以及图神经网络方法也被用于小样本图像分类的任务. 本文的小样本学习算法与其他几篇小样本文献相比较有两点区别, 一是本文阐述的小样本学习算法是针对图像分类任务, 文献[16-19]中的小样本学习算法不仅应用于图像分类, 还有识别、分割等图像任务以及小样本学习在语音、视频中的算法应用, 本文集中地对小样本图像分类算法进行了分类并归纳总结; 二是本文探索了不同的网络建模方式, 将小样本图像分类算法分为卷积神经网络模型和图神经网络模型两大类, 卷积神经网络模型主要基于CNN对图像数据建模, 图神经网络模型进一步将CNN应用在图神经网络上, 通过图结构中的节点和边来对图像数据建模.

本文的结构如下, 第1节介绍了小样本图像分类的流程, 小样本图像分类数据集和实验评价指标; 第2节将现有小样本图像分类算法按照数据结构类型分为卷积神经网络模型和图神经网络模型两大类并进行详细介绍; 第3节通过实验数据对比分析了各种算法的性能; 第4节总结了小样本图像分类面临的技术挑战并讨论了未来研究趋势; 第5节总结全文.

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“SSIC” 就可以获取《基于小样本学习的图像分类技术综述(中文版),19页pdf》专知下载链接