NIPS 2017:与李飞飞、哈萨比斯、Ian Goodfellow等7位大牛面对面

新智元专栏

作者:Jim Fan(范麟熙)

【新智元导读】NIPS 2017是一届不平凡的会议,DeepMind、FB、英伟达、BATJ为了招人使出了浑身解数,但各家公司展示自己的思路各有不同。李飞飞、哈萨比斯、Ian Goodfellow等大牛做了哪些分享?Micheal Jordan还在现场击鼓助兴?斯坦福大学博士生、师从李飞飞教授的Jim Fan(范麟熙)全程参与了本届NIPS所有主要的活动和讲座,带来他的第一手观察和体验。

我现在在斯坦福大学攻读人工智能博士,师从斯坦福人工智能实验室主任、现谷歌云首席科学家李飞飞教授。这是我第一次参加NIPS会议。今年的NIPS不仅热度上达到历史峰值,内容和活动上也异常精彩。NIPS上听到的演讲和遇到的人物,很多都和我研究人工智能的心路历程直接相关,所以有不少“相见如故”和“感慨万千”的瞬间和大家分享。

我第一天一早6点45分就到会场门外了,排在签到队伍的第一个,没想到转身一看,紧接着排在我后面的居然是Yoshua Bengio大神。我之前就听说了他老人家晚睡早起的习惯,果然名不虚传。

NIPS学术讲座:与7位大神面对面

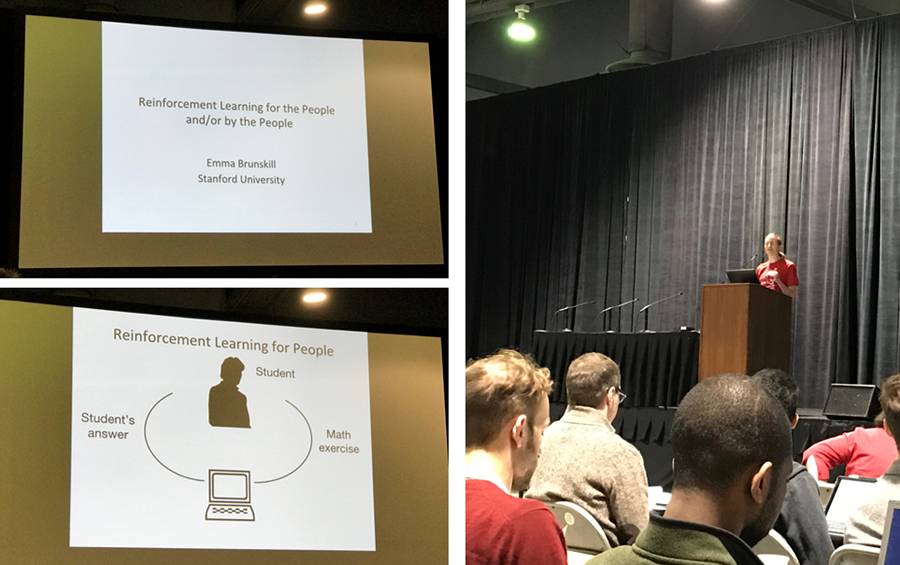

NIPS的第一天,我全程参加了tutorial sessions。早上8点第一场tutorial是我们斯坦福的教授Emma Brunskill主讲的,题为《Reinforcement Learning for the people and by the people》。这个标题巧妙地借用了美国总统林肯在葛底斯堡演讲里的一句名言“Government of the people, by the people, for the people, shall not perish from the Earth.”

Emma和我在斯坦福一起合作过一个元学习(meta-learning)的项目。她在强化学习(RL)的理论上有很深的功底,她参与的很多篇论文里都含有大量的收敛性证明。DeepMind把最新的深度学习技术和古老的强化学习算法结合在一起之后,大家把RL也做成了“炼金术”。像Emma这样严谨的数学证明也是越来越少了。

回到Emma的讲座内容:如何把人和强化学习有机结合呢?

Emma提到了自己在教育学方面的一些研究,比如把学生作为RL环境的一部分。在这个环境里,RL智能体就是“虚拟老师”,它根据学生的学习情况,自动设计下一个教程里应该引进哪些知识点,既不能太容易,也不能远远超过学生的能力范围。智能体获得的奖励(reward signal)就是学生的考试成绩等客观指标。

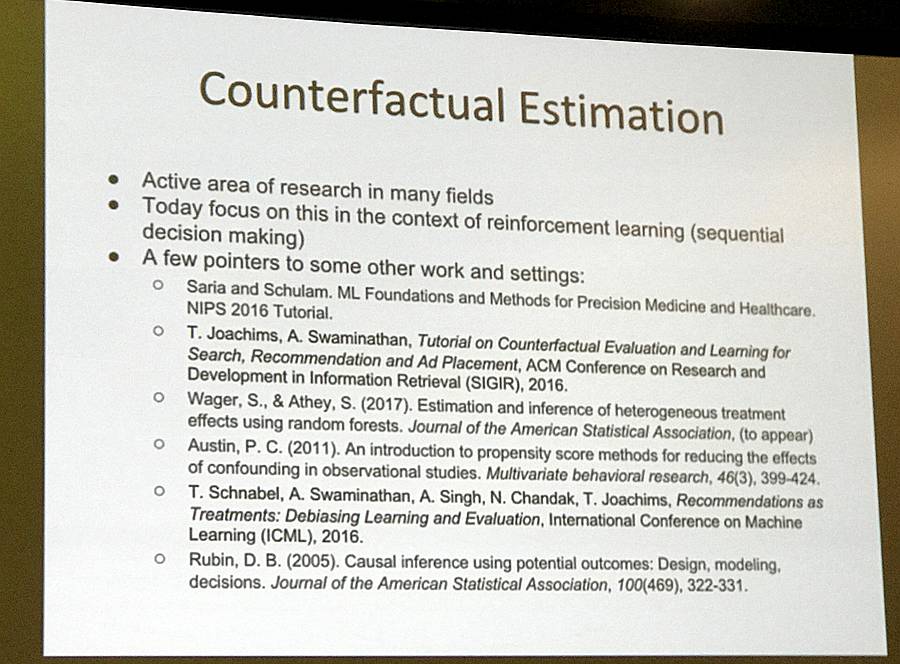

在教育学里的RL和在Atari电子游戏里的RL有非常大的区别。电子游戏相当于一个高速模拟器,你可以在短短几分钟里玩上百局,几乎没有成本地获得大量的训练数据。但是,牵涉到人的话就要复杂很多。一个学生可能在几个月之后才会有明显的进步,这就意味着每一次实验的反馈周期非常长。如果盲目地套用Atari游戏上的RL算法,可能要几十年的时间才能训练一个算法,这是不现实的。Emma的讲座重点讨论了各种提高采样效率(sample efficiency)的方法,以及在没有现成数据的场景下如何做出有意义的推断(counterfactual reasoning)。

RL和人的结合虽然困难重重,但同时也有很大的机遇。因为人工智能终究是为人类服务的,算法和人的互动将会是未来一个越来越重要的课题。

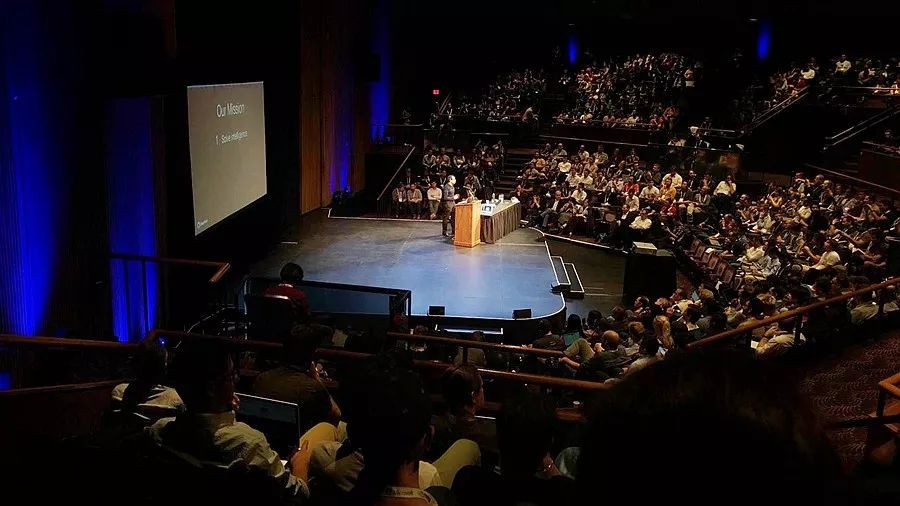

这次很遗憾没能挤进自己导师的讲座专场,只能站在门口踮着脚尖观望。我稍微晚了一点点,整个大厅摩肩接踵,不仅座无虚席、还几乎站无虚席。当天没有第二场讲座有如此盛况的。

飞飞老师的演讲主题是人工智能和计算机视觉在医疗上的应用以及未来的前景。

DeepMind联合创始人Demis Hassabis自从2016年3月的AlphaGo比赛之后,就一跃成为人工智能届的天王巨星。DeepMind掐准了时间,在NIPS期间发表了“AlphaZero”的最新论文。AlphaZero没有任何专门为围棋设计的组件,它能原封不动直接应用于任何完备信息(complete informatio)的对弈游戏,比如国际象棋和日本将棋。

我在大一的时候,出于兴趣,自己用C++写过一个国际象棋引擎,当时参考了最强的开源引擎Stockfish(鳕鱼)。这次看到AlphaZero完胜鳕鱼引擎,心中百感交集。我会在另一篇文章里,详细写一写AlphaZero和鳕鱼的传奇。

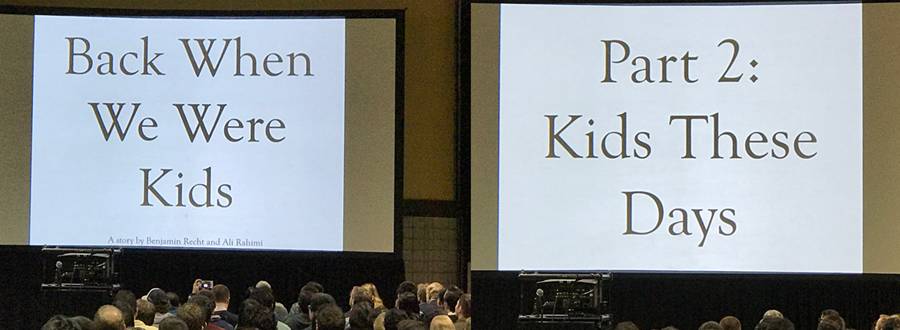

这次NIPS的“Test of Time Award”颁给了Ali Rahimi,他的颁奖演说也成为了这次NIPS最大的彩蛋,大家茶余饭后津津乐道的话题。Ali获奖的的那篇经典论文题为“Random Features for Large-Scale Kernel Machine”《大规模kernel机的随机特征》。对于我个人而言,这篇论文的意义尤其深刻。我在纽约的哥伦比亚大学读大二的时候,师从自然语言处理(NLP)宗师Michael Collins,做关于语音识别的研究,深入比较了深度神经网络和基于Rahimi和Recht的随机特征算法。这是我学术生涯第一个正式的研究项目,也是第一次跳出课本和作业的限制、动手做最前沿的机器学习。我记得当时和PhD学长用Java写了一整个训练框架,还把本来只能在CPU上运行的代码改成了CUDA加速的GPU代码。项目做了一个暑假,我学到了很多算法和GPU编程上的知识,为之后更复杂、规模更大的项目打下了坚实的基础。毫不夸张地说,没有Rahimi就没有我当年的处女作!这次能在现场亲耳听到他的演讲,真是不胜荣幸。

在解释“炼金术”上,Rahimi说到,“吴恩达说过:机器学习就是新时代的电力。我却认为机器学习慢慢变成了新时代的炼金术。炼金术本身并不是坏事。它推动了冶金、纺织、化工、医疗等技术的发展,但是同时炼金术师也相信真的能把铜片变成黄金。 我希望我所生活的世界是基于非常稳固、有规律、有系统理论的知识体系上,而不是炼金术上。”

大家可能也看到了Yann LeCun在脸书和Reddit论坛上和Rahimi的激烈论战。我觉得双方的论点都有可取之处。我个人的观点,用中国哲学的话来说就是“中庸之道“:

一方面,现在很多论文的确缺乏严谨的科学态度。这是非常危险的。我想从“p-value”这个经典的实验统计指标说起。假设我在小白鼠上测试一种新的药,发现一批的存活率是90%。而文献中旧药的存活率是88%。试问我的新药一定比旧药更有效吗?答,如果你不给出p-value,那就无法判断,因为有可能你做了一次小规模实验,碰巧抽到一批身体健壮的小白鼠,所以药效更好。如果换一批,存活率可能只有85%。p-value代表了一种“自信度”,越低越好:如果p-value < 0.01,那说明在统计意义上,新药的确比旧药效果更佳,而不是因为我做实验的运气好。

任何别的应用科学领域的论文,比如医学、生物学、经济学,凡是涉及实验结果的比较,一般都会提到p-value。但是不知道为什么,在深度学习界,“p-value”似乎无人问津。深度神经网络的初始参数一般都是随机生成的,有不少实验换一个随机种子就无法重新论文里的结果了。很多论文更是只跑了一次实验,比文献里的结果高了0.5%,就声称自己的算法是一个巨大的进步。

这个现象在强化学习里尤为显著,因为现在很多深度强化学习算法训练时都相对不稳定。有时候算法的代码一行不变,不同的随机初始化就会导致训练结果大相径庭。有些论文里的确跑了很多次实验求平均值,但是最后汇报的结果却是“top 5”的曲线,不得不说有“报喜不报忧”的嫌疑。在这一点上,我非常赞同Rahimi的观点:实验方法需要规范化、实验结果要经得起推敲。

另一方面,我站在Yann LeCun这一侧:经验总是领先于理论,即使没有理论,也不代表“炼金术”是不值得去做的。我的理由主要分两块:

第一,人工智能和物理方程是不一样的。后者是可以准确推导的,比如牛顿的万有引力方程放之四海而皆准、光速的数值和电子的电荷也可以精确衡量。但是,前者的本性是模仿人的理性和情感,而这些本身就是很fuzzy、没有明确定义的概念。你问画家为什么要选这种颜色而不是那种,他只会说只可意会不可言传。你问李世石下围棋的时候为什么选这步而不是那步,他也会告诉你“凭感觉就是这样”。我们可以用心理学等科学来系统地描述人类认知的过程,但即便如此,也不存在放之四海而皆准的“智能方程”。

第二,我认为如果哪天我们真的实现了“强人工智能(Artificial General Intelligence, AGI)”,它很可能是一个emergent property,所谓“涌现的性质”。就拿我们自己的大脑打个比方。大脑里有上千亿个神经元细胞。每个细胞既不存在自我意识,也不存在复杂的推理,它们只是根据一定的法则接受神经电信号并向邻居发出脉冲。但是,亿万个神经元同时运行时,就能演奏出思维和情感的交响乐。这就是“涌现”的涵义。你可以用数学理论精确地描述每一个神经元每一毫秒的活动,但是你依旧无法理解为什么大脑作为一个整体拥有喜怒哀乐、爱恨情仇。所以,我的预测是,强人工智能很可能完全无法用Rahimi所设想的一个系统的理论体系来分析。

Ian大神的代表作就是现在家喻户晓的“生成对抗式网络”(Generative Adversarial Network, GAN)。现在,基于GAN和卷积神经网络的算法已经能合成以假乱真的图片了。我和Ian大神的交集是2016年在OpenAI的暑假实习,Ian本科毕业于斯坦福,算是我的直系学长;PhD毕业于蒙特利尔大学AI实验室(MILA),也是我曾经和Yoshua Bengio一起做过科研的地方。我对他的印象是一位非常健谈的前辈,善于思辨,偶尔还会来一些冷幽默 。Ian这次在NIPS做了关于GAN应用在艺术和创造上的报告。

Schmidhuber老人家最著名的工作就是二十年前的Long Short-Term Memory(LSTM),解决了回馈式神经网络的训练稳定性问题,也为后来的机器翻译、语音识别、音频合成等时间序列应用奠定了基础。这次在NIPS有幸遇到了他本人,聊了一下强化学习和元学习的一些看法。老人家一身笔挺的西装,classy的画风就是跟周围的人都不太一样。

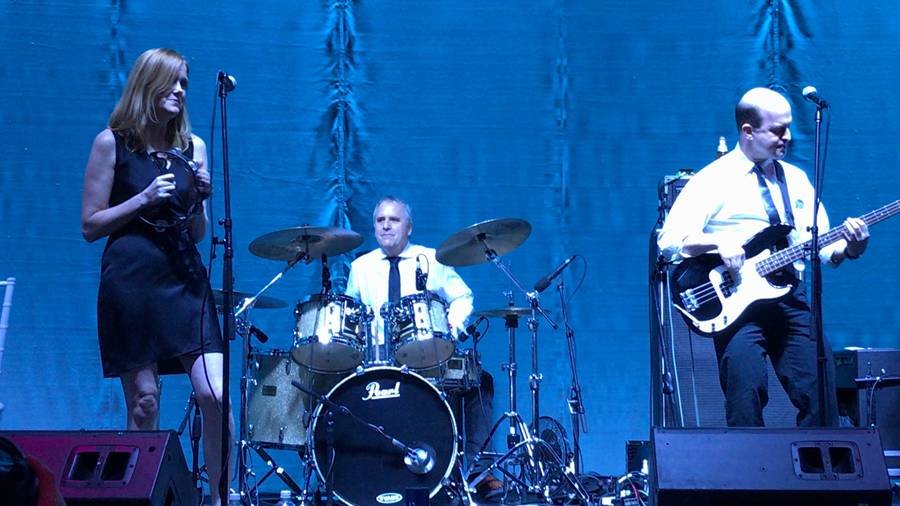

在NIPS盛大的闭幕式上,“Imposterior”乐队为大家倾情演奏摇滚、爵士等音乐。乐队最著名的成员要数Michael Jordan教授,伯克利的机器学习宗师、现任蚂蚁金服首席科学家。

Michael Jordan击鼓助兴!

NIPS企业玩家:各显神威,招人不遗余力

接下来,我们把时间往回调一点,看看本届NIPS上的企业玩家。AI热潮下,企业纷纷都来学术会议招揽人才,不遗余力。在企业举办的午餐会、晚宴和after-party中,可以看出各自不同的风格和气氛。

NIPS BAT展台:这部分内容可以访问新智元小程序回顾

我是第一次参加NIPS,所以没有什么比较。但听曾经参加过的小伙伴们说,今年的NIPS企业参与度有明显的提升,不仅是老牌的Google Brain,Facebook AI Research和DeepMind,还有苹果、亚马逊等公司也有自己的专场讲座。

除了主会场的日程之外,各公司在中午和晚上也使出浑身解数吸引大家去参加午餐会、晚宴和深夜派对。我这次应邀参加了很多知名公司的聚会,为大家带来第一手体验报告。

冉冉升起的DeepMind公司,自从阿法狗威震四海之后也是越来越高冷了。他们NIPS的after-party是严格的邀请制。别的公司即使没有邀请,一般也会让到场的人临时注册。但是,DeepMind好几个警卫守在入口处,把不速之客们无情地拒之门外。据说每个DeepMind的员工只能邀请一个亲朋好友参加。

派对当然是在高大上的地方举办:

这次非常幸运地在派对上遇到了DeepMind首席科学家,阿法狗的主要发明人之一David Silver。在阿法狗之前,他就已经在强化学习领域里战果卓著了,比如2015年发在《自然》杂志上的Deep Q-Network深度强化学习算法,能从没有任何背景知识的情况下,在经典的Atari电子游戏上超越人类玩家的水平。

我上个月在斯坦福看了AlphaGo的纪录片,对里面一些细节跟Silver大神讨论了下,还称赞了他在电影里的演技——我开玩笑说:“咱现在就在洛杉矶,距离好莱坞那么近,您应该去那儿开个讲座!”

Elon Musk自然不会错过NIPS这样人才济济的地方。我们组毕业的学长、现任特斯拉无人驾驶总负责人的Andrej Karpathy也一起参加了特斯拉的座谈会。

会上我问了Elon,特斯拉无人驾驶的视觉系统是否能防御Adversarial Attack(恶意干扰神经网络的算法),Elon说:“所有交通信号灯和路牌都在地图数据库里,不需要当场识别,但是你要故意攻击无人车,总是有办法的。”(下图左二是Elon Musk,左三是Karpathy。)

这次在京东的午餐会上,我听了京东人工智能负责人周伯文老师的演讲,了解到京东在人工智能上的投资非常巨大,应用也比我想象的广泛很多。京东会和斯坦福AI实验室一起合作科研,我非常期待!

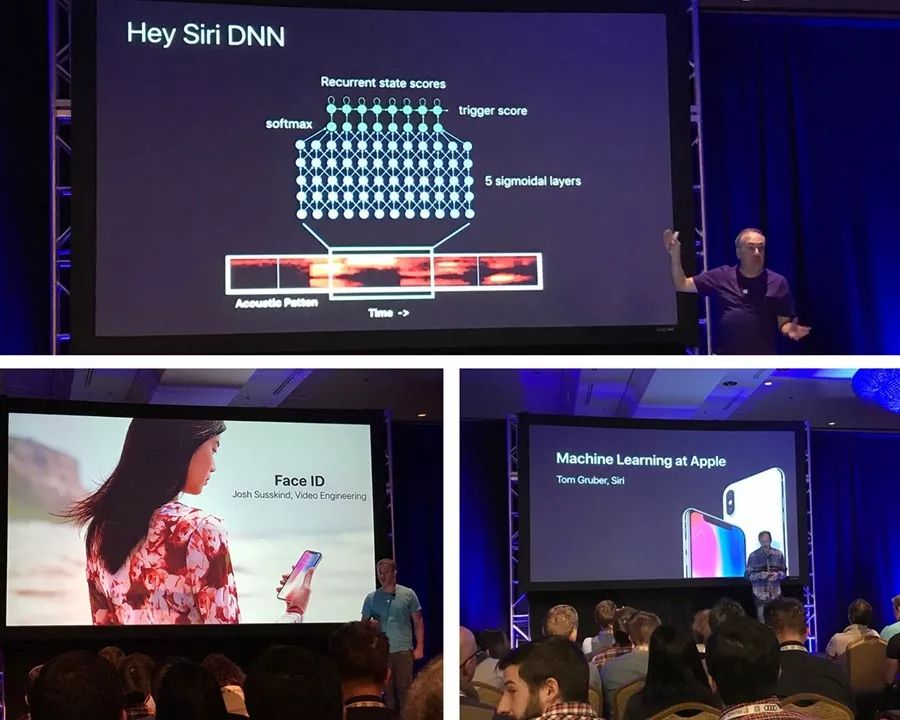

迫于开放研究的浪潮,一直守口如瓶的苹果公司居然也开了讲座,告诉大家FaceID(iPhoneX面部识别)、Animoji(动态表情)、和Hey Siri(Siri语音识别关键字识别)背后的秘密。

苹果FaceID技术讲座和“Hey Siri”关键字检测技术背后的神经网络

Facebook ONNX团队的活动在Parker Lighthouse举办 。ONNX全称是Open Neural Network Exchange format,是一个能让不同的深度学习平台互相贯通的桥梁。现在官方支持的是架构有PyTorch、Caffe2、CNTK(微软)和MXNet(亚马逊)。Tensorflow也有支持,但是是非官方的community effort。

举个例子,比如你在PyTorch里写的机器翻译的回馈式神经网络,你能很方便地把训练好的网络用ONNX导出参数和架构,然后在Caffe2里deploy,这样运行效率会高很多。可以说,ONNX提供了一个从实验研究直接到工业应用的捷径。

在晚餐会上,ONNX宣布支持三个公司的深度学习架构:AWS(亚马逊云计算 MXNet)、Facebook Open Source(脸书开源计划 PyTorch和Caffe2)、Microsoft(微软CNTK)。

ONNX如此重要的项目,自然会有众多大佬出席!上图Yann Lecun大神在演讲致辞后自拍,他现在是Facebook人工智能实验室FAIR的主任。我还远远看到了贾扬清大神,并且和久仰的Adam Paszke谈了很久,Adam是PyTorch的发明人之一,非常年轻有为。

这次听说黄老板要亲临NIPS,我在第一天就去找英伟达的HR预订了after-party的邀请函。英伟达是NIPS的钻石级赞助商,黄老板自然不计成本吸引来自世界各地的AI精英们。晚上的after-party简直是黄老板的私人脱口秀。现场的气氛和演唱会几乎没有区别,一直处于燃点,时不时就能听到大家的尖叫和疯狂的鼓掌声。

英伟达现场揭幕了Titan V GPU!Titan V是台式机显卡,面向机器学习研究人员、开发人员和数据科学家,这些人都希望能够在台式机上构建和测试机器学习系统。

从左到右,从上到下:Pedro Domingos上台领取领取纪念版Titan X;黄老板给Yoshua Bengio大师颁奖;好莱坞的乐团现场演奏AI谱曲的交响乐;黄老板给苹果公司AI主任科学家Ruslan Salakhutdinov颁奖;有黄老板签名的纪念水杯,抽中可以免费领取英伟达Titan V

黄老板还精心策划了彩蛋。参加活动的观众里有20位幸运儿抽中了一台Titan V,抽奖方式非常独特:进门的时候,每个人都领到了一个纪念杯。如果这个杯子上有黄老板的签字,那么就恭喜你!(可惜我没抽中……)

现场还赠送了星球大战典藏版的Titan X GPU,另外20位幸运的观众还抽到Star Wars Titan X。黄老板还请来了好莱坞的乐团,为大家现场演奏AIVA谱的交响乐。AIVA是一个音乐人工智能,能够自动合成谱子,音效时而唯美时而震撼。当晚画龙点睛之笔!

小结

2017年是第三十一届NIPS大会。三十一年,一代科学巨匠们的辉煌历史!本次大会上,学术圈百家争鸣,企业界也百花齐放,大家从各种不同的领域、不同的视角、和不同的应用出发,为人工智能的发展做出自己的一份贡献。

本届NIPS主席Samy Bengio在开幕式上说,他当年在丹佛市参加第一届会议的时候只有一百多人,坐一个大厅绰绰有余。而今年有超过8500人注册,很多会场甚至站无虚席。人数在逐年指数增长,而唯一不变的是我们追求科学真谛的执著,还有人类创造智能的古老的梦想。更多内容,访问新智元小程序,回顾NIPS 2017(要往前多翻几页哦~)

最后一天的夕阳:

(本文图片来自作者,未经授权请勿使用)

12月20日,东方科技论坛青年学者论坛举办人工智能海外博士生研讨会,Jim将在新智元小程序“新智元V享圈”全程直播,欢迎围观!