![]()

CSIG文档图像分析与识别专业委员会学术微沙龙(简称:文档图像微沙龙)在线学术报告会第六期于2022年3月1日成功举行。本沙龙由中国图象图形学学会主办,文档图像分析与识别专委会发起承办,中国图象图形学报协办。本期活动邀请中国科学技术大学博士后方山城分享报告: ABINet:一种用于场景文字识别的自治、双向、迭代语言建模方法。微沙龙活动在B站、蔻享学术,中国图像图形学报视频号进行了同步直播。

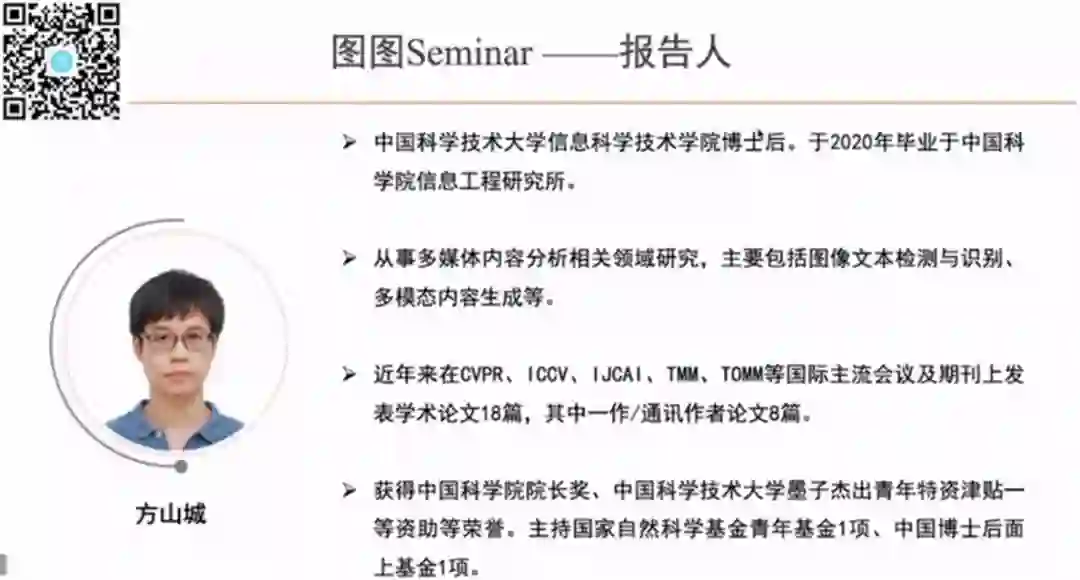

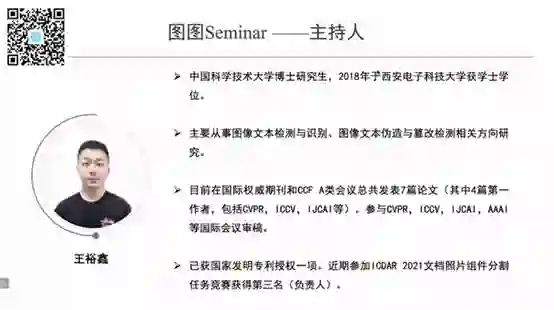

本次活动由中国科学技术大学博士生王裕鑫主持,中国科学技术大学博士后方山城做了题为“ABINet:一种用于场景文字识别的自治、双向、迭代语言建模方法”的学术报告。报告首先介绍了目前OCR领域内常用的视觉模型与语言模型,从形式化定义和直观示例两个层面展示了两种模型各自的特点及实际运用场景。通过对目前基于视觉模型和基于语言模型的场景文本识别方法归纳总结,指出现有方法存在的多个问题,介绍ABINet的设计出发点,引出研究动机。接下来对ABINet的网络结构设计、半监督集成训练方式和扩展至端到端场景文字识别任务三个方面进行了详细的介绍。通过大量的实验进一步证明了ABINet结构的优越性,此外在3个公开训练数据集的加持下,ABINet在6个公开测试数据集上都达到了SOTA,基于ABINet扩展的端到端场景文字识别模型也同样在4个公开数据集上刷新了SOTA精度。目前ABINet已在github平台(https://github.com/FangShancheng/ABINet)公开了源码。最后,报告嘉宾回答了听众提出的一系列问题,并针对目前OCR领域在学术和工业界广泛存在问题给出了一些潜在的解决方案,并号召广大研究人员共同探索解决。

Fang S, Xie H, Wang Y, et al. Read like humans: autonomous, bidirectional and iterative language modeling for scene text recognition[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2021: 7098-7107.

本次报告会获得了良好效果,我们期待更多优秀青年学子在文档图像领域取得研究进展,并在后续的沙龙报告会中踊跃参与、共同进步!

https://www.bilibili.com/video/BV18U4y1f7HF

来源:CSIG文档图像分析与识别专委会

![]()