【NeurIPS 2020 】面向张量分解知识图谱补全的对偶诱导正则

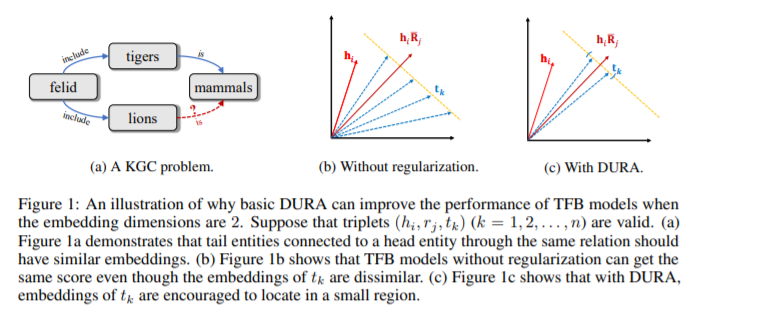

近年来,张量分解模型凭借模型简洁、计算速度快等优点在知识图谱补全任务上取得了令人瞩目的成就。但是,这些模型较易受到过拟合的影响,在性能上通常落后于其他类型的模型。为解决过拟合问题,包括 L2 正则,N3 正则 [1] 在内的多种正则项被提出,但这些正则项又在性能或者适用范围上存在明显缺陷。为此,我们基于知识图谱补全模型之间的对偶性,为张量分解模型提出了一种新的正则项---DURA。该正则项可以广泛地应用于多种不同的张量分解知识图谱补全模型,且能够显著提升模型性能。

https://arxiv.org/abs/2011.05816

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“DIRT” 就可以获取《【NeurIPS 2020】面向张量分解知识图谱补全的对偶诱导正则》专知下载链接

登录查看更多