AI的freestyle如何到来?

中国新歌声、新说唱强势回归,音乐类节目重获大众关注,在欣赏不同风格的选手演绎各式各样的歌曲同时,小线菌不禁想起那些由人工智能「创作」出的作品,它们能骗过受众的耳朵而被认为是由音乐家编写的。

在这个AI来势汹汹的时代,音乐作品的学习和编写对于AI而言仿佛不是什么难事。今天这篇文章,小线菌带你回顾AI与音乐界合作的历史,并且提出对AI作曲的看法。

谈起AI在音乐领域的涉猎,早在计算机刚出现的上世纪50年代,伊利诺伊大学的两位教授雷贾伦·希勒(Lejaren Hiller)和莱纳德·艾萨克森(Leonard Isaacson)在学校的超级计算机Illiac上让历史上第一首完全由计算机“作曲”的音乐作品《Illiac Suite》成功诞生,这发生在1957年。

自动计算机前的雷贾伦·希勒。

40年后,也就是1997年,索尼在巴黎的计算机科学实验室开始研究人工智能合成音乐。他们2014年发布过用人工智能制作的爵士乐;2016年9月发布了用人工智能写作的两首流行歌曲:第一首名为《Daddy’s Car》,带有披头士朗朗上口、阳光轻松的怀旧曲调;另外一首名叫《Mr. Shadow》,模仿的是欧文·柏林(Irving Berlin)和艾灵顿公爵(Duke Ellington)等爵士乐手的风格。

索尼这个人工智能程序名为 Flow Machines,它的机器学习算法学习的不同风格乐谱高达13000份,并且可以让用户在选择特定的风格后立即创作一首曲谱。他们的目标是“将文本、音乐等原始语料的风格抽离出来,并将其转化为可塑的织体(Texture)。”也就是说通过机器学习,Flow Machines 算法能够分析不同风格音乐的“套路”,并通过其他限制条件将这些音乐的结构重新组合成新一首新的音乐。

同样是2016年,谷歌也宣布过一个名为 Magenta 的项目,发布了第一首人工智能创作出的90秒钢琴音乐作品。这是一个基于开源人工智能平台Tensor Flow,以深度神经网络的机器学习来创作艺术的项目,志在利用人工智能研发出自动生成音乐的算法,并将在未来介入视频制作及其它视觉艺术领域的创作。

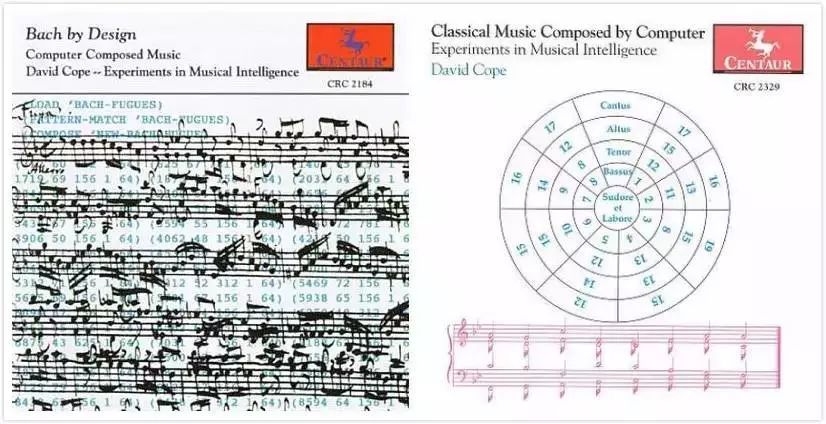

提到AI作曲,就不能不提被称作AI作曲教父的大卫·柯普(David Cope)。这位加州大学圣克鲁兹分校的音乐学教授从上世纪80年代就开始研究音乐与人工智能。他写出程序EMI(Experiments in Musical Intelligence),其工作原理是模式匹配,将音乐片段分割成更小的片段并进行分析,找出相似的声音并进行分类,这一程序一天就能谱出5000首巴赫风格的赞美诗。

EMI的古典乐编曲

还有他写的起名叫「艾米丽·霍薇」(Emily Howell)的「作曲机器人」,可以用全新的风格作曲而非简单地模仿其他作曲家,在 2009 年,机器人艾米丽甚至发布了自己的第一张专辑 ——《 明由暗生(From Darkness, Light)》。

现在,越来越多AI平台试图涉足音乐领域。2017年8月,美国网红歌手Taryn Southern在YouTube上传了和Amper Music(一个能够完成作曲,编曲和演奏的人工智能)共同创作的单曲《Break Free》。让人会心一笑的是,这首歌曲所在的专辑正好就叫「I AM AI」 。

Break Free充满现代感的MV

看到这里,或许你会好奇AI怎样输出自己的freestyle?小线菌这就来介绍一下目前使用比较广泛的几种作曲模型。

马尔科夫链

这是一种基于随机过程、概率逻辑的有限控制方法,结合一定约束规则后能够在统计的基础上对音乐的未来走向进行概率预测与风格边界限制。由于建模简单,可以即时产生新音乐,所以一直被广泛用于商业程序上,也大量出现在互动音乐艺术家的作品和即兴演出中。

遗传算法

这种算法是计算机根据设定好的参数生成原始模型,将对各乐段的人工评估结果作为适应度函数值,分别设定选择、交换和突变规则,通过时值修正来解决乐曲每小节各音符的时值之和的不稳定问题,从而生成音符序列。

人工神经网络

这种模型可以根据一系列人类己经创作好的音乐,提取和存储音高、音长、音量、音色、音程、节奏、调式、和声等关键特征,按照要求大量输出有类似特征的新音乐。它采用具有深度学习能力的各种改进神经网络模型来帮助人工智能模型学习样本音乐中的关键元素以及套路,小线菌认为这也是今后AI形成「freestyle」方法中的最前沿。

当然,如果「freestyle」指自由创作,那么对于AI能否进行自由创作,这个问题本身就存在着争议。

AI作曲的发展速度和成效让人惊叹,当然不乏有负面的声音。有人质疑此举会让人类艺术家的创造力和原创能力大打折扣,批评AI作曲的形式本质上不是「创作」,因为它没有倾注人类的情感和心血,而是基于机械的算法和数据,哪怕是最先进的技术制作出来的旋律也不能和人类哪怕一瞬的音乐灵感相比较。

小线菌在这里并不打算对这些批评下什么结论,人工智能发展到现在这个阶段,没有争议反而说明这件事情没有引起足够的关注。诚然,在感性层面如关于创作的界定还有很大的讨论空间,如果涉及“程序本身还是编写程序的人是真正的科学家”或“人工智能取代人类”甚至还能引发道德和哲学角度的热议。

但是从时代发展的角度来看,小线菌认为AI作曲的前景还是很广阔的,类似的应用如果投放到商业市场无疑能使效率大大提高,如购物商场播放不同的有特定效用的音乐,显然可以利用AI的高产出带来高效率;同时,从用户的角度出发,快时代的时间不会被过多消耗在鉴别作曲者是否是真人上,只要音乐够动听就是可以看作是一个成功的产品。

另一方面,大多数人对AI作曲焦虑的关注点在于它们会让人类音乐家失业,或许相比于音乐的创作性而言这是更实际的问题。小线菌认为,在类似应用的推广过程中,强调技术的亲和性而非侵略性会让这个现象有所缓解。AI在音乐创作过程中充当的是人类的助手,目的是让音乐家更加方便地工作,更不会影响音乐家的工作饭碗,这样的描述显然比描绘一个不需要人类操作、AI自己就能完成独立的音乐输出的场景更能让人接受。说到底还是绕不过人性,能让骄傲的不肯放下身段的人类打消顾虑,之后一切都好说了。

参考资料:

中国艺术报:当机器人也会作曲时

音乐先声:AI写的歌,算原创吗?

利维坦:人工智能是怎么创作音乐的?

五分钟,你可以掌握一个科学知识。

五分钟,你可以了解一个科技热点。

五分钟,你可以近观一个极客故事。

精确解构科技知识,个性表达投融观点。

欢迎关注线性资本。

Linear Path, Nonlinear Growth。