【Facebook AI】无监督机器翻译,336页ppt,Unsupervised Machine Translation

Mikel Artetxe是Facebook人工智能研究中心的一名研究多语言的科学家。他主要研究跨语言表示学习和机器翻译,主要研究无监督和无监督的方法。在此之前,他最近在巴斯克国家大学完成了无监督机器翻译的博士学位,导师是Eneko Agirre和Gorka Labaka,并在谷歌、DeepMind和Facebook实习过。

http://www.mikelartetxe.com/

Unsupervised Machine Translation

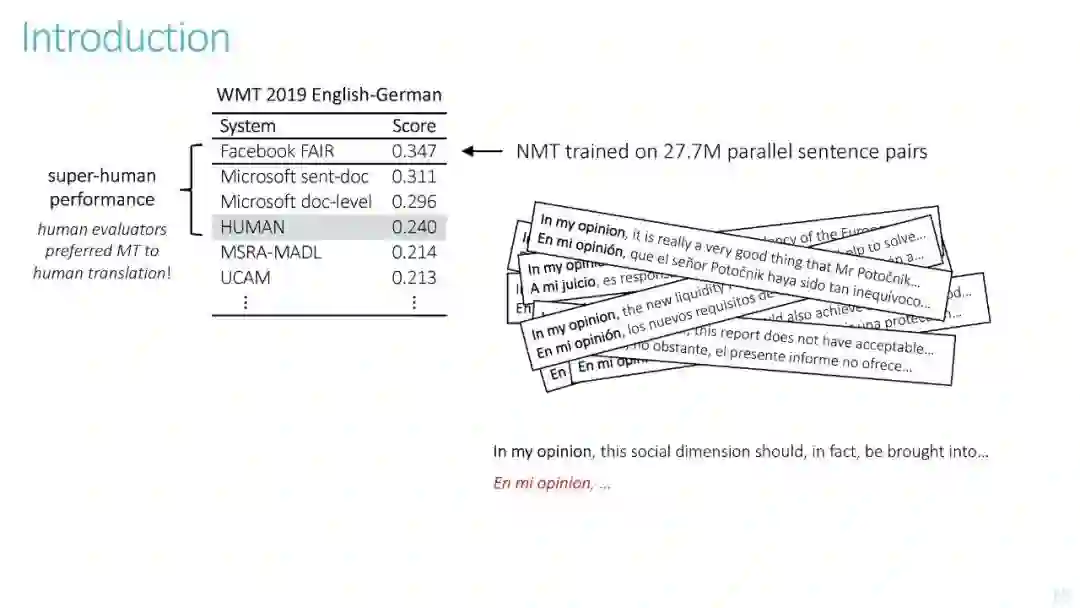

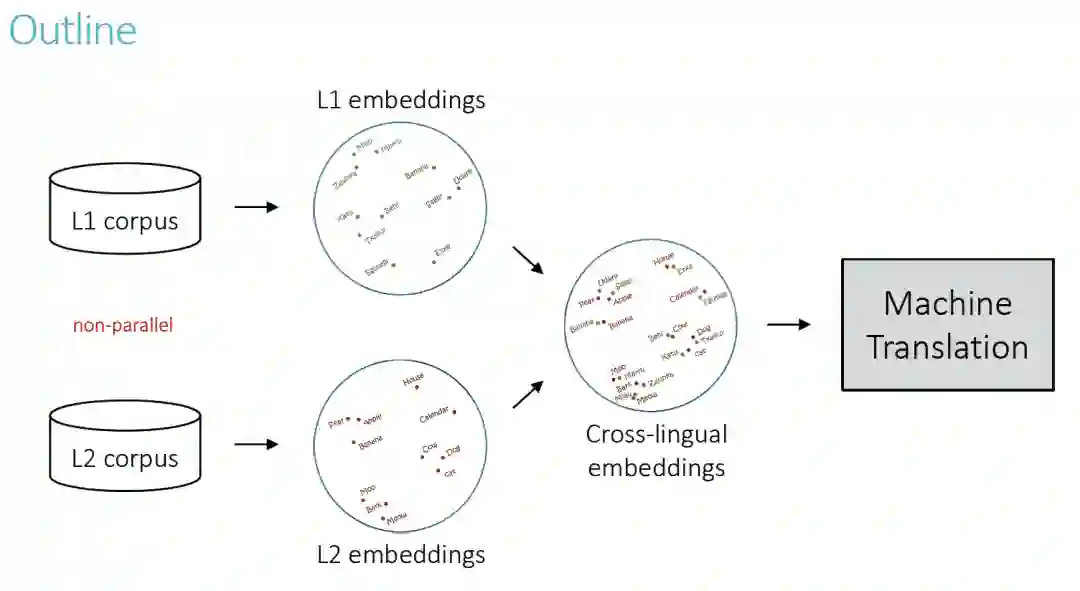

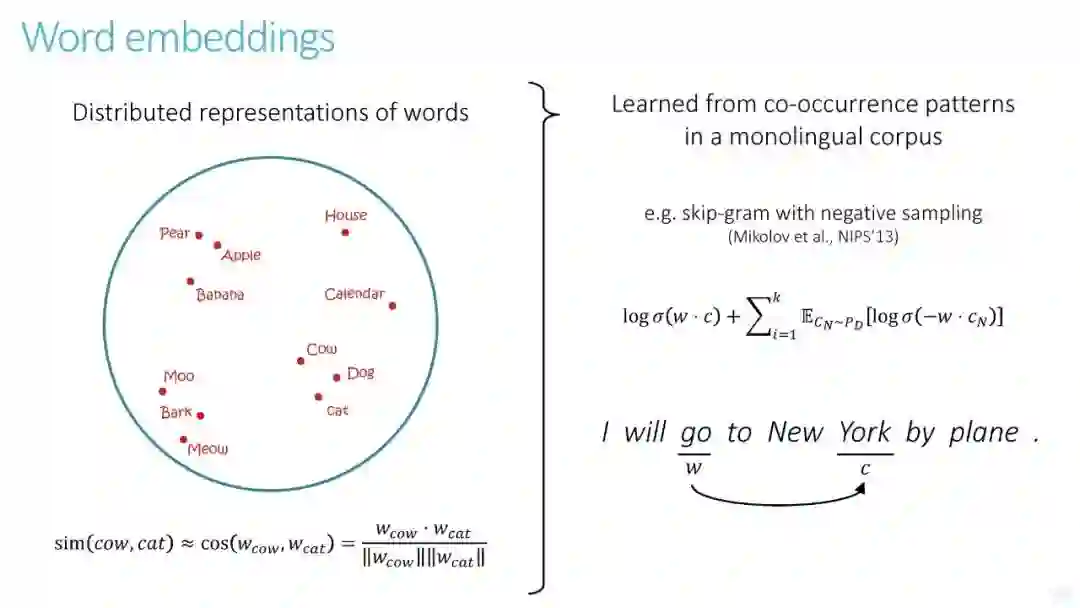

虽然现代机器翻译依赖于大量的平行语料库,但最近的一项研究已经成功地在无监督的情况下训练机器翻译系统,仅使用单语语料库。现有的方法大多依赖于跨语言单词嵌入或深度多语言预训练来进行初始化,并通过迭代反翻译来进一步完善该系统。在这次演讲中,我将对这一领域做一个概述,重点介绍我们自己在跨语言单词嵌入映射以及无监督神经和统计机器翻译方面的工作。

https://nlp.stanford.edu/seminar/details/mikelartetxe.shtml

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“MT336” 就可以获取《【Facebook AI】无监督机器翻译,336页ppt,Unsupervised Machine Translation》专知下载链接

登录查看更多