完结撒花!李宏毅老师深度学习与人类语言处理课程视频及课件(附下载)

李宏毅老师2020新课 深度学习与人类语言处理课程 昨天(7月10日)终于完结了,这门课程里语音和文本的内容各占一半,主要关注近3年的相关技术,自然语言处理部分重点讲述BERT及之后的预处理模型(BERT和它的朋友们),以及相关的NLP任务,包括文本风格迁移、问答系统、聊天机器人以及最新的GPT3解读等,是难得的深度学习NLP最新学习材料。当然最重要是这是一门中文课程,李宏毅老师的课程质量又极高,再次认真的推荐给各位NLPer:

课程主页:http://speech.ee.ntu.edu.tw/~tlkagk/courses_DLHLP20.html

B站传送门:https://www.bilibili.com/video/BV1RE411g7rQ

如果需要该课程视频和课件,可以扫码关注以下公众号后台回复“DLHLP”获取课程视频和相关课件网盘链接,另外我们建立了一个李宏毅老师课程的学习交流群,感兴趣的同学可以添加微信 AINLPer(id: ainlper) ,备注“B站李宏毅”进群一起交流学习。

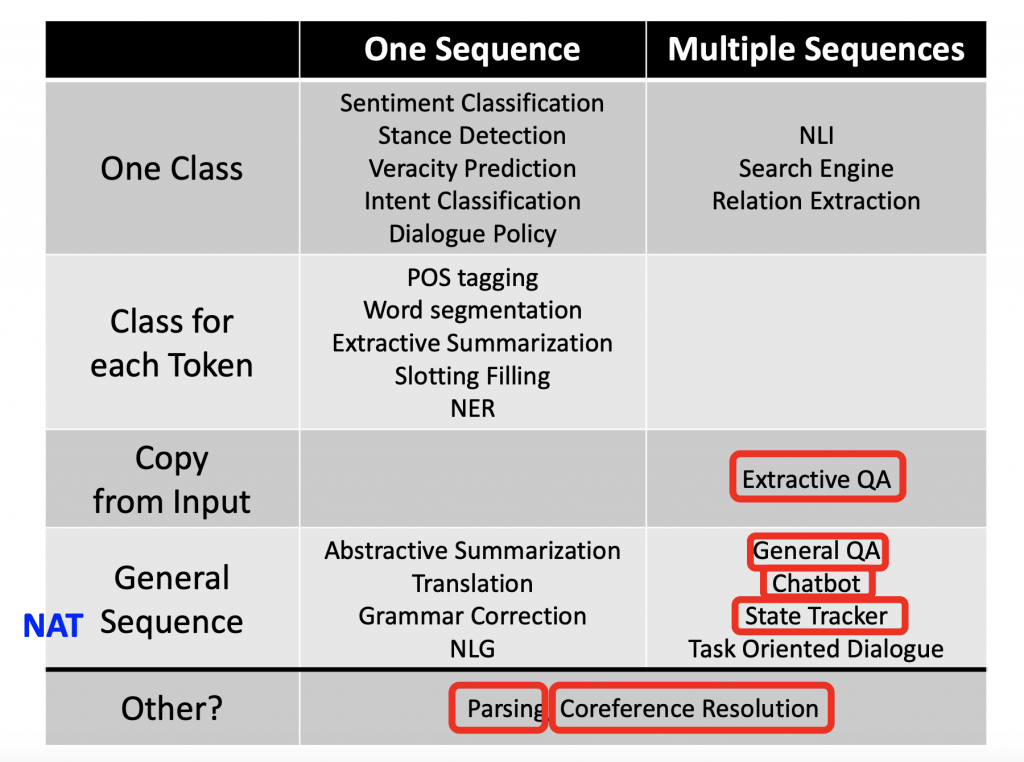

在7月10日最后一次的课程中,李宏毅老师在课程视频结尾处再次引用了之前的2张PPT作为结束来总结这门课程的主要内容和自然语言处理相关任务的划分:

最后我们已经将这门课程的视频和课件打包,如果需要,可以扫码关注以下公众号后回复“DLHLP”获取该课程视频和相关课件网盘链接,另外我们建立了一个李宏毅老师课程的学习交流群,感兴趣的同学可以添加微信 AINLPer(id: ainlper) ,备注“B站李宏毅”进群一起交流学习:

附第一课课程介绍:

推荐阅读

模型压缩实践系列之——bert-of-theseus,一个非常亲民的bert压缩方法

征稿启示| 200元稿费+5000DBC(价值20个小时GPU算力)

文本自动摘要任务的“不完全”心得总结番外篇——submodular函数优化

斯坦福大学NLP组Python深度学习自然语言处理工具Stanza试用

关于AINLP

AINLP 是一个有趣有AI的自然语言处理社区,专注于 AI、NLP、机器学习、深度学习、推荐算法等相关技术的分享,主题包括文本摘要、智能问答、聊天机器人、机器翻译、自动生成、知识图谱、预训练模型、推荐系统、计算广告、招聘信息、求职经验分享等,欢迎关注!加技术交流群请添加AINLPer(id:ainlper),备注工作/研究方向+加群目的。

阅读至此了,分享、点赞、在看三选一吧🙏