深度学习先驱 Yann LeCun 被骂到封推!AI 偏见真该甩锅数据集?

最近,人工智能领域又发生了一次热热闹闹的争论,随后演变成一场偏离轨道的争吵,目前以 Yann 道歉封推暂告一段落......

争论来龙去脉

这次争论的主角是图灵奖得主、人工智能标杆性人物 Yann LeCun,争论源自于 Yann 针对一篇 CVPR 论文提出的 PULSE 算法发表的一句观点。

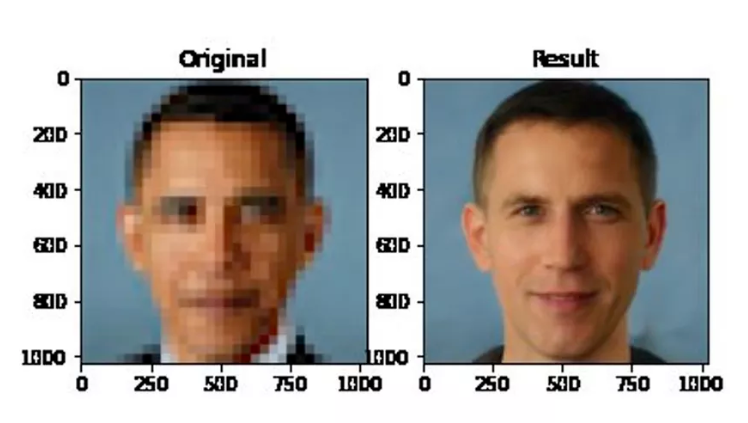

PULSE 算法是美国杜克大学研究人员发明的一种新的图像识别算法,它可以将低分辨图片变成高清图片,细致到毛孔、头发都能神还原,即使是被打了马赛克的图片,也可以通过该算法“脑补”出清晰地图片。于是一张引起争议的图片诞生了:

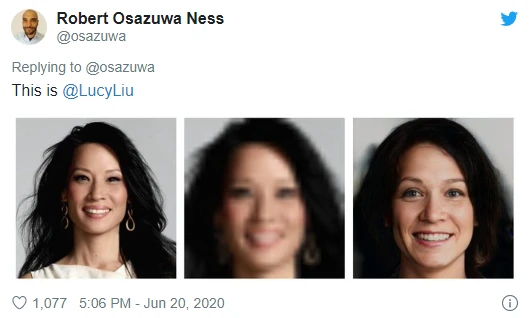

有人用作者在论文中开源的代码进行了模型推理,使用美国前总统奥巴马的打码图像进行了试验,结果发现奥巴马被还原成了白人。

为了证明还原照片不是假的,还有人用自己和更多人的照片做了对比实验,可以很清楚地看到,生成照片中的人都具有了白人的特征。

一石激起千层浪,尤其是在这个特殊时期,有色人种被还原成白人的事挑起了大家对于 AI 系统产生偏见(bias)的批判,也再次警醒人们,AI 技术带有偏见所带来的潜在危机。

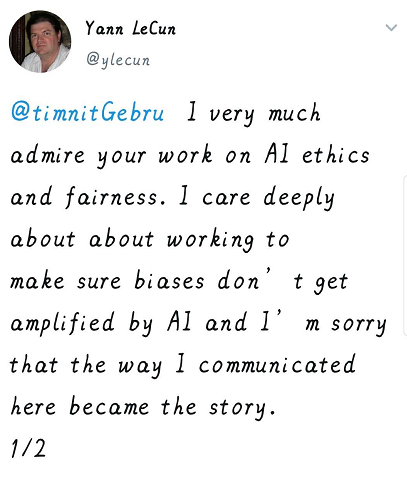

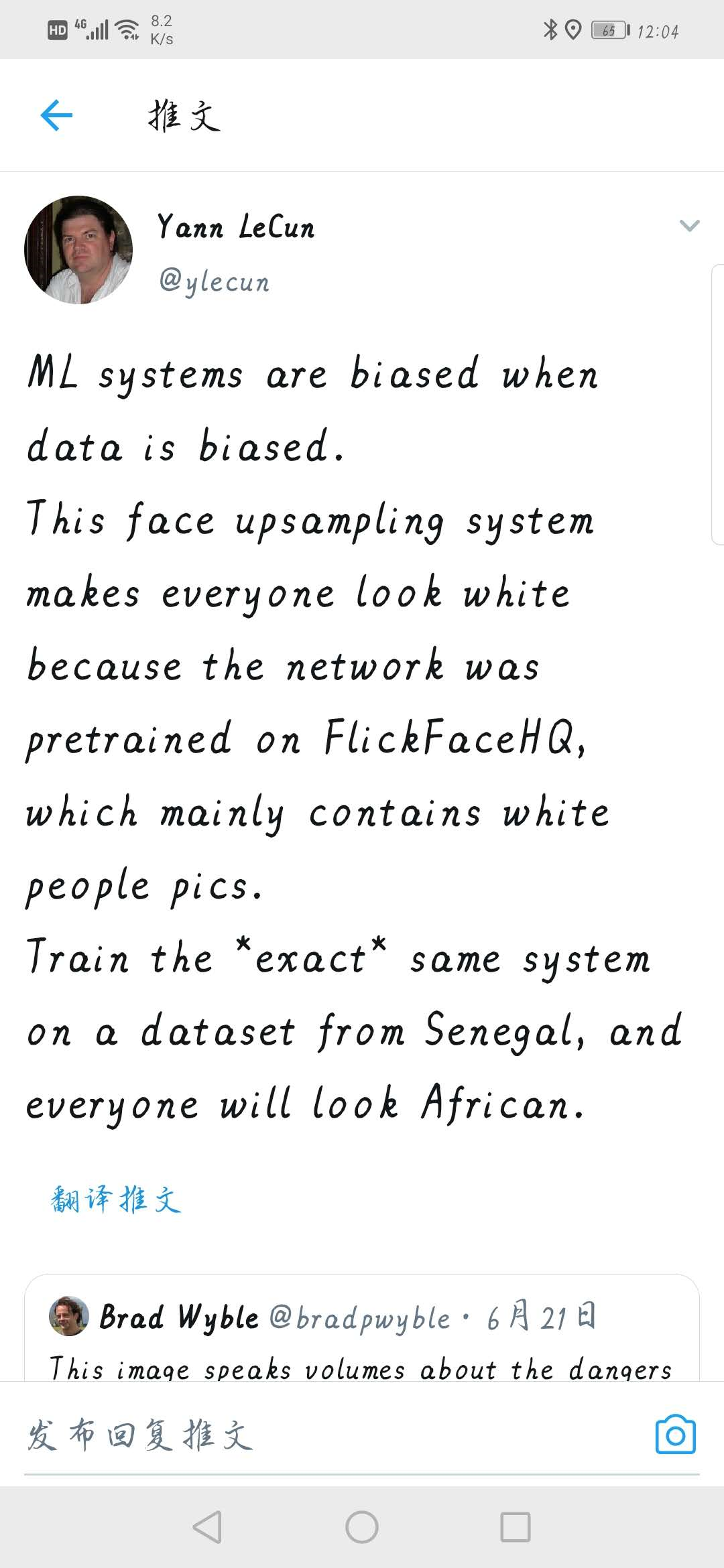

而 Yann 此时在 Twitter 上发表了自己的观点:

推文大意是,当数据集有偏见时,机器学习系统也随之产生偏见。这个系统之所以让生成图片看起来都是白人是因为系统在只包含白人图像的 FlickFaceHQ 数据集上进行预训练,换成一个来自塞内加尔的数据集,同一个系统生成的图像看起来就是非洲人了。

就是这样一句话引起了争议,有人说,机器学习系统产生偏见不应只归咎于数据集,这种甩锅的做法是不公平的,还有人的原因、观念的原因,等等,最后评论区的声音很快偏离轨道,没有多少人关心关于偏见的学术和技术讨论,而是转移到具有煽动性的种族话题讨论中, Yann 也终于疲于应对指责,发布了一条道歉推文,宣布自己从此将不再在推特发表重要观点。

PULSE 算法如何产生偏见?

抛开不理智的声音,这次陷入争论中心的 AI 系统偏见其实是一个存在很久热度很高的话题,今天我们就来看一下,还原马赛克图片背后的PULSE 算法究竟是怎么回事,为什么会产生偏见。

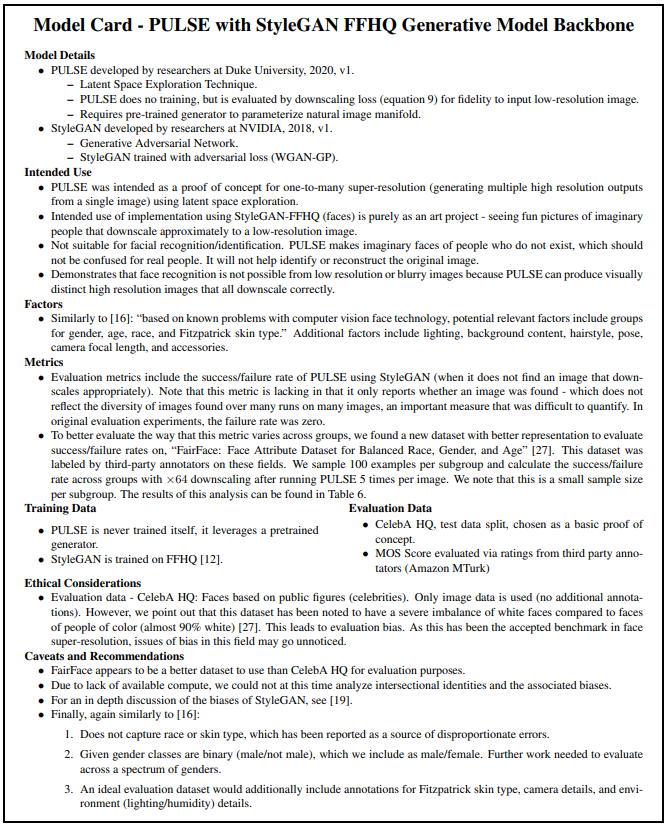

PULSE 算法背后的团队来自杜克大学,阐述这一算法的论文入选了 CVPR 2020 大会。

论文地址:https://arxiv.org/pdf/2003.03808.pdf

简单来说,该算法利用了“放大(upscaling)”技术来处理图像中的像素,其工作原理类似于将低分辨率电影高清化,就是在放大画面后增强细节。问题是,马赛克图片缺少了很多像素细节,PULSE 算法必须借助机器学习技术来填补像素不足的地方,也就是说,还原后的图像实际上并不是说复原图像本来真实的样子,而是算法通过数据记得训练,“脑补”出新的图像。

而“脑补”的过程,就需要用到英伟达的 StyleGAN。PULSE 算法进一步利用了 StyleGAN 的想象力。论文作者在文章中也指出,虽然用 PULSE 用 StyleGAN(在FFHQ上训练)作为生成模型生成了令人印象深刻的图像质量,但他们注意到当在测试以外的人脸自然图像上进行实验时会产生偏见,而他们认为 PULSE 的偏见继承自 StyleGAN 的一些固有偏见,并提出了这种偏见的来源:

-

从潜在空间约束继承的偏差:如果为StyleGAN有色人种分布在隐空间较低密度的区域会产生偏见,这是因为PULSE对潜在空间的的必要限制,以持续生成高分辨率图像。 -

无法收敛:在GitHub上发布的初始代码中,当在优化结束时 PULSE 仍未找到正确缩小的图像(在内)时,PULSE 无法返回“找不到图像”。因此,可能的问题是,在 StyleGAN 的输出中很难找到有色人种要比白人人少的图像。 -

从优化继承而来:这意味着受约束的潜在空间包含各种有色人种的图像,但PULSE的优化程序未找到它们。但是,如果是这种情况,那么我们应该能够在受约束的潜在空间中找到具有足够随机初始化的图像。但是经过试验似乎并不奏效。 -

从StyleGAN继承:一些人指出,似乎在StyleGAN的增强的潜在空间中可以生成更多元化的图像。但是,这与StyleGAN本身在训练后生成的图像集并不相似,例如,在同一篇论文中,作者展示了嵌入的不相关领域(例如猫)的图像也很成功。在他们的工作中,PULSE仅限于StyleGAN认为是真实的人脸图像。

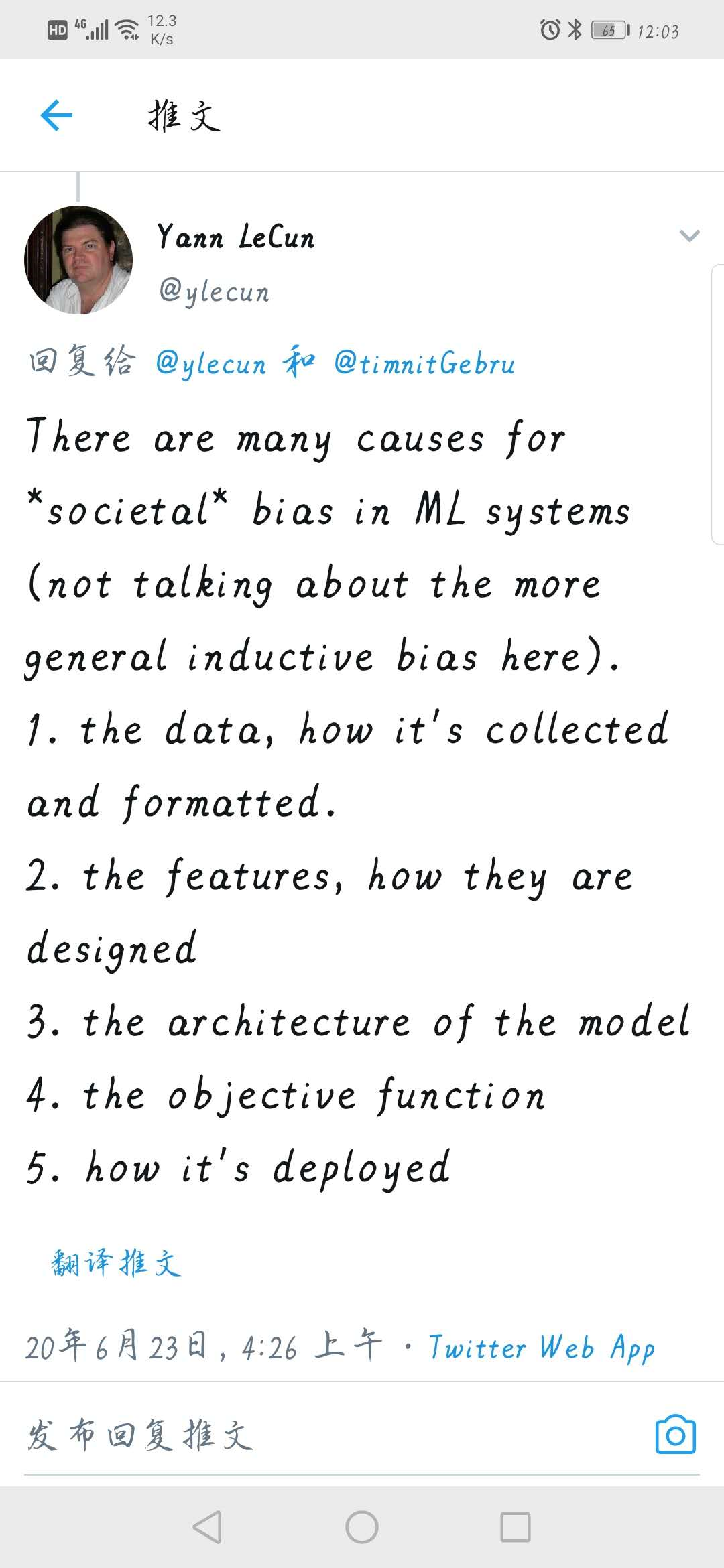

偏见都甩锅给数据集对吗?

机器学习系统中导致社会偏见的原因很多(这里不谈论更一般的归纳偏置): 1.如何收集数据和格式化

2.特征设计

3.模型的架构

4.目标函数

5.部署方式

摒弃偏见,还能从哪里入手?

【END】

更多精彩推荐

☞专访 | 「Smartbi 」VP徐晶:未来,BI将成为决策者的诸葛亮

☞密码界“女杀手”,破译世上最安全密码系统,获 771 万奖金!

☞他被称为"中国第一程序员",一人之力单挑微软,如今拜入武当修道

![]()

欢迎“分享”、“点赞”、“在看”三连走起!