机器之心 & ArXiv Weekly Radiostation

参与:杜伟、楚航、罗若天

本周的重要论文包括牛津大学等机构的学者利用机器学习算法实现 10 万高压非晶硅原子的模拟,以及香港大学和字节跳动 AI 实验室研究者提出的端到端单阶段目标检测器 OneNet。

Liquid Warping GAN with Attention: A Unified Framework for Human Image Synthesis

OneNet: Towards End-to-End One-Stage Object Detection

Learning Search Space Partition for Black-box Optimization using Monte Carlo Tree Search

Origins of Structural and Electronic Transitions in Disordered Silicon

DEBERTA: DECODING-ENHANCED BERT WITH DISENTANGLED ATTENTION

AutoDropout: Learning Dropout Patterns to Regularize Deep Networks

ERNIE-M: Enhanced Multilingual Representation by Aligning Cross-lingual Semantics with Monolingual Corpora

ArXiv Weekly Radiostation:NLP、CV、ML 更多精选论文(附音频)

论文 1:Liquid Warping GAN with Attention: A Unified Framework for Human Image Synthesis

摘要:

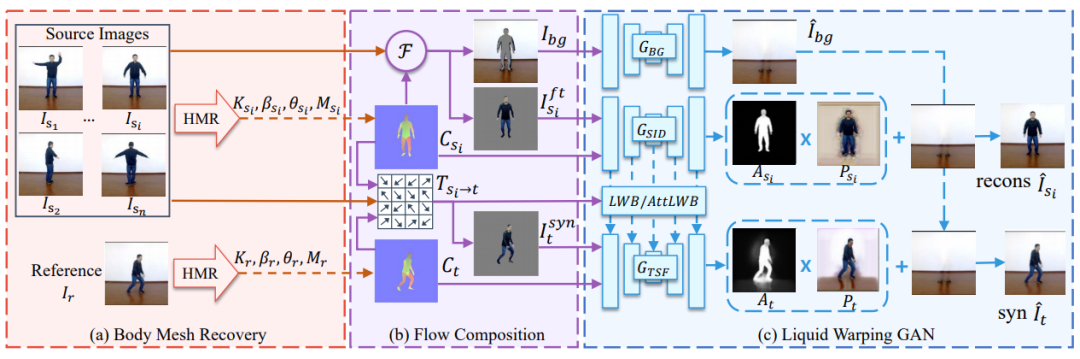

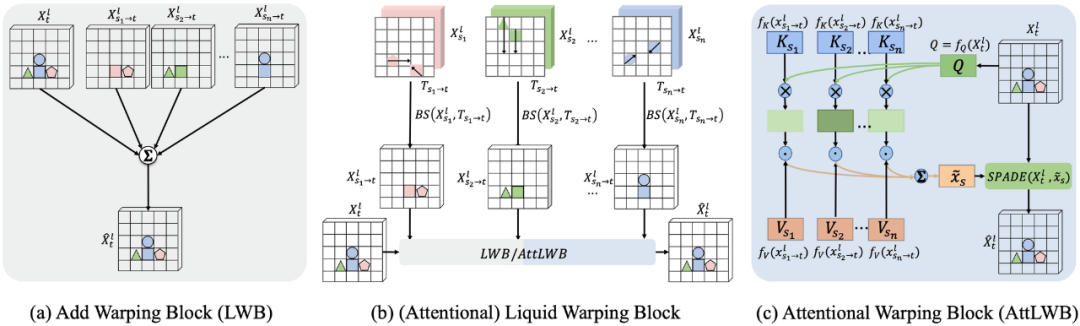

去年,来自上海科技大学和腾讯 AI Lab 的研究者的研究论文《Liquid Warping GAN: A Unified Framework for Human Motion Imitation, Appearance Transfer and Novel View Synthesis》入选计算机视觉顶会 ICCV 2019。经过一年的努力,该论文所提方法的改进版诞生了。

改进版的优势在于源图像的数量从一张变为一组

。以动作合成为例,源图像是一组不同视角的图像,因此合成结果从多个角度看起来效果更好。具体而言,为了较好地表征源图像的识别性信息,该研究采用去噪卷积自动编码器提取源特征。此外,该方法还可以支持来自多源的更灵活的 warping。为了进一步提高未知源图像的泛化能力,该研究采用了 one/few-shot 对抗学习。

![]()

![]()

![]()

推荐:

舞蹈的转身和面向背后的动作合成效果都有所提升。

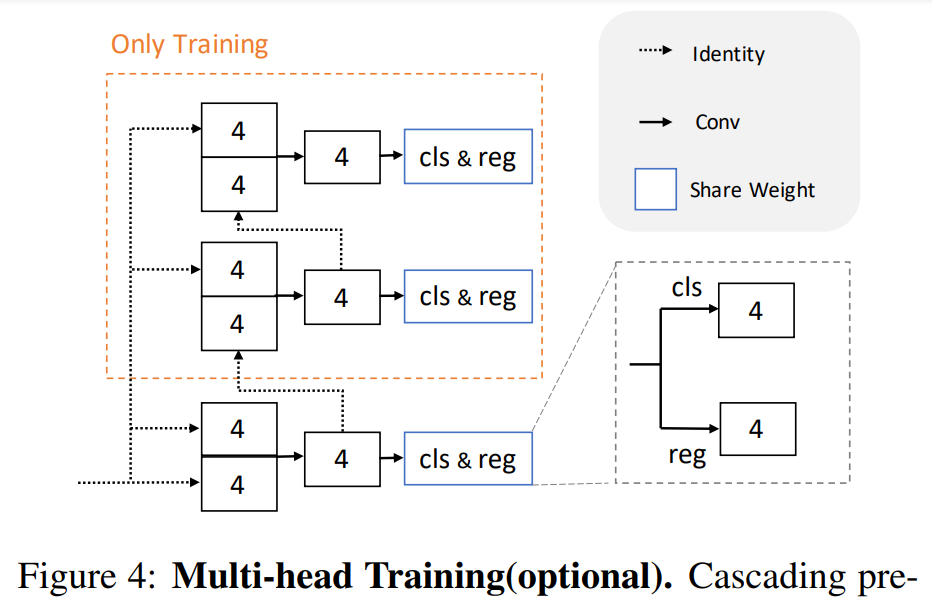

论文 2:OneNet: Towards End-to-End One-Stage Object Detection

摘要:

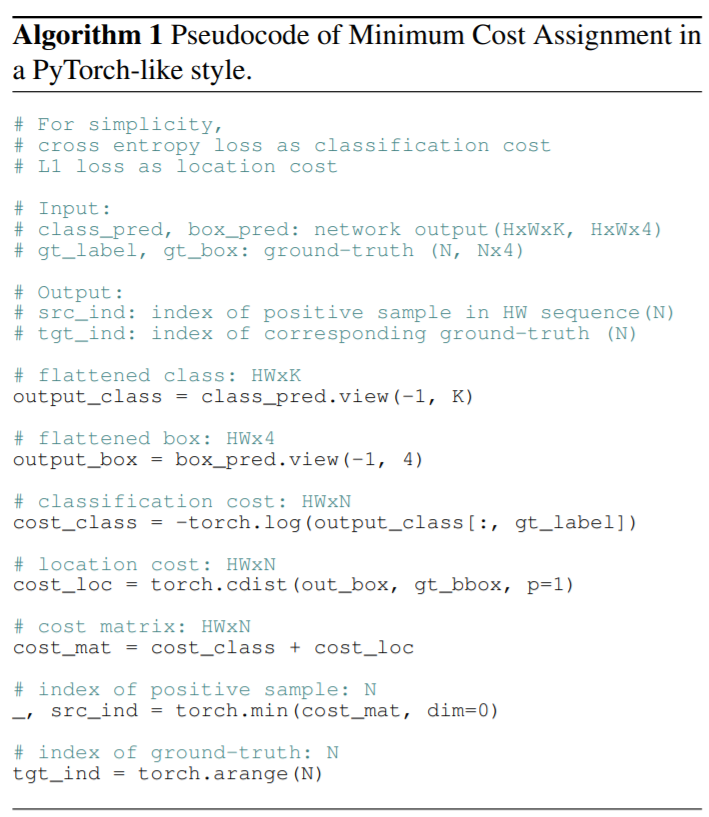

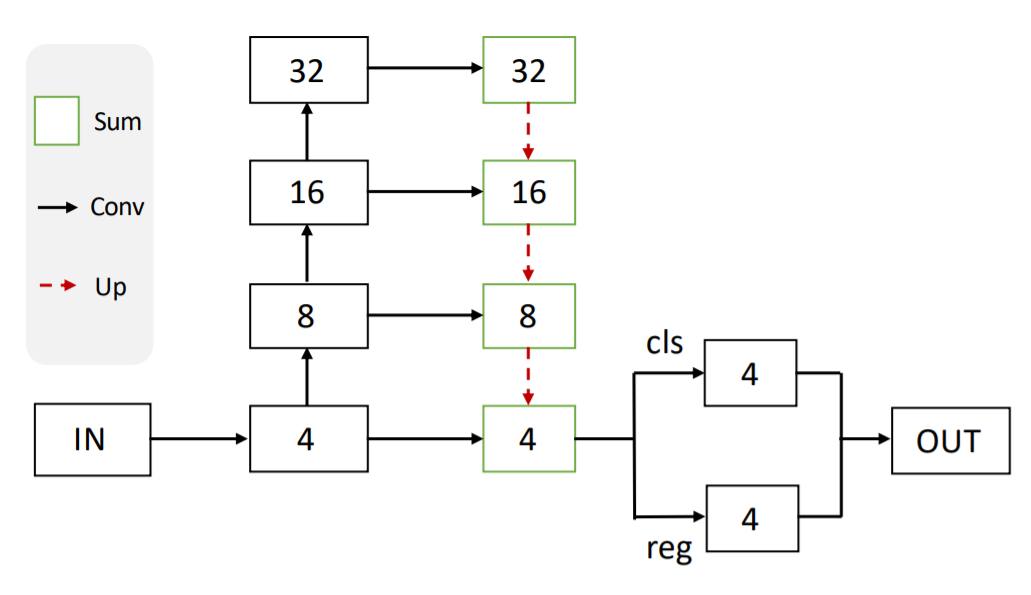

在本文中,来自香港大学和字节跳动 AI 实验室的研究者发现:标签分配中样本与真值之间缺乏分类代价是 one-stage 检测器移除非最大抑制(NMS)并实现端到端的主要障碍。现有的 one-stage 目标检测仅通过位置代价来分配标签,例如框 IoU、点距离。在缺少分类代价的情况,单独的位置代价将将导致高置信度得分在推理中产生冗余框,从而使 NMS 成为必要的后处理。

为了设计一种

端到端 one-stage 目标检测器

,研究者提出了

最小代价分配(Minimum Cost Assignment)

。代价是样本与真值之间的分类代价和位置代价的总和。对于每个目标真值,仅将一个最小代价样本分配为正样本,其他都是负样本。为了评估该方法的有效性,研究者设计了一个非常简单的 one-stage 检测器 OneNet。实验结果表明,在经过「最小代价分配」训练后,OneNet 避免了产生重复框,并实现了端到端目标检测。在 COCO 数据集上,OneNet 实现了 35.0 AP/80 FPS 和 37.7 AP/50 FPS,图像大小为 512 像素。

![]()

![]()

![]()

推荐:

首次实现了在 dense detector 中无需 NMS 后处理。

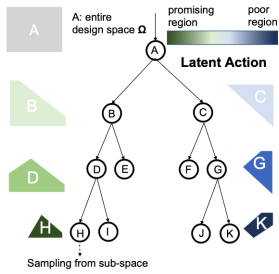

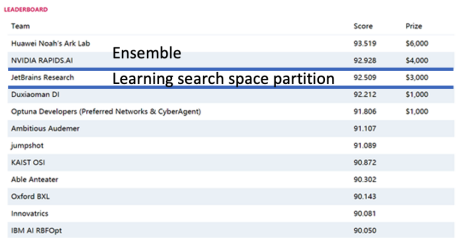

论文 3:Learning Search Space Partition for Black-box Optimization using Monte Carlo Tree Search

摘要:

现实世界的大多数系统是没有办法给出一个确切的函数定义,比如机器学习模型中的调参,大规模数据中心的冷藏策略等问题。这类问题统统被定义为黑盒优化。黑盒优化是在没办法求解梯度的情况下,通过观察输入和输出,去猜测优化变量的最优解。在过去的几十年发展中,遗传算法和贝叶斯优化一直是黑盒优化最热门的方法。

不同于主流算法,

布朗大学的研究者和 Facebook 田渊栋团队在本文中联合介绍一个基于蒙特卡洛树搜索(MCTS)的全新黑盒优化算法,隐动作集蒙特卡洛树搜索 (LA-MCTS)

。LA-MCTS 发表在 2020 年的 NeurIPS,仅仅在文章公开几个月后,就被来自俄罗斯 JetBrains 和韩国的 KAIST 的队伍独立复现,并用来参加 2020 年 NeurIPS 的黑盒优化挑战,分别取得了第三名和第八名的好成绩 。

![]()

![]()

![]()

NeurIPS 2020 黑盒优化挑战赛 leaderboard。

推荐:

论文一作王林楠是布朗大学第四年博士生,他的研究方向为人工智能和超级计算。

论文 4:Origins of Structural and Electronic Transitions in Disordered Silicon

摘要:

依靠算法推断能力和强大的算力,很多人都认为 AI 在材料设计、材料筛选和材料性能预测等领域拥有很大潜力。为了对一般无序结构材料有更深的理解,人们广泛研究了非晶硅在高压条件下的富相行为。然而在和原子打交道的层面上,人们一直需要借助量子力学来理解材料的结构和键合,这仅限于尺度很小的模型系统,如果用机器学习算法从量子力学数据中「学习」会是怎么样?

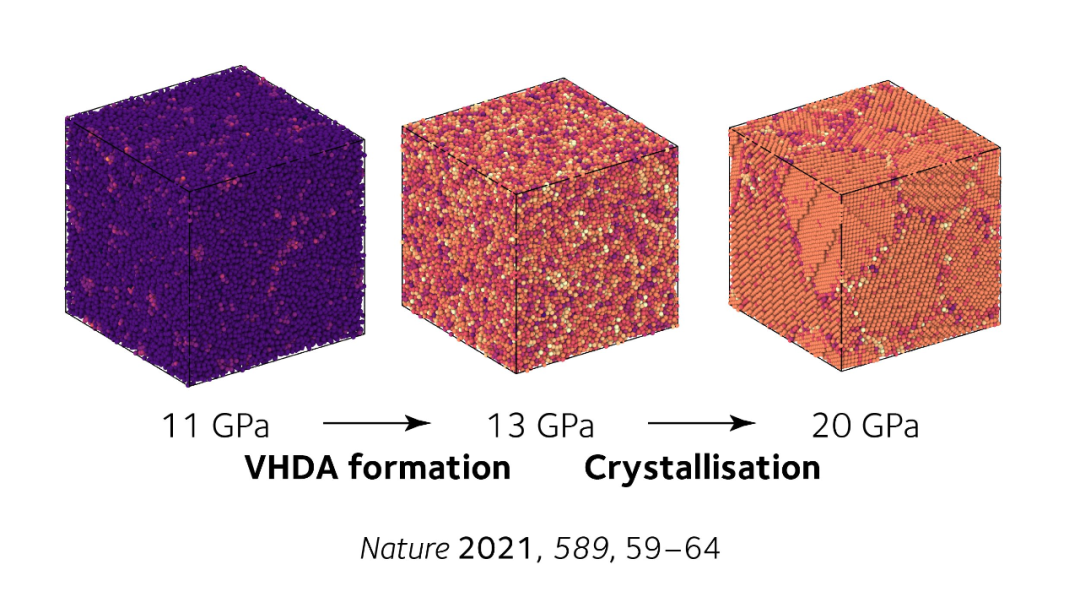

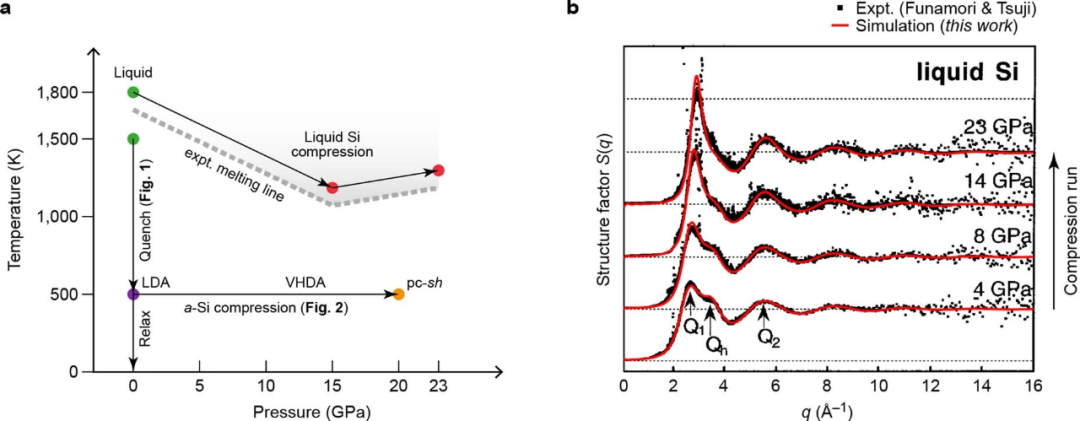

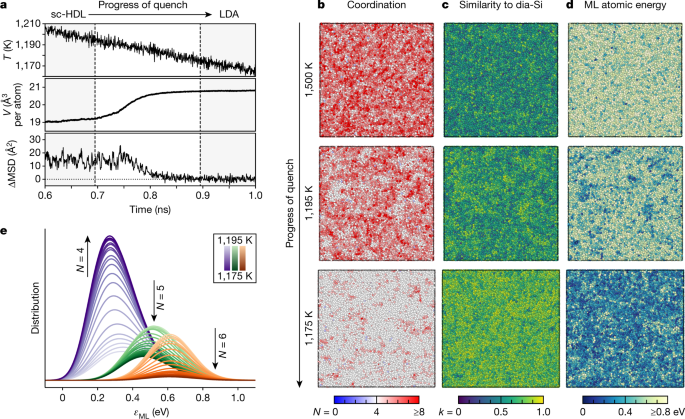

在 2021 年的第一期《自然》杂志封面研究中,来自

牛津大学的 Volker Deringer 等人展示了模拟加压非晶硅的原子机器学习模型,成功解决了这一挑战,并捕获了实验中遇到的所有结构变化

。这种计算方法可以为实验条件极富挑战性的材料预测建模开启全新的方式。这是 2020 年 12 月 DeepMind 人工智能解决生物学 50 年来重大挑战之后,人工智能在又一个新的领域展现强大能力。现在,人类已经能够实现 10 纳米尺度,十万个硅原子系统的模拟——使用常规方法的话,即使是超级计算机也需要耗费大量时间。

![]()

研究者通过机器学习,对包含 10 万个硅原子的系统从冷却的液态到 20 万大气压(20GPa)压缩过程提供了前所未有的结构和键能信息。

![]()

![]()

推荐:

自生物领域之后,材料领域也被人工智能攻陷了。

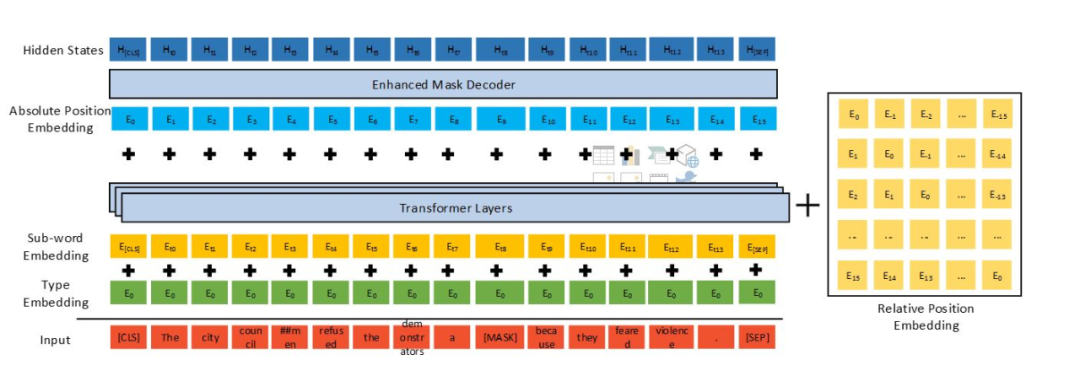

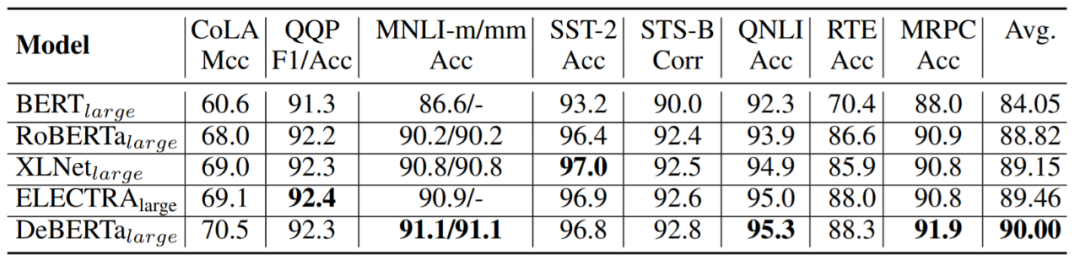

论文 5:DEBERTA: DECODING-ENHANCED BERT WITH DISENTANGLED ATTENTION

摘要:

去年 6 月,来自微软的研究者提出一种新型预训练语言模型 DeBERTa,该模型使用两种新技术改进了 BERT 和 RoBERTa 模型。8 月,该研究开源了模型代码,并提供预训练模型下载。最近这项研究又取得了新的进展。

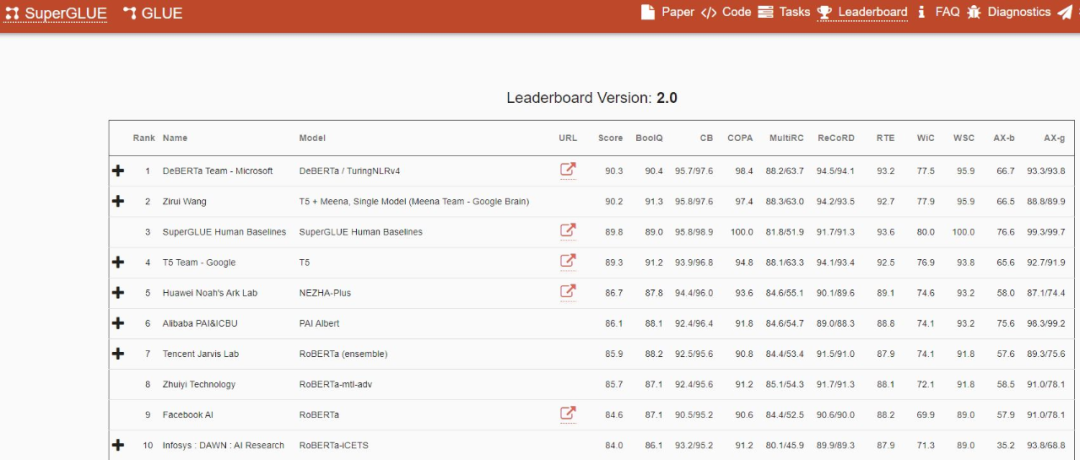

微软最近通过训练更大的版本来更新 DeBERTa 模型,该版本由 48 个 Transformer 层组成,带有 15 亿个参数

。本次扩大规模带来了极大的性能提升,使得单个 DeBERTa 模型 SuperGLUE 上宏平均(macro-average)得分首次超过人类(89.9 vs 89.8),整体 DeBERTa 模型在 SuperGLUE 基准排名中居于首位,以 90.3 的得分显著高出人类基线(89.8)。最近该研究在 arXiv 上提交了 DeBERTa 的最新论文,文中详细介绍了 DeBERTa 模型的方法及最新的实验结果。

![]()

![]()

![]()

SuperGLUE 排行榜,2021 年 1 月 6 日。

推荐:

目前该模型以 90.8 的宏平均(macro-average)得分高居 GLUE 基准排名的首位。

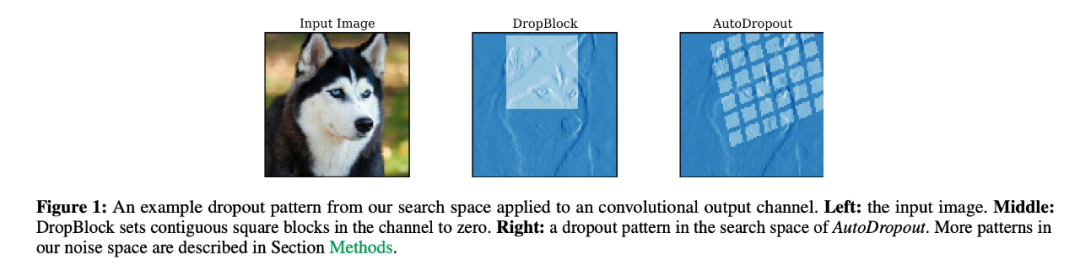

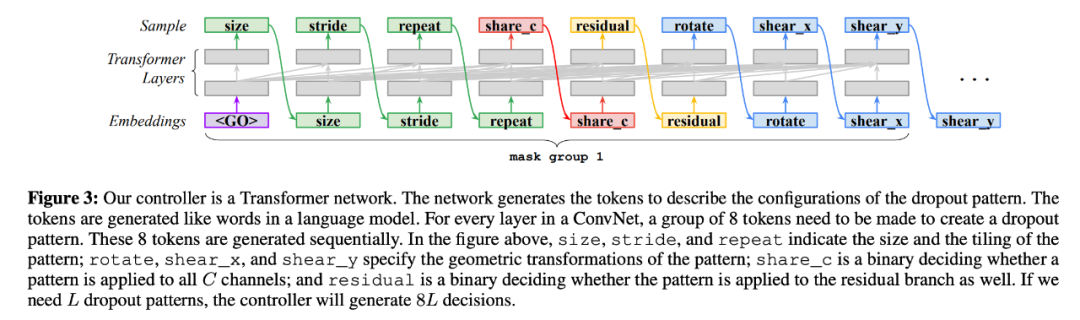

论文 6:AutoDropout: Learning Dropout Patterns to Regularize Deep Networks

摘要:

最近,来自谷歌大脑的两位研究者通过研究以往工作中的 dropout 模式,发现这些模式不仅难以设计,而且还需要针对每个模型架构、任务和域进行专门调整。

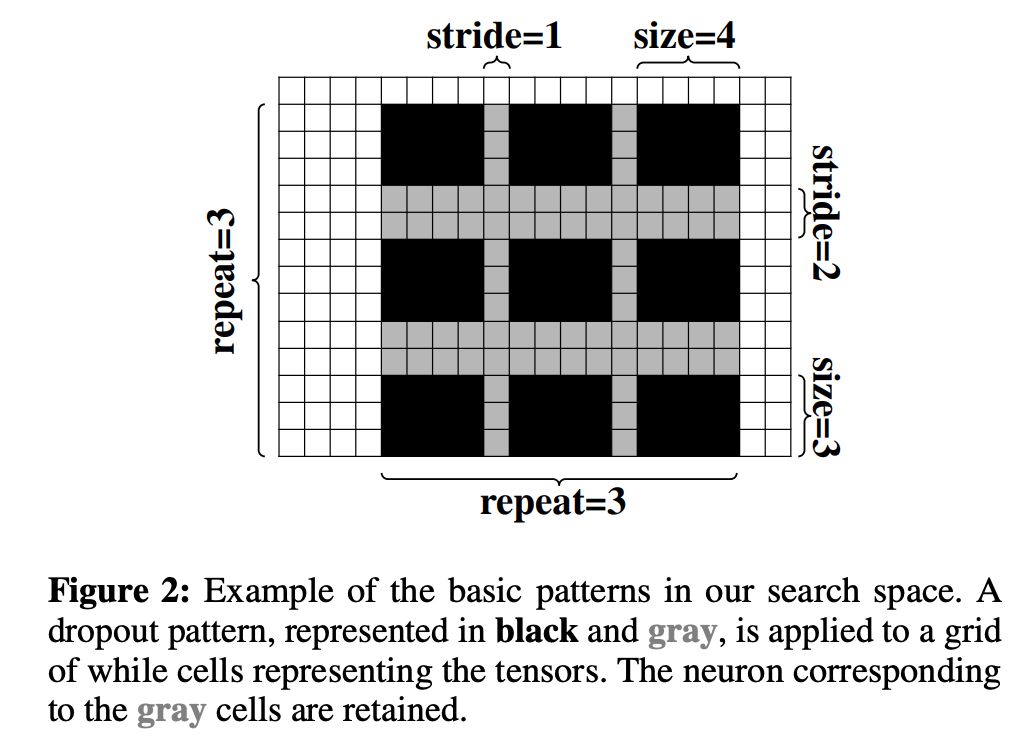

为了解决这些难题,

研究者提出了 AutoDropout,它可以实现专用 dropout 模式设计过程的自动化。AutoDropout 的主要贡献是一个新颖的结构化 dropout 模式搜索空间

。在这个搜索空间中,人们可以为每个模型架构和任务找到适合的 dropout 模式。此外,该搜索空间还泛化了很多现有的 dropout 模式。

实验结果表明,AutoDropout 找到的 dropout 模式能够显著提升常见 ConvNet 和 Transformer 架构的性能。在 ImageNet 数据集上,AutoDropout 将 ResNet-50 的 top-1 准确率从 76.5% 提升至 78.7%,EfficientNet-B7 的性能则从 84.1% 提升至 84.7%。在 CIFAR-10-4000 的半监督设置下,AutoDropout 也将 Wide-ResNet-28-2 的准确率从 94.9% 提升至 95.8%。对于语言建模任务而言,AutoDropout 将 Transformer-XL 在 Penn Treebank 数据集上的困惑度从 56.0 降至 54.9。

![]()

AutoDropout 搜索空间中的一种 dropout 模式。

![]()

![]()

研究者使用 Transformer 网络对控制器进行参数化。

推荐:

Dropout 也能自动化了,谷歌 Quoc Le 等人利用强化学习自动找寻模型专用 Dropout。

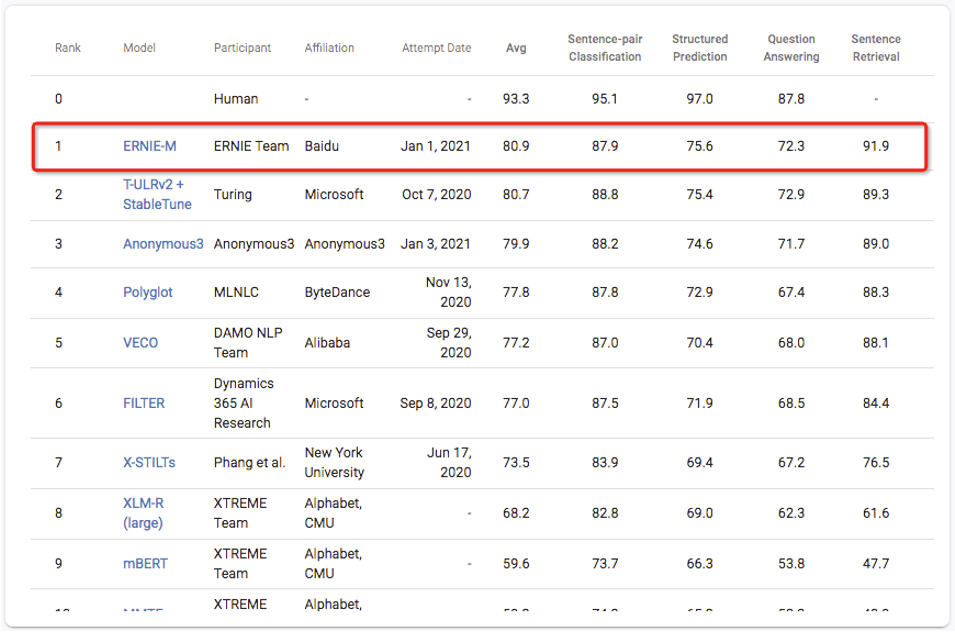

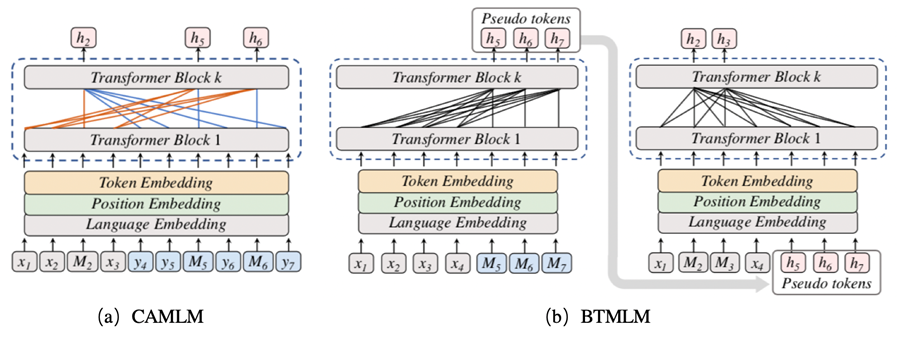

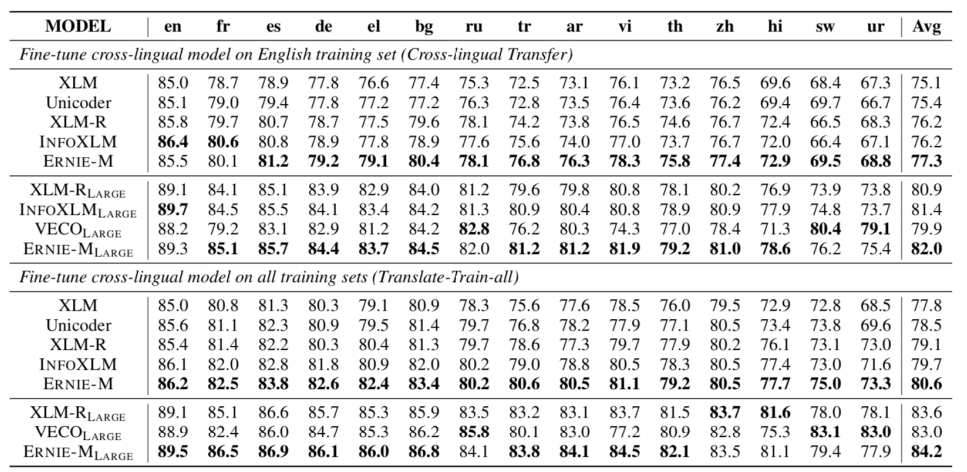

论文 7:ERNIE-M: Enhanced Multilingual Representation by Aligning Cross-lingual Semantics with Monolingual Corpora

摘要:

2021 年伊始,百度在自然语言处理领域取得最新突破,发布多语言预训练模型 ERNIE-M。ERNIE-M 通过对 96 门语言的学习,使得一个模型能同时理解 96 种语言,该项技术在 5 类典型跨语言理解任务上刷新世界最好效果。在权威跨语言理解榜单 XTREME 上,

ERNIE-M 也登顶榜首,超越微软、谷歌、Facebook 等机构提出的模型

。据了解,基于飞桨实现的 ERNIE-M 模型也会于近期开源。

![]()

![]()

![]()

ERNIE-M 在 Cross-lingual Transfer 和 Multi-language Fine-tuning 两种模式下验证了效果,研究者用英语对 ERNIE-M 进行微调训练,在汉语、德语、乌尔都语等语言上测试,能达到平均准确率 82.0% 的效果。

推荐:

同时掌握 96 门语言,取得多项世界突破,百度发布预训练模型 ERNIE-M。

ArXiv Weekly Radiostation

机器之心联合由楚航、罗若天发起的ArXiv Weekly Radiostation,在 7 Papers 的基础上,精选本周更多重要论文,包括NLP、CV、ML领域各10篇精选,并提供音频形式的论文摘要简介,详情如下:

1. Can RNNs learn Recursive Nested Subject-Verb Agreements?. (from Stanislas Dehaene)

2. Dynamic Hybrid Relation Network for Cross-Domain Context-Dependent Semantic Parsing. (from Jian Sun)

3. Personalized Food Recommendation as Constrained Question Answering over a Large-scale Food Knowledge Graph. (from Mohammed J. Zaki)

4. Did Aristotle Use a Laptop? A Question Answering Benchmark with Implicit Reasoning Strategies. (from Dan Roth)

5. I-BERT: Integer-only BERT Quantization. (from Michael W. Mahoney, Kurt Keutzer)

6. Reinforcement Learning based Collective Entity Alignment with Adaptive Features. (from Xuemin Lin)

7. Multitask Learning for Emotion and Personality Detection. (from Erik Cambria)

8. Curriculum-Meta Learning for Order-Robust Continual Relation Extraction. (from Guilin Qi)

9. Taxonomy Completion via Triplet Matching Network. (from Lei Li)

1. LAEO-Net++: revisiting people Looking At Each Other in videos. (from Andrew Zisserman)

2. Learning Temporal Dynamics from Cycles in Narrated Video. (from Cordelia Schmid)

3. Where2Act: From Pixels to Actions for Articulated 3D Objects. (from Leonidas Guibas, Abhinav Gupta)

4. GAN-Control: Explicitly Controllable GANs. (from Gerard Medioni)

5. Safety-Oriented Pedestrian Motion and Scene Occupancy Forecasting. (from Raquel Urtasun)

6. Efficient 3D Point Cloud Feature Learning for Large-Scale Place Recognition. (from Jian Yang)

7. Partial Domain Adaptation Using Selective Representation Learning For Class-Weight Computation. (from Baoxin Li)

8. MSED: a multi-modal sleep event detection model for clinical sleep analysis. (from Poul Jennum)

9. Progressive Self-Guided Loss for Salient Object Detection. (from Weisi Lin)

10. PVA: Pixel-aligned Volumetric Avatars. (from James Hays)

1. Distribution-Free, Risk-Controlling Prediction Sets. (from Jitendra Malik, Michael I. Jordan)

2. AutoDropout: Learning Dropout Patterns to Regularize Deep Networks. (from Quoc V. Le)

3. GraphHop: An Enhanced Label Propagation Method for Node Classification. (from C.-C. Jay Kuo)

4. Reinforcement Learning with Latent Flow. (from Yang Gao, Pieter Abbeel)

5. Cauchy-Schwarz Regularized Autoencoder. (from Maja Pantic)

6. GeCo: Quality Counterfactual Explanations in Real Time. (from Dan Suciu)

7. Few-Shot Learning with Class Imbalance. (from Amos Storkey)

8. Robust Text CAPTCHAs Using Adversarial Examples. (from Cho-Jui Hsieh)

9. Geometric Entropic Exploration. (from Rémi Munos)

10. Do We Really Need Deep Learning Models for Time Series Forecasting?. (from Lars Schmidt-Thieme)

![]()