课程简记:深度学习与人类语言处理 ——李宏毅,2020 (P1)

原创 · 作者 | 阿芒Aris

学校 | 北京理工大学

研究方向 | 自然语言处理

人类语言处理任务总结与研究方向

1

2

3

4

5

在本课程中,文字和语音的内容各占一半,主要关注近3年的相关技术,重点讲述BERT及之后的预处理模型。

**

课程任务总结:

**

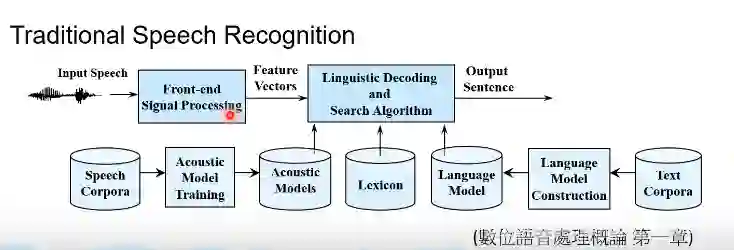

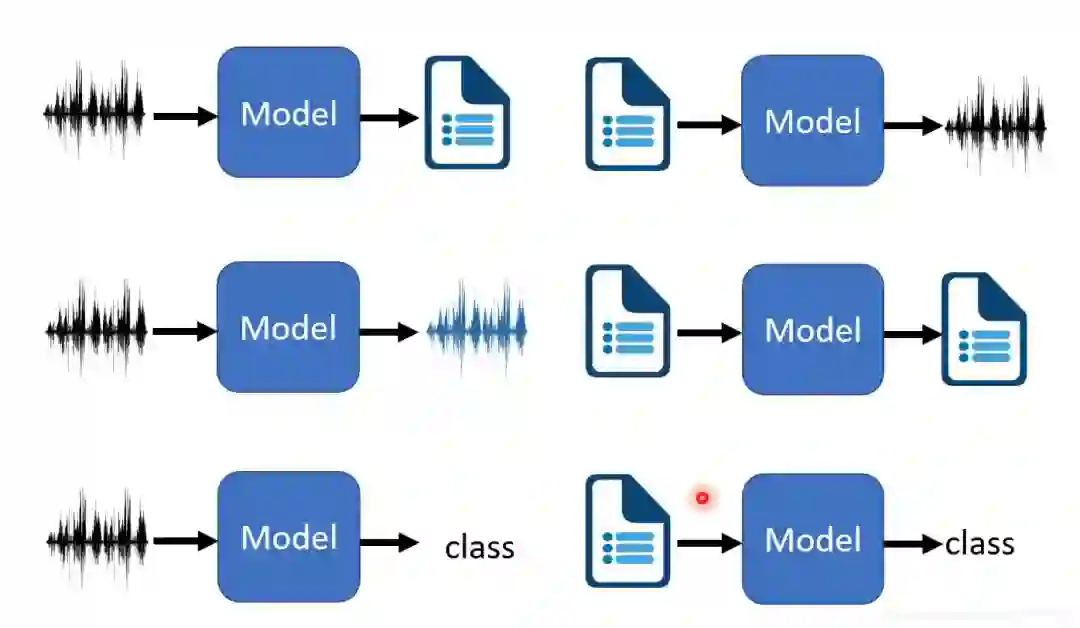

I 语音——文字(语音辨识) Speech Recognition

传统: 多模组

现今: ASR(Automatic Speech Recognition)

端到端神经网络系统(但不是传统的seq2seq模型),后续会讲

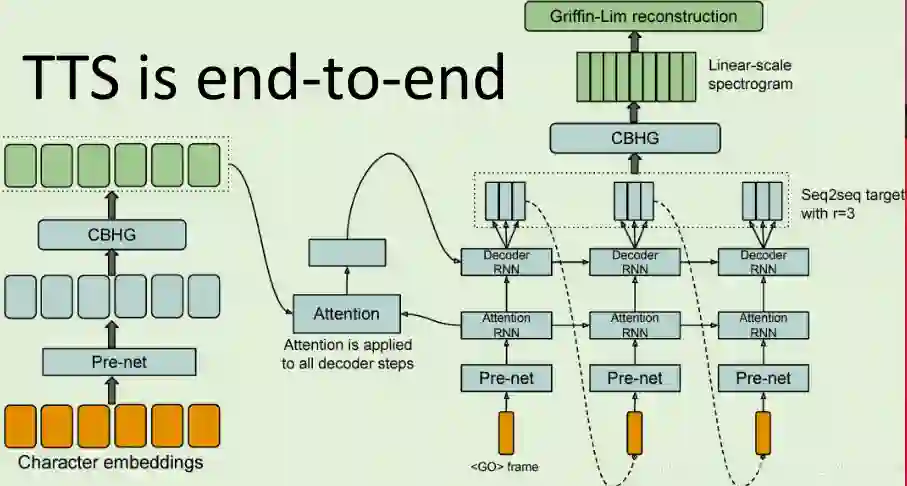

II 文字——语音(语音合成) Text-to-Speech Synthesis

现今: 端到端的系统TTS

III 语音——语音

应用: 语音分离 Speech Separation (例如将两个人同时说的话分离为各自所说的)

语音转换 Voice Conversion (例如柯南中的变音器)

无监督语音转换 Only one utterance from each speaker(one-shot learning) (一次学习,例如,使系统各听A、B两人说的一句话,将A所说的话用B的语气、语调讲出,反之也可),技术后续会讲

One-shot learning扩展:《deep learning》一书 480页 迁移学习的两种极端形式是一次学习(one-shot learning) 和 零次学习 (zero-shot learning) ,有时也被称为 零数据学习 (zero-data learning)。只有一个标注样本的迁移任务被称为一次学习;没有标注样本的迁移任务被称为零次学习。

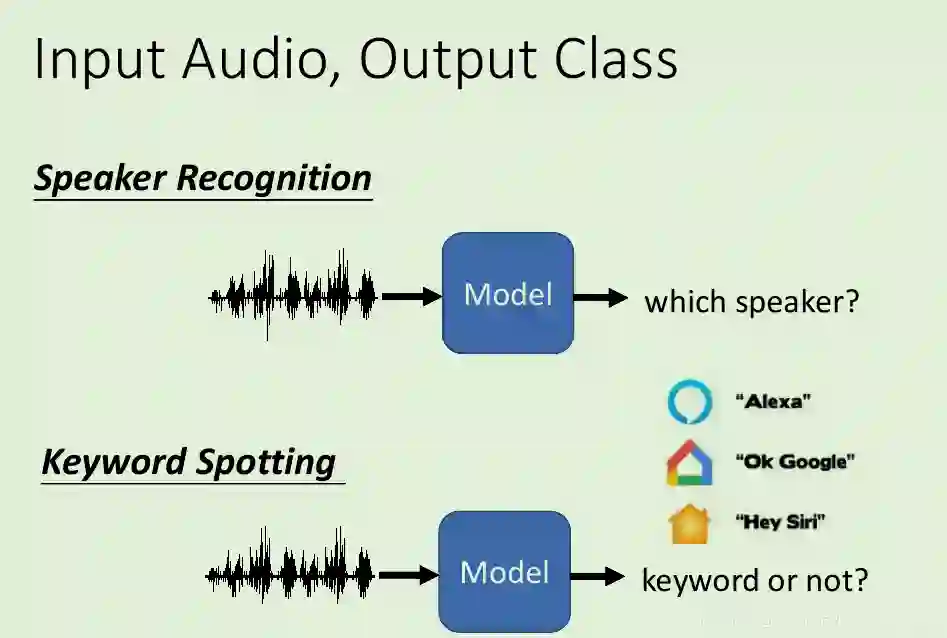

IV 语音——类别

应用:

1 Speaker Recognition 讲述人辨识,判别一段语音是属于谁

2 Keyword Spotting 关键词判断,判别一段语音是否是一种关键词(可用于聊天系统 如 判别启动语,在Siri中当语音中包含"Hey Siri"时 Siri便会启动)

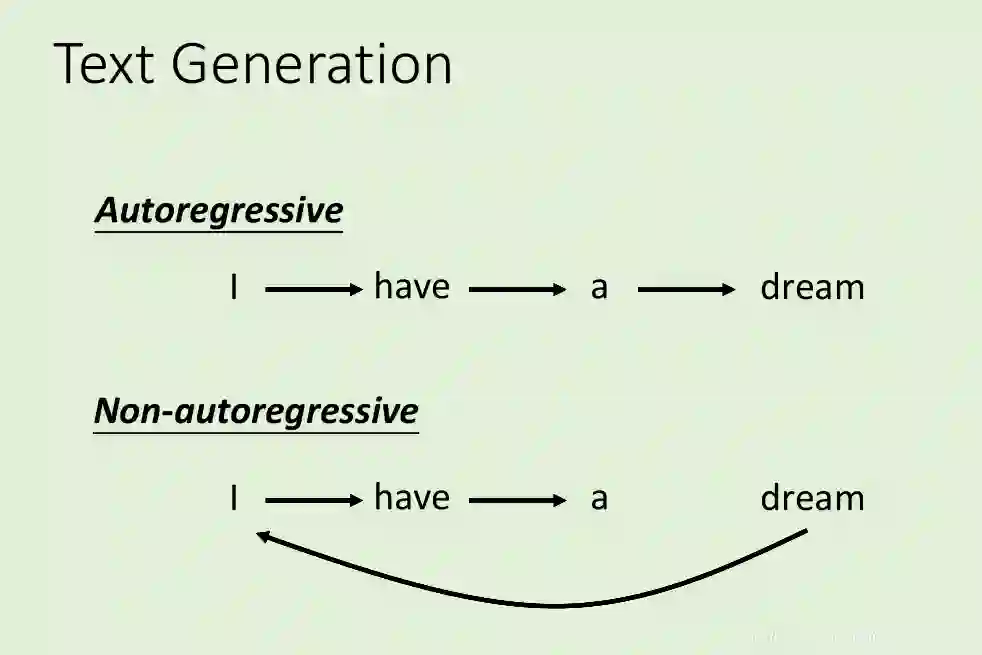

V 文字——文字 (文字生成) Text Generation

Autoregressive: 自回归,逐字预测输出

Non-Autoregressive:非自回归,乱序预测输出

应用:翻译、摘要、聊天机器人、问答系统

VI 文字——类别 ,文本分类

扩展:(后续会有详细讲解)

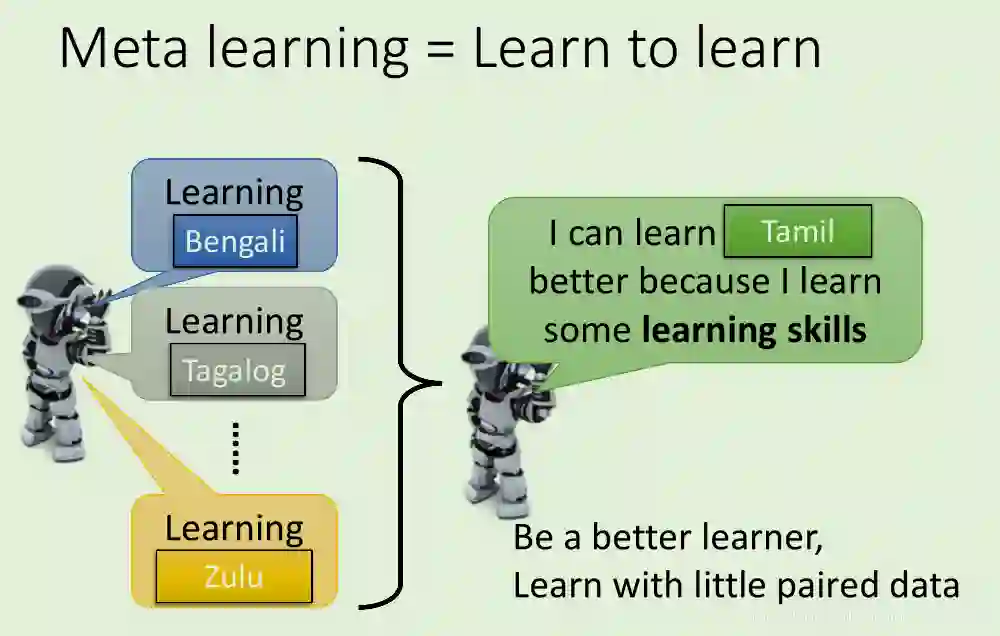

Meta Learning 元学习,学习如何去学习

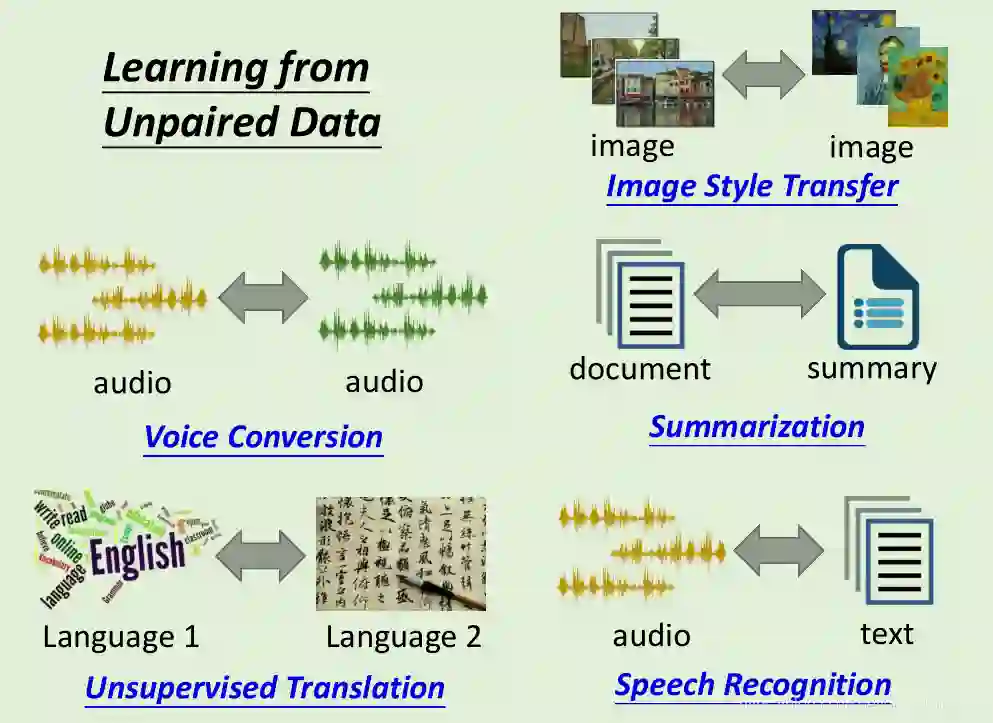

Leaning from Unpaired Data 从输入输出模式不同的数据学习

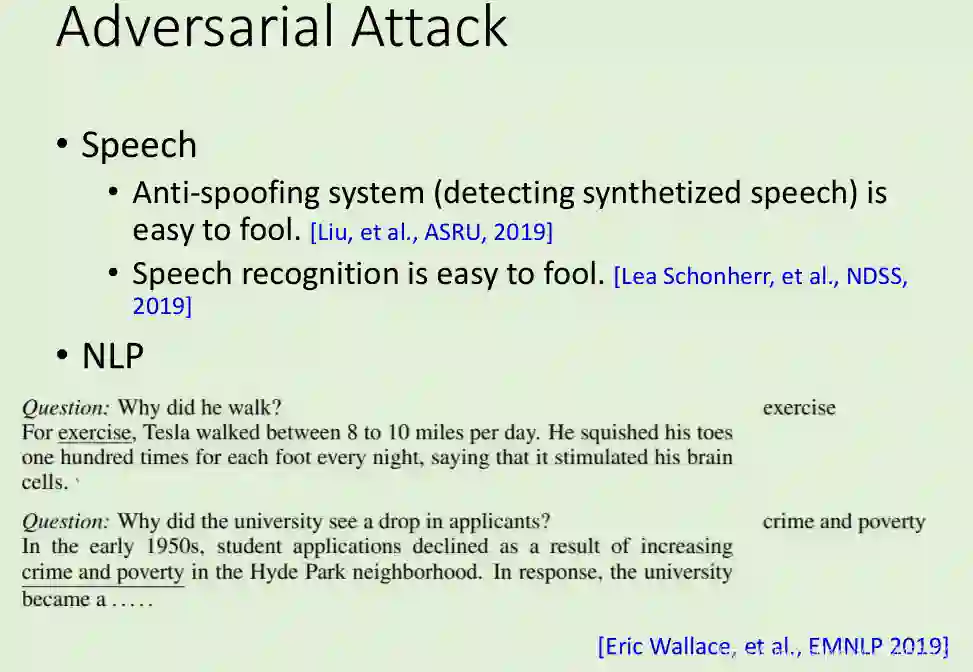

Adversarial Attack 对抗攻击

Explainable AI ,AI模型的可解释性

本文由作者授权AINLP原创发布于公众号平台,欢迎投稿,AI、NLP均可。原文链接,点击"阅读原文"直达:

https://blog.csdn.net/qq_44574333/article/details/108041754

推荐阅读

征稿启示| 200元稿费+5000DBC(价值20个小时GPU算力)

完结撒花!李宏毅老师深度学习与人类语言处理课程视频及课件(附下载)

模型压缩实践系列之——bert-of-theseus,一个非常亲民的bert压缩方法

文本自动摘要任务的“不完全”心得总结番外篇——submodular函数优化

斯坦福大学NLP组Python深度学习自然语言处理工具Stanza试用

关于AINLP

AINLP 是一个有趣有AI的自然语言处理社区,专注于 AI、NLP、机器学习、深度学习、推荐算法等相关技术的分享,主题包括文本摘要、智能问答、聊天机器人、机器翻译、自动生成、知识图谱、预训练模型、推荐系统、计算广告、招聘信息、求职经验分享等,欢迎关注!加技术交流群请添加AINLPer(id:ainlper),备注工作/研究方向+加群目的。

阅读至此了,分享、点赞、在看三选一吧🙏