2020年至今,深度学习模型少有突破性进展,尽管学术界一直在炒大规模预训练模型,但是能玩得起的机构少之又少,更别提具体应用落地了。

但是,深度学习终究还是要服务于企业,只有能为企业带来实在的收益(靠着玩概念,忽悠来的投资,不算做收益),深度学习才能长青。

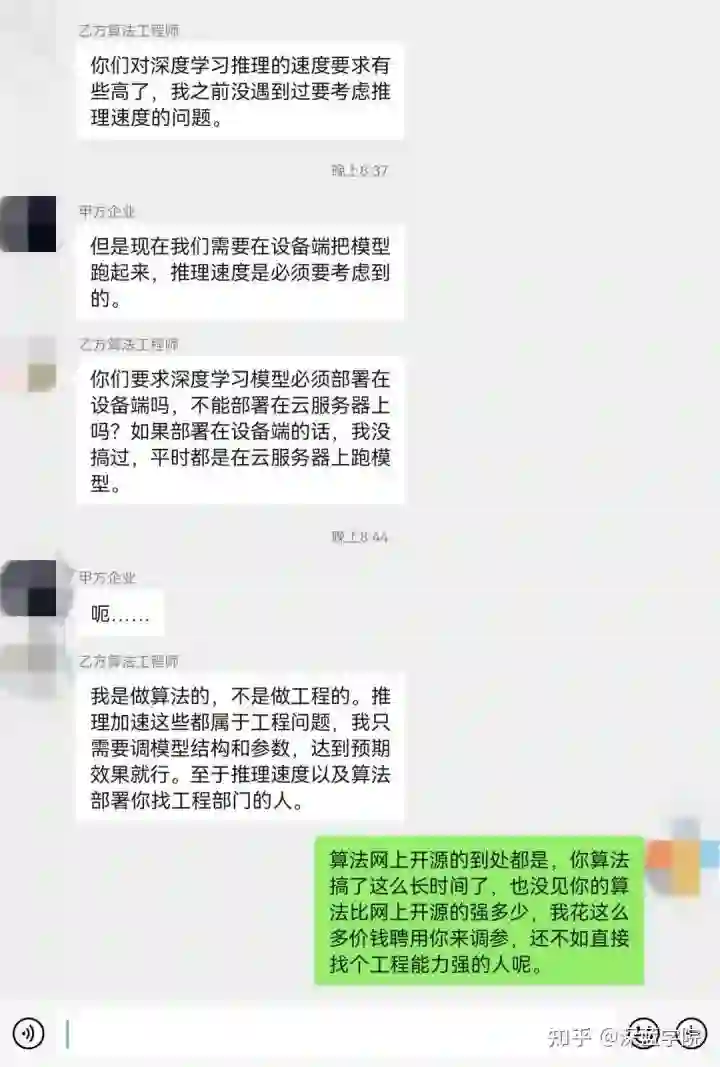

各大企业都在努力验证深度学习的商业落地场景,而高学历的算法工程师在驻场解决甲方企业的实际问题时,却出现以下这种搞笑局面:

![]()

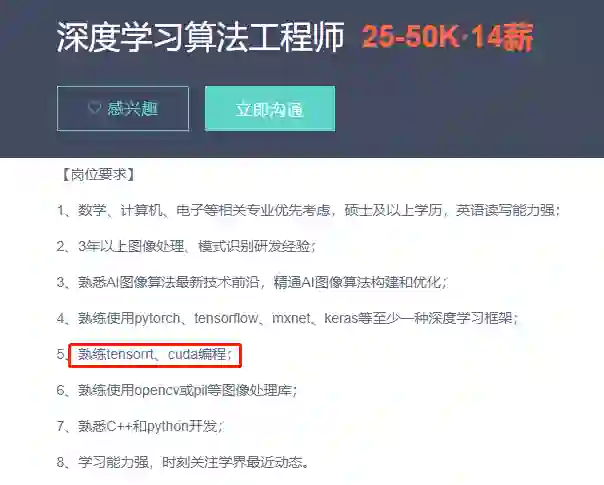

为了避免以上这种情况重复发生,现在的企业在招聘AI算法工程师时,开始要求应聘者需要掌握当下深度学习加速必备的CUDA编程,并且需要熟练掌握当下主流的加速工具TensorRT模型的使用技巧。

一、CUDA是什么?它在深度学习加速中扮演着什么样的角色呢?

CUDA是NVIDIA在2006年推出的运算平台。

CUDA作为一个完整的GPU解决方案,提供了硬件的直接访问接口,并且采用C语言作为编程语言,具备提供大量高性能计算指令开发能力,使开发者能够建立起一种效率更高的密集数据计算解决方案。

主流的深度学习框架也都是基于CUDA进行GPU并行加速的,几乎无一例外。

二、TensorRT又是什么?

NVDIA本着让大家能更好地利用GPU,使其在做深度学习推理的时候达到更好的效果的目标,推出了高性能深度学习支持引擎——TensorRT。TensorRT是目前深度学习工业化领域主流的加速模型。

另外,TensorRT可以作为用户应用程序中的库,它包括用于从Caffe,ONNX或TensorFlow导入现有模型的解析器,以及用于以编程方式(C++或Python API)构建模型。

就目前的形势来看,熟悉CUDA及TensorRT的AI算法工程师太抢手了,可以迅速建立与普通AI算法工程师的差异化竞争壁垒。

目前熟悉CUDA编程的算法工程师薪资也十分可观,基本来说掌握了CUDA就可以告别裁员潮。

![]()

然而学习CUDA编程并不容易,尽管NVIDIA推出了CUDA相关文档,但是这些文档对新入门的小伙伴并不友好,很多人反映自己想学习CUDA,但是苦于学习起来效率太低,只好遗憾放弃。

基于此,深蓝学院潜心制作了

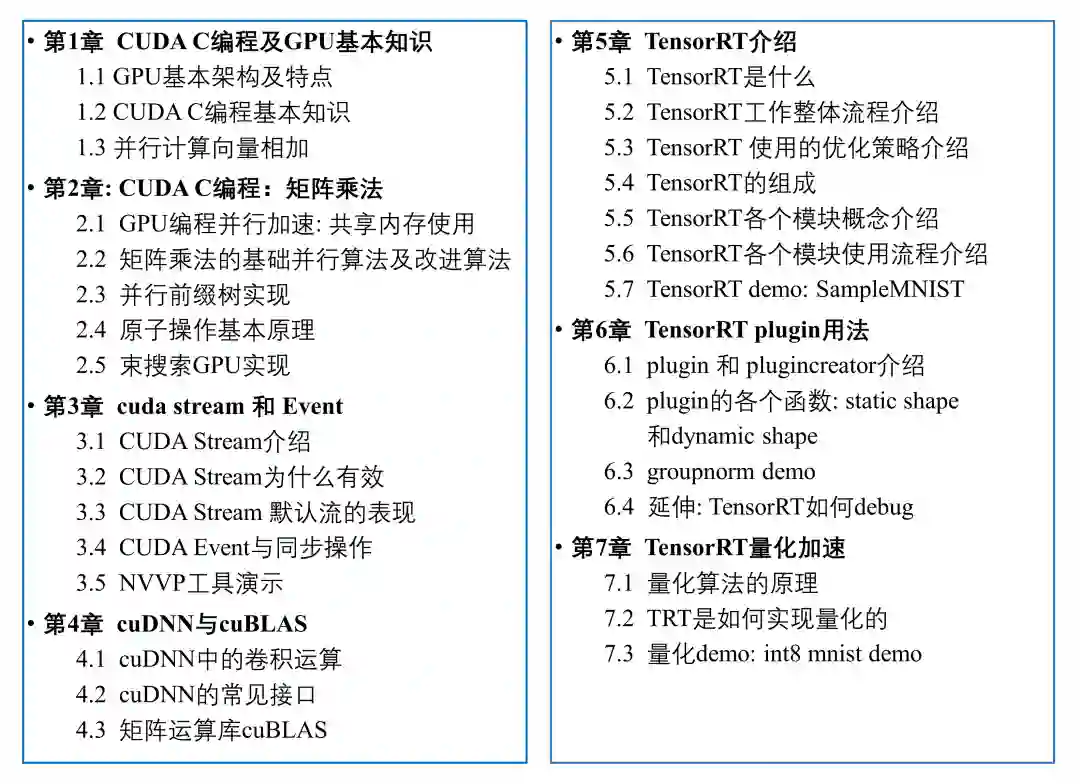

《CUDA入门与深度神经网络加速》

课程。希望大家通过对这门课程的学习,具备CUDA编程操作的能力,并且能够使用cuDNN、TensorRT这两个当下热门的深度神经网络加速工具。

在本期课程的主讲老师是具备

近10年CUDA开发经验

的资深算法工程师,老师会带领大家逐步掌握可应用于工程项目的CUDA编程技术,以及深度神经网络加速的技术!

不止步于口述讲解,本课程基本所有讲解都涵盖详细的代码实现,老师手把手教你程序实现!

杨伟光,腾讯高级研究员,大连理工大学硕士

毕业后一直在腾讯从事语音领域深度学习加速上线工作。近10年CUDA开发经验,近5年 TensorRT 开发经验,Github TensorRT_Tutorial作者。

主要方向为自然语言处理、智能语音及其在端侧的部署。博士毕业于清华大学,在各类国际AI会议和刊物中发表论文10篇以上,多次获得NIST主办的国际比赛top 2成绩。近年来主要研究方向为AI在场景中的落地应用。

![]()

![]()

2.

知识前沿:本期课程涵盖当下主流的深度学习模型加速工具

3. 氛围活跃:与数百位同学共同交流学习

1.

人工智能领域的算法或者开发工程师,尤其是工作涉及深度学习的模型。

2. 希望学习并行计算系统的科研工作者以及工程师。

1. 掌握CUDA并行系统的分析、开发、调试与优化方法。

3. 了解cuDNN与TensorRT两个深度学习模型的加速工具

你的同学大多是来自985、211及海外院校硕博,在这里大家一起学习、进行讨论与研究。独一无二的优质圈子将是你未来学习与就业的宝贵资源

。

讲师&助教及时答疑解惑,班主任全程带班督学,帮你克服拖延,不断进步。

助教1V1批改作业,并在班会中进行讲评和指导;在班会中,学习更多技巧;在交流中收获更多思路。

![]()