干货教程!百度AutoDL「自动深度学习: 理论、算法、平台和应用」132PPT

【导读】百度研究院大数据实验室窦德景博士等人给了关于自动深度学习的教程包括AutoDL的理论、算法、平台和应用,共132PPT,涵盖神经架构搜索、迁移学习和元学习,以及深度学习模型压缩。该教程将包括对最先进的算法和系统的全面调研。是了解工业界学术界的最好自动深度资料。

地址:

http://baiduautodl.com/

概览

机器学习、数据挖掘和数据分析技术在众多领域的广泛使用为自动构建模型、共享和重用模型、算法和代码提供了机会,以帮助提高解决方案的速度和减少工作的重复。尽管这适用于广泛的机器学习任务,但由于许多原因,自动化模型构建对深度学习特别重要。这样的例子包括

深度学习模型有很多超参数需要调整,

深度学习模型需要很长时间的训练

目前广泛使用的深度学习架构屈指可数。

在本教程中,我们关注最新的主题,如神经架构搜索、迁移学习和元学习,以及深度学习模型压缩。该教程将包括对最先进的算法和系统的全面调研,对报告者的研究经验的详细描述,以及由百度AutoDL团队构建的平台的现场演示。

本教程不需要任何先决条件。假设有监督学习和深度学习的一般知识就行。

目录

我们计划涵盖自动深度学习模型构建、迁移和压缩相关的广泛主题。具体的教程大纲是:

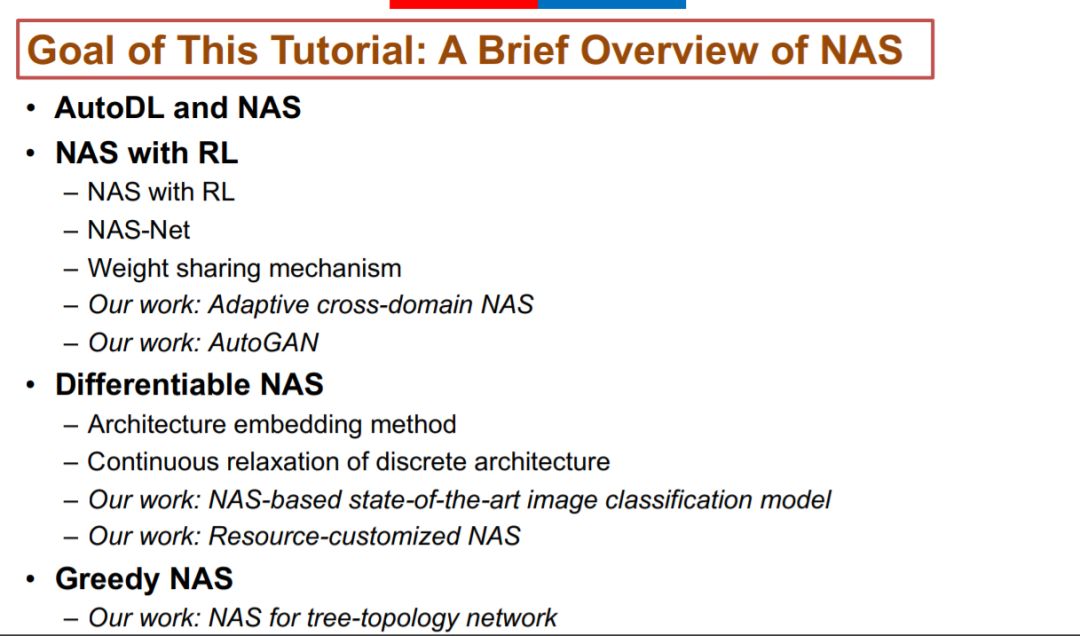

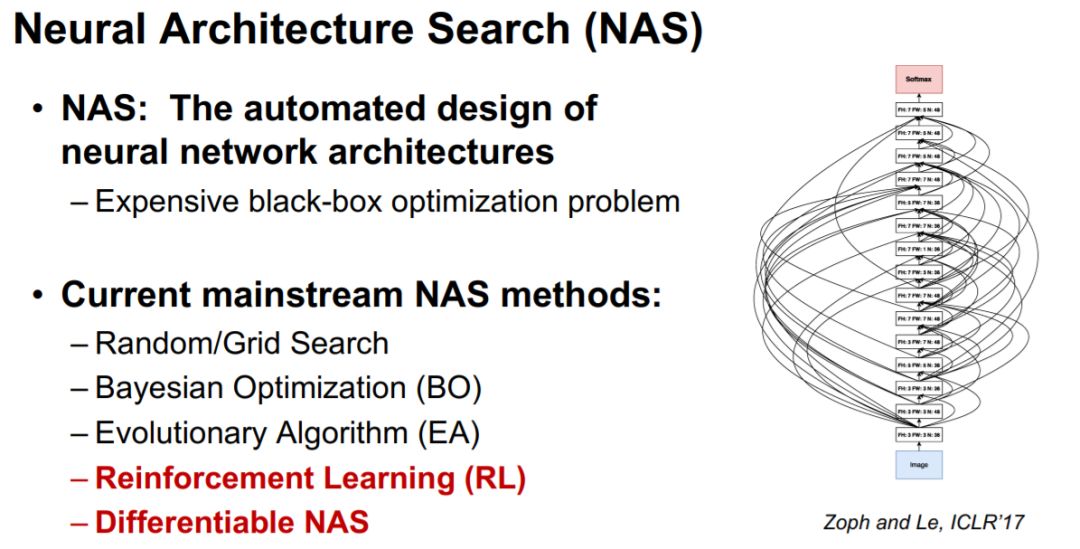

(1) 神经结构搜索

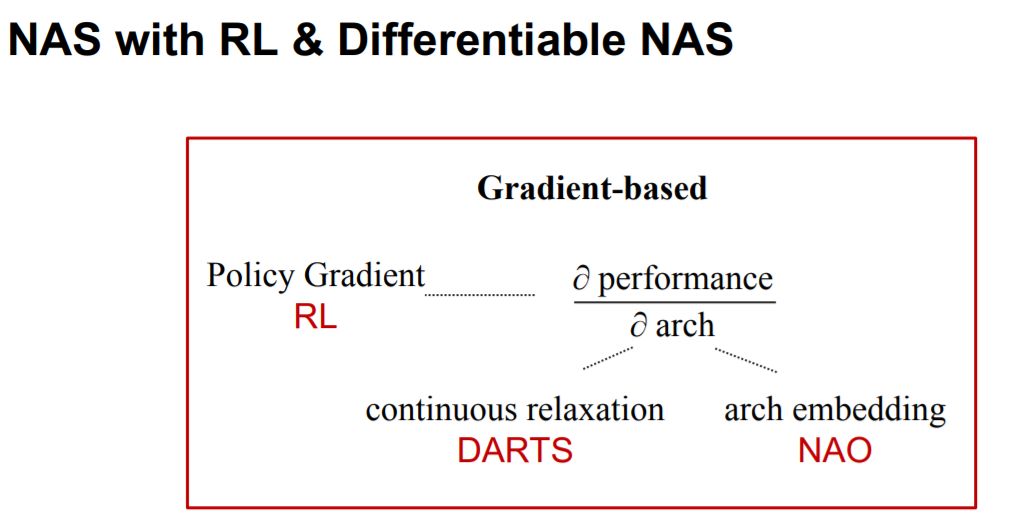

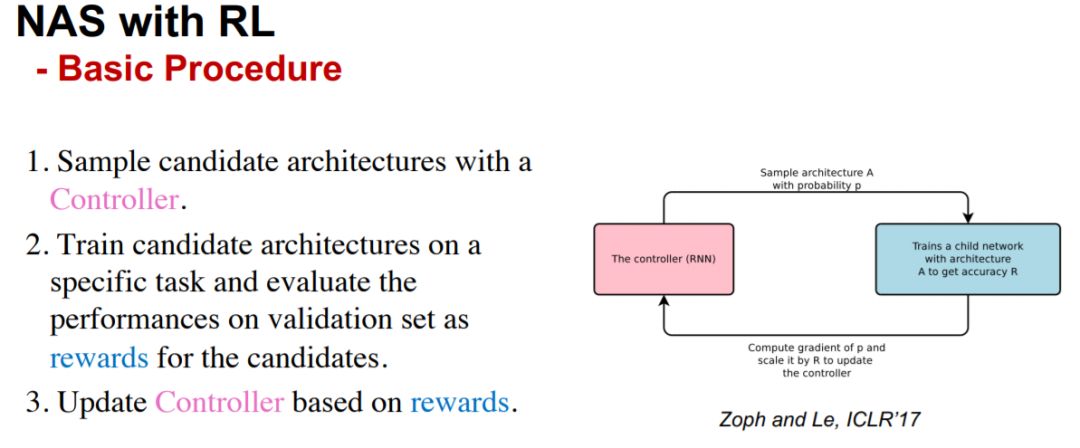

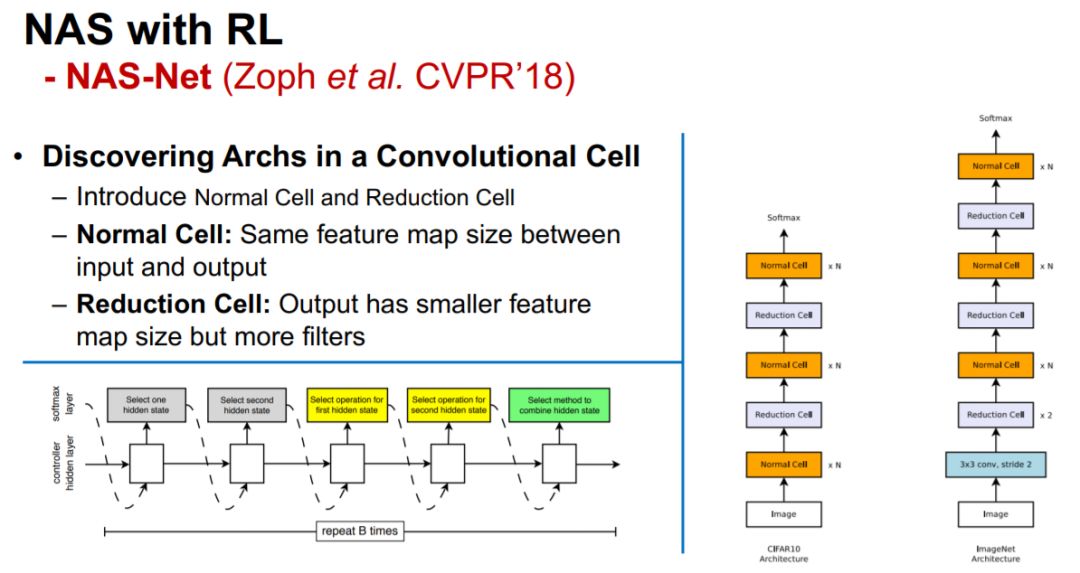

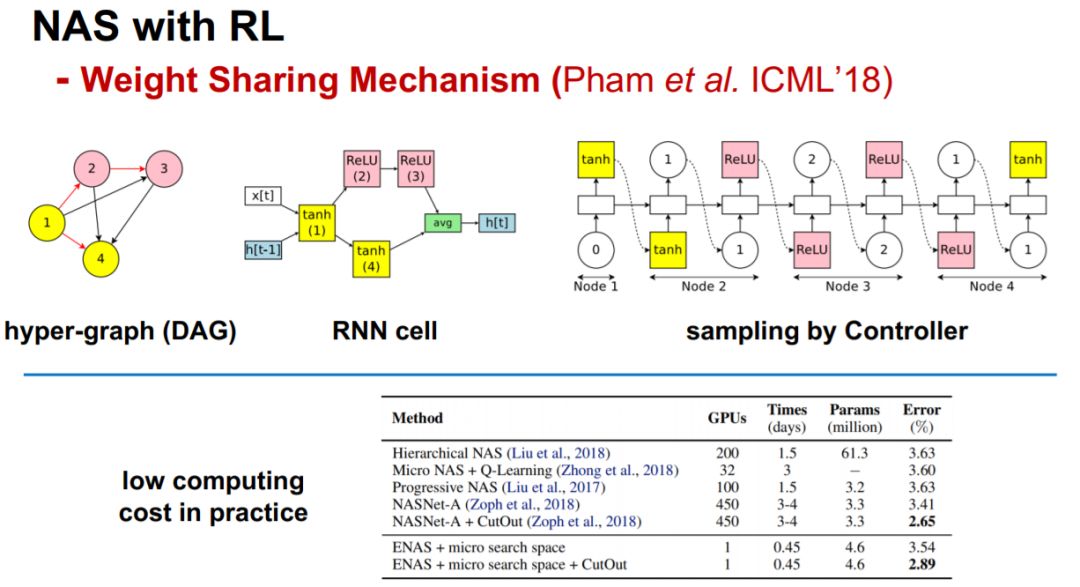

基于深度强化学习的NAS

可微分架构搜索

随机搜索和进化搜索

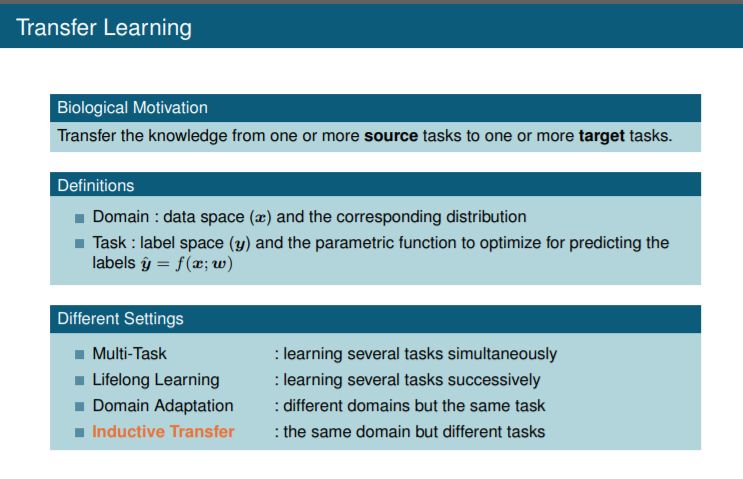

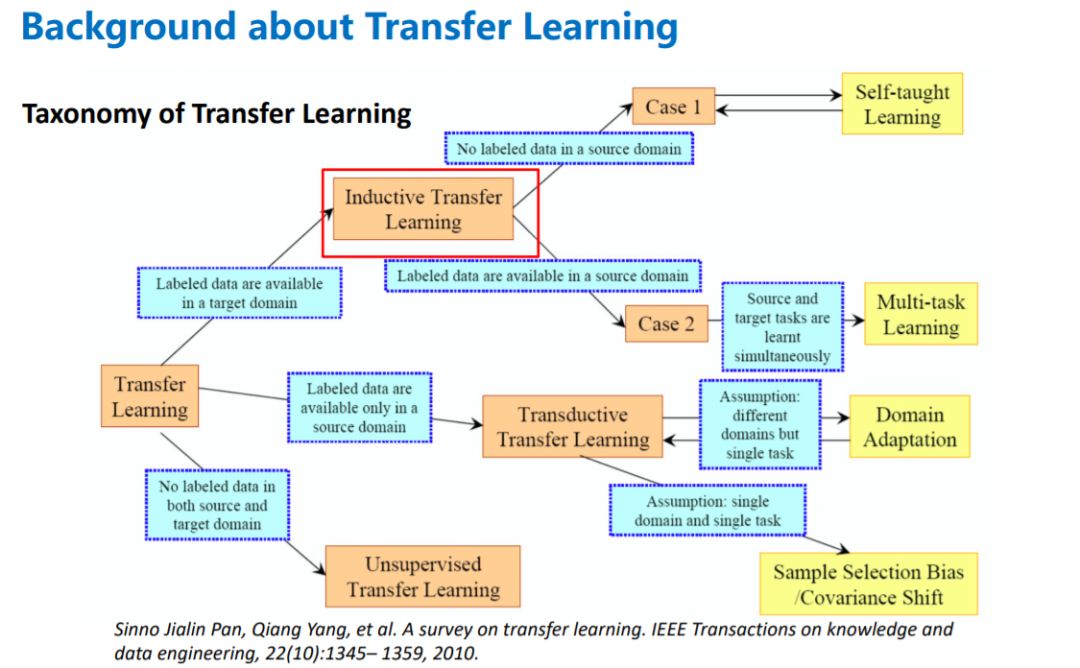

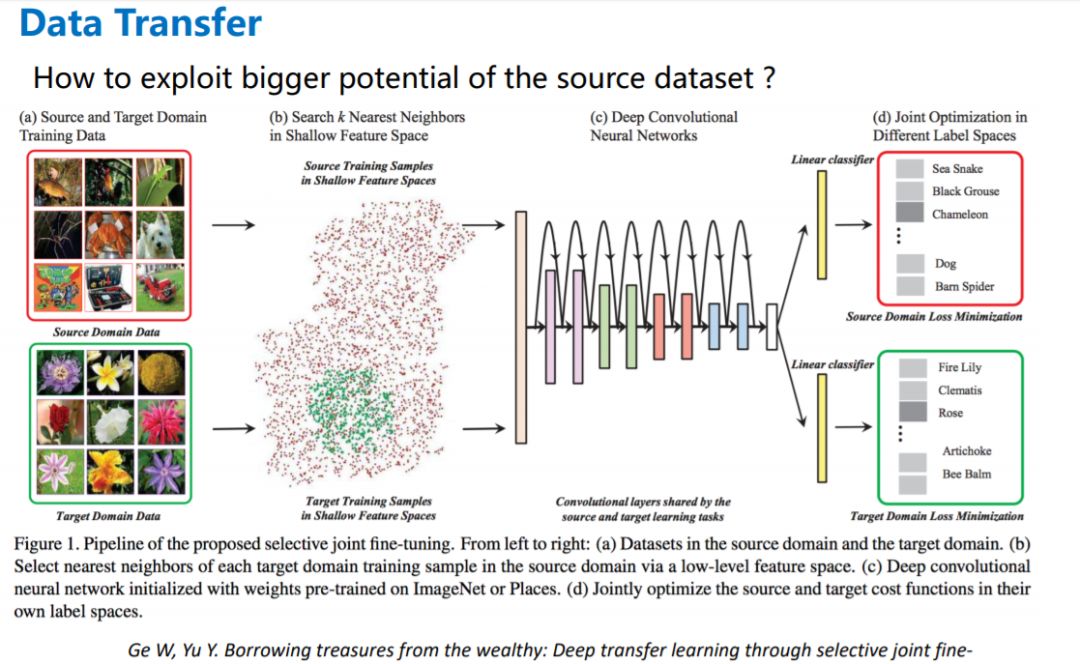

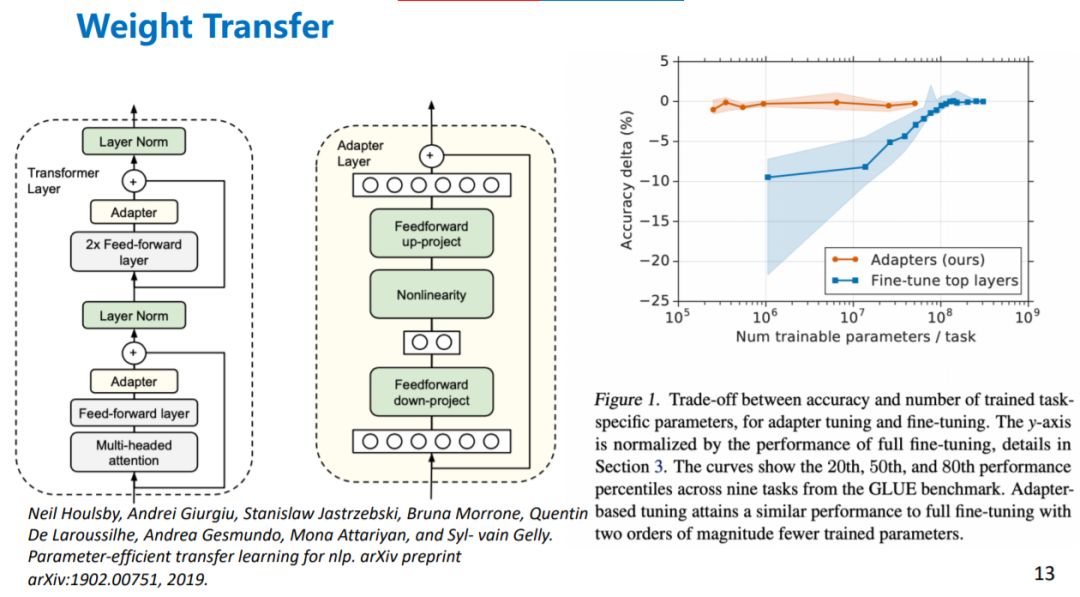

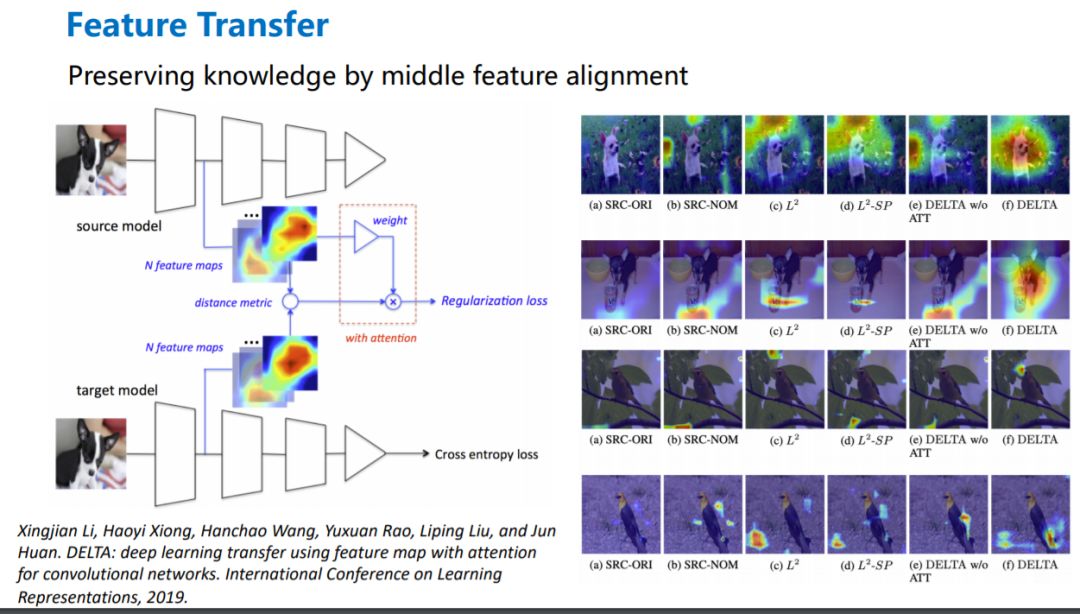

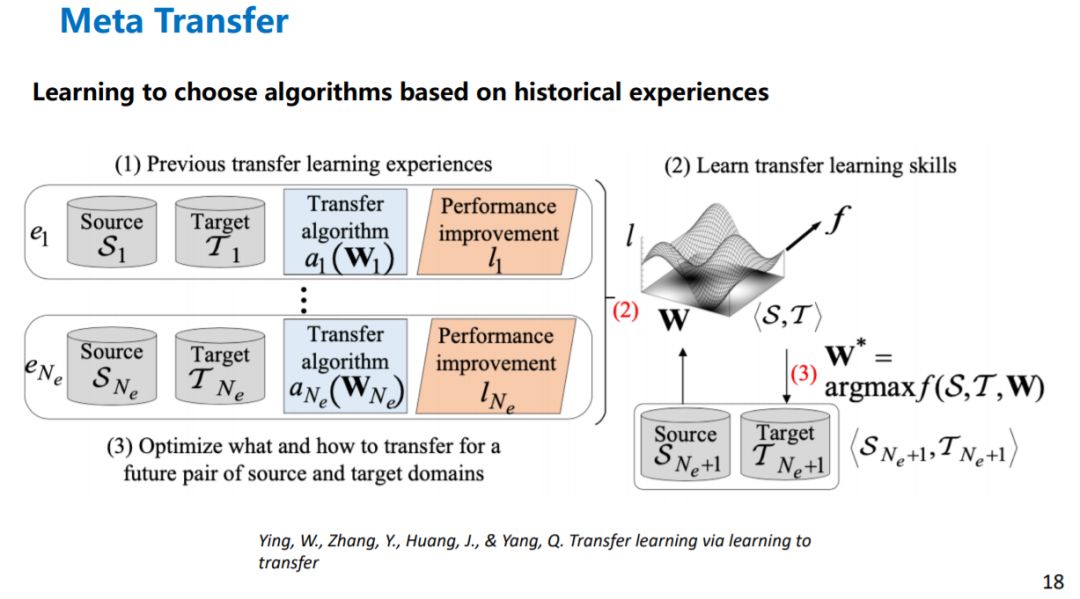

(2) 深度学习模型迁移和元学习

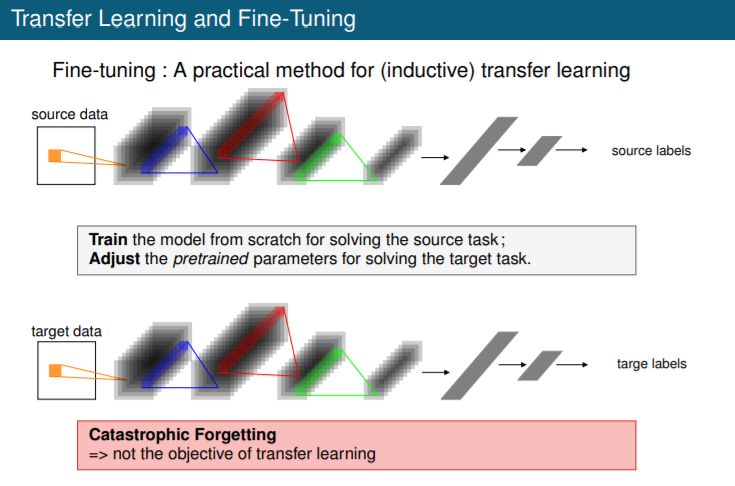

微调

基于正则化的迁移学习

知识蒸馏

(3) 深度学习模型压缩

修剪,半精度,低秩分解

参数共享

知识蒸馏

d. 基于nas的模型压缩

(4) AutoML平台

谷歌云自动机器学习

微软Azure ML

Amarzon SageMaker

(5) 百度EasyDL和Jarvis的现场演示(支持百度AutoDL)

讲者介绍

Dejing Dou博士是俄勒冈大学计算机和信息科学系的教授,领导着高级集成与挖掘(AIM)实验室。他也是美国国家科学基金会IUCRC大学习中心(CBL)的主任。1996年获清华大学学士学位,2004年获耶鲁大学博士学位。

研究领域包括人工智能、数据挖掘、数据集成、信息提取和健康信息学。Dr. Dejing Dou发表研究论文100余篇,其中部分论文发表在AAAI、IJCAI、KDD、ICDM、ACL、EMNLP、CIKM、ISWC、JIIS、JoDS等知名会议和期刊上。他的DEXA'15论文获得了最佳论文奖。他的KDD'07论文被提名为最佳研究论文奖。他是《数据语义期刊》、《智能信息系统期刊》和PLOS ONE的编委会成员。他曾担任各种国际会议的项目委员会成员,并担任其中四次会议的项目联合主席。窦博士已经从国家科学基金会和国家卫生研究院获得了超过500万美元的PI研究资助。

其他讲者包括:Dr. Jun Huan,Dr. Siyu Huang,Dr. Di Hu,Mr. Xingjian Li,Dr. Haoyi Xiong,Dr. Boyang Li

内容导读:

第一部分:自动深度学习与应用

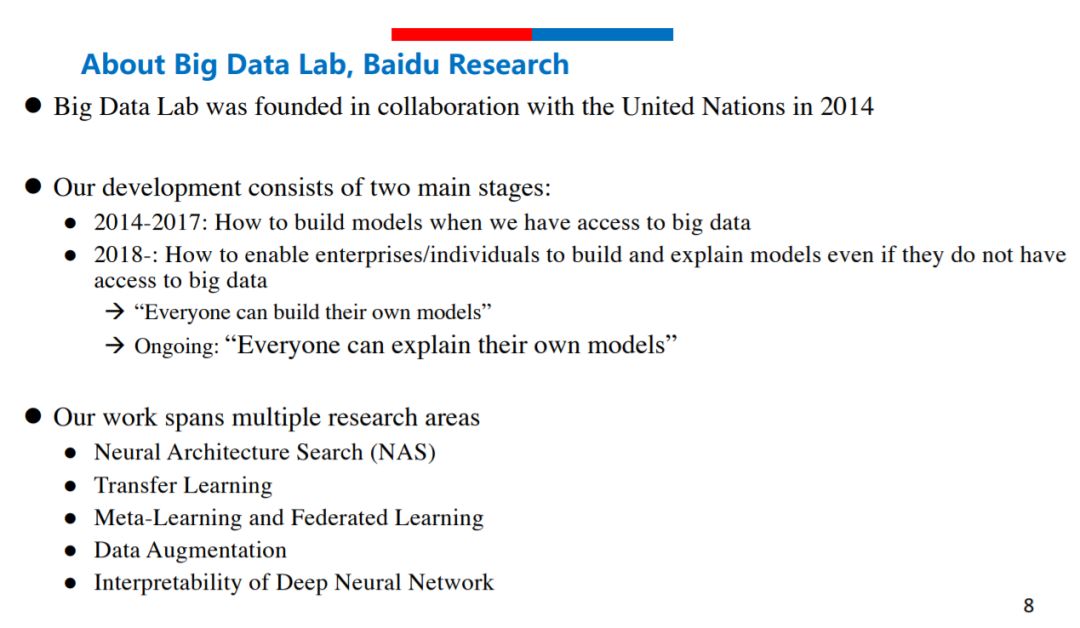

百度研究大数据实验室

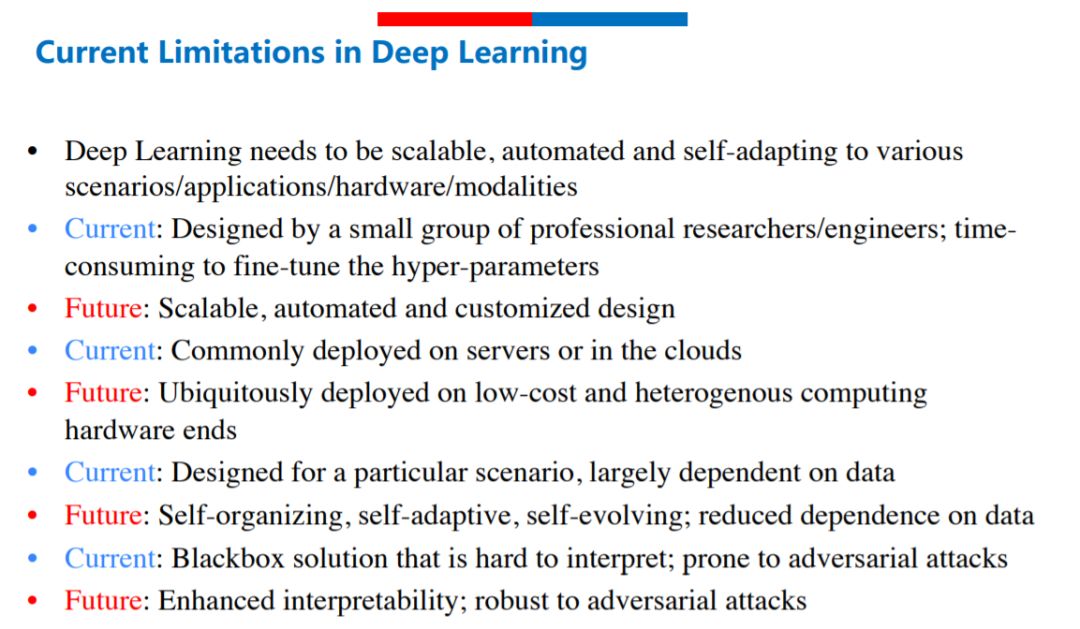

深度学习当前局限

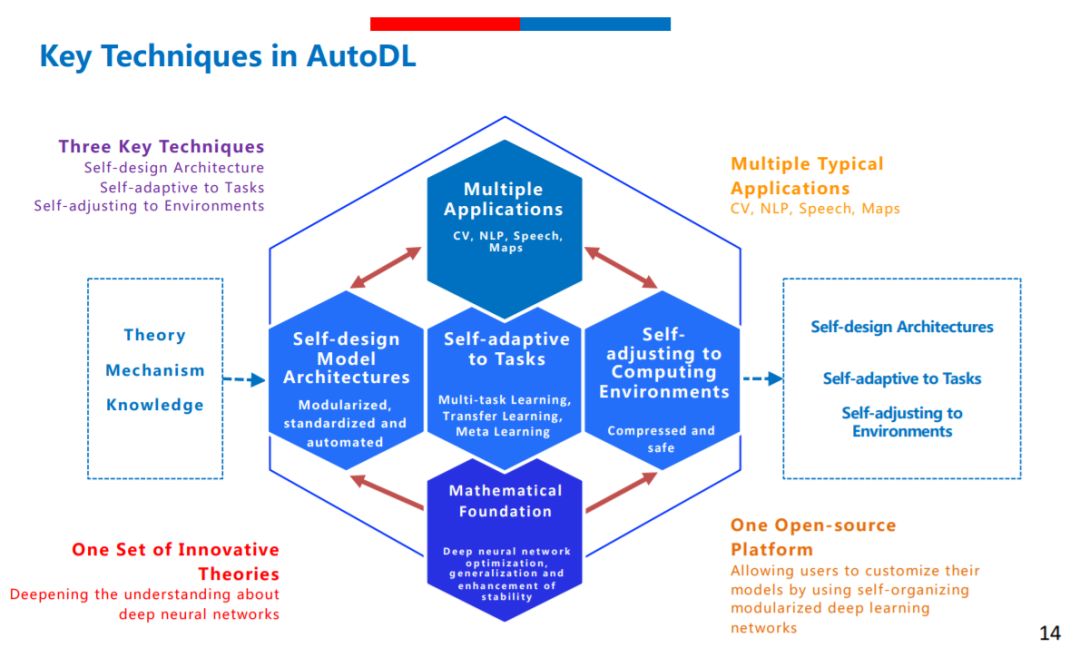

AutoDL关键技术

第二部分:神经架构搜索 A Tutorial on Neural Architecture Search

目录内容:AutoDL与NAS

神经架构搜索

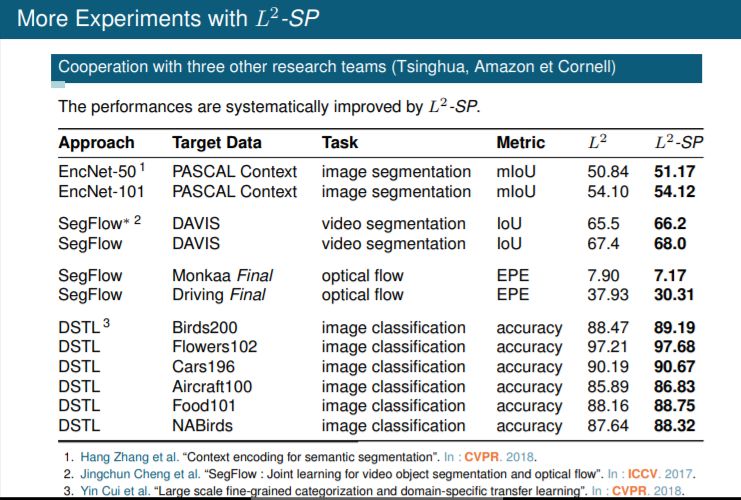

第三部分a:AutoDL迁移学习的参数正则化方案,Parameter Regularization Schemes for AutoDL Transfer Learning

第三部分b:AutoDL: 迁移学习的参数正则化方案,AutoDL Transfer Learning

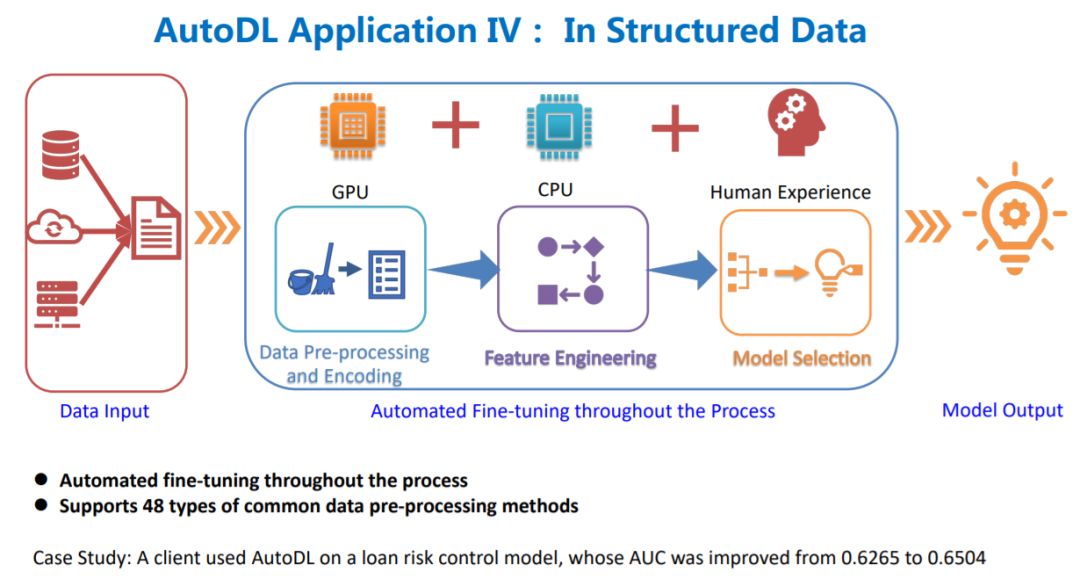

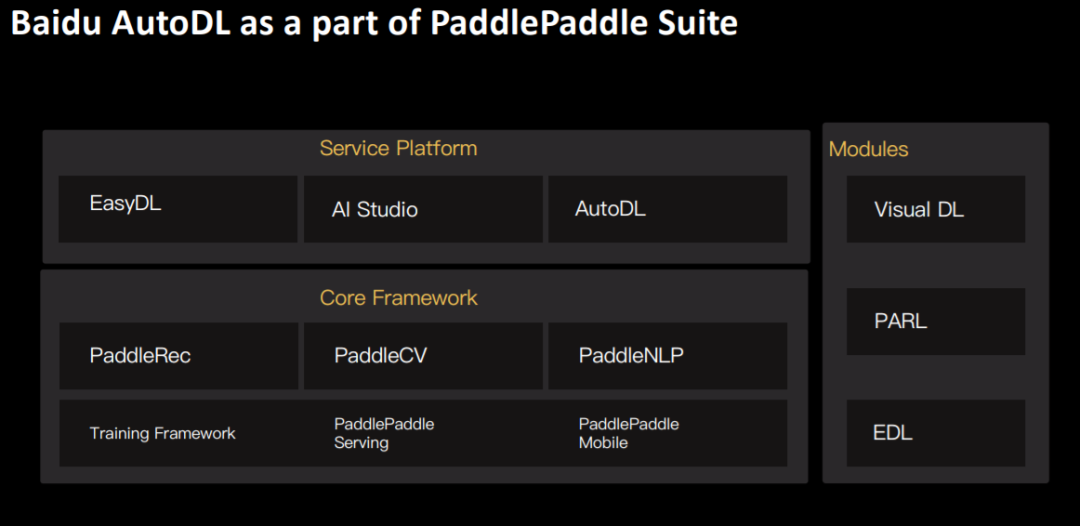

第四部分:Industrializing AI with Baidu AutoDL

参考文献:

B Zoph and QV Le. Neural Architecture Search with Reinforcement Learning. In ICLR, 2017.

B Zoph et al. Learning Transferable Architectures for Scalable Image Recognition. In CVPR, 2018.

H Pham et al. Efficient Neural Architecture Search via Parameter Sharing. In ICML, 2018.

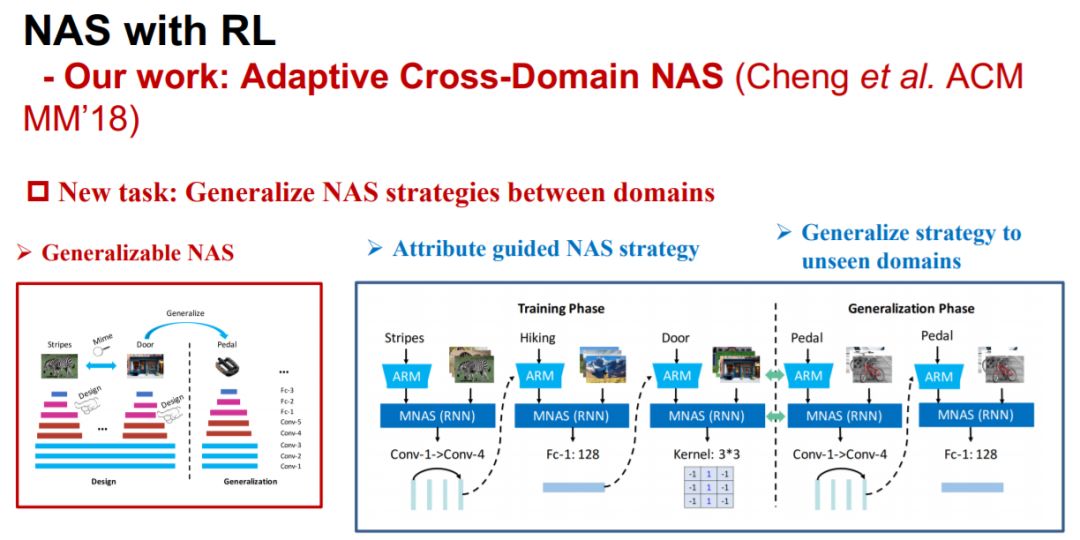

Z Cheng et al. Learning to Transfer: Generalizable Attribute Learning with Multitask Neural Model Search. In ACM MM, 2018.

Wang H, Huan J. AGAN: Towards Automated Design of Generative Adversarial Networks. arXiv:1906.11080, 2019.

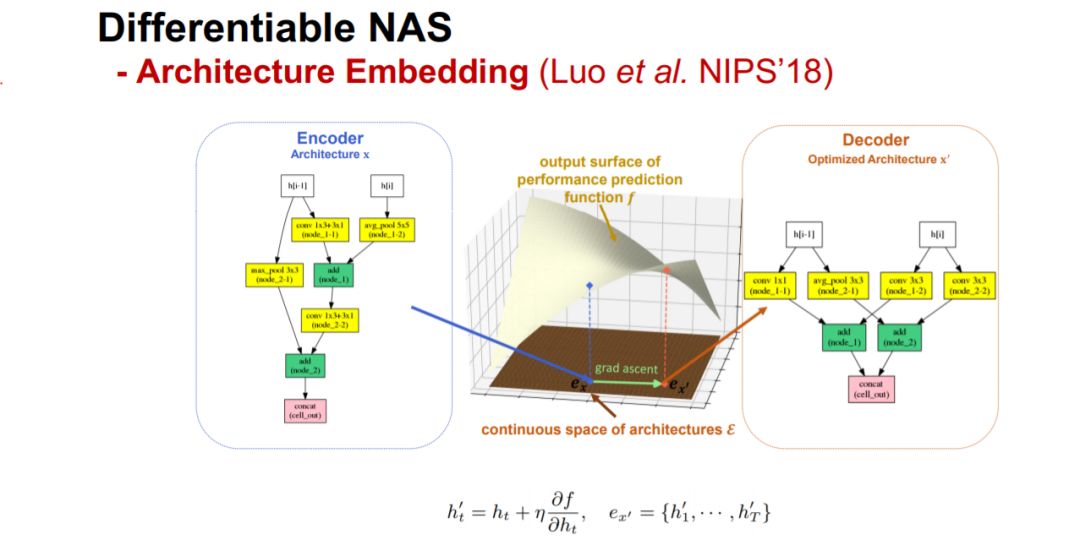

R Luo et al. Neural Architecture Optimization. In NIPS, 2018.

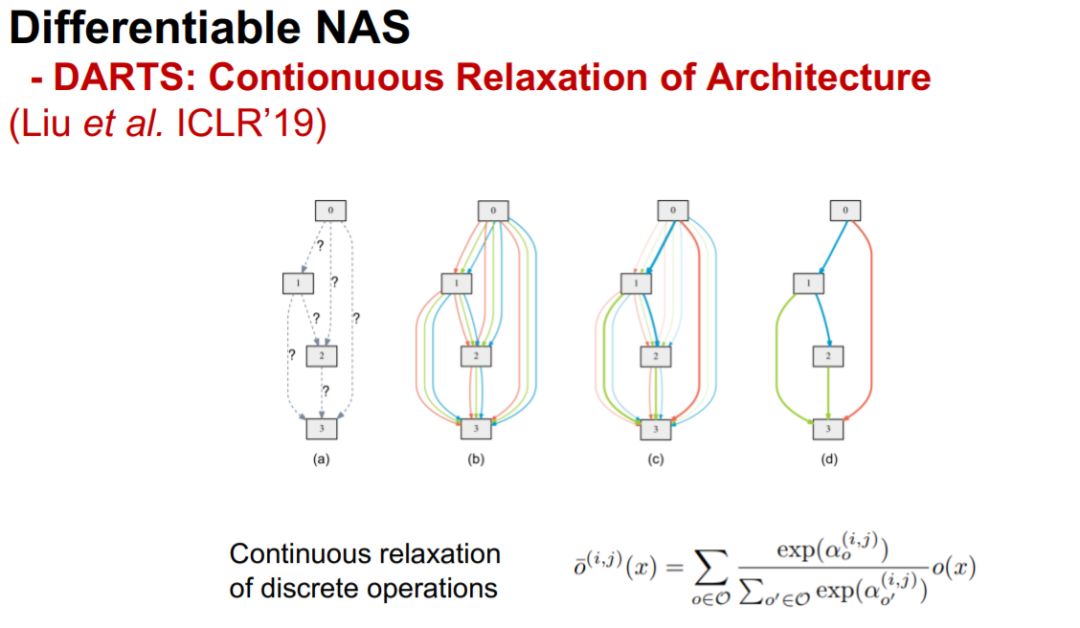

H Liu et al. Darts: Differentiable Architecture Search. In ICLR, 2019

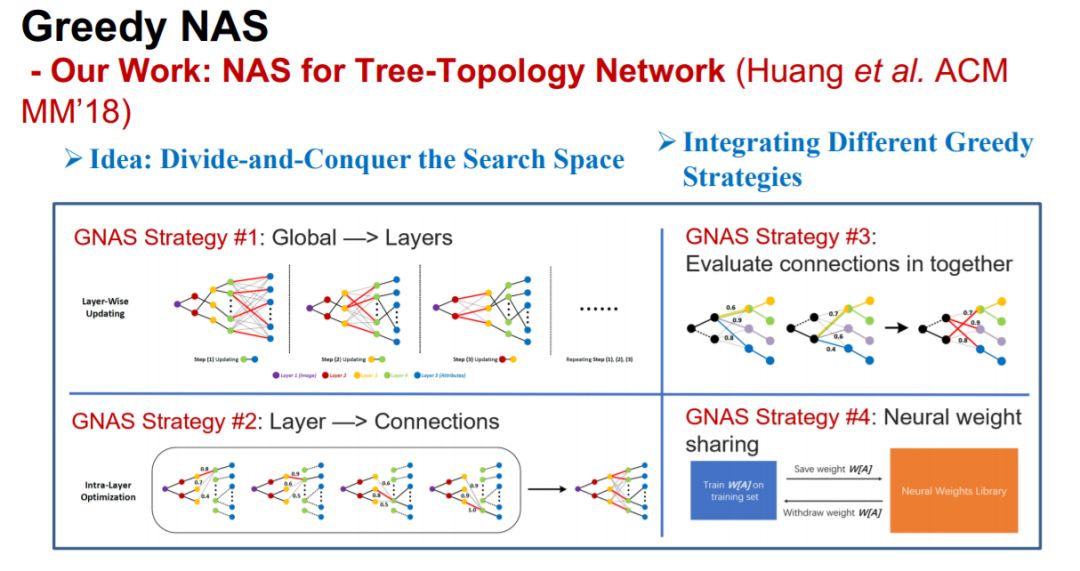

S Huang et al. GNAS: A Greedy Neural Architecture Search Method for Multi-Attribute Learning. In ACM MM, 2018.

便捷查看下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“自动深度学习” 就可以获取《百度AutoDL自动深度学习: 理论、算法、平台和应用》132页pdf专知下载索引链接